研究方向:Image Captioning

1. 論文介紹

本文提出ViLU(Vision-Language Uncertainties),一個用于學習視覺語言不確定性量化(UQ)和檢測視覺語言模型故障的事后框架。

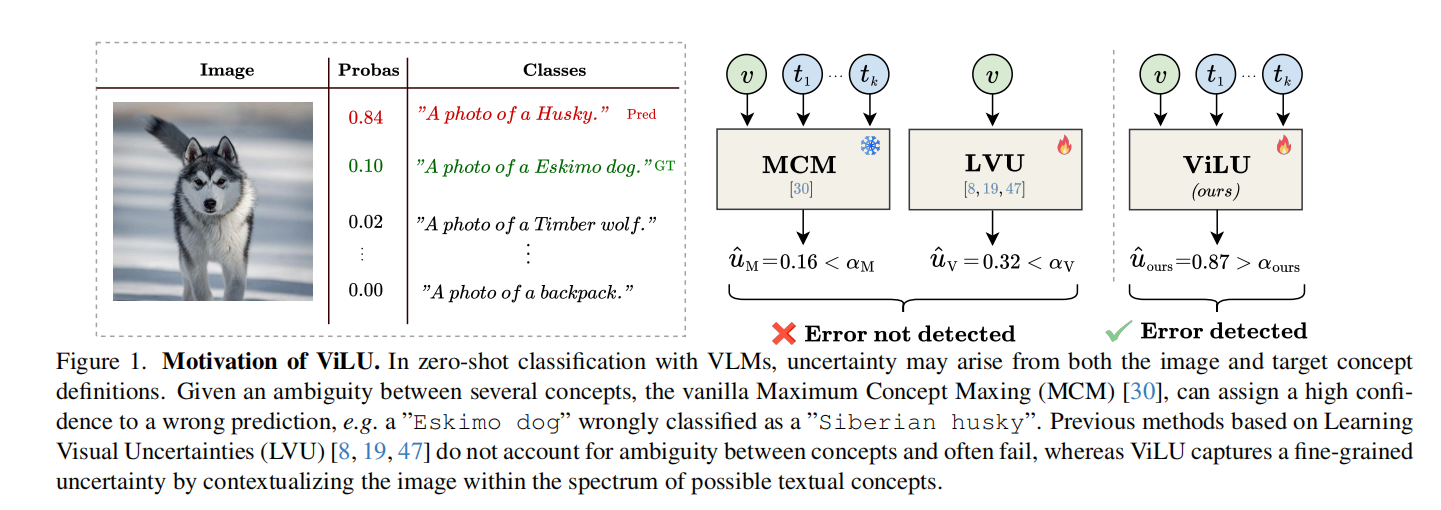

使用VLMs進行量化(UQ)的標準方法是最大概念匹配(MCM)分數(如果模型給某個類別分的概率最大,那就認為它最有可能是正確答案),但它存在根本性的缺陷:如果多個概念之間存在歧義,原始的最大概念最大化 (MCM) 可能會對錯誤的預測賦予較高的置信度,并且把模型對最可能類別的置信度作為可靠性指標。

如圖所示,視覺語言模型(VLM)誤將“愛斯基摩犬”圖像分類為“西伯利亞雪橇犬”,而且高置信度得分阻止了錯誤的檢測。

2. 方法介紹

2.1?在視覺語言模型上進行不確定性量化的方法學

采用一種事后方法,僅依賴于視覺和文本嵌入,設計不確定性量化度量。提供不確定性估計而無需修改內部表示、進行微調或依賴于訓練期間使用的損失函數。

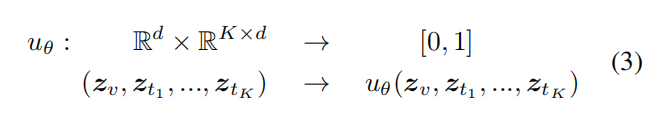

不確定性受視覺嵌入(低圖像質量、模糊特征)、文本嵌入(定義概念難以區分)和跨模態(視覺嵌入和K個候選文本嵌入之間)交互的影響。學習一個全局不確定性表示uθ?(?)(預測輸入是否會被視覺語言模型誤分類)來捕捉上述三種不確定性影響。不確定性模塊二元分類任務表示:

輸入圖像和K個候選文本嵌入表示,輸出一個概率值,表示 VLM 的預測是否錯誤。

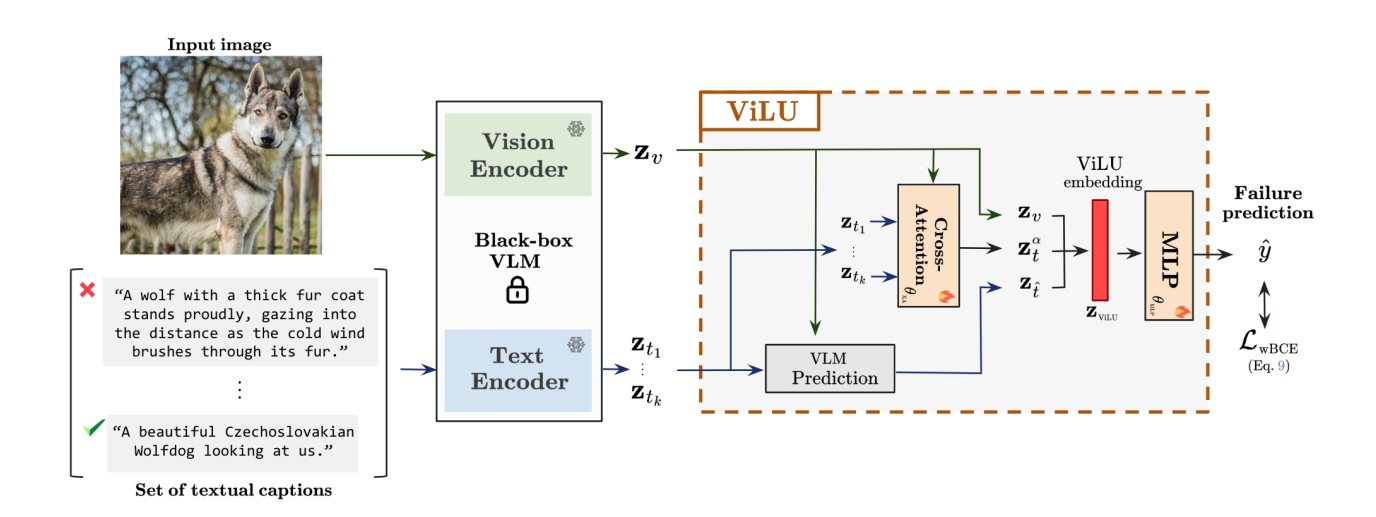

2.2 ViLU框架

通過整合視覺嵌入()、預測文本嵌入(

)和跨注意力生成的特定于圖像條件的文本表示(

),構建任務相關的聯合不確定性表征。ViLU將失敗預測建模為二元分類問題,采用加權交叉熵損失直接區分正確與錯誤預測,而非依賴損失預測,從而實現對預訓練VLMs的黑盒式后處理。

2.3?訓練過程

ViLU在訓練和推理過程中同時處理圖像-字幕任務和圖像-標簽任務

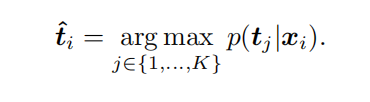

圖像-標簽任務:利用圖像和K個目標類別確定圖像的預測概念類別,形成一個與批次無關的預測流程。類別的文本表示通過文本模板獲得(例如,“一張[類別]的照片”),得到一組固定的文本字幕?。適用于具有預定義標簽的標準分類數據集。

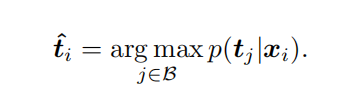

圖像-字幕任務:為給定的輸入圖像分配最相似的字幕,利用圖文對預測相應圖像的字幕,

一 歸一化)

egui (0.32.1) 學習筆記(逐行注釋)(十八) 使用表格)

)

)

:FreeRTOS任務掛起與解掛)