1. 引言

圖像模糊是數字圖像處理中的常見問題,其成因包括相機抖動、物體運動、聚焦不良等。傳統方法如維納濾波、Lucy-Richardson 算法等依賴于模糊核估計和逆濾波,在復雜場景下性能有限。生成對抗網絡(Generative Adversarial Networks, GAN)的出現為模糊圖像恢復提供了全新的解決方案。GAN 通過生成器與判別器的對抗訓練,能夠自動學習從模糊圖像到清晰圖像的非線性映射,在視覺效果和細節恢復上表現優異。本文將深入探討 GAN 在模糊圖像恢復中的具體原理、網絡架構、訓練策略及應用實踐。

2. GAN 的基本原理與結構

2.1 GAN 的核心思想

GAN 由生成器(Generator)和判別器(Discriminator)組成,二者通過對抗博弈優化。生成器的目標是將隨機噪聲或模糊圖像映射為逼真的清晰圖像,而判別器則區分生成圖像與真實清晰圖像。訓練過程中,生成器試圖欺騙判別器,而判別器則努力提高識別能力,最終達到納什均衡狀態,生成器能夠生成高質量的圖像。

2.2 生成器架構設計

生成器通常采用編碼器 - 解碼器結構,結合卷積和反卷積操作。例如,DeblurGAN 的生成器包含 3 個卷積塊、9 個殘差塊和 2 個轉置卷積塊,通過全局殘差連接加速訓練并提升泛化能力。殘差塊(Residual Block)通過跳躍連接保留輸入特征,避免梯度消失,適用于處理深層網絡。轉置卷積層用于上采樣,恢復圖像分辨率。

2.3 判別器架構設計

判別器通常采用 PatchGAN 結構,對圖像局部區域進行判別,而非全局判斷。例如,DeblurGAN 的判別器使用多層卷積提取特征,輸出每個圖像塊的真偽概率,最終取平均值作為全局判斷。這種設計有助于捕捉局部細節,提升判別精度。

3. 模糊圖像恢復的挑戰與解決方案

3.1 模糊類型與數據生成

模糊類型包括運動模糊、高斯模糊等。運動模糊的建模可通過隨機軌跡生成模糊核,例如 DeblurGAN 采用馬爾可夫過程生成復雜軌跡,模擬真實運動模糊。數據集方面,GOPRO 數據集通過多幀平均生成模糊圖像,而 HIDE 數據集則標注了人類區域,用于前景 - 背景區分的去模糊任務。

3.2 損失函數設計

對抗損失:基于 Wasserstein GAN(WGAN)或 WGAN-GP,使用梯度懲罰項穩定訓練,避免模式崩潰。公式為:

其中,

為梯度懲罰系數,

為插值樣本。

內容損失:采用預訓練的 VGG 網絡提取特征,計算生成圖像與真實圖像的 L2 距離(感知損失),公式為:

其中,

表示 VGG 網絡第 i 個塊的第 j 層特征。

結構損失:結合 L1 或 L2 損失,確保像素級相似性,公式為:

?或:

邊緣與紋理損失:通過邊緣檢測算子(如 Sobel)提取邊緣信息,或使用局部二進制模式(LBP)評估紋理一致性,增強細節恢復。

4. 訓練策略與技巧

4.1 優化器與學習率調整

常用 Adam 優化器,學習率初始化為\(10^{-4}\),采用線性衰減策略,前 150 個 epoch 保持不變,后 150 個 epoch 線性降至 0。Batch Size 通常設為 1 或 4,以適應內存限制。

4.2 正則化與穩定性增強

譜歸一化(Spectral Normalization):對判別器權重矩陣進行歸一化,限制其 Lipschitz 常數,防止梯度爆炸。通過冪迭代法近似計算矩陣的譜范數,公式為:

其中,

為矩陣 W 的譜范數。

小批量判別(Minibatch Discrimination):引入小批量統計信息,避免模式崩潰。計算每個樣本與其他樣本的特征差異,生成多樣性更高的圖像。

4.3 數據增強與預處理

對輸入模糊圖像進行隨機裁剪、旋轉、縮放等操作,增加數據多樣性。同時,對圖像進行歸一化(如標準化至 [-1, 1]),加速訓練收斂。

5. 典型模型與應用

5.1 DeblurGAN 系列

- DeblurGAN:采用條件 GAN(cGAN)架構,生成器包含殘差塊和轉置卷積層,判別器使用 PatchGAN。結合 WGAN-GP 和感知損失,在 GoPro 數據集上取得優異表現。

- DeblurGAN-v2:引入特征金字塔網絡(FPN),結合多尺度特征融合,支持輕量骨干網絡(如 MobileNet)實現實時去模糊。判別器采用 relativistic loss,提升訓練穩定性。

5.2 CycleGAN 在非配對數據中的應用

CycleGAN 通過循環一致性損失實現非配對數據的轉換,適用于無清晰 - 模糊圖像對的場景。例如,在透射文本恢復中,CycleGAN 結合注意力機制,非均勻處理不同文本特征,有效去除背面信息。

5.3 醫療影像去模糊

在 CT 重建中,GAN 可將 5mm 層厚掃描數據提升至 0.5mm 精度,結合感知損失和結構損失,減少偽影并保留解剖結構細節。

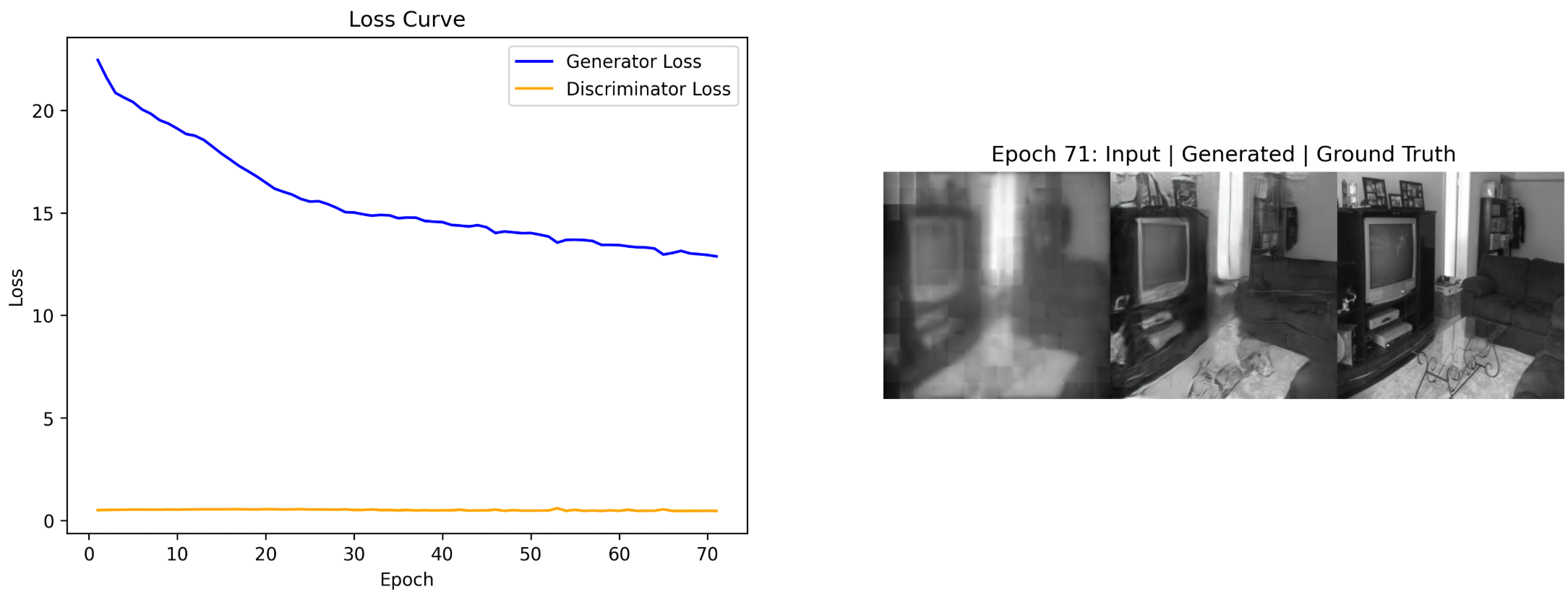

6. 評估指標與實驗分析

6.1 定量指標

峰值信噪比(PSNR):衡量像素級差異,公式為:

其中,

為像素最大值(通常為 255),MSE 為均方誤差。

結構相似性指數(SSIM):評估圖像結構相似性,范圍在 [-1, 1],值越接近 1 表示質量越好。

LPIPS(Learned Perceptual Image Patch Similarity):基于預訓練網絡的特征距離,更接近人類感知。

6.2 定性分析

通過視覺對比展示恢復結果,觀察邊緣清晰度、紋理細節和偽影情況。例如,DeblurGAN 在 GoPro 數據集上的恢復結果在 SSIM 和視覺效果上均優于傳統方法。

7. 挑戰與未來方向

7.1 現有挑戰

- 模糊核未知性:盲去模糊需同時估計模糊核和清晰圖像,增加模型復雜度。

- 噪聲干擾:低信噪比圖像中,GAN 易生成偽影。

- 計算資源需求:深層網絡和高分辨率圖像恢復需要大量 GPU 內存和計算時間。

7.2 未來方向

- 自監督學習:利用單幅模糊圖像的先驗信息(如邊緣、紋理)進行無監督訓練。

- 多模態融合:結合光學信息(如深度圖、光譜數據)提升恢復精度。

- 輕量化模型:設計高效網絡結構(如 MobileNet、Transformer),實現實時處理。

- 倫理與法律:在文物修復、醫療影像等領域,需確保恢復結果的真實性和合規性。

8. 結論

GAN 通過對抗訓練和多損失函數的結合,在模糊圖像恢復中展現了強大的能力。從基礎原理到具體實現,從網絡架構到訓練策略,GAN 為圖像恢復提供了端到端的解決方案。未來,隨著技術的不斷進步,GAN 有望在更多領域實現高精度、高效率的模糊圖像恢復,推動數字圖像處理技術的發展。

代碼示例(DeblurGAN 生成器部分)

import torch

import torch.nn as nnclass ResidualBlock(nn.Module):def __init__(self, channels):super(ResidualBlock, self).__init__()self.conv1 = nn.Conv2d(channels, channels, kernel_size=3, padding=1)self.in1 = nn.InstanceNorm2d(channels)self.relu = nn.ReLU(inplace=True)self.conv2 = nn.Conv2d(channels, channels, kernel_size=3, padding=1)self.in2 = nn.InstanceNorm2d(channels)def forward(self, x):residual = xout = self.conv1(x)out = self.in1(out)out = self.relu(out)out = self.conv2(out)out = self.in2(out)out += residualreturn outclass Generator(nn.Module):def __init__(self, input_channels=3, output_channels=3):super(Generator, self).__init__()self.conv1 = nn.Conv2d(input_channels, 64, kernel_size=7, padding=3)self.in1 = nn.InstanceNorm2d(64)self.relu = nn.ReLU(inplace=True)self.conv2 = nn.Conv2d(64, 128, kernel_size=3, stride=2, padding=1)self.in2 = nn.InstanceNorm2d(128)self.conv3 = nn.Conv2d(128, 256, kernel_size=3, stride=2, padding=1)self.in3 = nn.InstanceNorm2d(256)self.res_blocks = nn.Sequential(ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256),ResidualBlock(256))self.deconv1 = nn.ConvTranspose2d(256, 128, kernel_size=3, stride=2, padding=1, output_padding=1)self.in4 = nn.InstanceNorm2d(128)self.deconv2 = nn.ConvTranspose2d(128, 64, kernel_size=3, stride=2, padding=1, output_padding=1)self.in5 = nn.InstanceNorm2d(64)self.conv_out = nn.Conv2d(64, output_channels, kernel_size=7, padding=3)self.tanh = nn.Tanh()def forward(self, x):x = self.conv1(x)x = self.in1(x)x = self.relu(x)x = self.conv2(x)x = self.in2(x)x = self.relu(x)x = self.conv3(x)x = self.in3(x)x = self.relu(x)x = self.res_blocks(x)x = self.deconv1(x)x = self.in4(x)x = self.relu(x)x = self.deconv2(x)x = self.in5(x)x = self.relu(x)x = self.conv_out(x)x = self.tanh(x)return x以下論文是去模糊方面的,可以參考下:

[1] Goodfellow I, et al. Generative adversarial nets. NIPS 2014.

[2] Kupyn O, et al. DeblurGAN: Blind motion deblurring using conditional adversarial networks. CVPR 2018.

[3] Ledig C, et al. Photo-realistic single image super-resolution using a generative adversarial network. CVPR 2017.

[4] Miyato T, et al. Spectral normalization for generative adversarial networks. ICLR 2018.

[5] Zhu J Y, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks. ICCV 2017.

[6] 基于生成對抗網絡的圖像去模糊技術研究與應用. CSDN 博客,2025.

[7] 深度學習去運動模糊 ----《DeblurGAN》. CSDN 博客,2025.

[8] 譜歸一化在 GAN 中的運用. CSDN 博客,2024.

[9] 基于 CycleGAN 的透射文本圖像復原。哈爾濱工業大學,2025.

[10] 2024 最全 python 圖像修復指南. CSDN 博客,2025.

![【URP】[法線貼圖]為什么主要是藍色的?](http://pic.xiahunao.cn/【URP】[法線貼圖]為什么主要是藍色的?)

)

)