文章目錄

- 1. 相關資源

- 2. 核心特性

- 3. 安裝與使用(Docker Compose 部署)

- 3.1 部署Dify

- 3.2 更新Dify

- 3.3 重啟Dify

- 3.4 訪問Dify

- 4. 接入本地模型

- 4.1 接入 Ollama 本地模型

- 4.1.1 步驟

- 4.1.2 常見問題

- 4.2 接入 Vllm 本地模型

- 5. 進階應用場景

- 6. 總結

1. 相關資源

- 官網

- Github

- 說明文檔

2. 核心特性

- ? 多模型支持:兼容 OpenAI、Anthropic、Ollama、VLLM、Hugging Face 等數百種模型。

- ? 可視化 Prompt 編排:無需代碼,通過界面調整 AI 行為。

- ? RAG 增強檢索:支持知識庫上傳(PDF/TXT/Markdown 等),提升回答準確性。

- ? Agent 框架:可構建自動化 AI 工作流(如數據分析、客服機器人)。

- ? 靈活部署:支持 Docker 一鍵部署,適配本地、云端及混合環境。

3. 安裝與使用(Docker Compose 部署)

參考資料

Docker Compose 部署

在運行安裝命令之前,請確保您的機器上安裝了 Docker 和 Docker Compose,安裝 Docker 以及 Docker Compose 的具體步驟可以參考 Ubuntu 24.04 完整Docker安裝指南:從零配置到實戰命令大全。

3.1 部署Dify

cd ~/workspace/ai/tools && git clone --depth 1 git@gitee.com:dify_ai/dify.git && cd dify/docker

cp .env.example .env

# 啟動 Docker 容器,未將當前用戶加入docker組的話,需要使用sudo

docker compose up -d

# 檢查容器是否都正常運行

docker compose ps

值得注意的是,如果版本是 Docker Compose V1,在使用命令 docker compose 的時候,需要換成 docker-compose,例如 docker-compose up -d。

3.2 更新Dify

cd dify/docker

docker compose down

git pull origin main

docker compose pull

docker compose up -d

注意:

- 如果

.env.example文件有更新,請務必同步修改你本地的.env文件。 - 檢查

.env文件中的所有配置項,確保它們與你的實際運行環境相匹配。你可能需要將.env.example中的新變量添加到.env文件中,并更新已更改的任何值。 - 更新后需要重啟 Dify

3.3 重啟Dify

# 停止Dify

docker compose down

# 啟動Dify

docker compose up -d

3.4 訪問Dify

# 本地環境

http://localhost# 服務器環境

http://your_server_ip

4. 接入本地模型

4.1 接入 Ollama 本地模型

參考資料

接入 Ollama 部署的本地模型

私有化部署 Ollama + DeepSeek + Dify,構建你的專屬私人 AI 助手

筆者實驗環境為 Ubuntu24.04,宿主機啟動 Ollama 服務 + Docker Compose部署 Dify

4.1.1 步驟

- 點擊 Dify 平臺右上角頭像 → 設置 → 模型供應商,選擇

Ollama,點擊“添加模型”(若 Dify 平臺中 Ollama 插件未安裝的話,需要先點擊“安裝”)。 - 輸入模型名稱、基礎URL,其他選項可使用默認設置即可,點擊“保存”。其中:

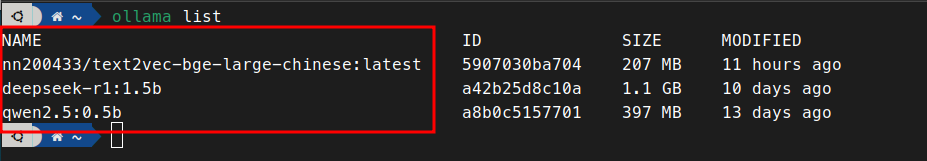

模型名稱為 Ollama 服務中的模型名稱,可通過ollama list獲取

基礎URL為 Ollama 服務地址,例如http://host.docker.internal:11434

4.1.2 常見問題

-

Connection refused問題

使用官方文檔中的

http://host.docker.internal:11434作為基礎URL,可能會出現httpconnectionpool (host=localhost, port=11434): max retries exceeded with url:/cpi/chat (Caused by NewConnectionError ('<urllib3.connection.HTTPConnection object at 0x7f8562812c20>: fail to establish a new connection:[Errno 111] Connection refused'))錯誤,此時需要直接使用宿主機的IP地址。解決步驟:

-

設置 Ollama 服務監聽地址

# 修改 ollama.service 文件,添加 OLLAMA_HOST 環境變量 sudo vim /etc/systemd/system/ollama.service # 在 [Service] 下添加 Environment="OLLAMA_HOST=0.0.0.0:11434" # 重新加載配置文件 sudo systemctl daemon-reload sudo systemctl restart ollama # 查看服務狀態,確保 ollama 服務以 :::11434 啟動 sudo netstat -tulnp | grep ollama # 重啟Dify docker compose down docker compose up -d -

獲取本機IP地址

# 獲取本機IP地址,假如輸出為 192.168.163.248 hostname -I | awk '{print $1}' # 測試以本機IP是否可以查看ollama模型列表(需要將 192.168.163.248 替換為上一步實際輸出的IP地址) curl http://192.168.163.248:11434/api/tags # 應成功返回模型列表 -

開啟防火墻端口

如果仍有問題,考慮是否防火墻攔截了

11434端口,需要配置防火墻規則。sudo ufw allow 11434/tcp && sudo ufw reload -

修改基礎URL配置

修改基礎URL配置,將

http://host.docker.internal:11434修改為http://192.168.163.248:11434,再次點擊保存即可。

-

4.2 接入 Vllm 本地模型

- 點擊 Dify 平臺右上角頭像 → 設置 → 模型供應商,選擇

Vllm,點擊“添加模型”(若 Dify 平臺中 Vllm 插件未安裝的話,需要先點擊“安裝”)。 - 輸入模型名稱、API endpoint URL,其他選項可使用默認設置即可,點擊“保存”。其中:

模型名稱為 Vllm 服務啟動的模型名稱API endpoint URL為 Vllm 服務地址,例如http://192.168.163.248:8000/v1

5. 進階應用場景

🔹 知識庫問答:上傳企業文檔,構建智能客服。

🔹 AI 工作流:結合 Agent 實現自動化任務(如郵件撰寫+數據分析)。

🔹 私有化部署:企業級數據安全,完全本地運行。

6. 總結

Dify 是當前最易用的開源 LLM 應用平臺之一,適合快速搭建 AI 應用。本文詳細介紹了 Docker 部署、Ollama/VLLM 本地模型接入 及常見問題排查,幫助開發者高效落地 AI 項目。

)

)

)