歡迎關注我的公眾號:Halo咯咯

01。概述

北京大學的研究人員聯合微軟研究院、滑鐵盧大學以及Vector研究所共同推出了EAGLE-2,這是一種利用上下文感知的動態草圖樹來增強推測性采樣的方法。EAGLE-2在先前的EAGLE方法基礎上進行了改進,不僅顯著提升了速度,同時保持了生成文本的質量。該方法根據上下文動態調整草圖樹,并利用草圖模型的置信度分數來近似接受率。

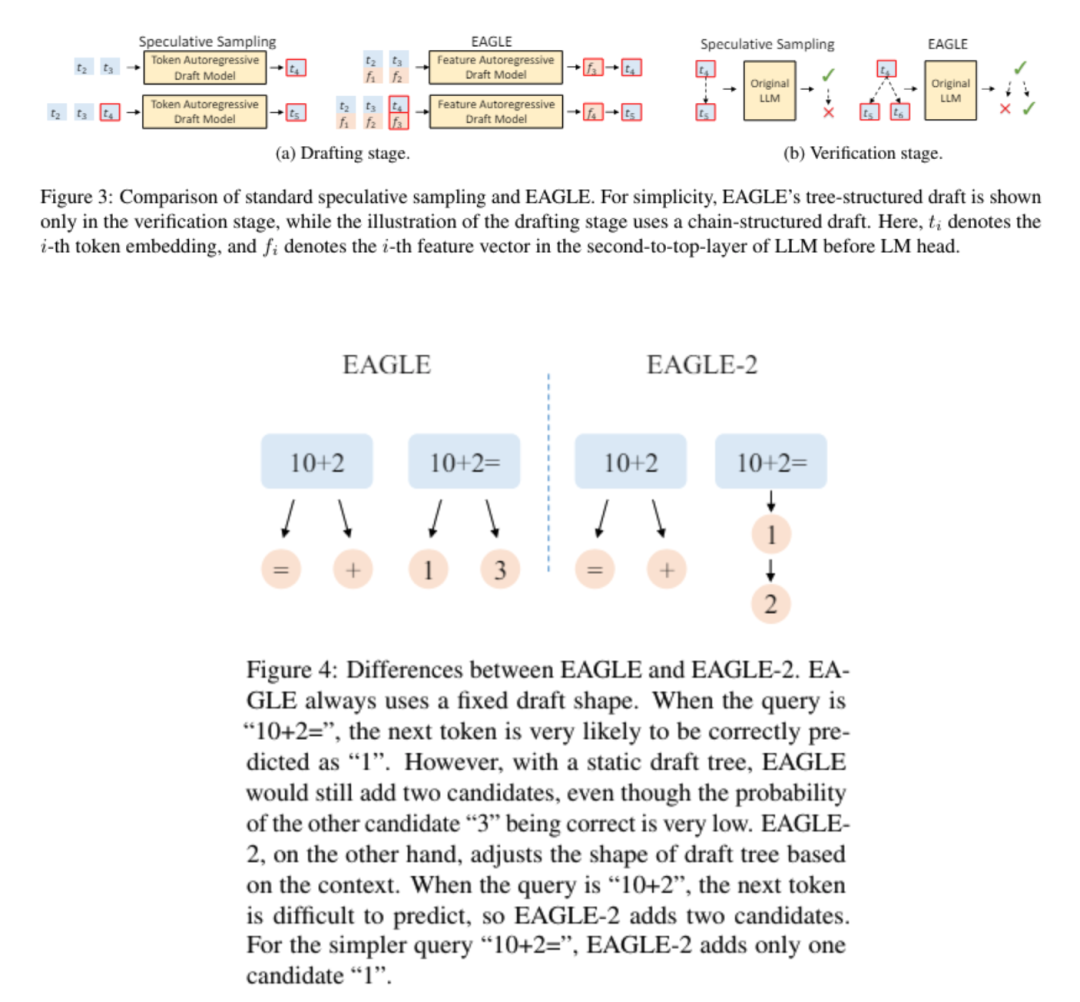

EAGLE-2通過上下文動態調整草圖樹,優化了推測性采樣過程。該方法包含兩個主要階段:擴展和重新排名。首先,在擴展階段,草圖模型從草圖樹的最新層輸入最有希望的節點,以形成下一層。草圖模型的置信度分數近似于接受率,從而可以高效地預測和驗證代幣。隨后,在重新排名階段,驗證過程中為原始語言模型(LLM)的輸入選擇具有較高接受概率的代幣。這種兩階段的方法確保草圖樹能夠適應上下文,顯著提高了代幣的接受率和整體效率。該方法消除了多次前向傳遞的需求,從而加快了推理過程,同時不影響生成文本的質量。

02。EAGLE特點

-

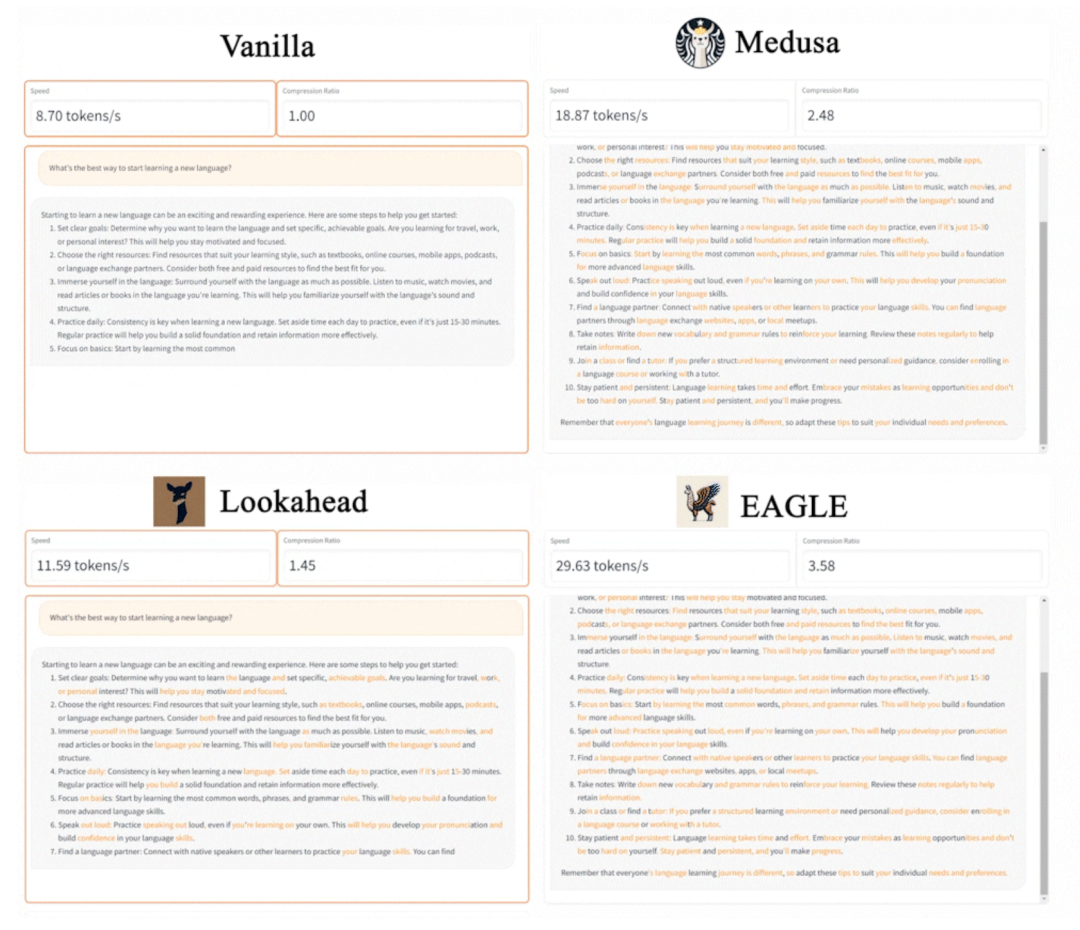

EAGLE技術以其卓越的性能獲得第三方評估機構的認證,成為迄今為止最快的推測性方法。

-

在gpt-fast上實現2倍速度提升,在標準解碼(13B參數模型)上快3倍,比Lookahead(13B參數模型)快2倍,比Medusa(13B參數模型)快1.6倍。

-

EAGLE技術在生成文本的分布上能夠保證與傳統解碼方法的一致性。此外,它可在1至2天內完成訓練,并在8個RTX 3090 GPU上進行測試,使得即使是GPU資源有限的研究人員也能夠承擔得起。

-

EAGLE技術還可以與其他并行技術如vLLM、DeepSpeed、Mamba、FlashAttention、量化技術以及硬件優化等相結合使用。

03。EAGLE2性能

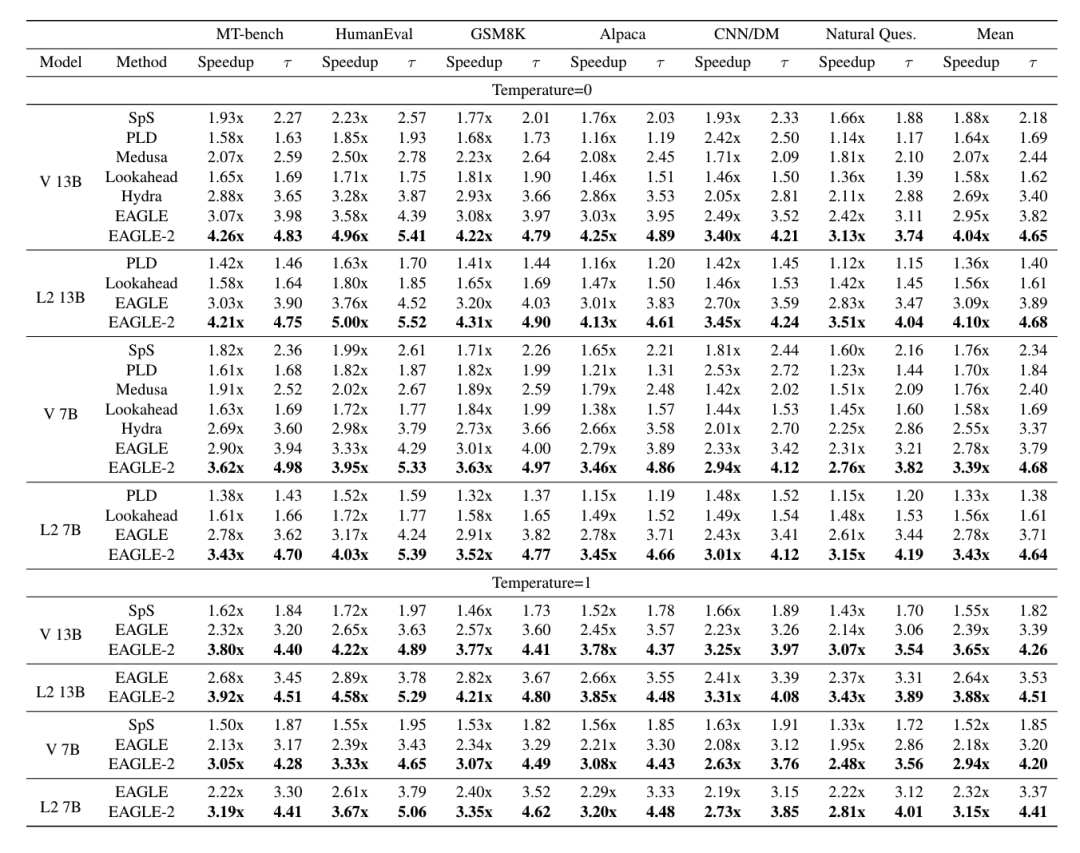

在多輪對話場景中,EAGLE-2實現了大約4.26倍的加速;在代碼生成任務中,其速度提升高達5倍。在草擬-驗證周期內生成的平均代幣數量顯著高于其他方法,大約是標準推測性采樣的兩倍。這種性能提升使EAGLE-2成為實時自然語言處理應用的寶貴工具。

性能評估還表明,EAGLE-2在不同任務和大型語言模型(LLM)上實現了3.05倍至4.26倍的加速比率,比之前的EAGLE方法提升了20%至40%。它保持了生成文本的分布,確保了在提高速度的同時不損失輸出質量。EAGLE-2在涵蓋六項任務和三個系列的大型語言模型的廣泛測試中展現了最佳性能,證實了其魯棒性和高效率。

參考:

1.https://arxiv.org/abs/2406.16858

2.https://github.com/SafeAILab/EAGLE

中的實現。)

V2.0.5版本詳細更新內容)