數據中心

一、DNS

現在網站的數目非常多,常用的網站就有二三十個,如果全部用 IP 地址進行訪問,恐怕很難記住

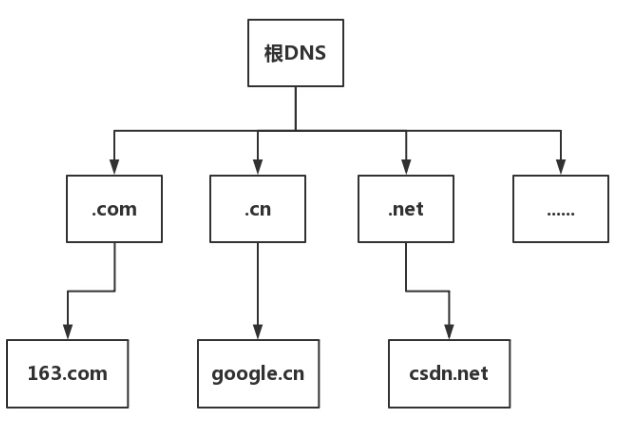

根 DNS 服務器 :返回頂級域 DNS 服務器的 IP 地址

頂級域 DNS 服務器:返回權威 DNS 服務器的 IP 地址

權威 DNS 服務器 :返回相應主機的 IP 地址

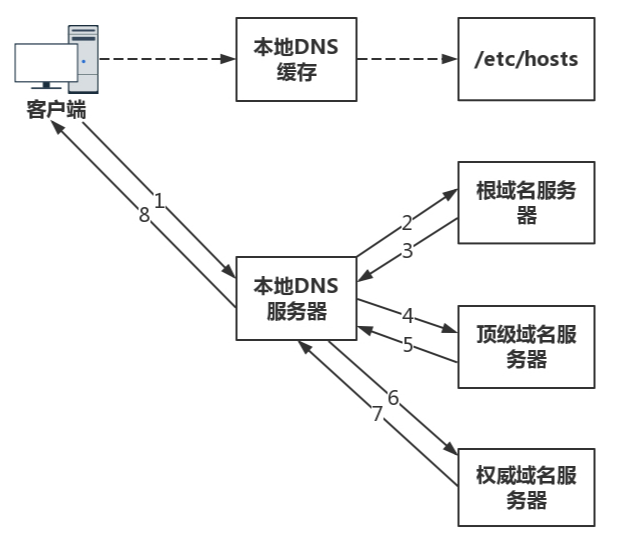

1 電腦客戶端會發出一個 DNS 請求,問 www.163.com 的 IP 是啥啊,并發給本地域名服務器 (本地 DNS)。那本地域名服務器 (本地 DNS) 是什么呢?如果是通過 DHCP 配置,本地 DNS 由你的網絡服務商(ISP),如電信、移動等自動分配,它通常就在你網絡服務商的某個機房。

2 本地 DNS 收到來自客戶端的請求。你可以想象這臺服務器上緩存了一張域名與之對應 IP 地址的大表格。如果能找到 www.163.com,它直接就返回 IP 地址。如果沒有,本地 DNS 會去問它的根域名服務器:“老大,能告訴我 www.163.com 的 IP 地址嗎?”根域名服務器是最高層次的,全球共有 13 套。它不直接用于域名解析,但能指明一條道路。

3 根 DNS 收到來自本地 DNS 的請求,發現后綴是 .com,說:“哦,www.163.com 啊,這個域名是由.com 區域管理,我給你它的頂級域名服務器的地址,你去問問它吧。”

4 本地 DNS 轉向問頂級域名服務器:“老二,你能告訴我 www.163.com 的 IP 地址嗎?”頂級域名服務器就是大名鼎鼎的比如 .com、.net、 .org 這些一級域名,它負責管理二級域名,比如 163.com,所以它能提供一條更清晰的方向。

5 頂級域名服務器說:“我給你負責 www.163.com 區域的權威 DNS 服務器的地址,你去問它應該能問到。”

6 本地 DNS 轉向問權威 DNS 服務器:“您好,www.163.com 對應的 IP 是啥呀?”163.com 的權威 DNS 服務器,它是域名解析結果的原出處。為啥叫權威呢?就是我的域名我做主。

7 權限 DNS 服務器查詢后將對應的 IP 地址 X.X.X.X 告訴本地 DNS。

8 本地 DNS 再將 IP 地址返回客戶端,客戶端和目標建立連接。

至此,我們完成了 DNS 的解析過程。現在總結一下,整個過程我畫成了一個圖。

負載均衡

一個應用要訪問數據庫,在這個應用里面應該配置這個數據庫的 IP 地址,還是應該配置這個數據庫的域名呢?顯然應該配置域名,因為一旦這個數據庫,因為某種原因,換到了另外一臺機器上,而如果有多個應用都配置了這臺數據庫的話,一換 IP 地址,就需要將這些應用全部修改一遍。但是如果配置了域名,則只要在 DNS 服務器里,將域名映射為新的 IP 地址,這個工作就完成了,大大簡化了運維。

另外一個壞了,還可以更換另一個

肯定希望北京的用戶訪問北京的數據中心,上海的用戶訪問上海的數據中心,這樣,客戶體驗就會非常好,訪問速度就會超快。這就是全局負載均衡的概念。

在域名和 IP 的映射過程中,給了應用基于域名做負載均衡的機會,可以是簡單的負載均衡,也可以根據地址和運營商做全局的負載均衡。

DNS 的兩項功能,第一是根據名稱查到具體的地址,另外一個是可以針對多個地址做負載均衡,而且可以在多個地址中選擇一個距離你近的地方訪問。

二、HTTPDNS:網絡世界的地址簿也會指錯路

HTTPDNS是一種基于HTTP協議實現的域名解析服務。它主要用于解決傳統DNS(域名系統)服務中存在的一些問題,如解析速度慢、解析不穩定、解析結果被劫持等。

解決的問題:

- 解析速度:HTTPDNS通過直接向HTTPDNS服務器發送HTTP請求來獲取域名對應的IP地址,可以減少DNS查詢的延遲,提高解析速度。

- 穩定性:HTTPDNS服務通常由大型云服務商提供,具有較高的穩定性和可靠性。

- 安全性:由于HTTPDNS使用HTTPS等加密協議,可以防止DNS劫持和污染,確保域名解析的安全性。

- 準確性:HTTPDNS可以提供更準確的地理位置解析,優化訪問速度。

運轉方式:

HTTPDNS的工作原理相對簡單,可以概括為以下幾個步驟:

- 域名請求:當客戶端(如手機應用或網站)需要訪問一個域名時,它會向HTTPDNS服務器發送一個HTTP請求。

- 解析域名:HTTPDNS服務器接收到請求后,會查找其內部數據庫,將域名解析為IP地址。

- 返回結果:解析完成后,HTTPDNS服務器通過HTTP響應將IP地址返回給客戶端。

- 緩存結果:客戶端接收到IP地址后,通常會將其緩存起來,以便后續使用時可以直接從緩存中獲取,減少對HTTPDNS服務器的請求。

舉例說明:

假設你正在使用一個在線視頻播放應用,當你點擊一個視頻鏈接時,應用需要解析視頻服務器的域名以獲取視頻內容。如果沒有使用HTTPDNS,應用可能會通過傳統的DNS服務來解析域名,這個過程可能受到網絡環境的影響,解析速度較慢,且存在被劫持的風險。

使用HTTPDNS后,應用會向HTTPDNS服務器發送一個HTTP請求,請求解析視頻服務器的域名。HTTPDNS服務器快速響應,返回了視頻服務器的真實IP地址。應用接收到IP地址后,就可以直接連接到視頻服務器,開始播放視頻。由于HTTPDNS的解析速度快,穩定性好,整個視頻播放體驗會得到顯著提升。

https 和 http

HTTP(HyperText Transfer Protocol)和HTTPS(HyperText Transfer Protocol Secure)都是用于從網絡傳輸超文本到本地瀏覽器的傳輸協議,但它們之間存在一些關鍵的區別:

-

安全性:

- HTTP:是超文本傳輸協議的非安全版本,它在傳輸數據時不會進行加密,這意味著數據在傳輸過程中可能會被截獲或篡改。

- HTTPS:在HTTP的基礎上加入了SSL/TLS協議,提供了數據加密、完整性校驗和身份驗證。這使得傳輸的數據更安全,可以防止數據在傳輸過程中被竊聽或篡改。

-

端口:

- HTTP:默認使用80端口進行通信。

- HTTPS:默認使用443端口進行通信。

-

URL 表示:

- HTTP:網址通常以

http://開始。 - HTTPS:網址以

https://開始,這個額外的"s"代表"secure",即安全。

- HTTP:網址通常以

-

搜索引擎優化(SEO):

- 使用HTTPS的網站可能會獲得搜索引擎如Google的輕微偏好,因為它們提供了更安全的連接。

-

信任和認證:

- HTTPS需要安裝SSL證書,這通常涉及到購買證書和配置服務器的過程。證書頒發機構(CA)會對網站進行身份驗證,確保訪問者連接的是他們想要訪問的網站。

-

性能:

- 由于加密和解密過程需要消耗計算資源,HTTPS通常會比HTTP有稍微的性能開銷,但隨著現代硬件和優化算法的發展,這種差異已經變得非常小。

-

用戶信任:

- 當用戶訪問一個使用HTTPS的網站時,瀏覽器會顯示一個鎖形圖標,這可以增加用戶對網站的信任度。

-

兼容性:

- 幾乎所有的現代瀏覽器都支持HTTPS,并且鼓勵網站使用HTTPS來保護用戶數據。

簡而言之,HTTPS是HTTP的安全版本,它通過加密技術保護數據傳輸的安全,是當前推薦的網站連接方式,特別是在處理敏感信息(如登錄憑據、支付信息等)時。

三、CDN:你去小賣部取過快遞么?

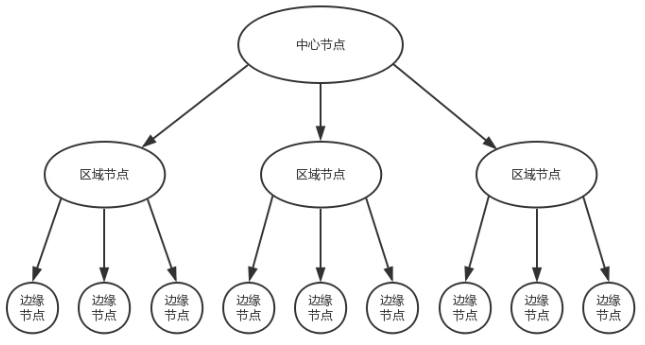

CDN 的分發系統的架構

由于邊緣節點數目比較多,但是每個集群規模比較小,不可能緩存下來所有東西,因而可能無法命中,這樣就會在邊緣節點之上。有區域節點,規模就要更大,緩存的數據會更多,命中的概率也就更大。在區域節點之上是中心節點,規模更大,緩存數據更多。如果還不命中,就只好回源網站訪問了。

很多 CDN 還提供預處理服務,也即文件在分發之前,經過一定的處理。例如將視頻轉換為不同的碼流,以適應不同的網絡帶寬的用戶需求;再如對視頻進行分片,降低存儲壓力,也使得客戶端可以選擇使用不同的碼率加載不同的分片。這就是我們常見的,“我要看超清、標清、流暢等”。

CDN 和電商系統的分布式倉儲系統一樣,分為中心節點、區域節點、邊緣節點,而數據緩存在離用戶最近的位置。

CDN 最擅長的是緩存靜態數據,除此之外還可以緩存流媒體數據,這時候要注意使用防盜鏈。它也支持動態數據的緩存,一種是邊緣計算的生鮮超市模式,另一種是鏈路優化的冷鏈運輸模式。

冷鏈運輸模式就像優化的物流網絡,確保數據從源站到用戶的傳輸路徑是最優的。通過CDN節點的分布和路徑優化,數據傳輸變得更加高效和可靠。這樣,即使數據不是在邊緣節點生成的,也能通過路徑優化和CDN的分布網絡,實現快速、可靠的數據下發。

DNS和 CDN

1 用戶在瀏覽器中輸入一個域名。

2 本地DNS解析這個域名,可能會得到CDN網絡中某個邊緣節點的IP地址。

3 用戶的請求被發送到這個邊緣節點。

4 CDN根據用戶的地理位置、網絡條件和服務器負載情況,將請求定向到最佳的服務器。

5 用戶從最近的服務器獲取內容,享受快速的訪問體驗。

四、數據中心

數據中心的入口和出口也是路由器,由于在數據中心的邊界,就像在一個國家的邊境,稱為邊界路由器(Border Router)。為了高可用,邊界路由器會有多個。

一般家里只會連接一個運營商的網絡,而為了高可用, 為了當一個運營商出問題的時候,還可以通過另外一個運營商來提供服務,所以數據中心的邊界路由器會連接多個運營商網絡。

好的,讓我們一步一步來解釋這段話中的概念,以便你更容易理解。

什么是AS(自治系統)?

AS(Autonomous System,自治系統) 是指在一個網絡內,由一個或多個網絡運營商控制和管理的一個獨立的網絡。每個AS都有一個唯一的AS號碼(ASN),用于標識它們。

- 例子:想象有一個大公司,這個公司在全國有多個分部,每個分部都有自己的小網絡。這些分部網絡在內部是自己管理的,但對外它們被視為一個整體。這個整體就是一個AS。

什么是BGP協議?

BGP(Border Gateway Protocol,邊界網關協議) 是一種用于在不同AS之間交換路由信息的協議。BGP幫助網絡找到最合適的路徑,把數據從一個AS傳送到另一個AS。

- 例子:如果你在紐約,而你要寄包裹到洛杉磯,BGP就像是快遞公司用來選擇最佳路線的系統,確保你的包裹能夠經過最有效率的路線到達目的地。

數據中心的AS和BGP

數據中心是一個大型的網絡設施,里面有大量的服務器和網絡設備。這個數據中心通常被視為一個獨立的AS,因為它內部有自己獨立的網絡管理和路由系統。

- 訪問外部網站:當數據中心內部的機器需要訪問外部網站(例如,訪問Google),它需要知道如何把數據發送出去。

- 對外提供服務:數據中心里面有些機器對外提供服務(例如,運行一個網站),這些服務需要讓外部的用戶能找到并訪問到數據中心的服務器。

為了實現內外互通,數據中心會使用BGP協議來與其他AS交換路由信息。這意味著:

- 數據中心內的路由信息:數據中心內部的路由器會使用內部協議來管理和分發路由信息。

- 通過BGP獲取路由信息:當數據中心需要與外部世界通信時,它使用BGP協議來獲取和交換路由信息。

多線BGP的概念

多線BGP 是指一個數據中心通過多個互聯網服務提供商(ISP)連接到外部網絡,每個ISP可能屬于不同的AS。這樣可以確保更高的可靠性和速度,因為如果一個ISP的線路出現問題,數據中心還可以通過其他ISP的線路進行通信。

- 例子:想象你家有多條不同的寬帶連接(例如,電信和聯通),這樣即使一條線路斷了,你還可以通過另一條線路上網。多線BGP就是這個概念在大型數據中心中的應用。

總結

- AS(自治系統) 是一個獨立的網絡系統,擁有自己的管理和路由規則。

- BGP(邊界網關協議) 是一種用來在不同AS之間交換路由信息的協議。

- 數據中心作為AS:數據中心內部作為一個AS管理自己的網絡,但通過BGP協議與外部世界通信。

- 多線BGP:數據中心通過多個ISP連接到外部網絡,以提高可靠性和網絡性能。

希望這些解釋能幫你更好地理解AS、BGP協議以及它們在數據中心中的應用。

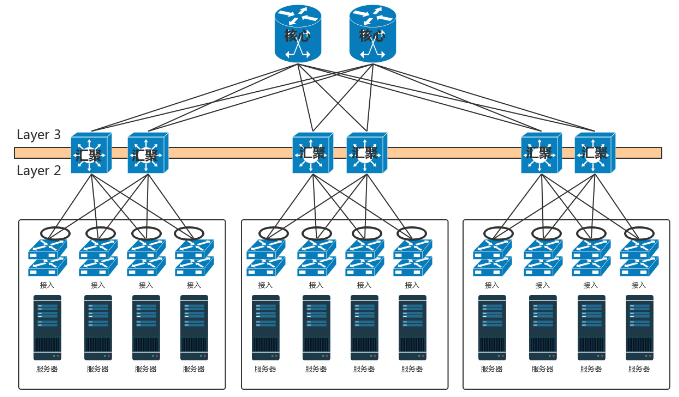

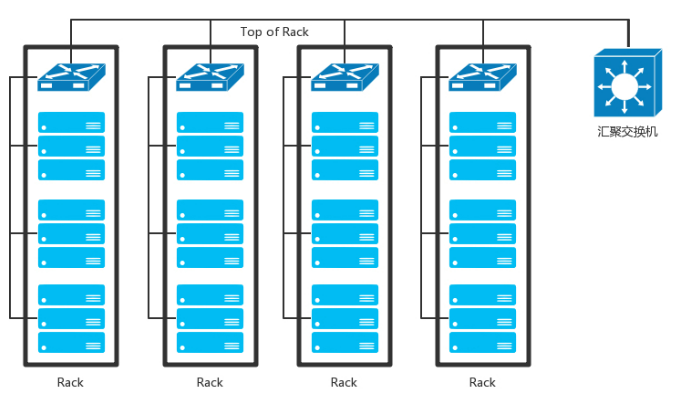

如果數據中心非常簡單,沒幾臺機器,那就像家里或者宿舍一樣,所有的服務器都直接連到路由器上就可以了。但是數據中心里面往往有非常多的機器,當塞滿一機架的時候,需要有交換機將這些服務器連接起來,可以互相通信。

這些交換機往往是放在機架頂端的,所以經常稱為TOR(Top Of Rack)交換機。這一層的交換機常常稱為接入層(Access Layer)。注意這個接入層和原來講過的應用的接入層不是一個概念。

當一個機架放不下的時候,就需要多個機架,還需要有交換機將多個機架連接在一起。這些交換機對性能的要求更高,帶寬也更大。這些交換機稱為匯聚層交換機(Aggregation Layer)。

數據中心里面的每一個連接都是需要考慮高可用的。這里首先要考慮的是,如果一臺機器只有一個網卡,上面連著一個網線,接入到 TOR 交換機上。如果網卡壞了,或者不小心網線掉了,機器就上不去了。所以,需要至少兩個網卡、兩個網線插到 TOR 交換機上,但是兩個網卡要工作得像一張網卡一樣,這就是常說的網卡綁定(bond)。

這就需要服務器和交換機都支持一種協議LACP(Link Aggregation Control Protocol)。它們互相通信,將多個網卡聚合稱為一個網卡,多個網線聚合成一個網線,在網線之間可以進行負載均衡,也可以為了高可用作準備。

LACP

當你通過LACP聚合多個網卡或網線時,單個數據流(例如,一個客戶端傳輸一個大文件)通常只能使用其中一條物理鏈路的帶寬,而不能同時使用所有聚合鏈路的總帶寬。這是因為LACP的負載均衡算法是基于數據流的分配,而不是單個數據流的帶寬疊加。

更詳細的解釋

什么是單個數據流?

單個數據流是指一對一的通信連接,例如一個客戶端與服務器之間的文件傳輸。這個流可能由TCP連接組成,并且有特定的源IP、目的IP、源端口和目的端口。

LACP的負載均衡

LACP的負載均衡算法通常基于某些特征來分配數據流,例如:

- 源IP地址

- 目的IP地址

- 源MAC地址

- 目的MAC地址

- 源端口號

- 目的端口號

這些特征會被用來決定某個數據流通過哪條物理鏈路傳輸。一旦一個數據流被分配到某條鏈路,它就會一直使用這條鏈路直到連接結束。這種機制有助于保持數據包的順序和連接的穩定性。

實際帶寬利用

-

單個數據流的局限:

- 如果只有一個客戶端在傳輸大文件(一個數據流),該流會被分配到其中一條物理鏈路。例如,如果有四條1Gbps的鏈路,這個數據流可能只會使用其中的一條1Gbps鏈路。

-

總帶寬的利用:

- 因此,即使你有4Gbps的總帶寬(四條1Gbps鏈路),單個數據流只能使用1Gbps。這個數據流無法利用所有四條鏈路的帶寬。

-

多數據流的優勢:

- 如果有多個數據流(例如多個客戶端同時進行文件傳輸),這些數據流會被分配到不同的物理鏈路上,總帶寬利用率會更高,接近4Gbps。

示例

假設你有四條1Gbps的鏈路通過LACP聚合在一起:

-

單個數據流:

- 客戶端A在下載一個大文件,這個數據流被分配到鏈路1。因此,這個下載過程只能使用1Gbps的帶寬,即使總帶寬是4Gbps。

-

多個數據流:

- 客戶端A、B、C、D分別在下載不同的大文件。客戶端A的流被分配到鏈路1,客戶端B的流被分配到鏈路2,依此類推。這時,總帶寬利用率可以接近4Gbps,因為多個數據流被均勻分配到不同的物理鏈路上。

總結

單個數據流受限于LACP的負載均衡機制,通常只能使用一條物理鏈路的帶寬。因此,在有多個并發數據流時,LACP能夠更好地發揮聚合帶寬的優勢,提高整體網絡性能和帶寬利用率。

交換機

在核心交換上面,往往會掛一些安全設備,例如入侵檢測、DDoS 防護等等

為什么二層不能有環路

交換機A --鏈路1--> 交換機B --鏈路2--> 交換機C --鏈路3--> 交換機A

在正常情況下,交換機會學習到幀的源MAC地址,并將這些地址與對應的端口關聯起來,構建一個MAC地址表。當交換機收到一個幀時,它會查看MAC地址表,決定將幀轉發到哪個端口。

但是,如果交換機之間的連接形成了環路,就會出現以下問題:

-

廣播風暴:當一個廣播幀(目的MAC地址為FF:FF:FF:FF:FF:FF)進入網絡時,它會在交換機之間無限循環,因為每個交換機都會將廣播幀轉發到所有端口(除了接收該幀的端口)。

-

MAC地址表不穩定:由于廣播幀在環路中無限循環,交換機的MAC地址表會不斷更新,導致轉發路徑不穩定。

為啥目標mac在環路中,依舊會產出環路

這里可能存在一點理解上的混淆。在討論二層交換網絡中的環路問題時,重要的是理解交換機的工作原理和廣播/組播幀的處理方式。

澄清概念:

- 當我們說“廣播幀”或“組播幀”,指的是目的MAC地址是廣播地址(所有F’s,即FF:FF:FF:FF:FF:FF)或一組設備共享的組播地址,而不是指向單個特定設備的唯一MAC地址。

- 在二層交換網絡中,交換機根據MAC地址表進行幀轉發。對于廣播或組播幀,它們的目的并不是到達某個特定的目標MAC地址,而是要讓網絡中的所有(廣播)或一部分(組播)設備接收到這些幀。

為什么環路會導致問題:

-

廣播和組播幀的泛洪:當交換機接收到一個廣播或組播幀時,它會執行泛洪操作,即將該幀從除了接收該幀的端口之外的所有其他端口轉發出去。這是因為廣播和組播的目的在于讓網絡中的多個或所有設備都能接收到信息,而交換機并不知道哪些具體端口連接了應該接收這些幀的設備。

-

環路中的無限循環:如果網絡中存在環路,且廣播或組播幀進入這個環路,這些幀就會在環路中不斷被交換機轉發,每次經過都會被重新廣播出去。因為二層交換機不記錄廣播或組播幀的轉發歷史,無法識別這些幀是否已經經過環路中的某個節點,所以不會停止轉發,從而形成無限循環。

舉例說明:

假設有四臺交換機A、B、C、D,它們通過相互連接形成了一個環路,且沒有啟用任何防環機制。如果在交換機A上發生了一個廣播幀(例如ARP請求),這個廣播幀會按照以下步驟傳播:

- A發送廣播幀到B、C。

- B接收到廣播幀后,再次將其轉發給C和D(盡管C已經收到過,但B不知道)。

- C接收到從B來的廣播幀,又將其轉發給A和D(盡管A是源頭,C也不知道)。

- 這個過程會不斷重復,廣播幀在環路A-B-C-D-A中無限循環,直到網絡帶寬被完全消耗。

因此,即使廣播或組播幀沒有特定的目標MAC地址,它們在環路中的無限制轉發也會迅速耗盡網絡資源,導致網絡性能嚴重下降。

為什么三層可以有環路

在三層網絡中,設備使用IP地址進行通信,而IP路由是基于目的地址的,數據包通過路由器進行轉發,路由器會根據路由表選擇最佳路徑進行轉發。因此,即使存在環路,路由器會通過路由協議選擇最佳路徑,避免數據包在網絡中無限循環。

堆疊后,網卡ip怎么設置

當服務器通過多根網線連接到堆疊交換機上時,網絡配置有幾種常見的方式來確保服務器的IP配置和網絡連接正常工作。主要的方法包括使用鏈路聚合(Link Aggregation)、綁定多個網卡(NIC Bonding)或網絡團隊(Network Teaming)。這些方法可以使多條物理連接看起來像一條邏輯連接,從而簡化IP配置并提供冗余和負載均衡。

1. 鏈路聚合(Link Aggregation)和NIC Bonding

鏈路聚合(Link Aggregation)是將多條物理網線綁定在一起形成一條邏輯網線的技術。在Linux系統中,通常稱為NIC Bonding;在Windows系統中,稱為NIC Teaming。

配置步驟:

-

創建綁定接口:

- 將多個物理網卡(例如 eth0、eth1、eth2)綁定成一個邏輯接口(例如 bond0)。

-

配置綁定接口的IP地址:

- 給邏輯接口(bond0)配置一個IP地址。

示例配置(Linux):

在Linux系統中,使用以下步驟進行配置:

-

創建綁定配置文件:

-

創建或編輯

/etc/sysconfig/network-scripts/ifcfg-bond0文件,內容如下:DEVICE=bond0 NAME=bond0 TYPE=Bond BONDING_MASTER=yes BOOTPROTO=static IPADDR=192.168.1.100 NETMASK=255.255.255.0 ONBOOT=yes BONDING_OPTS="mode=802.3ad miimon=100"

-

-

配置物理網卡:

-

創建或編輯

/etc/sysconfig/network-scripts/ifcfg-eth0文件,內容如下:DEVICE=eth0 NAME=eth0 TYPE=Ethernet ONBOOT=yes MASTER=bond0 SLAVE=yes -

重復上述步驟配置

ifcfg-eth1、ifcfg-eth2等文件。

-

-

重啟網絡服務:

- 執行命令

sudo systemctl restart network或sudo service network restart使配置生效。

- 執行命令

如果大二層橫向流量不大,核心交換機數目不多,可以做堆疊,但是如果橫向流量很大,僅僅堆疊滿足不了,就需要部署多組核心交換機,而且要和匯聚層進行全互連。由于堆疊只解決一個核心交換機組內的無環問題,而組之間全互連,還需要其他機制進行解決。

如果是 STP,那部署多組核心無法擴大橫向流量的能力,因為還是只有一組起作用。

于是大二層就引入了TRILL(Transparent Interconnection of Lots of Link),即多鏈接透明互聯協議。它的基本思想是,二層環有問題,三層環沒有問題,那就把三層的路由能力模擬在二層實現。

運行 TRILL 協議的交換機稱為RBridge,是具有路由轉發特性的網橋設備,只不過這個路由是根據 MAC 地址來的,不是根據 IP 來的。

葉脊網絡

在網絡架構中,“東西流量”和“南北流量”是描述數據傳輸方向的術語,它們與網絡中的流量模式有關。

-

南北流量(North-South Traffic):指的是進入或離開數據中心的數據流量。例如,用戶通過互聯網訪問數據中心中的網站,這種從外部網絡到數據中心,或從數據中心到外部網絡的流量就是南北流量。

-

東西流量(East-West Traffic):指的是在數據中心內部不同服務器或虛擬機之間傳輸的數據流量。例如,數據中心內的兩個應用程序之間交換數據,或者一個應用程序需要訪問存儲在數據中心另一部分的數據。

隨著云計算和大數據的發展,數據中心內部的交互變得非常頻繁,東西流量的增長速度可能超過了南北流量。這是因為云服務和大數據分析通常涉及到大量的數據在數據中心內部的多個服務器之間傳輸和處理。

**葉脊網絡結構(Leaf-Spine Architecture)**是為了應對這種流量模式變化而發展起來的一種網絡設計。它具有以下特點:

-

葉節點(Leaf Nodes):負責連接終端用戶或外部網絡,處理南北流量。

-

脊節點(Spine Nodes):位于網絡的中心,所有葉節點都連接到脊節點,脊節點之間也相互連接,形成一個全連接的網絡。

-

全連接性:葉節點和脊節點之間的全連接設計允許任何葉節點與其他葉節點直接通信,從而優化東西流量的傳輸。

舉例來說,想象一個大型的數據中心,它像一個多層的購物中心:

-

南北流量就像是顧客從購物中心的入口進入,然后到各個店鋪(服務器)去購物。顧客進入和離開購物中心的流量就是南北流量。

-

東西流量則像是在購物中心內部,各個店鋪之間需要交換貨物或信息。比如,一家服裝店可能需要從另一家店鋪調貨。

在傳統的網絡結構中,東西流量可能需要通過一個中心節點來轉發,這就像購物中心內的所有店鋪都只能通過一個中央服務臺來交換貨物,效率較低。

而葉脊網絡結構則像是在購物中心的每一層都建立了多個通道,店鋪之間可以直接交換貨物,不需要經過中央服務臺,大大提高了效率。這樣的設計使得數據中心能夠更好地處理日益增長的東西流量,滿足云計算和大數據時代的需求。

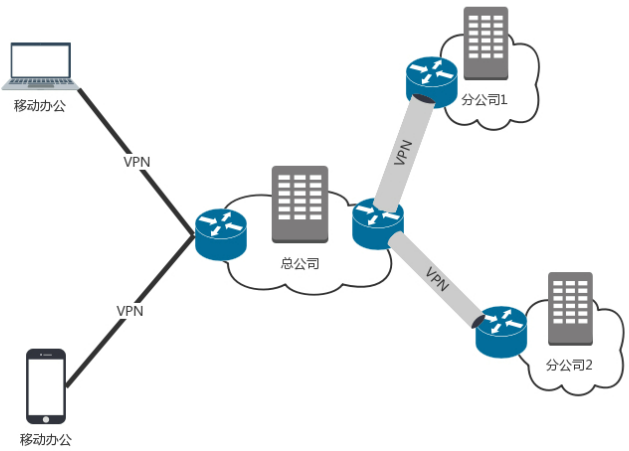

五、VPN

需要將多個數據中心連接起來,或者需要辦公室和數據中心連接起來。這該怎么辦呢?

第一種方式是走公網,但是公網太不安全,你的隱私可能會被別人偷窺。

第二種方式是租用專線的方式把它們連起來,這是土豪的做法,需要花很多錢。

第三種方式是用 VPN 來連接,這種方法比較折中,安全又不貴。

VPN,全名Virtual Private Network,虛擬專用網,就是利用開放的公眾網絡,建立專用數據傳輸通道,將遠程的分支機構、移動辦公人員等連接起來。

VPN 是如何工作的?

暫時沒什么興趣研究

VPN(Virtual Private Network,虛擬私人網絡)是一種網絡技術,它允許用戶通過一個不安全的網絡(如互聯網)建立一個加密的、安全的連接到另一個網絡。VPN常用于遠程工作,確保數據傳輸的安全性。下面是VPN工作原理的通俗解釋和例子:

-

用戶連接到互聯網:假設你在家中,想要安全地訪問公司的網絡資源。

-

啟動VPN客戶端:在你的電腦上,你打開一個VPN客戶端軟件。這個軟件就像是一把鑰匙,用來開啟VPN連接。

-

認證過程:當你啟動VPN客戶端時,它可能會要求你輸入用戶名和密碼,或者使用證書等其他認證方式來驗證你的身份。

-

建立加密隧道:一旦你的身份得到驗證,VPN客戶端和VPN服務器之間就會建立一個加密的隧道。這個隧道使用加密算法(如AES)來保護數據,確保只有授權的用戶和設備能夠讀取數據。

-

數據傳輸:現在,當你發送數據時(比如訪問公司網站或發送電子郵件),數據會首先被VPN客戶端加密,然后通過互聯網發送到VPN服務器。

-

數據到達VPN服務器:VPN服務器接收到加密的數據后,會解密這些數據,并將其轉發到目標網絡(比如你的公司網絡)。

-

訪問資源:在公司網絡中,你的請求就像在公司內部發起的一樣,你可以訪問公司內部的資源,如文件服務器、內部網站等。

-

返回數據:當你請求的數據返回時,它會經過相同的過程:在公司網絡中被加密,通過VPN服務器解密,然后發送回你的VPN客戶端。

-

斷開連接:當你完成工作并斷開VPN連接時,加密隧道會被關閉,你的網絡活動將不再通過VPN進行。

舉例說明:

想象你在一個咖啡館工作,你需要訪問公司的敏感文件。如果沒有VPN,你的網絡連接可能會被監聽,數據可能會被竊取。但是,通過VPN,你可以安全地連接到公司的網絡,就像你坐在辦公室里一樣。當你通過VPN發送請求時,數據被加密,即使有人試圖攔截你的連接,他們也無法讀取數據,因為只有你和VPN服務器擁有解密密鑰。這樣,你的工作數據就得到了保護。

VPN 和 VPS

VPS(Virtual Private Server,虛擬專用服務器)是一種虛擬化技術,它允許單個物理服務器運行多個獨立的操作系統實例。每個VPS都擁有自己的操作系統、CPU、內存、存儲等資源,就像一臺獨立的服務器一樣。用戶可以通過遠程連接管理自己的VPS,就像管理一臺物理服務器。

VPN(Virtual Private Network,虛擬私人網絡)是一種網絡服務,它通過加密技術在互聯網上創建一個安全的、專用的連接。VPN通常用于遠程訪問公司網絡或保護用戶在公共網絡上的隱私。

VPS和VPN之間的關系可以從以下幾個方面來理解:

-

獨立性:VPS是獨立的服務器實例,而VPN是連接到另一個網絡的加密通道。

-

用途:VPS通常用于托管網站、應用程序或作為開發和測試環境。VPN則用于安全地訪問遠程網絡或保護網絡流量。

-

安全性:VPS提供了隔離的環境,每個VPS之間是相互獨立的,而VPN提供了數據傳輸過程中的加密保護。

-

部署:VPS是在服務器提供商的數據中心內部署的,而VPN可以由個人或企業在任何地方部署。

-

關聯使用:VPS和VPN可以一起使用,為用戶提供更安全、更靈活的服務。例如,一個企業可能會在VPS上托管其網站,并通過VPN連接到內部網絡以進行遠程管理。

通俗解釋:

想象一下,VPS就像一個虛擬的公寓,每個公寓都有自己的門、窗戶和內部設施,但它們都是在一個大樓里。你可以在自己的公寓里做很多事情,比如開公司或做個人項目。

VPN則像是一條秘密通道,連接你的公寓和另一個地方(比如你的辦公室)。通過這條通道,你可以安全地訪問辦公室的資源,就像你真的在那里一樣。

所以,VPS和VPN是兩個不同的概念,但它們可以一起工作,為你提供更安全、更靈活的網絡服務。

查詢)

)