AI. AI. AI. 最近耳朵里是不是總是被這些詞轟炸?特別是“Agent”、“AI Agent”、“智能體”、“Agentic”…… 感覺一夜之間,AI 就從我們熟悉的聊天框里蹦出來,要擁有“獨立思考”和“自主行動”的能力了?

說實話,一開始我也被這些詞搞得有點暈。很多解釋要么太技術化,各種框架、算法撲面而來;要么又太基礎,講了半天還是感覺沒抓住重點。

如果你跟我一樣,不是程序員,沒有深厚的技術背景,但平時一直在用 ChatGPT、文心一言、通義千問這些 AI 工具,也想搞明白 AI Agent 到底是什么,以及它將來可能會如何影響我們的生活和工作,那恭喜你,這篇文章就是為你寫的!

今天,我就用最簡單、最貼近生活的例子,帶你一起走完一個“1-2-3”的學習路徑:從你熟悉的 LLM(大型語言模型),到 AI 工作流(AI Workflow),再到最終的 AI Agent(AI 智能體)。相信我,那些聽起來嚇人的“RAG”、“ReAct”,拆開了看一點都不復雜!

咱們,這就開始!

第一層:你熟悉的“超級大腦”——大型語言模型(LLM)

咱們先從最熟悉的第一層說起。你平時用的那些強大的 AI 聊天機器人,比如 ChatGPT、Google Gemini、Claude、國內的文心一言、通義千問等等,它們的核心其實都是構建在大型語言模型(LLM)這個基礎上的應用。

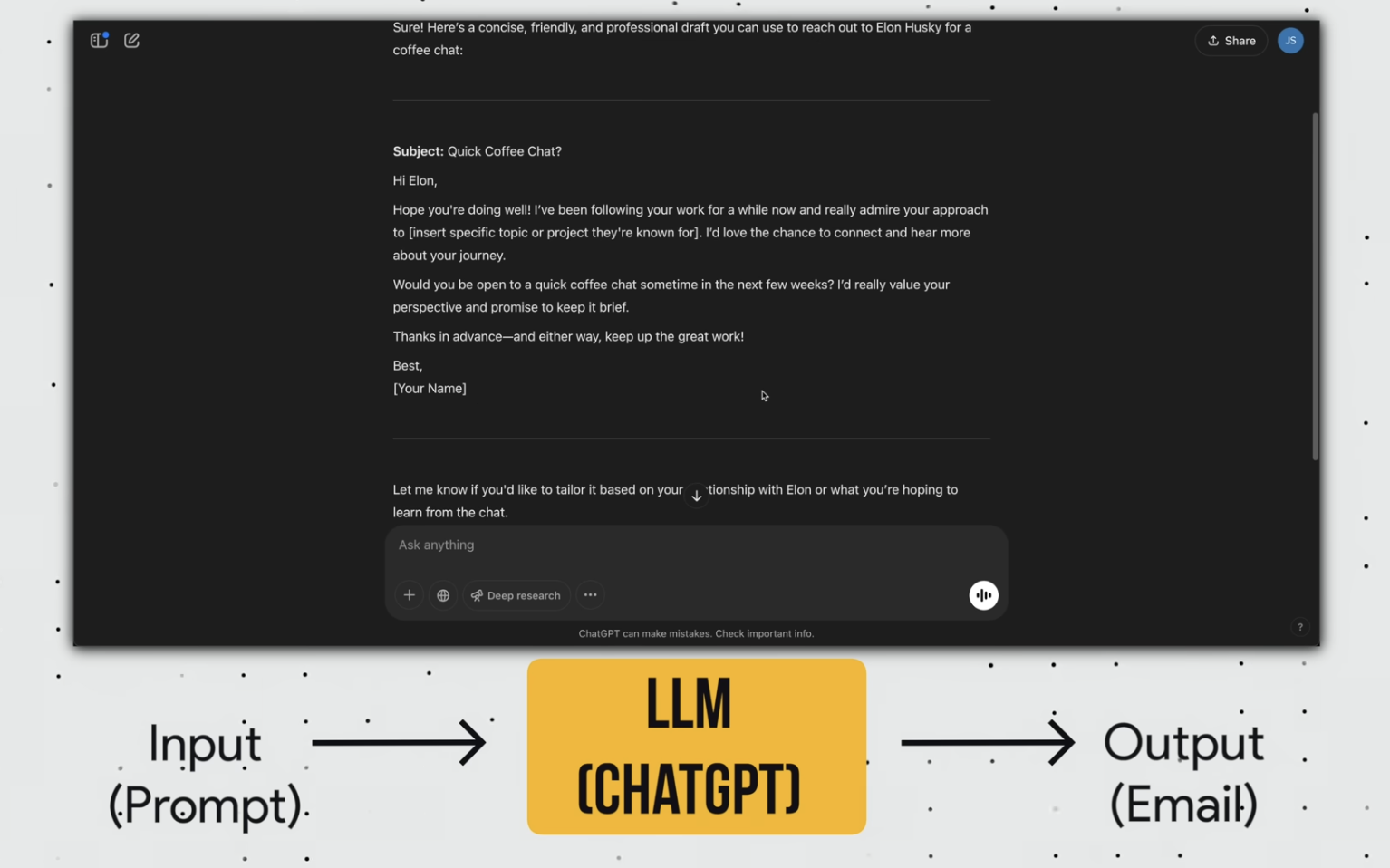

你可以想象一下,LLM 就像一個擁有海量知識的“超級大腦”。我們人類(你)給它一個輸入(也就是 Prompt,你的問題或指令),它就根據它在訓練中學到的海量數據,給出一個輸出(它的回答或生成的內容)。

舉個最簡單的例子:我讓 ChatGPT 幫我寫一封約咖啡的郵件。我的 Prompt 就是輸入,它瞬間生成的那封比我本人寫得流暢、客氣一百倍的郵件,就是輸出。到這里是不是感覺很簡單?沒啥難的!

但是,問題來了。如果我問 ChatGPT:“我下周三跟 Elon Husky 約咖啡是幾點?”

你懂的,就算你沒試過,你也知道它肯定會懵圈,然后回復你一句“我不知道你的個人日程信息”。為什么?因為它沒法訪問我的個人日歷!

這就暴露了大型語言模型的兩個關鍵“軟肋”:

-

知識不全:?它們雖然學了很多互聯網上的公共數據,但對我們個人的私密信息、公司內部的數據,或者某些實時變化的信息(比如我的最新日歷、最新的天氣),是一無所知的。

-

太“被動”:?它們就像一個被動等指令的機器人。你問一句,它答一句。你給它個 Prompt,它給個 Output。它不會主動去外部世界獲取信息,也不會自己決定去做點什么。

記住 LLM 的這兩個特點,我們繼續往下走,看看怎么解決這些問題。

第二層:聽話的“流水線工人”——AI 工作流(AI Workflow)

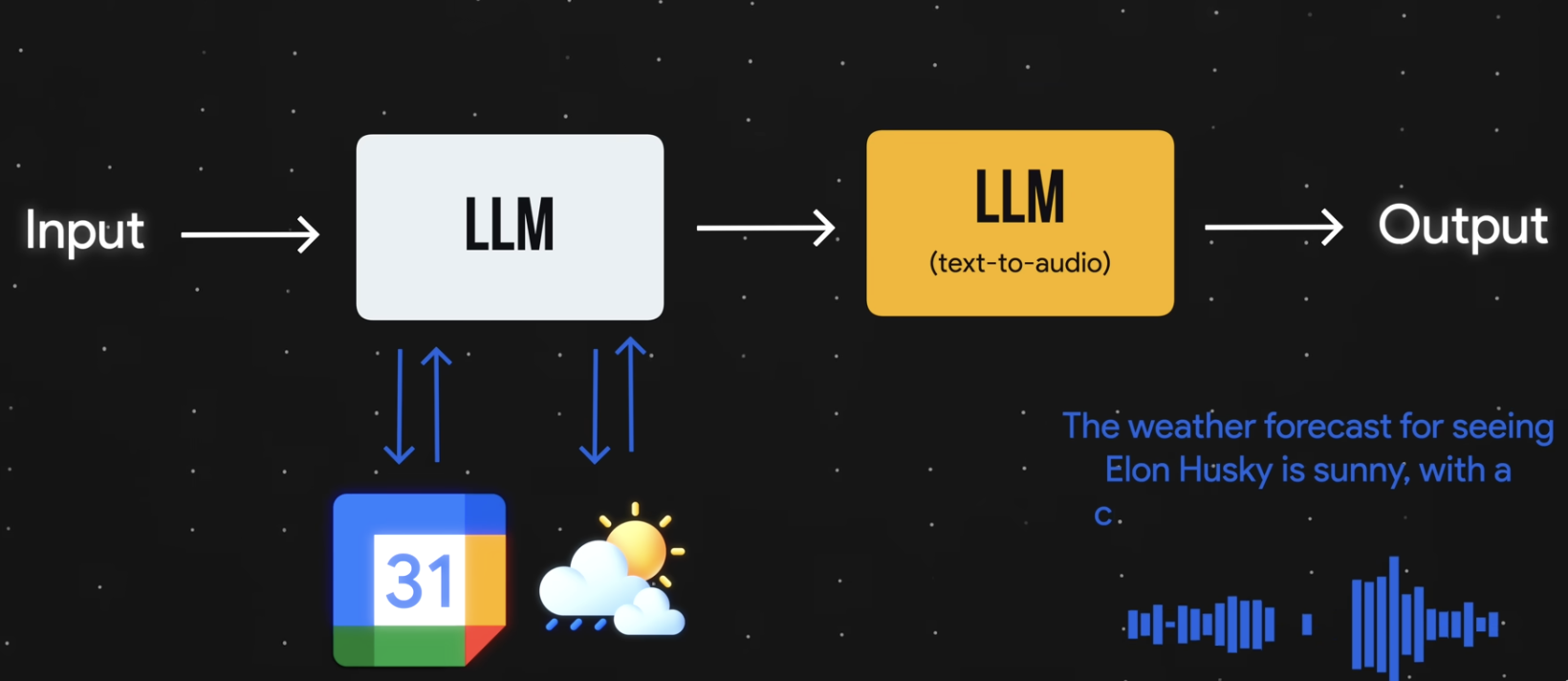

既然 LLM 自己不知道我的日歷,那我們能不能給它“賦能”呢?這就是 AI 工作流要做的事情。

我們可以在 LLM 的外面,搭建一個“工作流程”。比如,我這個人類,可以預設一個邏輯:“以后只要我問關于個人日程的問題,我的指令先不要直接給 LLM,而是先觸發一個‘查日歷’的動作。查到日歷數據后,把數據連同我的問題一起,打包喂給 LLM,讓它根據這些信息回答。”

如果按照這個邏輯實現了,下次我再問“我下周三跟 Elon Husky 的咖啡約會是幾點?”,我的這個問題就會先觸發“查日歷”這個步驟。系統查到日歷信息(比如是下午 3 點),然后把“我下周三跟 Elon Husky 約會是下午 3 點”這個信息,連同我的問題,一起發給 LLM。LLM 收到信息后,就能準確地回答我了!

看起來很智能對不對?但新問題又來了。如果我緊接著問:“那天下雨嗎?”

這時候,我的這個“查日歷”工作流就又會“卡殼”了。為什么?因為它只能嚴格遵循我預設好的那個“路徑”:永遠是“查日歷”。我的日歷里可沒有天氣信息!

這就是 AI 工作流的一個根本特點:它只能嚴格、機械地遵循人類預設好的、固定不變的“路徑”或“步驟”去執行任務。?它就像一條“流水線”,每一步做什么都是我們人類提前設計好的。用技術話說,這個固定的路徑,就是它的“控制邏輯”,是人來編寫和控制的。

就算我把這個流程搞得更復雜:比如先查日歷,再通過天氣 API 查天氣,甚至再加一個文語轉換模型把最終答案讀出來。聽起來功能很強大了,對不對?但本質上,它依然只是一個 AI 工作流。?為什么?因為它每一步做什么,調用哪個工具,都是我這個人類提前設定好的。只要是由人類在做決策,決定一步一步怎么走,它就還不是 AI Agent。

順便提一個你可能聽過的高級詞:“RAG”(Retrieval Augmented Generation,檢索增強生成)。這個詞在 AI 圈子里被說得很多,聽起來很高大上。其實你簡單理解,它就是一種特殊的 AI 工作流!它的核心功能就是:在 AI 模型生成回答之前,先去外部世界(比如你的文檔庫、數據庫、互聯網)“檢索”相關的“增強”信息,然后把信息喂給模型,讓它基于這些信息生成更準確、更及時的回答。?所以,“檢索”+“生成”,就是 RAG 的本質,它是一種讓 LLM 突破自身知識限制的有效工作流。你看,是不是沒那么復雜了?

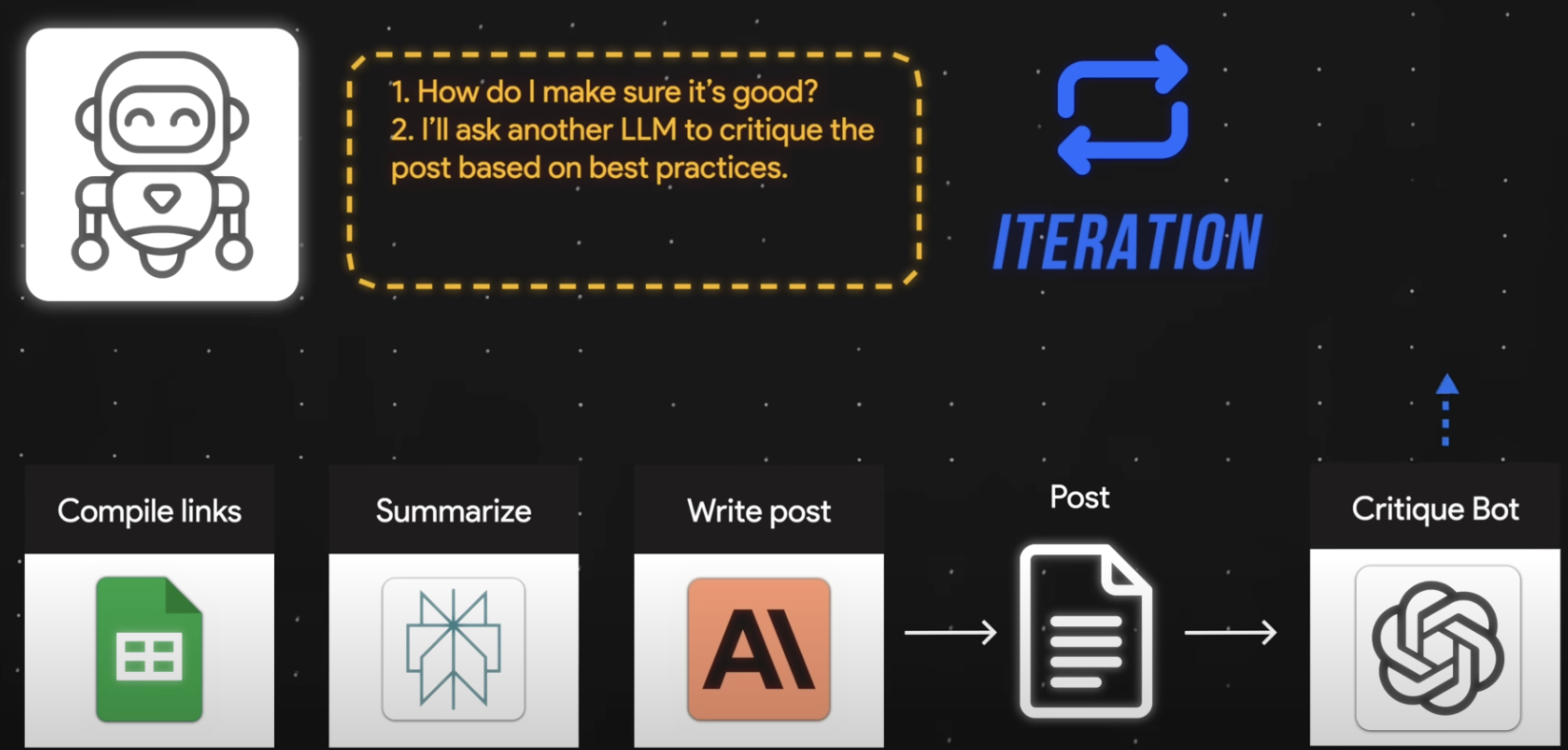

我之前用 Make.com 搭建過一個很典型的 AI 工作流,你聽聽是不是這個邏輯:

-

我把收集到的新聞文章鏈接放到一個 Google Sheets 表格里。

-

我的這個自動化工作流啟動后,先去讀取 Google Sheets 里的鏈接。

-

然后把鏈接發給 Perplexity,讓 Perplexity 幫我總結文章內容。

-

接著把 Perplexity 總結好的內容,發給 Claude(一個 LLM),并配合我預設好的一個 Prompt,讓 Claude 幫我寫成適合發 LinkedIn 和 Instagram 的社交媒體推文。

-

最后設置成每天早上 8 點自動運行一次。

你看,這就是一個標準的工作流:每一步都由我這個人類事先設定好了——先表格、再 Perplexity、然后 Claude、最后定時。人是這個流程的決策者和設計者,它只是按部就班地執行。

再加一個點:如果我對 Claude 生成的 LinkedIn 推文不滿意(比如我覺得它寫得不夠吸引人),我得手動去修改那個給 Claude 的 Prompt,然后重新運行一下這個工作流。這個“試錯-調整-再運行”的過程,現在還是由我這個人類在完成。記住這一點,因為待會兒講 Agent 的時候,它就不同了!

第三層:能“思考”和“行動”的自主個體——AI Agent

好,終于來到第三層,也是最近最讓人興奮的概念:AI Agent(AI 智能體)!

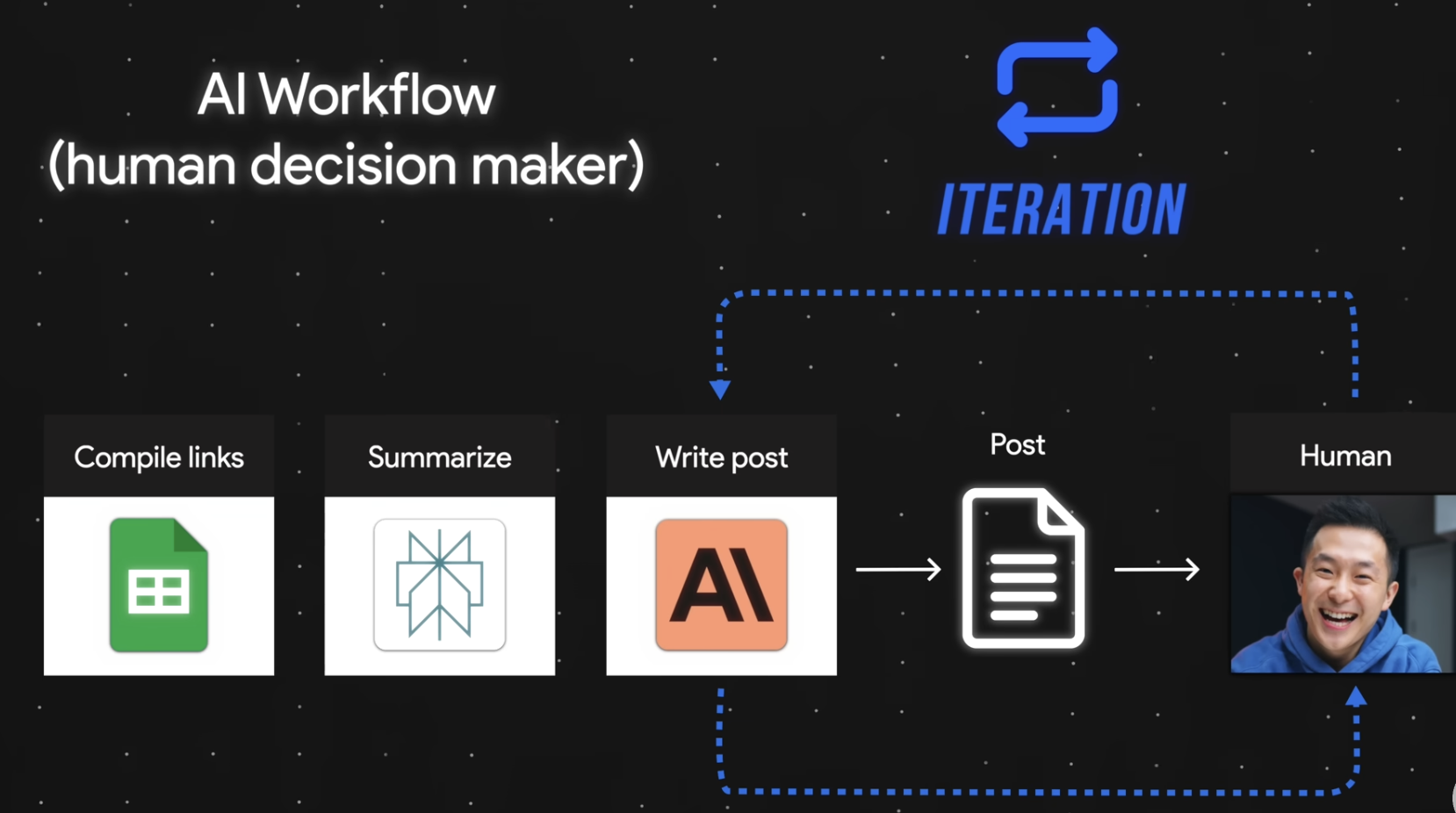

核心區別是什么?還記得剛才的 AI 工作流嗎?是人類決定每一步怎么走。而 AI Agent 最關鍵的變化在于:把那個做決策的人類,換成了一個 LLM!

簡單來說,一個真正的 AI Agent,不再是一個只等你下指令、按固定流程跑的機器人。它更像是一個擁有某個“目標”后,能夠自己去思考、自己去行動,想方設法達成目標的“智能體”。

它的核心能力體現在兩個方面(這也是為什么很多 Agent 框架被稱為?ReAct?的原因,ReAct =?Reason +?Act):

-

它必須能“思考”(Reason):?當你給 Agent 一個目標(比如“幫我寫一篇基于最新新聞的社交媒體推文”)時,它不會傻等指示。它會自己動腦子,像人一樣“思考”:怎么做最有效率??我需要新聞內容,是自己去網上找然后復制粘貼嗎?好像太慢了。哦,我可以只收集新聞鏈接,然后調用一個工具自動抓取內容并總結!這個方案聽起來不錯!它會自己選擇最佳的路徑和方法。

-

它必須能“行動”(Act):?光想沒用,Agent 必須能把想法付諸實踐。它會自己去調用各種外部工具來完成任務。比如,它決定要收集鏈接并抓取內容,它會自己選擇并調用合適的工具(比如一個搜索引擎 API、一個網頁抓取工具、或者像 Make.com 那樣能連接各種服務的平臺)來執行這些操作。再比如,要寫推文,它會自己決定調用哪個 LLM,使用什么樣的 Prompt,并把之前獲取到的新聞總結作為輸入。

所以,當一個 AI 接收到一個任務/目標后,如果它能夠:

-

自己“思考”?達成目標的步驟和方法(Reason)

-

自己“行動”?去調用工具執行這些步驟(Act)

-

自己“觀察”?行動的結果是否符合預期

-

自己“決定”?是否需要調整計劃或重復步驟(Iterate)

-

直到最終達成目標

那它就是一個 AI Agent!關鍵是:決策者從人類變成了 LLM 自己。

還記得剛才我在 AI 工作流里手動修改 Prompt 嗎?在 Agent 的世界里,它還能做得更多:

一個高級的 AI Agent,甚至擁有自主迭代(Iterate)和優化的能力。比如,它寫完第一版的 LinkedIn 推文后,可能會自己調用另一個 LLM 來“評價”這篇推文質量如何,是否符合要求。如果評價反饋說“不行,不夠吸引人”,Agent 會根據這個反饋,自己調整推文的內容或寫作策略,然后再讓評價 LLM 檢查,直到寫出它認為最佳的版本。整個“生成-評價-修改”的循環,Agent 自己就能完成,不需要我這個人類一直盯著、手動修改。

再舉個更具象的例子。AI 領域的牛人吳恩達(Andrew Ng)之前演示過一個 AI 視覺 Agent。你給它一個目標:“在視頻素材里找到所有出現‘滑雪的人’的片段”。

這個 Agent 在后臺做了什么呢?它首先會“思考”:一個“滑雪的人”大概長什么樣?(嗯,應該是一個人在雪地里,穿著滑雪板,可能速度很快?)然后它開始“行動”:它會自己去瀏覽視頻里的每一幀畫面,調用圖像識別或動作捕捉等工具,嘗試識別出符合它“思考”出來的特征的畫面。一旦找到了它認為是“滑雪的人”的畫面,它就會給對應的視頻片段打上標簽,并把這些片段提取出來呈現給你。

這個過程最厲害的地方在于:識別“滑雪的人”、判斷畫面、打標簽、提取片段,整個復雜的任務,是這個 Agent 自己根據目標,自主地進行“思考”和“行動”來完成的,而不是預先由人類把視頻都看一遍,手動給每一段打好各種標簽(比如‘滑雪者’、‘雪山’、‘雪地’等等),Agent 只是按照人類打好的標簽去檢索。?這種根據目標自主規劃和執行的能力,就是 Agent 和傳統工作流的根本區別。

總結一下:從 LLM 到 Agent 的進階之路

好了,咱們一起回顧一下今天走過的“1-2-3”路徑:

-

第一層 LLM:?你給輸入,它給輸出,很被動,知識有限。

-

第二層 AI 工作流:?你給輸入,并給它設定好固定的步驟(人類是決策者),它按照你的步驟去調用外部工具(比如查日歷、查天氣、查數據庫)獲取信息,再給 LLM 處理,最終給輸出。流程固定,需要人類來調整和優化。

-

第三層 AI Agent:?你給一個目標,LLM 自己會“思考”(Reason),決定要采取哪些“行動”(Act),自己去調用工具,自己觀察結果,甚至能自主“迭代”優化,最終達成目標(LLM 是決策者)。?它是一個更智能、更自主的“個體”。

AI Agent 正在讓 AI 從一個被動的工具,變成一個能理解你的意圖、自主規劃并執行任務的“智能助理”。雖然目前可能很多 Agent 還不完美,但毫無疑問,它們代表著 AI 應用的一個重要發展方向,也預示著未來我們的工作和生活方式可能會因此發生改變。

希望這篇文章能幫你揭開 AI Agent 的神秘面紗,讓你不再覺得這些詞高不可攀。理解了這些基礎概念,你就能更好地把握 AI 發展的脈搏啦!

)

)

![網絡安全等級保護有關工作事項[2025]](http://pic.xiahunao.cn/網絡安全等級保護有關工作事項[2025])