(1) 輸出形式

-

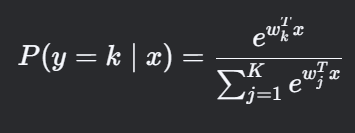

Softmax回歸

輸出是一個概率分布,通過Softmax函數將線性得分轉換為概率:

其中?KK?是類別數,模型同時計算所有類別的概率。

-

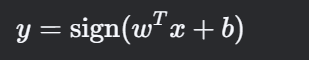

單層感知機

輸出是二分類的硬決策(如0/1或±1):

無概率解釋,直接給出分類結果。

(2) 損失函數

-

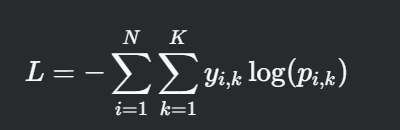

Softmax回歸

最小化交叉熵損失,鼓勵正確類別的概率接近1:

其中?yi,kyi,k??是樣本?ii?的真實類別標簽(one-hot編碼)。

-

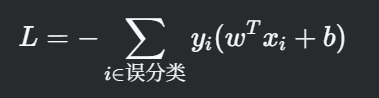

單層感知機

僅懲罰誤分類樣本,損失函數為:

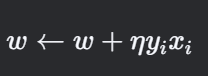

更新規則為

(僅對錯誤樣本更新)。

(僅對錯誤樣本更新)。

(3) 優化目標

-

Softmax回歸

直接建模多類別的概率分布,通過最大似然估計優化參數。 -

單層感知機

尋找一個分離超平面,僅保證線性可分性(對線性不可分數據不收斂)。

(4) 應用場景

-

Softmax回歸

多分類任務(如圖像分類、文本分類),需概率輸出時。 -

單層感知機

二分類任務(如垃圾郵件檢測),或作為神經網絡的基礎組件(但需配合非線性激活函數)。

)

![每日c/c++題 備戰藍橋杯(洛谷P1015 [NOIP 1999 普及組] 回文數)](http://pic.xiahunao.cn/每日c/c++題 備戰藍橋杯(洛谷P1015 [NOIP 1999 普及組] 回文數))

)