1. 卷積神經網絡實際上就是避免過擬合,就是“特征”神經網絡。這個特征和卷積核相關。卷積和相關類似,有點是本質屬性和輸出屬性的感覺。

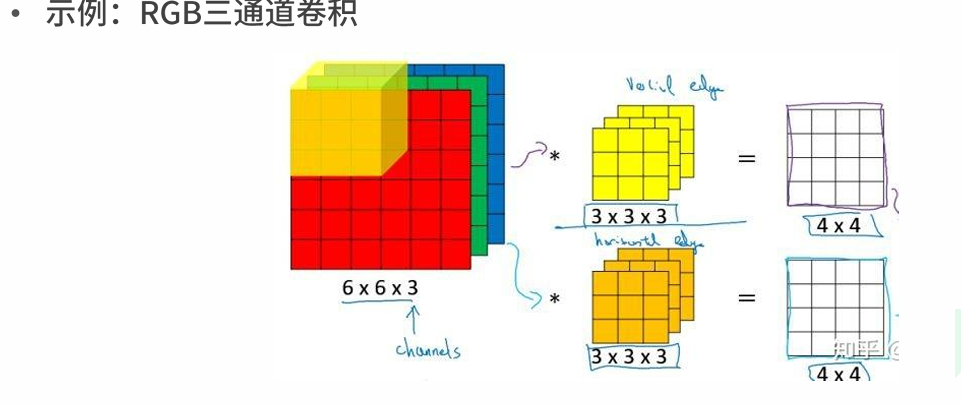

著重注意三通道卷積

padding 上下左右、前后都要加邊

padding 上下左右、前后都要加邊

池化就是解決特征過多問題,縮小1倍較多。均值池化,最大池化。

卷積是線性的,疊加激活函數解決非線性神經網絡問題。

池化層和卷積層反向傳播問題,對于池化層,使用最大池化可以使大多數神經元置零,減少反向傳播神經元參數。

欠擬合的原因主要是網絡深度不夠,一般采用擴大網絡規模和深度,或改進方法。

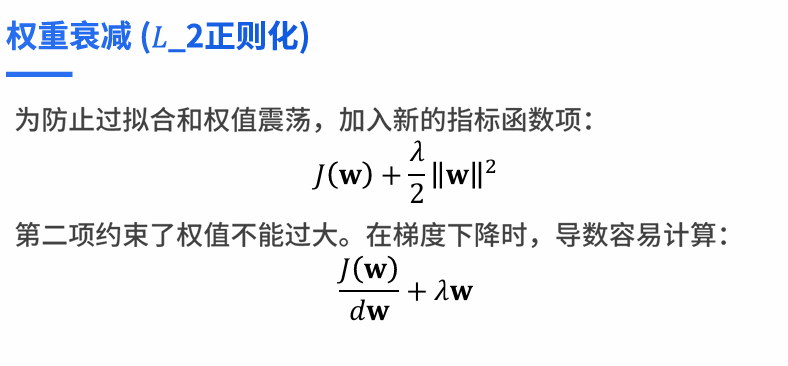

過擬合就是訓練誤差低,測試誤差高,結果泛化及處理未知數據能力不強。調整訓練算法。權重衰減及LR正則化方法。

DropOut,工廠干活時10個人一定出現分化,反映到神經網絡,某些神經元會不停調正權值,非常積極,會產生振蕩,還有神經元不被激活,不參與任何訓練。如何改變這種情況。針對10個人,可以分成2班,形成均勻分配。每一天都隨機選擇5個人上班,因為人多,工作時間長,所以被選中國內的概率都是一致的,每一個神經元都會隨機參與。在全連接層一般會使用暫退法則。

DropOut,工廠干活時10個人一定出現分化,反映到神經網絡,某些神經元會不停調正權值,非常積極,會產生振蕩,還有神經元不被激活,不參與任何訓練。如何改變這種情況。針對10個人,可以分成2班,形成均勻分配。每一天都隨機選擇5個人上班,因為人多,工作時間長,所以被選中國內的概率都是一致的,每一個神經元都會隨機參與。在全連接層一般會使用暫退法則。

2. 框架

嵌入式Tensorflow稍多,但是方向為Pytorch

tensorflow2.0 版本以上和Pytorch類似。同一個網絡同一組參數最后的結果是不一樣的。

pytorch 張量 一切都是 tensor 張量。神經網絡就是圖,圖可以獲得偏導。圖神經網絡 GNN

)

)

【標題字體過小】問題根源與解決方案)

——CRUD進階與數據庫約束:構建健壯數據系統的基石)

![Python 鏈接各種中間件[Mysql\redis\mssql\tdengine]](http://pic.xiahunao.cn/Python 鏈接各種中間件[Mysql\redis\mssql\tdengine])

)