一、背景:遠程醫療邁入“沉浸式協同”的新階段

過去,遠程醫療主要依賴視頻會議系統,實現基礎的遠程問診、會診或術中指導。雖然初步解決了地域限制問題,但其單視角、平面化、缺乏沉浸感與交互性的特征,已無法滿足臨床協作、手術示教、康復管理等復雜醫療場景的需要。

隨著VR頭戴設備(HMD)的普及、Unity3D引擎在可視化和交互場景構建中的深入應用,以及5G與實時音視頻傳輸技術的突破,遠程診療正逐步邁向“沉浸式協同”的新階段:

-

醫生可身臨其境地觀察術野畫面,圍繞患者構建三維診療空間;

-

遠端專家可同步進入虛擬場景,進行多視角觀摩、標注、指導;

-

患者則可在家通過頭顯設備參與復健動作訓練,并實時獲取反饋;

-

教學過程中,學生通過 VR 重現手術過程,實現更深層次的感知與理解。

這一轉變對底層視頻播放與互動系統提出了前所未有的挑戰:更低的延遲、更高的清晰度、更穩定的多協議播放能力,以及對頭顯平臺的深度適配與交互支持,成為構建下一代醫療系統的技術基石。

二、技術挑戰:醫療級 VR 遠程播放的五大關鍵難題

相比一般的視頻播放,醫療級遠程診療對音視頻系統提出了更為嚴苛的技術要求。無論是延遲控制、圖像質量,還是設備兼容性與交互能力,稍有不足都可能直接影響診療效果。在將視頻播放引入 VR 頭顯設備的過程中,主要面臨以下五大技術挑戰:

? 1. 延遲控制難度大

遠程醫療強調實時反饋與操作協同,而傳統播放器的端到端延遲通常在 800ms 以上,遠超醫療交互所需的 150~200ms 范圍。一旦畫面延遲過高,會導致醫生無法準確判斷術野變化、患者動作或指導反饋,從而影響操作安全與診療效率。

🧩 2. Unity3D 引擎集成復雜

Unity 是構建 VR 醫療場景的主流引擎,但大多數通用播放器難以直接與 Unity 渲染管線融合。在視頻解碼完成后,如何將圖像高效映射到 Unity 的材質系統中,進而實現頭顯左右眼同步渲染,是實現沉浸式體驗的關鍵技術門檻。

📶 3. 協議源類型多樣,兼容性要求高

醫療系統中常見的設備如內窺鏡、高清攝像頭通常采用 RTSP 協議進行推流,而遠程教學或云端轉播又常使用 RTMP。一套播放系統必須同時支持多種協議,并在不同網絡條件下穩定運行,這對播放器內核的兼容性與適應性提出了更高要求。

🧠 4. VR 頭顯硬件資源受限

當前大多數 VR 設備基于 Android 系統,受限于 CPU 性能、GPU 帶寬及內存容量。若播放器設計不夠精簡,容易導致解碼卡頓、發熱升溫、功耗過高等問題,直接影響佩戴體驗與系統穩定性。因此,必須實現輕量級、高效能的視頻解碼與渲染路徑。

🎯 5. 多源視頻同步與多視角空間組織復雜

在臨床教學或遠程手術協同中,往往需要同時展示多個視頻流:術野主畫面、醫生講解、輔助視角、圖文標注等。這些畫面既要時序同步,又要在 VR 空間中合理排布,并支持用戶自由切換或組合觀看,極大增加了渲染與交互設計的復雜度。

總結來說,醫療級 VR 視頻播放不僅僅是“能播”這么簡單,更是對低延遲能力、渲染融合、協議支持、資源優化與交互體驗的全方位考驗。唯有構建專為醫療場景打造的視頻處理架構,才能真正支撐起沉浸式遠程診療的落地需求。

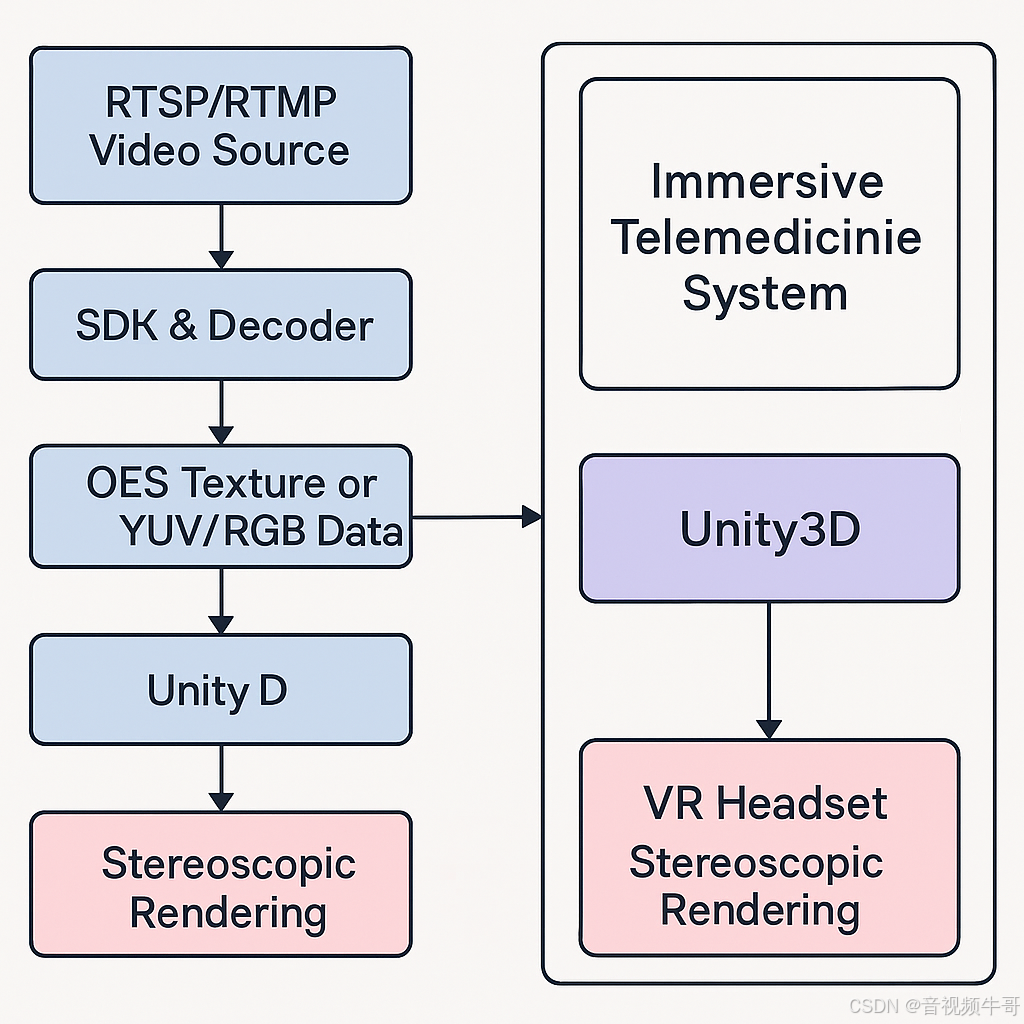

三、解決方案:大牛直播SDK × Unity3D × VR頭顯 的融合架構

為了滿足遠程醫療在 VR 場景下對“低延遲、高穩定、強交互”的多重要求,采用大牛直播SDK與 Unity3D 的深度融合架構,構建了一個高效、可擴展、可跨平臺的沉浸式視頻播放方案。該方案在底層播放能力、引擎渲染、設備適配、交互控制等多個維度進行了系統優化,有效解決了醫療級 VR 播放中的核心難題。

Android平臺Unity共享紋理模式RTMP播放延遲測試

? 1. 播放器內核:原生多協議、低延遲、高并發

大牛直播SDK 具備成熟穩定的 RTSP / RTMP 播放能力,支持軟硬解碼動態切換,并對醫療場景常見的視頻源做了深度適配:

-

協議支持全面:支持 RTSP(UDP/TCP)、RTMP可無縫切換,兼容主流醫療視頻系統與云端平臺。

-

低延遲優化:內置超低延遲模式,端到端延遲最低可達 100~200ms,滿足手術示教與遠程協作的實時性需求。

-

高穩定性播放:支持斷流重連、動態碼率適應、流狀態監聽等機制,保障長時間穩定運行。

? 2. 引擎融合:Unity3D 插件化接入,支持頭顯雙目渲染

在 Unity 平臺下,通過將大牛直播SDK 封裝為可復用的插件組件,支持與 Unity 渲染管線深度對接:

-

原生接口封裝:支持 Android、Windows 等平臺的 JNI / C# 接口調用,快速集成至 Unity 項目。

-

紋理綁定高效:通過

SurfaceTexture+ExternalTexture實現視頻紋理與 Unity 材質的 GPU 零拷貝綁定。 -

頭顯適配良好:支持 VR 模式下的左右眼分屏渲染,保證沉浸式視覺體驗不受破壞。

-

多畫面支持:支持多個視頻流在同一 Unity 場景中同步渲染,可靈活部署主視角、輔視角、講解層等區域。

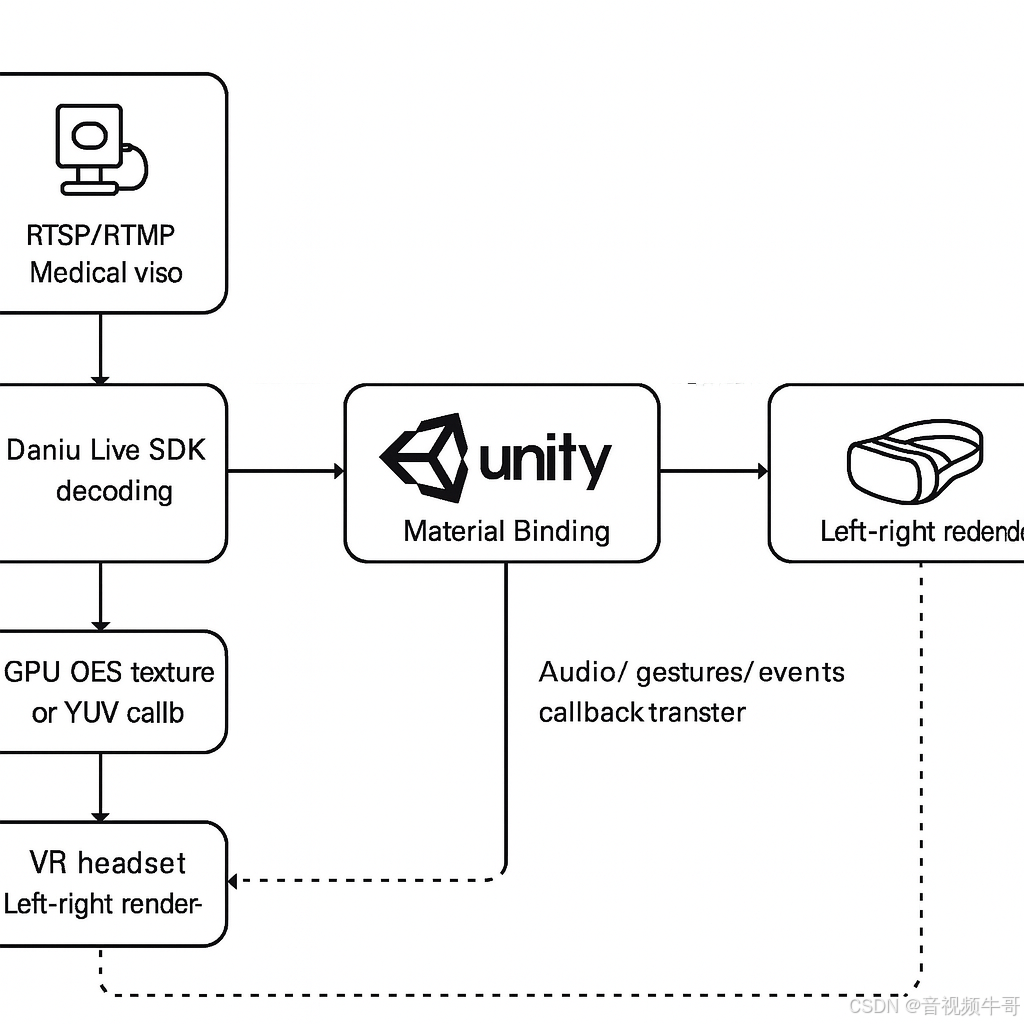

? 3. 渲染管線:全流程 GPU 加速 + 零拷貝優化

為提升幀率與播放流暢性,整個渲染管線以“低功耗 + 高性能”為目標進行了系統優化:

[RTSP/RTMP 視頻源]↓

[大牛直播SDK 解碼(支持 H.264/H.265)]↓

[OES 紋理輸出 or YUV/RGB 數據回調]↓

[Unity 材質綁定 ExternalTexture]↓

[頭顯左右眼同步渲染顯示]

該流程具備以下優勢:

-

GPU 直接接管解碼紋理,避免 CPU?GPU 的頻繁數據傳輸;

-

內部緩存機制優化首幀加載速度與播放平滑度;

-

可擴展支持圖像增強、邊緣疊加、AI 標注層等圖層疊加。

? 4. 醫療場景專屬優化能力

針對遠程醫療的特殊需求,大牛直播SDK + Unity3D 的組合還提供如下關鍵能力:

-

多音視頻流同步播放:支持多個手術/講解視角的時間軸同步控制,確保場景一致性。

-

空間交互集成:與 Unity XR Interaction Toolkit 無縫融合,可加入手勢識別、語音控制等交互方式。

-

全平臺支持:適配主流 VR 設備(如 Pico、Quest 系列)以及移動端/PC端的輔助查看終端。

-

可錄制、可截圖、可轉推:支持本地錄像、實時截圖、轉推流等能力,便于教學與數據歸檔。

? 5. 模塊化架構,便于擴展與集成

該方案以模塊化插件結構設計,可根據不同項目需求靈活裁剪與擴展:

-

📦 播放內核可獨立更新,無需重構主項目;

-

🧩 多協議模塊可按需啟用;

-

🧠 可無縫接入 AI 圖像識別、事件檢測模塊;

-

?? 支持邊緣計算節點部署與云端協同轉碼。

總結來看,大牛直播SDK 與 Unity3D 的深度融合不僅解決了遠程醫療中高質量視頻播放的技術瓶頸,還打通了 VR 設備與醫療系統之間的互動通道,真正實現了“可落地、可擴展、可演進”的沉浸式遠程診療基礎架構。

四、典型應用場景落地:打造沉浸式醫療協同體驗

在遠程醫療的多元化發展過程中,傳統的視頻通話方案逐漸無法滿足新型醫療協同的體驗訴求。以大牛直播SDK 為核心的視頻能力疊加 Unity3D 的三維渲染與交互能力,構建的沉浸式播放系統已在以下典型場景中實現落地應用,并展現出顯著的實用價值:

🎓 1. 手術示教與醫學教學

應用方式:

通過 Unity3D 構建虛擬手術室場景,集成 RTSP 推流的術野畫面、醫生講解流、PPT 疊加等多源內容,實時同步播放至學生頭顯設備中。

技術要點:

-

多畫面同步渲染(主視角 + 輔視角 + 解說)

-

支持空間定位講解與圖層標注

-

支持課后錄像回放與素材導出

價值體現:

提升醫學教育沉浸感與參與度,讓學生“進入手術現場”,突破傳統教室教學的視覺與空間限制。

🧠 2. 多院遠程會診與協同決策

應用方式:

遠程專家通過頭顯進入統一的虛擬會診空間,實時觀看患者術前檢查圖像、實時影像數據流,同時與本地醫生展開空間化互動討論。

技術要點:

-

遠程 RTSP 畫面與 Unity 場景融合

-

支持語音通話、注釋與圖層同步

-

可引入 AI 模型實時輔助分析(如腫瘤勾畫)

價值體現:

打破時空壁壘,提升會診效率,構建高質量、多學科協同的臨床決策環境。

🩹 3. 居家康復訓練與慢病隨訪

應用方式:

患者在家佩戴 VR 頭顯進入康復訓練場景,觀看康復視頻流或醫生遠程指導畫面,并根據提示完成指定動作;醫生端實時接收頭顯反饋,給予針對性調整。

技術要點:

-

RTMP 實時視頻遠程推流

-

Unity 中接入動作捕捉與行為監測模塊

-

支持遠程語音指令控制與交互反饋

價值體現:

提升患者依從性與訓練效果,降低隨訪成本,增強康復過程可視性與互動性。

🧪 4. 手術過程直播與術后復盤分析

應用方式:

在關鍵手術過程中,系統可將術野視頻流實時轉碼為 RTMP,推送至 VR 教學空間或專家復盤場景中;術后可通過錄像回放進行多角度分析。

技術要點:

-

支持原始碼流無損錄制

-

多流同步錄像與時間軸跳轉分析

-

可疊加術中注釋與圖像標記

價值體現:

提升教學價值與術后評估精度,形成可持續沉淀的知識資料庫。

🧬 5. AI + VR 遠程圖像分析平臺

應用方式:

將遠程視頻畫面通過大牛直播SDK 拉流至本地,實時進行圖像識別(如病灶檢測、行為分析),分析結果可疊加至 Unity 場景中顯示或觸發交互邏輯。

技術要點:

-

播放器支持 YUV/RGB 數據回調接口

-

Unity 層接入視覺 AI 模型

-

支持識別結果空間化可視呈現

價值體現:

實現智能分析與視覺反饋閉環,提升遠程醫療的精準性與智能化水平。

總結來看,無論是術中教學、遠程會診,還是康復指導與智能分析,大牛直播SDK + Unity3D + VR頭顯所構建的沉浸式視頻播放架構,正在不斷拓展遠程醫療的應用邊界,為智慧醫療體系注入可感知、可互動、可進化的新能力。

五、技術亮點全景圖

| 技術維度 | 關鍵能力描述 | 實際價值體現 |

|---|---|---|

| 🔁 多協議兼容 | 原生支持 RTSP(TCP/UDP)、RTMP等主流流媒體協議 | 無需第三方適配器,輕松接入醫院設備與云平臺 |

| ? 超低延遲播放 | 內置低延遲模式,RTMP、RTSP端到端延遲控制在 100~200ms | 滿足術中遠程協作、教學同步、AI輔助診斷等場景 |

| 🧩 Unity3D 插件化集成 | 支持 Unity 調用原生解碼,紋理零拷貝綁定材質,兼容 XR 管線 | 快速構建三維沉浸式場景,無需重寫渲染框架 |

| 🎥 多畫面多視角支持 | 支持多路視頻同時接入與空間布置(術野+講解+輔助視角) | 滿足手術示教、會診分析等多視角同步需求 |

| 🧠 VR頭顯優化 | 解碼+渲染資源開銷控制,支持雙目立體顯示、斷網重連、低功耗運行 | 提升播放流暢度與頭顯佩戴體驗,避免發熱卡頓 |

| 📊 YUV/RGB 數據回調 | 播放器支持裸數據幀回調,可供 AI 圖像識別、邊緣分析、自動標注等處理流程使用 | 構建智能診療與圖像增強流程的底層輸入通道 |

| 💬 音視頻交互回傳 | 可以通過APP上層邏輯實現支持語音通話、手勢控制、交互事件傳遞回 Unity 邏輯層 | 增強醫生與患者/學生的沉浸式交互能力 |

| 📱 跨平臺部署能力 | 支持 Android(頭顯)、iOS、Windows、Linux 等全平臺播放端部署 | 滿足多終端同步觀看與混合現實醫療教學部署場景 |

六、未來擴展方向:打造智慧醫療的實時感知中樞

隨著遠程醫療持續向“智能化、沉浸化、協同化”方向演進,以大牛直播SDK 為核心的 VR 視頻處理架構,將在未來承擔更豐富的角色,逐步從“視頻播放”演進為“實時感知中樞”。在此基礎上,可進一步拓展如下能力:

🔍 1. AI 模塊集成:從被動觀看到智能感知

-

自動識別術中關鍵事件:如出血、組織切割等,通過 YUV/RGB 數據回調對接 AI 模型;

-

智能圖像增強與標注:自動勾勒病灶邊界,進行實時疊加顯示;

-

邊緣推理計算協同:結合邊緣端推理芯片,實現視頻內容本地識別,提升處理效率并降低延遲。

🌐 2. 跨端協同:VR 醫療體驗輕量化

-

多終端混合同步:支持 VR 頭顯 + 平板 + PC 同步觀看,適配不同角色需求;

-

遠程注解與權限控制:專家可在視頻畫面上遠程標注、調閱資料、發布操作指令。

🧠 3. 數字孿生醫療空間構建

-

基于真實數據復現手術流程與空間布置;

-

結合傳感器數據、視頻流、設備模型進行空間建模;

-

構建“醫療場景 + 視頻流 + 控制流”三位一體的可交互數字醫療系統。

?? 4. 云邊協同與私有化部署能力

-

支持邊緣節點緩存轉發、推流調度,保障大規模醫院或集團使用;

-

私有化部署支持醫療數據合規要求(如 HIPAA、GDPR)。

? 結語:從視頻播放到醫療協作的數字基建

大牛直播SDK 與 Unity3D 在 VR 遠程醫療中的融合應用,不僅僅是一個播放器集成方案,而是一套面向未來醫療場景的“視頻能力平臺”。

它打通了:

-

多協議音視頻的超低延遲采集與播放路徑;

-

三維交互與沉浸式空間的深度集成方式;

-

AI 輔助識別、遠程協同、跨端適配等智能化能力接口。

在教學、診斷、協作、康復等多場景中,它已經不僅是傳輸圖像的通道,更是數字醫療系統的交互窗口、數據入口與感知橋梁。

隨著 VR 醫療的不斷發展,這一融合架構將承載起越來越多的智能協作任務,助力醫療體系真正走向數字化、空間化、泛在化的新階段。

📌 如果你正在尋找一套高效穩定、功能強大、可持續演進的醫療級 VR 視頻集成方案,大牛直播SDK 是值得信賴的核心選擇之一。

)

)

![C study notes[3]](http://pic.xiahunao.cn/C study notes[3])

—組合模式)

安全檢查)

)