計算機科學與技術

計算機科學與技術(CS)是一門涵蓋理論、系統、應用的綜合學科,其課程體系圍繞“計算機的底層原理、開發方法、技術創新”展開,既包含數學與理論基礎,也涉及工程實踐與前沿技術。以下是主要課程的分類梳理:

一、數學與基礎編程(公共基礎課)

數學是計算機科學的底層支撐,編程則是實踐的工具,這兩類課程為后續學習奠定基礎。

1. 數學類

- 高等數學(微積分):研究函數的極限、導數、積分及微分方程,用于機器學習中的梯度計算、圖形學的曲面建模等。

- 線性代數:矩陣運算、向量空間、特征值/特征向量等,是機器學習(如神經網絡、主成分分析)、計算機圖形學(坐標變換)的核心工具。

- 概率論與數理統計:隨機變量、概率分布、假設檢驗、回歸分析等,支撐機器學習(貝葉斯模型、統計學習)、大數據分析(數據挖掘)等領域。

- 離散數學:集合論、圖論、邏輯代數、組合數學等,是算法設計(如圖遍歷)、密碼學(數論)、編譯原理(形式語言)的理論基礎。

2. 編程基礎

- C語言程序設計:學習結構化編程、指針、內存管理等底層操作,理解計算機如何執行指令(如棧幀、內存分配)。

- Python/R語言:面向對象與腳本編程,用于快速驗證算法、數據分析(R更側重統計)及機器學習原型開發。

- Java/Go語言:部分院校會作為進階語言,Java常用于企業級開發(如Spring框架),Go適合高并發系統(如云計算)。

二、計算機系統基礎(理解“計算機如何工作”)

這類課程聚焦計算機硬件與軟件的協同機制,是理解系統底層邏輯的核心。

1. 計算機組成原理

研究計算機硬件系統的組成與運行機制,包括:

- 數據表示(二進制、浮點數)、運算器(加減乘除邏輯)、存儲器(緩存、內存、硬盤層次結構);

- CPU指令執行流程(取指-譯碼-執行)、總線與I/O設備交互;

- 匯編語言(如x86匯編):理解高級語言如何轉換為機器指令。

2. 操作系統(OS)

探索管理計算機資源的系統軟件,核心內容包括:

- 進程與線程管理(調度算法、同步互斥、死鎖);

- 內存管理(分頁/分段、虛擬內存、缺頁中斷);

- 文件系統(目錄結構、磁盤塊分配、索引節點);

- 輸入輸出(設備驅動、中斷處理)。

實踐:通過Linux內核源碼分析或模擬器(如QEMU)動手實現簡單OS功能。

3. 計算機網絡

研究網絡通信的協議與技術,覆蓋OSI七層模型與TCP/IP四層模型:

- 物理層(信號傳輸、編碼)、數據鏈路層(MAC地址、以太網、PPP);

- 網絡層(IP協議、路由算法、NAT);

- 傳輸層(TCP可靠傳輸、UDP無連接);

- 應用層(HTTP/HTTPS、DNS、SMTP);

- 網絡安全(加密算法、防火墻、DDoS攻擊)。

實踐:使用Wireshark抓包分析、搭建小型局域網。

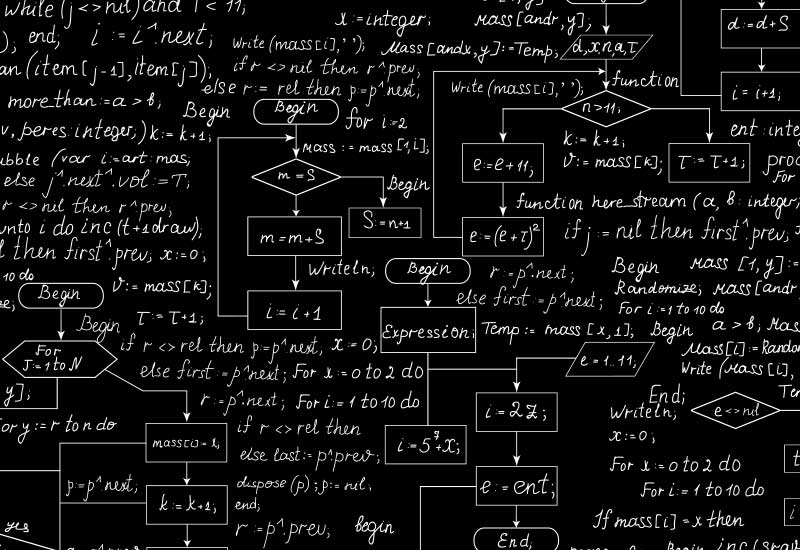

4. 編譯原理

研究將高級語言轉換為機器語言的過程,核心步驟包括:

- 詞法分析(正則表達式、Lex工具)、語法分析(上下文無關文法、Yacc/Bison);

- 語義分析(類型檢查、中間代碼生成);

- 優化(循環展開、常量傳播)與目標代碼生成(匯編/機器碼)。

三、核心專業課程(解決“如何高效計算與存儲”)

這類課程聚焦軟件開發的核心方法論、數據處理與系統設計,是計算機科學的技術主干。

1. 數據結構與算法

- 數據結構:線性表(數組、鏈表)、樹(二叉樹、紅黑樹、B+樹)、圖(鄰接表/矩陣、最短路徑算法)、哈希表(沖突解決);

- 算法設計:排序(快速排序、歸并排序)、查找(二分查找、哈希查找)、遞歸與分治、動態規劃、貪心算法;

- 復雜度分析:時間/空間復雜度計算,評估算法效率(如O(n log n) vs O(n2))。

實踐:LeetCode刷題、實現高效數據結構(如跳表)。

2. 數據庫系統

研究數據的存儲、管理與查詢,涵蓋:

- 關系型數據庫(SQL):ER模型設計、范式理論、事務(ACID特性)、索引優化;

- 非關系型數據庫(NoSQL):鍵值(Redis)、文檔(MongoDB)、列族(HBase)、圖(Neo4j);

- 分布式數據庫:分庫分表、一致性(CAP定理)、分布式事務(2PC/3PC)。

實踐:使用MySQL設計電商數據庫、用Python操作Redis緩存。

3. 軟件工程

研究軟件開發的全生命周期管理,包括:

- 方法學(瀑布模型、敏捷開發、DevOps);

- 需求分析(UML建模、用例圖)、設計模式(單例、工廠、觀察者);

- 測試與調試(單元測試、集成測試、自動化測試);

- 版本控制(Git/GitHub)、持續集成(CI/CD)。

實踐:團隊協作完成一個完整項目(如博客系統),使用Jira管理需求。

四、實踐與項目(理論與應用的橋梁)

計算機科學強調“做中學”,實踐課程貫穿始終,常見形式包括:

- 課程設計:每門核心課的配套實踐(如“數據結構課程設計”實現圖書館管理系統,“操作系統課程設計”實現文件系統)。

- 實驗課:驗證性實驗(如用Verilog設計CPU流水線)與綜合性實驗(如用Python實現一個簡單的Web服務器)。

- 畢業設計:本科階段的核心項目(通常3-6個月),需獨立或組隊完成一個完整系統(如基于深度學習的圖像識別平臺)。

- 競賽與開源:參與ACM-ICPC(算法競賽)、挑戰杯(創新項目)或貢獻GitHub開源項目(如優化一個Python庫)。

五、前沿方向課程(跟蹤技術趨勢)

隨著技術發展,計算機科學不斷延伸出新的交叉領域,高校會根據研究方向開設選修或進階課程,常見方向包括:

1. 人工智能與機器學習

- 機器學習基礎(監督/無監督學習、決策樹、SVM);

- 深度學習(神經網絡、CNN/RNN/Transformer、PyTorch/TensorFlow框架);

- 強化學習(馬爾可夫決策過程、Q-learning、AlphaGo原理);

- 應用:計算機視覺(圖像分類、目標檢測)、自然語言處理(NLP、情感分析)。

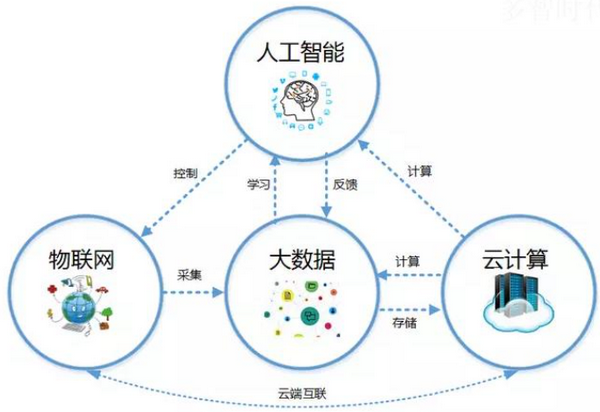

2. 大數據與云計算

- 大數據處理框架(Hadoop MapReduce、Spark);

- 分布式系統(一致性協議、Raft算法、Paxos);

- 云計算(IaaS/PaaS/SaaS、AWS/Azure/GCP實踐、容器化Docker/K8s);

- 數據倉庫與數據挖掘(OLAP、關聯規則挖掘、推薦系統)。

3. 網絡安全與密碼學

- 網絡攻擊與防御(滲透測試、SQL注入、XSS漏洞);

- 密碼學基礎(對稱加密AES、非對稱加密RSA、哈希算法SHA);

- 安全協議(SSL/TLS、IPSec)、區塊鏈安全(共識機制、智能合約漏洞)。

4. 高性能計算與分布式系統

- 并行計算(多線程、MPI、CUDA編程);

- 分布式存儲(GFS、HDFS、分布式數據庫);

- 邊緣計算(物聯網終端數據處理、低延遲優化)。

計算機科學與技術是否落伍了?

計算機科學與技術(CS)作為一門與技術發展緊密相關的學科,常被質疑“是否落伍”。但從學科本質、技術演進規律和應用場景的擴展來看,它不僅沒有落伍,反而在持續進化,始終是推動數字化社會的核心驅動力。以下從多個維度展開分析:

一、學科本質:底層邏輯穩定,支撐技術迭代

計算機科學的核心是研究“計算”的本質、方法與系統,其底層理論(如算法設計、數據結構、離散數學、操作系統原理)是技術發展的基石,具有極強的穩定性。這些內容不會因具體技術(如編程語言、框架、硬件)的更新而過時,反而為新技術的誕生提供理論支撐。

二、技術演進:從“工具革新”到“范式突破”,學科持續吸收新成果

計算機科學的發展史本質上是技術范式的不斷突破史,每一次技術革新(如從單機到互聯網、從PC到移動計算、從云計算到AI)都推動了學科邊界的擴展,而非替代學科本身。

1. 經典技術的“縱向深化”

早期計算機科學聚焦于硬件(如CPU設計)和基礎軟件(如操作系統),如今這些領域仍在向更復雜的方向演進:

- 硬件層面:從硅基芯片到量子計算(量子比特、量子算法),計算機組成原理的研究對象從經典電路擴展到量子系統;

- 軟件層面:操作系統從管理單機資源到管理分布式集群(如Kubernetes容器編排),內存管理從虛擬內存發展到分布式緩存(如Redis)。

2. 新興領域的“橫向融合”

計算機科學與其他學科的交叉融合催生了大量新方向,成為學科增長的核心動力:

- AI與計算機科學的融合:機器學習(尤其是深度學習)本質上是對“數據驅動計算”的探索,已成為計算機科學的核心分支(多數高校已將其納入本科課程);

- 生物+計算機:生物信息學(基因測序算法)、類腦計算(神經形態芯片)推動計算模型從“馮·諾依曼架構”向“神經形態架構”拓展;

- 物理+計算機:量子計算(量子比特糾纏)、智能硬件(傳感器網絡)將計算能力延伸到微觀世界和物理空間;

- 社會+計算機:社會計算(社交媒體數據分析)、計算社會科學(網絡行為建模)讓計算機科學從“解決技術問題”轉向“解決社會問題”。

總結:計算機科學從未落伍,反而在持續進化

計算機科學與技術的本質是研究“計算”的規律與方法,其核心理論穩定,應用場景擴展,教育體系動態調整。技術迭代(如AI、量子計算)是學科發展的自然結果,而非替代。對于學習者而言,關鍵不在于擔心“學科是否落伍”,而在于掌握核心基礎(如算法、系統)并保持對新技術的學習能力——這才是應對技術變革的根本。

城市白模加載與樣式控制)

)

移植全解-基于IIC)

綜合知識答案和詳解(回憶版))

:智能路由器的安全守衛)

)

)

)