作者:Tom Hardy

Date:2020-02-01

來源:MSFNet:多重空間融合網絡進行實時語義分割(北航和曠視聯合提出)

原文鏈接:https://arxiv.org/abs/1911.07217

主要內容

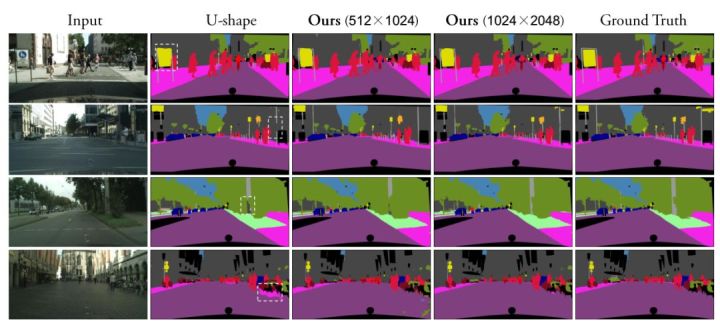

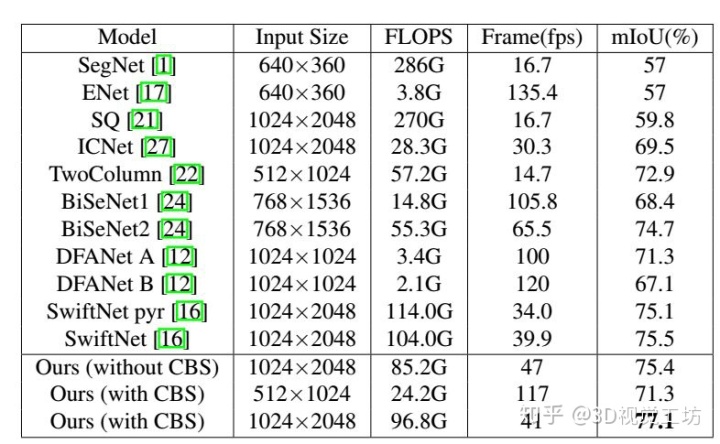

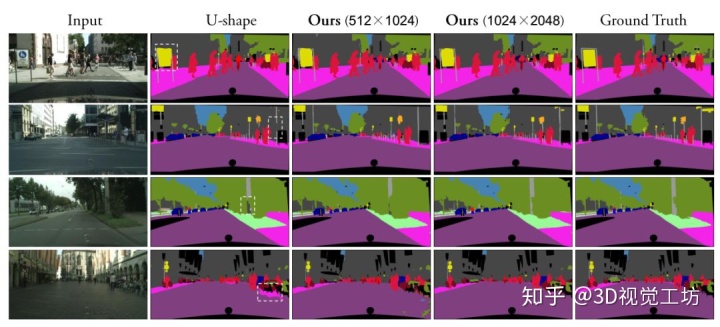

實時語義分割是一項具有挑戰性的任務,因為需要同時考慮效率和性能,其在自動駕駛、機器人等工業應用中發揮著重要的作用。針對這一復雜的任務,論文提出了一種高效的卷積網絡結構:多重空間融合網絡(MSFNet)來完成快速和準確的感知。MSFNet在多特征融合模塊的基礎上,利用類邊界監督來處理相關的邊界信息,從而獲得空間信息,擴大接收范圍。網絡最后對原始圖像1/8大小的特征圖進行上采樣,在保持較高速度的同時,可以獲得良好的分割結果。網絡在Cityscapes和CAMVID數據集上的實驗表明,與現有方法相比,所提出的方法具有明顯的優勢。更為具體地,對于1024×2048輸入圖像,它以41 FPS的速度在Cityscapes測試數據集上達到77.1%的mean IOU,而在Camvid測試數據集上以91 FPS的速度達到75.4%的mean IOU。

創新和改進點

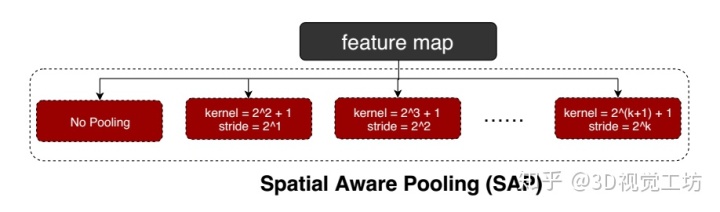

1、論文提出了一種新的多特征融合模塊(MFM),利用精心設計的空間感知池(SAP),在保持較小計算開銷的同時,擴大接收范圍,恢復空間信息的丟失

2、為了解決邊緣相關空間信息的丟失問題,論文提出了一種新的類邊界監控方法。

3、現有的分割方法主要集中在提高精度上,但是低延時實現實時性能是實際應用中最關鍵的問題,MSFNet主要針對速度進行改進。

4、在兩個基準數據集上的實驗表明,論文提出的方法在精度和推理時間上都優于大多數state-of-the-art方法。

網絡結構

先前的大多數網絡結構通過降低輸入分辨率來加快推理速度,但這會嚴重丟失空間信息,尤其是和邊緣相關的信息;還有一些方法通過減少通道來降低計算成本,但這會導致網絡的精度急劇下降;除此之外,還有一些輕量級的淺層網絡,但這些網絡有明顯的缺陷,因為它們通常太淺而無法獲得足夠的感受野。基于上述的種種缺陷,MSFNet在結構上做了相關改進和優化。

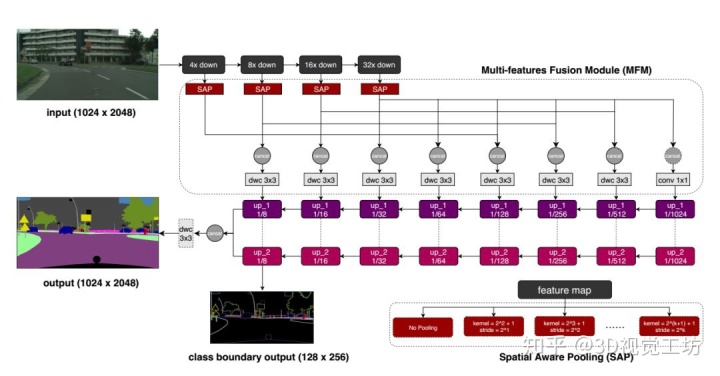

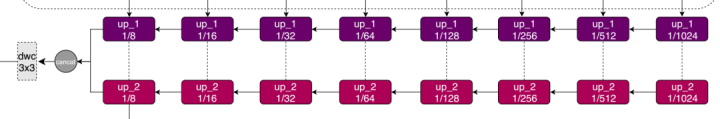

MSFNet網絡結構

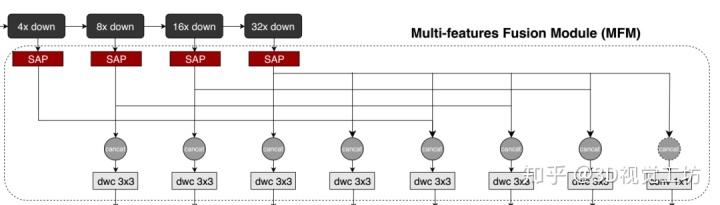

MSFNet的這種結構擴大了感受野并重新彌補空間信息損失,同時保持較小的計算成本。MSFNet中的兩個核心:MFM(多特征融合)和SAP(空間感知池化)。

針對SAP:

1、多分支pooling進行處理,論文分支數設為5個pooling和1個unpooling。

2、輸出多尺度feature map

針對MFM:

1、將SAP模塊中具有相同分辨率的特征圖進行聚合輸出,最后一個32x down經過SAP處理后,產生6個尺度的feature map,其中,第3~5個feature map分別和前面4x down、8x down、16x down經過SAP處理后與之對應相同分辨率的feature map進行concat。

2、使用3x3的深度可分離卷積進行特征融合,由于聚合后通道數量很多,使用深度可分離卷積可以顯著降低成本。

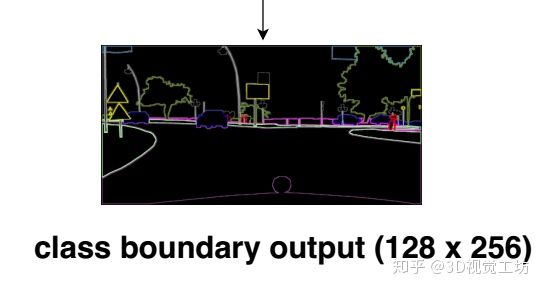

類別邊緣信息監督模塊:

為了恢復邊緣空間信息,進一步提高分割效果,論文提出了兩個獨立的上采樣分支。在上采樣過程中,兩個上采樣分支不相互傳遞信息。在類別邊緣方面,利用Ground Truth邊界來監督分割任務,使得網絡更加關注邊緣類別信息,降低像素級別的錯分率。

最后將類別邊緣監督信息和上分支feature map進行concat,然后使用深度可分離卷積進行特征融合,輸出最終分割結果。

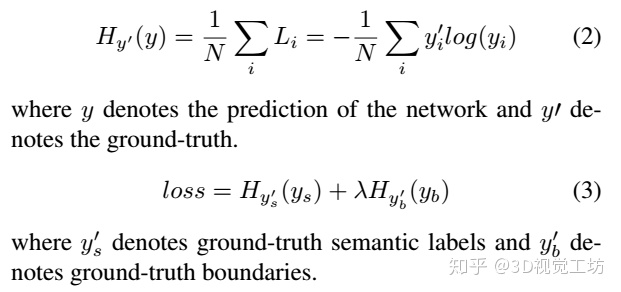

網絡損失函數:

這里一共兩類損失函數,一個是基于邊緣信息的,一個是基于整體輸出的,兩類損失構成最終的loss,并用一個超參數λ來平衡:

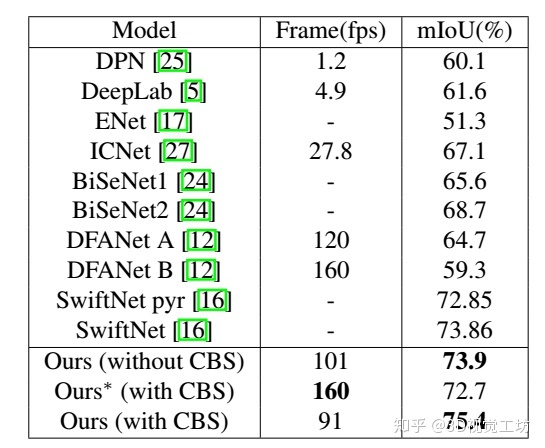

實驗結果

論文給出的實驗結果,綜合考慮速度和mIoU,MSFNet效果最佳!

上述內容,如有侵犯版權,請聯系作者,會自行刪文。

重磅!3DCVer-學術交流群已成立

歡迎加入我們公眾號讀者群一起和同行交流,目前有3D視覺、CV&深度學習、SLAM、三維重建、點云后處理、自動駕駛、CV入門、醫療影像、缺陷檢測、行人重識別、目標跟蹤、視覺產品落地、視覺競賽、車牌識別等微信群,請掃描下面微信號加群,備注:”研究方向+學校/公司+昵稱“,例如:”3D視覺 + 上海交大 + 靜靜“。請按照格式備注,否則不予通過。添加成功后會根據研究方向邀請進去相關微信群。原創投稿也請聯系。

:數組和列表)

無頭模式 headless)

【已解決】...)

之服務治理模塊Spring Cloud Eureka 搭建注冊中心)

)

)

)