2019獨角獸企業重金招聘Python工程師標準>>>

Local模式

運行Spark最簡單的方法是通過Local模式(即偽分布式模式)。

????運行命令為:./bin/run-example org.apache.spark.examples.SparkPi local

基于standalone的Spark架構與作業執行流程

Standalone模式下,集群啟動時包括Master與Worker,其中Master負責接收客戶端提交的作業,管理Worker。提供了Web展示集群與作業信息。

?

名詞解釋:

1. Standalone模式下存在的角色。

Client:客戶端進程,負責提交作業到Master。

Master:Standalone模式中主控節點,負責接收Client提交的作業,管理Worker,并命令Worker啟動Driver和Executor。

Worker:Standalone模式中slave節點上的守護進程,負責管理本節點的資源,定期向Master匯報心跳,接收Master的命令,啟動Driver和Executor。

Driver: 一個Spark作業運行時包括一個Driver進程,也是作業的主進程,負責作業的解析、生成Stage并調度Task到Executor上。包括DAGScheduler,TaskScheduler。

Executor:即真正執行作業的地方,一個集群一般包含多個Executor,每個Executor接收Driver的命令Launch Task,一個Executor可以執行一到多個Task。

2.作業相關的名詞解釋

Stage:一個Spark作業一般包含一到多個Stage。

Task:一個Stage包含一到多個Task,通過多個Task實現并行運行的功能。

DAGScheduler: 實現將Spark作業分解成一到多個Stage,每個Stage根據RDD的Partition個數決定Task的個數,然后生成相應的Task set放到TaskScheduler中。

TaskScheduler:實現Task分配到Executor上執行。

?

提交作業有兩種方式,分別是Driver(作業的master,負責作業的解析、生成stage并調度task到,包含DAGScheduler)運行在Worker上,Driver運行在客戶端。接下來分別介紹兩種方式的作業運行原理。

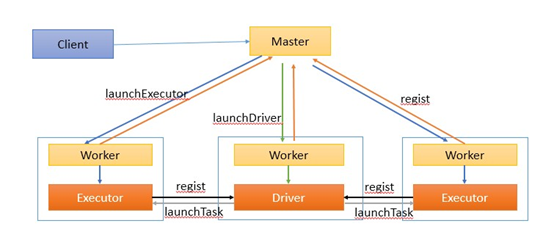

Driver運行在Worker上

????通過org.apache.spark.deploy.Client類執行作業,作業運行命令如下:

????????./bin/spark-class org.apache.spark.deploy.Client launch spark://host:port file:///jar_url org.apache.spark.examples.SparkPi spark://host:port

????作業執行流如圖1所示。

圖1

作業執行流程描述:

- 客戶端提交作業給Master

- Master讓一個Worker啟動Driver,即SchedulerBackend。Worker創建一個DriverRunner線程,DriverRunner啟動SchedulerBackend進程。

- 另外Master還會讓其余Worker啟動Exeuctor,即ExecutorBackend。Worker創建一個ExecutorRunner線程,ExecutorRunner會啟動ExecutorBackend進程。

- ExecutorBackend啟動后會向Driver的SchedulerBackend注冊。SchedulerBackend進程中包含DAGScheduler,它會根據用戶程序,生成執行計劃,并調度執行。對于每個stage的task,都會被存放到TaskScheduler中,ExecutorBackend向SchedulerBackend匯報的時候把TaskScheduler中的task調度到ExecutorBackend執行。

- 所有stage都完成后作業結束。

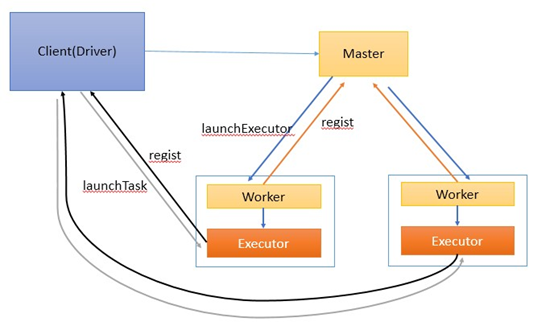

Driver運行在客戶端

????直接執行Spark作業,作業運行命令如下(示例):

????????./bin/run-example org.apache.spark.examples.SparkPi spark://host:port

????作業執行流如圖2所示。

?

圖2

作業執行流程描述:

- 客戶端啟動后直接運行用戶程序,啟動Driver相關的工作:DAGScheduler和BlockManagerMaster等。

- 客戶端的Driver向Master注冊。

- Master還會讓Worker啟動Exeuctor。Worker創建一個ExecutorRunner線程,ExecutorRunner會啟動ExecutorBackend進程。

- ExecutorBackend啟動后會向Driver的SchedulerBackend注冊。Driver的DAGScheduler解析作業并生成相應的Stage,每個Stage包含的Task通過TaskScheduler分配給Executor執行。

- 所有stage都完成后作業結束。

?

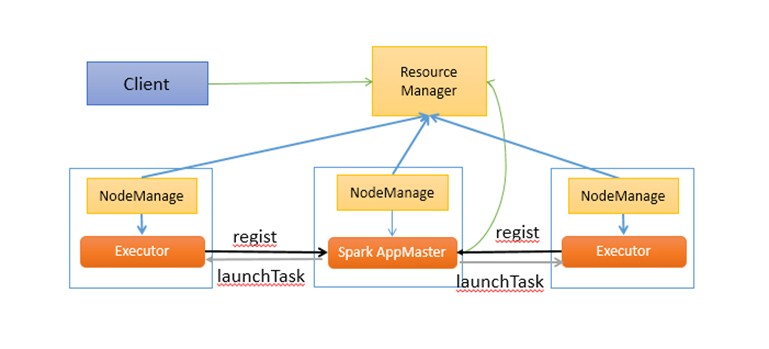

基于Yarn的Spark架構與作業執行流程

這里Spark AppMaster相當于Standalone模式下的SchedulerBackend,Executor相當于standalone的ExecutorBackend,spark AppMaster中包括DAGScheduler和YarnClusterScheduler。

????Spark on Yarn的執行流程可以參考http://www.csdn.net/article/2013-12-04/2817706--YARN?spark on Yarn部分。

????

? ? ?這里主要介紹一下Spark ApplicationMaster的主要工作。代碼參考Apache Spark 0.9.0版本ApplicationMaster.scala中的run()方法。

???????? 步驟如下:

- 設置環境變量spark.local.dir和spark.ui.port。NodeManager啟動ApplicationMaster的時候會傳遞LOCAL_DIRS(YARN_LOCAL_DIRS)變量,這個變量會被設置為spark.local.dir的值。后續臨時文件會存放在此目錄下。

- 獲取NodeManager傳遞給ApplicationMaster的appAttemptId。

- 創建AMRMClient,即ApplicationMaster與ResourceManager的通信連接。

- 啟動用戶程序,startUserClass(),使用一個線程通過發射調用用戶程序的main方法。這時候,用戶程序中會初始化SparkContext,它包含DAGScheduler和TaskScheduler。

- 向ResourceManager注冊。

- 向ResourceManager申請containers,它根據輸入數據和請求的資源,調度Executor到相應的NodeManager上,這里的調度算法會考慮輸入數據的locality。

?

?

http://m635674608.iteye.com/admin/blogs/new

移動APP開發平臺 - Smobiler(1))

![運行tomcat報Exception in thread ContainerBackgroundProcessor[StandardEngine[Catalina]]](http://pic.xiahunao.cn/運行tomcat報Exception in thread ContainerBackgroundProcessor[StandardEngine[Catalina]])