神經網絡表示

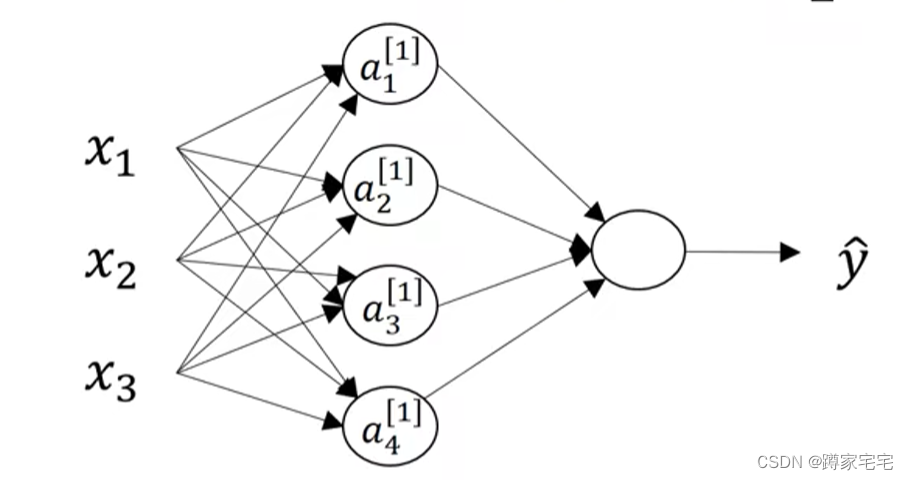

如下圖

就這個神經網絡圖來說,它有三層,分別是輸入層(Input layer),隱藏層(Hidden layer),輸出層(Output layer)

對于其他的神經網絡,隱藏層可以有很多層

一般來說,不把輸入層算作一個標準的層,所以這是一個雙層神經網絡

神經網絡的計算

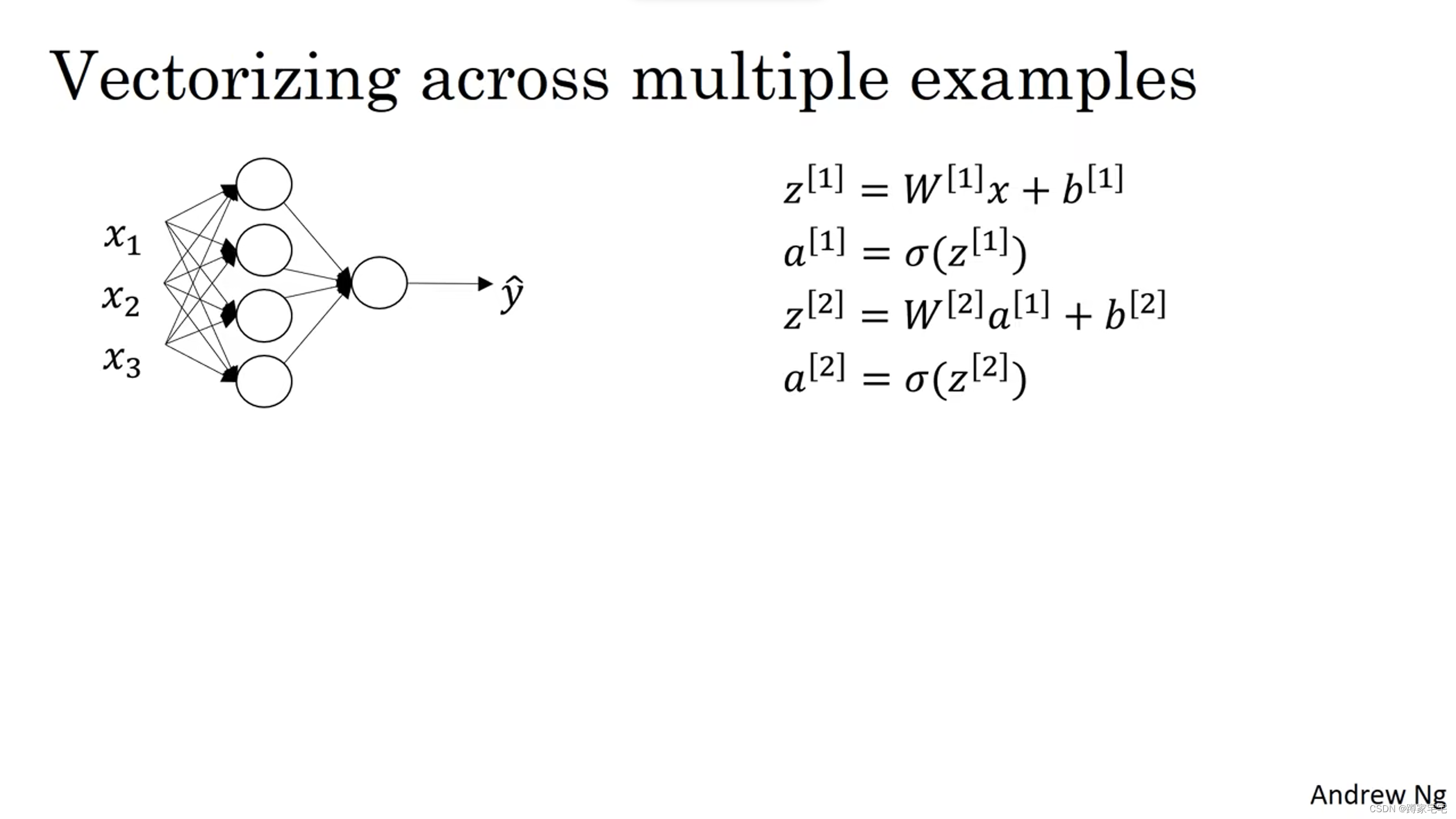

對于每一層的每個節點,以logistic為例,每個節點會得出一個a值(y的預測值)

然后這個a值作為新的輸入值進入下一層的節點,重復上一個過程

最終輸出最終預測值

所以,每個節點都包含一個完整的logistic計算

如下圖所示,第一層的a值代入到第二層的計算中

符號表示

從神經網絡開始,出現了大量的符號,本弱雞剛開始學也有點糊涂,經過好一番思考,才明白了每個符號的表示

層的表示

從輸入層開始,每一層都需要被表示,一般用方括號上標表示第幾層,注意,輸入層為第0層

?

這個符號表示第i層的x值

樣本表示

對于多份樣本數據,一般用圓括號上標表示第幾份樣本數據

這個表示第i份樣本數據,注意,每份樣本數據包含了所有的特征變量(它的表示見下)

每份樣本中特征變量的表示

上面說了每份樣本數據包含了所有特征變量,特征變量如何表示

一般用下標表示第幾個特征變量

這個表示某層第i個特征變量,nx為特征變量的總數

完整表示

這個表示第1層第3份樣本數據中的第2個特征變量

向量化實現神經網絡

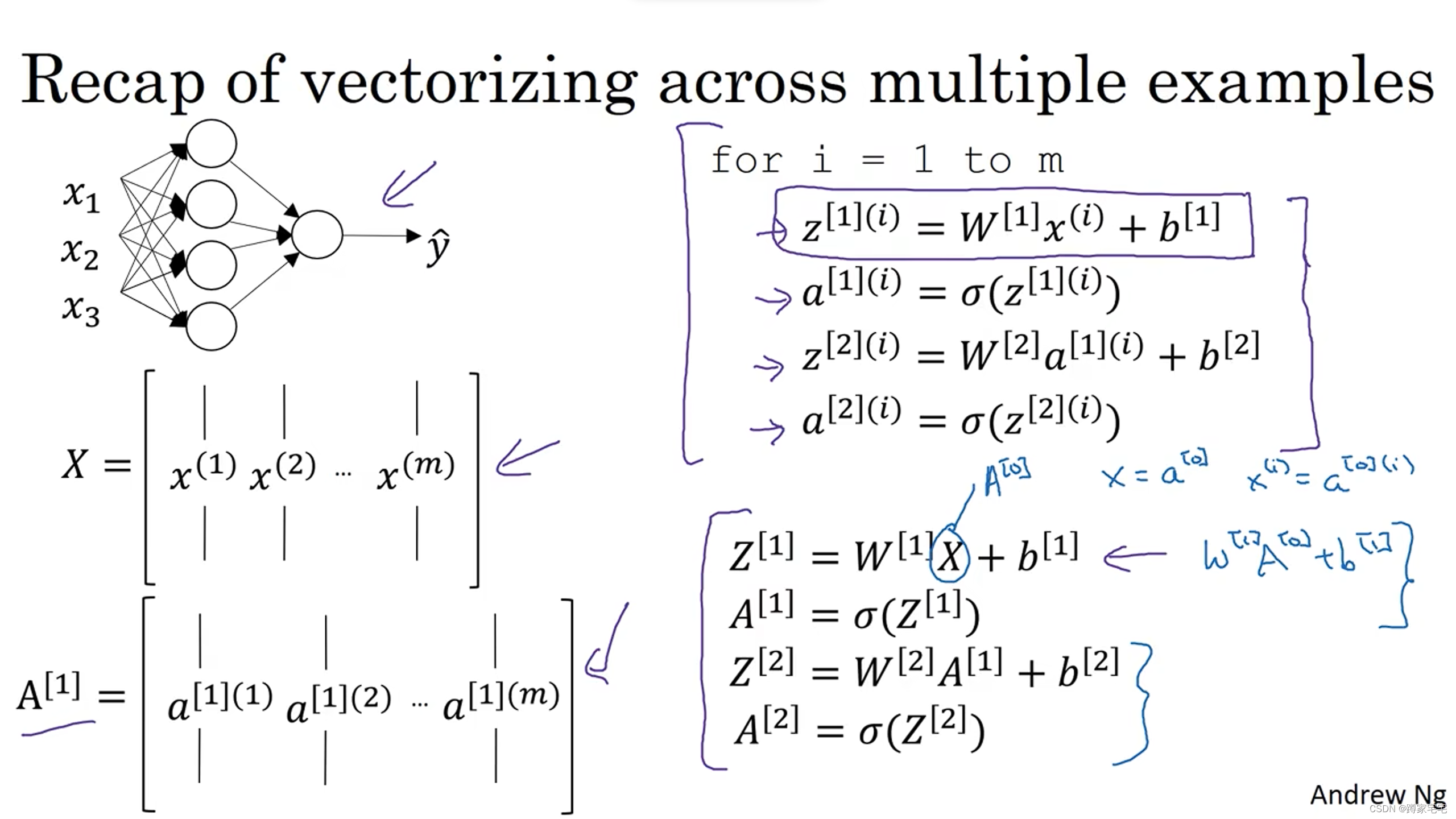

之前談了向量化,現在用完整符號表示神經網絡的向量化實現,見下圖

以X舉例,每個大X表示每層的X數據,大X中每列表示某份樣本數據,自上而下是特征變量

其他符號同理,都是用矩陣實現

)

)

)

)

——目錄與傳送門)

與sorted()排序函數的區別)