文章目錄

- 0 前言

- 1 背景

- 2 算法原理

- 2.1 動物識別方法概況

- 2.2 常用的網絡模型

- 2.2.1 B-CNN

- 2.2.2 SSD

- 3 SSD動物目標檢測流程

- 4 實現效果

- 5 部分相關代碼

- 5.1 數據預處理

- 5.2 構建卷積神經網絡

- 5.3 tensorflow計算圖可視化

- 5.4 網絡模型訓練

- 5.5 對貓狗圖像進行2分類

- 6 最后

0 前言

🔥 優質競賽項目系列,今天要分享的是

🚩 深度學習動物識別 - 卷積神經網絡 機器視覺 圖像識別

該項目較為新穎,適合作為競賽課題方向,學長非常推薦!

🥇學長這里給一個題目綜合評分(每項滿分5分)

- 難度系數:3分

- 工作量:3分

- 創新點:4分

🧿 更多資料, 項目分享:

https://gitee.com/dancheng-senior/postgraduate

1 背景

目前,由于計算機能力和相關理論的發展獲得了重大突破,基于深度學習的圖像檢測與識別技術已經廣泛應用到人們的生產生活中。學長將深度學習的技術應用到野生動物圖像識別中,優化了傳統的識別方法,形成對野生動物圖像更為準確的識別,為實現高效的野生動物圖像識別提供了可能。不同于傳統的野生動物識別,基于深度學習的野生動物識別技術可以捕獲到野生動物更加細致的信息,有利于對野生動物進行更加準確的識別和研究。因此,對基于深度學習的野生動物識別和研究,可以更好的幫助社會管理者和政府全面有效的對野生動物進行保護和監管,這也正是保護和識別野生動物的關鍵,同時這對整個自然和社會的和諧發展具有極大的推動作用。

2 算法原理

2.1 動物識別方法概況

基于人工特征的野生動物識別方法主要通過人工對野生動物圖像中具有辨識度的特征信息進行提取,并通過特征比對的方式就可以對野生動物所屬的類別進行識別判斷。

在深度學習技術普及之前,傳統的數字圖像處理技術與傳統機器學習技術一直是研究的熱點。傳統的數字圖像處理技術有模塊分割、降低噪聲點、邊緣檢測等方法。傳統的機器學習技術有支持向量機、隨機森林算法、BP

神經網絡算法等。

深度學習技術是通過計算機模擬人類大腦的分層表達結構來建立網絡模型,從原始數據集中對相關信息逐層提取。之后通過建立相應的神經網絡對數據進行學習和分析,從而提高對目標預測和識別的準確率。如今,深度學習技術已經相對成熟,在對目標進行特征提取方面,卷積神經網絡技術逐漸取代了傳統的圖像處理技術,并且在人類的生產生活中得到了廣泛應用,這為研究野生動物更高效的識別方法奠定了基礎。

2.2 常用的網絡模型

圖像識別是指對原始圖像進行整體分析來達到預測原始圖像所屬類別的技術。計算機視覺領域中對圖像識別技術進行了優化,與此同時,深度學習技術也對圖像識別領域展開了突破。目前在圖像識別領域中,研究人員開始使用深度學習的技術,并通過在實際應用中發現,基于深度學習的識別技術比傳統的識別技術效果更好,且更具有優勢。

2.2.1 B-CNN

雙線性卷積神經網絡(Bilinear

CNN,B-CNN)[34]是用兩個卷積神經網絡對圖像進行特征提取,然后使用相應的函數將得到所有特征進行組合,組合的數據帶入到分類器中進行分類。

2.2.2 SSD

經典的 SSD 模型是由經典網絡和特征提取網絡組成。

通過引入性能更好的特征提取網絡對 SSD

目標檢測模型進行了優化。Fu[49]等人提出了增加卷積神經網絡層數和深度的方法用于提高識別準確率。通過實際應用之后,發現該方法識別準確率確實得到了一定程度的提高,但是模型結構卻越來越復雜,同時對深層次的網絡訓練也越來越困難。

3 SSD動物目標檢測流程

學長首先對 DenseNet-169 網絡進行初始化,使用 DenseNet-169 網絡作為目標檢測的前置網絡結構,并運用遷移學習的方法對

DenseNet-169 進行預訓練,并將Snapshot Serengeti數據集下的權重值遷移到野生動物檢測任務中,使數據集的訓練速度得到提升。將

DenseNet-169 作為前置網絡置于 SSD 中的目標提取檢測網絡之前,更換完前置網絡的 SSD 目標檢測網絡依然完整。

4 實現效果

做一個GUI交互界面

5 部分相關代碼

5.1 數據預處理

?

import cv2 as cv

import os

import numpy as npimport random

import pickleimport timestart_time = time.time()data_dir = './data'

batch_save_path = './batch_files'# 創建batch文件存儲的文件夾

os.makedirs(batch_save_path, exist_ok=True)# 圖片統一大小:100 * 100

# 訓練集 20000:100個batch文件,每個文件200張圖片

# 驗證集 5000:一個測試文件,測試時 50張 x 100 批次# 進入圖片數據的目錄,讀取圖片信息

all_data_files = os.listdir(os.path.join(data_dir, 'train/'))# print(all_data_files)# 打算數據的順序

random.shuffle(all_data_files)all_train_files = all_data_files[:20000]

all_test_files = all_data_files[20000:]train_data = []

train_label = []

train_filenames = []test_data = []

test_label = []

test_filenames = []# 訓練集

for each in all_train_files:img = cv.imread(os.path.join(data_dir,'train/',each),1)resized_img = cv.resize(img, (100,100))img_data = np.array(resized_img)train_data.append(img_data)if 'cat' in each:train_label.append(0)elif 'dog' in each:train_label.append(1)else:raise Exception('%s is wrong train file'%(each))train_filenames.append(each)# 測試集

for each in all_test_files:img = cv.imread(os.path.join(data_dir,'train/',each), 1)resized_img = cv.resize(img, (100,100))img_data = np.array(resized_img)test_data.append(img_data)if 'cat' in each:test_label.append(0)elif 'dog' in each:test_label.append(1)else:raise Exception('%s is wrong test file'%(each))test_filenames.append(each)print(len(train_data), len(test_data))# 制作100個batch文件

start = 0

end = 200

for num in range(1, 101):batch_data = train_data[start: end]batch_label = train_label[start: end]batch_filenames = train_filenames[start: end]batch_name = 'training batch {} of 15'.format(num)all_data = {'data':batch_data,'label':batch_label,'filenames':batch_filenames,'name':batch_name}with open(os.path.join(batch_save_path, 'train_batch_{}'.format(num)), 'wb') as f:pickle.dump(all_data, f)start += 200end += 200# 制作測試文件

all_test_data = {'data':test_data,'label':test_label,'filenames':test_filenames,'name':'test batch 1 of 1'}with open(os.path.join(batch_save_path, 'test_batch'), 'wb') as f:pickle.dump(all_test_data, f)end_time = time.time()

print('制作結束, 用時{}秒'.format(end_time - start_time))

5.2 構建卷積神經網絡

cnn卷積神經網絡的編寫如下,編寫卷積層、池化層和全連接層的代碼

?

conv1_1 = tf.layers.conv2d(x, 16, (3, 3), padding='same', activation=tf.nn.relu, name='conv1_1')

conv1_2 = tf.layers.conv2d(conv1_1, 16, (3, 3), padding='same', activation=tf.nn.relu, name='conv1_2')

pool1 = tf.layers.max_pooling2d(conv1_2, (2, 2), (2, 2), name='pool1')

conv2_1 = tf.layers.conv2d(pool1, 32, (3, 3), padding='same', activation=tf.nn.relu, name='conv2_1')

conv2_2 = tf.layers.conv2d(conv2_1, 32, (3, 3), padding='same', activation=tf.nn.relu, name='conv2_2')

pool2 = tf.layers.max_pooling2d(conv2_2, (2, 2), (2, 2), name='pool2')

conv3_1 = tf.layers.conv2d(pool2, 64, (3, 3), padding='same', activation=tf.nn.relu, name='conv3_1')

conv3_2 = tf.layers.conv2d(conv3_1, 64, (3, 3), padding='same', activation=tf.nn.relu, name='conv3_2')

pool3 = tf.layers.max_pooling2d(conv3_2, (2, 2), (2, 2), name='pool3')

conv4_1 = tf.layers.conv2d(pool3, 128, (3, 3), padding='same', activation=tf.nn.relu, name='conv4_1')

conv4_2 = tf.layers.conv2d(conv4_1, 128, (3, 3), padding='same', activation=tf.nn.relu, name='conv4_2')

pool4 = tf.layers.max_pooling2d(conv4_2, (2, 2), (2, 2), name='pool4')flatten = tf.layers.flatten(pool4)

fc1 = tf.layers.dense(flatten, 512, tf.nn.relu)

fc1_dropout = tf.nn.dropout(fc1, keep_prob=keep_prob)

fc2 = tf.layers.dense(fc1, 256, tf.nn.relu)

fc2_dropout = tf.nn.dropout(fc2, keep_prob=keep_prob)

fc3 = tf.layers.dense(fc2, 2, None)

5.3 tensorflow計算圖可視化

?

self.x = tf.placeholder(tf.float32, [None, IMAGE_SIZE, IMAGE_SIZE, 3], 'input_data')

self.y = tf.placeholder(tf.int64, [None], 'output_data')

self.keep_prob = tf.placeholder(tf.float32)# 圖片輸入網絡中

fc = self.conv_net(self.x, self.keep_prob)

self.loss = tf.losses.sparse_softmax_cross_entropy(labels=self.y, logits=fc)

self.y_ = tf.nn.softmax(fc) # 計算每一類的概率

self.predict = tf.argmax(fc, 1)

self.acc = tf.reduce_mean(tf.cast(tf.equal(self.predict, self.y), tf.float32))

self.train_op = tf.train.AdamOptimizer(LEARNING_RATE).minimize(self.loss)

self.saver = tf.train.Saver(max_to_keep=1)

最后的saver是要將訓練好的模型保存到本地。

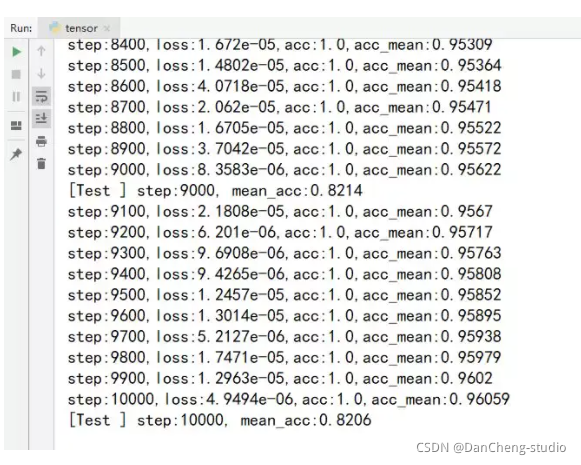

5.4 網絡模型訓練

然后編寫訓練部分的代碼,訓練步驟為1萬步

?

acc_list = []

with tf.Session() as sess:sess.run(tf.global_variables_initializer())for i in range(TRAIN_STEP):train_data, train_label, _ = self.batch_train_data.next_batch(TRAIN_SIZE)eval_ops = [self.loss, self.acc, self.train_op]eval_ops_results = sess.run(eval_ops, feed_dict={self.x:train_data,self.y:train_label,self.keep_prob:0.7})loss_val, train_acc = eval_ops_results[0:2]acc_list.append(train_acc)if (i+1) % 100 == 0:acc_mean = np.mean(acc_list)print('step:{0},loss:{1:.5},acc:{2:.5},acc_mean:{3:.5}'.format(i+1,loss_val,train_acc,acc_mean))if (i+1) % 1000 == 0:test_acc_list = []for j in range(TEST_STEP):test_data, test_label, _ = self.batch_test_data.next_batch(TRAIN_SIZE)acc_val = sess.run([self.acc],feed_dict={self.x:test_data,self.y:test_label,self.keep_prob:1.0})test_acc_list.append(acc_val)print('[Test ] step:{0}, mean_acc:{1:.5}'.format(i+1, np.mean(test_acc_list)))# 保存訓練后的模型os.makedirs(SAVE_PATH, exist_ok=True)self.saver.save(sess, SAVE_PATH + 'my_model.ckpt')

訓練結果如下:

5.5 對貓狗圖像進行2分類

6 最后

🧿 更多資料, 項目分享:

https://gitee.com/dancheng-senior/postgraduate

)