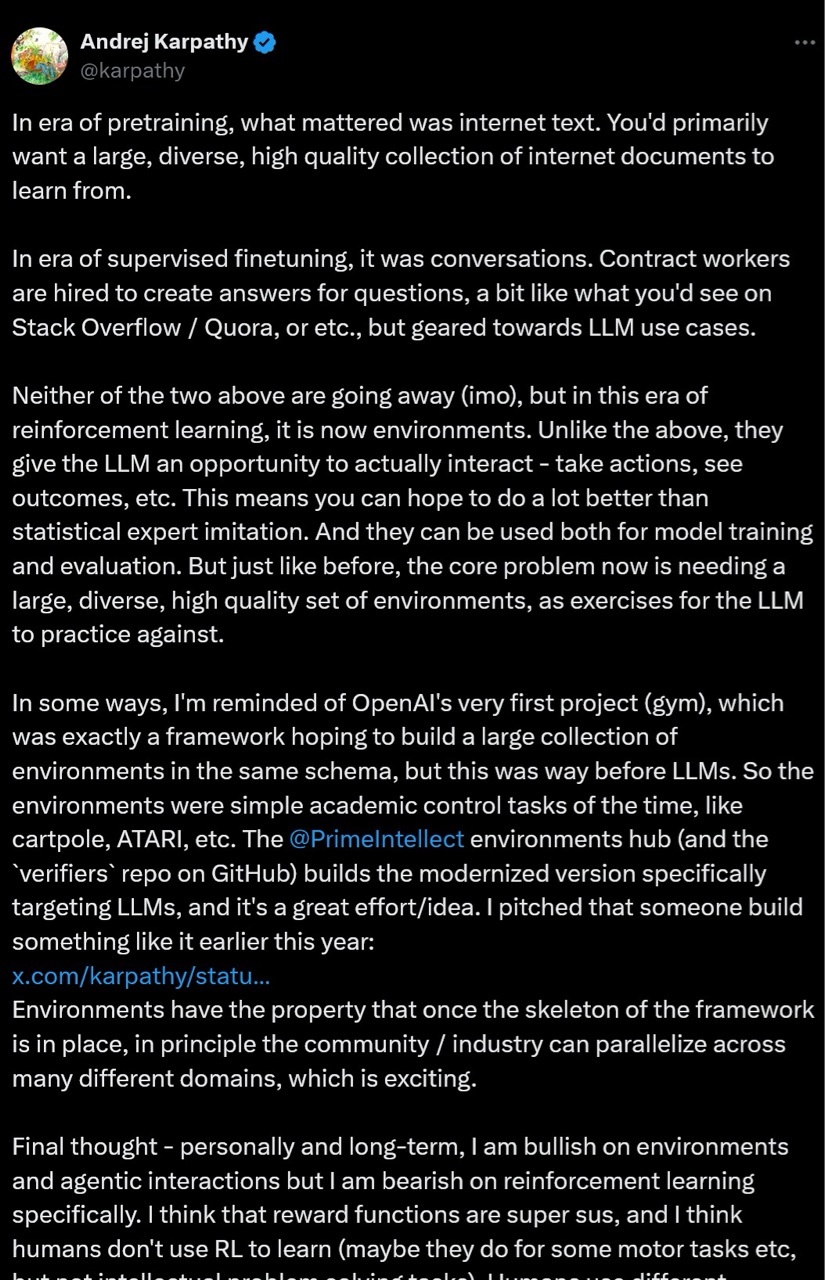

在預訓練時代,關鍵在于互聯網文本。你最需要的是一大批量、多樣化且高質量的互聯網文檔,供模型從中學習。

在監督微調(SFT)時代,核心則是對話數據。人們雇傭合同工人為問題撰寫答案,類似于你在 Stack Overflow 或 Quora 上看到的內容,但專門針對大語言模型(LLM)的應用場景進行優化。

我認為以上兩個階段都不會消失,但在當前的強化學習時代,關鍵要素變成了“環境”(environments)。與前兩者不同,環境能讓大語言模型真正地進行交互——采取行動、觀察結果等。這意味著我們有望超越簡單的“統計專家行為模仿”,實現更深層次的學習。這些環境既可用于模型訓練,也可用于模型評估。但和之前類似,現在核心的挑戰在于:我們需要大量、多樣化且高質量的環境,作為 LLM 練習的“習題集”。

從某種意義上說,這讓我想起了 OpenAI 最早的項目——Gym。那正是一個旨在構建大量統一格式環境的框架,只不過當時遠早于大語言模型的興起,因此那些環境大多是當時簡單的學術控制任務,比如倒立擺(cartpole)、ATARI 游戲等。而 PrimeIntellect 的“環境中心”(environments hub),以及其 GitHub 上的 verifiers 倉庫,則構建了一個面向現代 LLM 的升級版框架,這是一個非常出色的嘗試和構想。今年早些時候,我也曾提議有人來構建類似的東西。

環境的一個重要特性是:一旦框架的基本結構搭建完成,原則上社區和產業界就可以在不同領域并行開發,這令人非常振奮。

最后一點思考——就個人而言,從長期來看,我非常看好“環境”以及“具身智能體式交互”(agentic interactions)的發展前景,但我對“強化學習”(reinforcement learning, RL)本身持謹慎態度(看跌)。

我認為獎勵函數(reward functions)存在嚴重問題,而且我相信人類在學習時并不主要依賴強化學習(也許在某些運動控制類任務中會用到,但在智力型問題解決中并非如此)。人類使用的是更強大、更高效的其他學習范式,而這些范式尚未被充分發明或規模化應用。

不過,目前已有一些初步的設想和雛形(例如,“系統提示學習”這一概念,即把模型更新從權重調整轉移到提示詞/上下文本身,之后可選擇性地將知識“蒸餾”回權重中——這個過程有點像睡眠對大腦的作用)。

?

(健康生活是coder抒寫優質代碼的前提條件——《黃帝內經》伴讀學習紀要))

:配置項全景解析——打造你的專屬優化清單)

使用 vConsole調試console)

)