華為云Flexus+DeepSeek征文| 基于Dify-LLM平臺應用實踐:創建智能知識庫問答助手

- 前言

- 一、相關名詞介紹

- 1.1 華為云Flexus X實例介紹

- 1.2 華為云ModelArts Studio介紹

- 二、本次實踐介紹

- 2.1 本次實踐環境介紹

- 2.2 Dify平臺介紹

- 三、搭建Dify-LLM開發平臺

- 3.1 進入部署詳情頁

- 3.2 選擇部署方式

- 3.3 創建資源棧流程

- 3.4 開始部署Dify

- 3.5 查看部署結果

- 四、 訪問Dify-LLM應用開發平臺

- 4.1 訪問Dify初始頁

- 4.2 訪問Dify平臺首頁

- 五、Dify-LLM開發平臺的基本使用

- 5.1 開通ModelArts Studio商用服務

- 5.2 創建API key

- 5.3 Dify平臺對接MaaS服務

- 5.4 創建知識庫

- 5.5 知識庫配置工作

- 5.6 創建聊天助手

- 5.7 對話測試

- 六、華為云Flexus X實例的資源使用情況

- 七、快速清空資源

- 八、總結

前言

隨著人工智能技術的快速發展,構建高效、智能的知識服務系統已成為企業提升競爭力的重要手段。華為云Flexus X實例憑借其卓越的性能和靈活的擴展能力,為AI應用提供了強大支撐。本次實踐基于Dify-LLM平臺,結合DeepSeek大模型,探索智能知識庫問答助手的構建路徑。旨在通過華為云領先的技術能力,實現知識內容的快速接入與智能化處理,為企業提供更高效、精準的問答服務體驗。

一、相關名詞介紹

1.1 華為云Flexus X實例介紹

華為云Flexus云服務器X實例是新一代面向中小企業和開發者的柔性算力云服務器。它能夠智能感知業務負載的變化,自動調整資源配置。這款服務器特別適用于中低負載的應用場景,例如電商直播、企業網站建設、開發測試環境、游戲服務器以及音視頻服務等。X實例的設計理念旨在為用戶提供更加靈活和高效的計算資源管理方式。通過智能調整,它可以更好地滿足不同業務的需求,提高資源利用率。

1.2 華為云ModelArts Studio介紹

ModelArts Studio是華為云提供的一個大模型即服務平臺(MaaS服務),旨在簡化模型開發流程,支持定制化大模型的開發,并使這些模型能夠無縫集成到業務系統中。通過降低企業AI應用的成本和難度,ModelArts Studio助力企業快速實現AI技術落地。

二、本次實踐介紹

2.1 本次實踐環境介紹

| 云廠商 | 實踐目標 | 云服務器類型 | 部署方式 | 主要資源清單 |

|---|---|---|---|---|

| 華為云 | 快速搭建 Dify-LLM 應用開發平臺 | Flexus 云服務器 X 實例 | 單機一鍵部署(本地部署) | Flexus X 實例、彈性 IP(EIP)、安全組、VPC、Dify-LLM 應用開發平臺 |

2.2 Dify平臺介紹

🌐 Dify 簡介

💡 Dify 是一個面向開發者的 AI 應用開發平臺,提供完整的工具鏈與框架,幫助用戶快速構建、部署和管理基于大型語言模型(LLM)的應用程序。 其核心目標是降低 AI 應用開發門檻,支持從原型設計到生產環境的全流程,適用于 AI 助手、智能客服、內容生成等多種場景。

?? 核心特性

-

- 🧱 低代碼開發

提供可視化編排界面,開發者可通過拖拽方式設計 AI 工作流,無需深入編碼即可實現復雜邏輯,提升開發效率。

- 🧱 低代碼開發

-

- 🔄 多模型支持

兼容主流 LLM(如 GPT、Claude、通義千問等),允許靈活切換模型或結合多個模型的能力,滿足不同業務需求。

- 🔄 多模型支持

-

- 📁 數據管理

內置數據集管理功能,支持上傳、標注數據,并用于模型微調或上下文增強,打造更專業、定制化的 AI 應用。

- 📁 數據管理

-

- 🔌 API 集成

開放標準化 API 接口,方便將 AI 能力嵌入現有系統或第三方應用,實現無縫對接與擴展。

- 🔌 API 集成

三、搭建Dify-LLM開發平臺

3.1 進入部署詳情頁

華為云快速搭建Dify-LLM應用開發平臺地址:https://www.huaweicloud.com/solution/implementations/building-a-dify-llm-application-development-platform.html

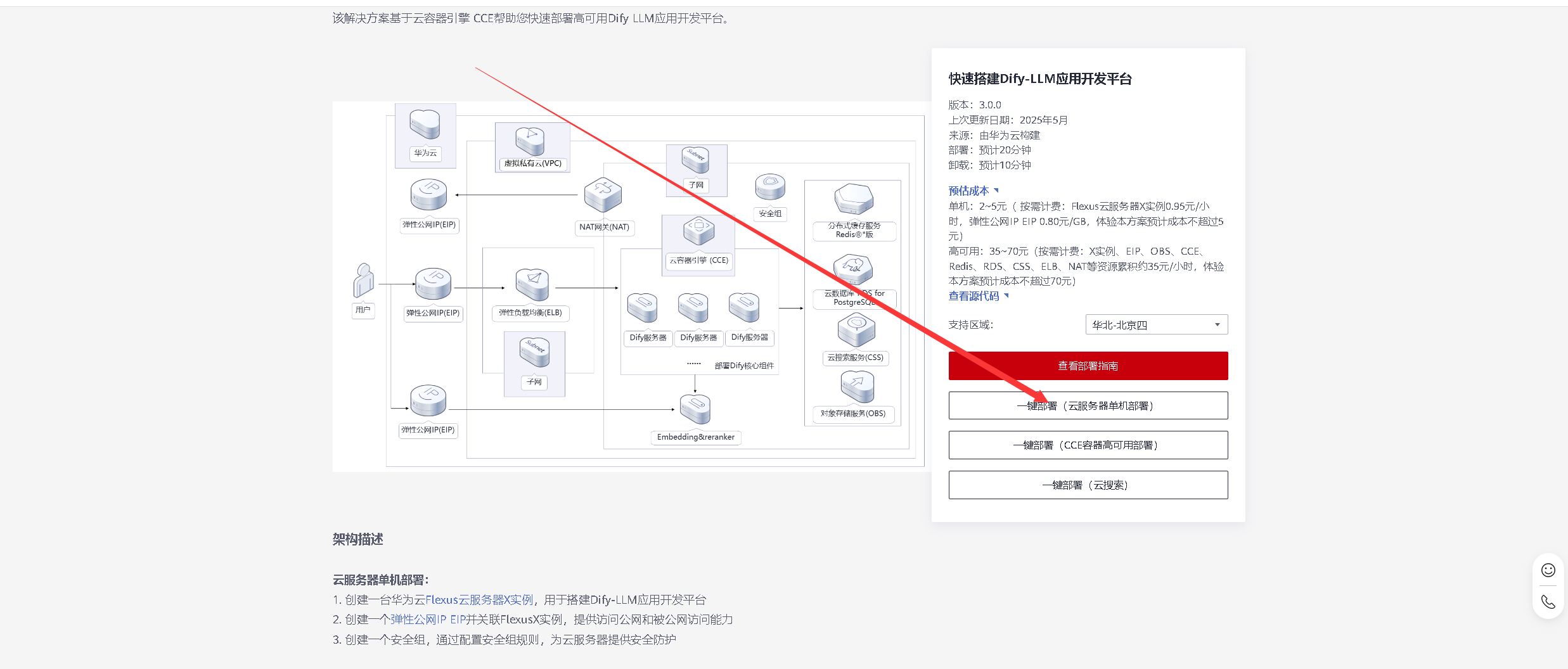

3.2 選擇部署方式

在部署方式中選擇“一鍵部署(云服務器單機部署)”,點擊確認即可開始部署。

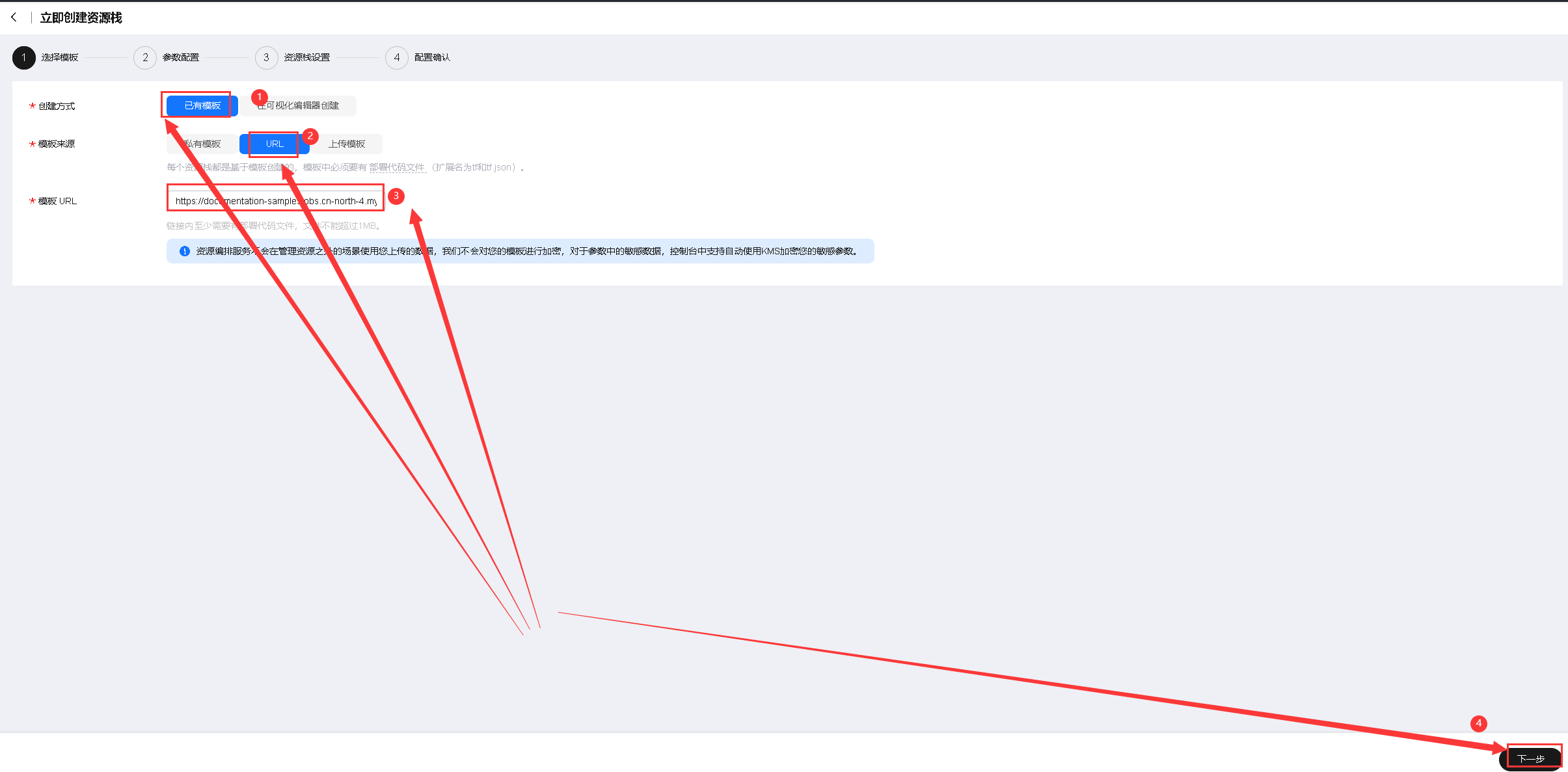

3.3 創建資源棧流程

創建資源棧—選擇模版步驟

在創建資源棧——選擇模版配置中:

創建方式:已有模版;模版來源:URL模版URL:選擇默認提供的地址即可。設置完畢后,選擇下一步。

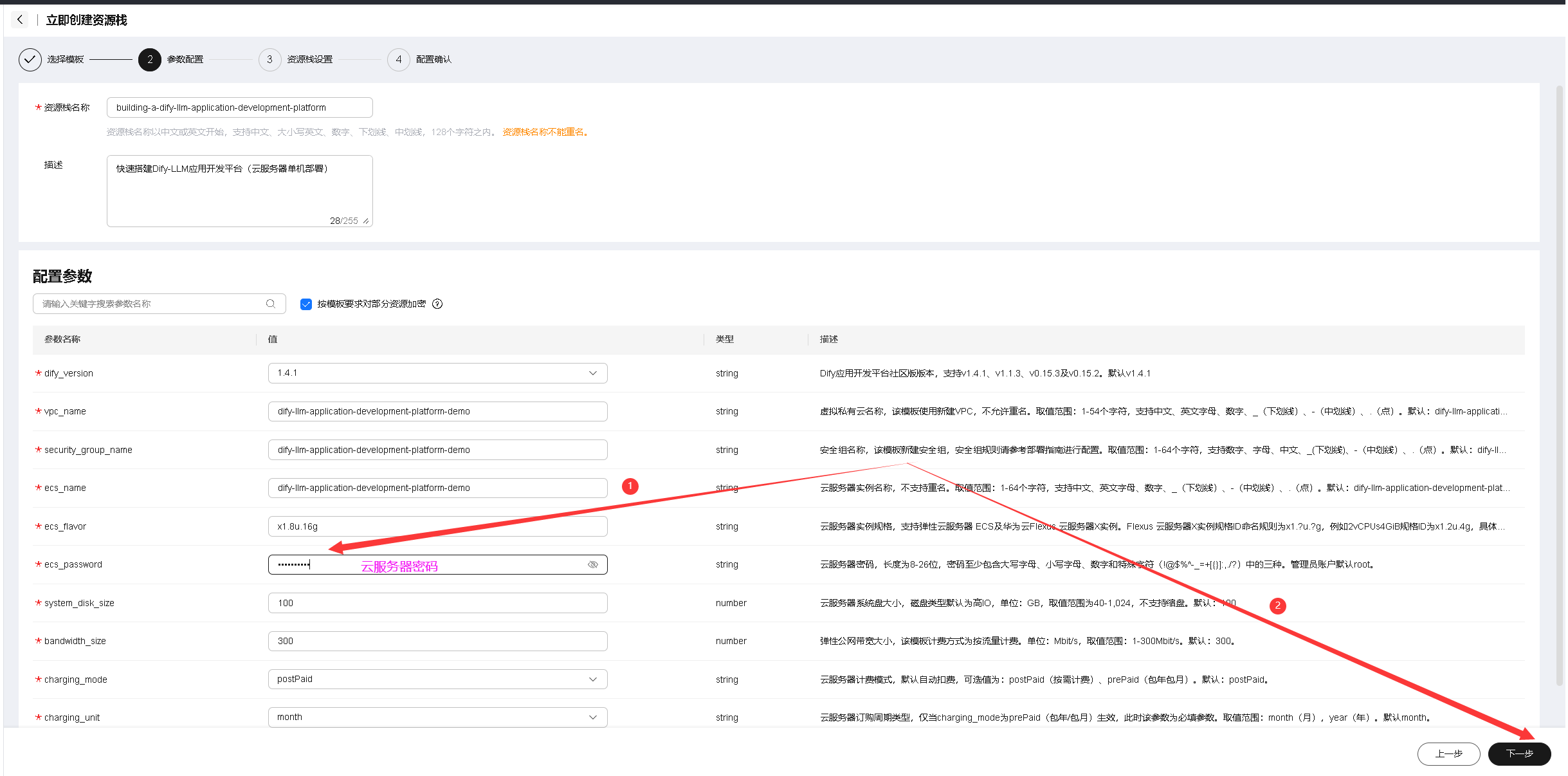

創建資源棧—參數設置工作

填寫以下參數,大部分參數默認即可,可參考下面的參數說明表。注意將

ecs_password的值為華為云 Flexus X 實例的服務器密碼。

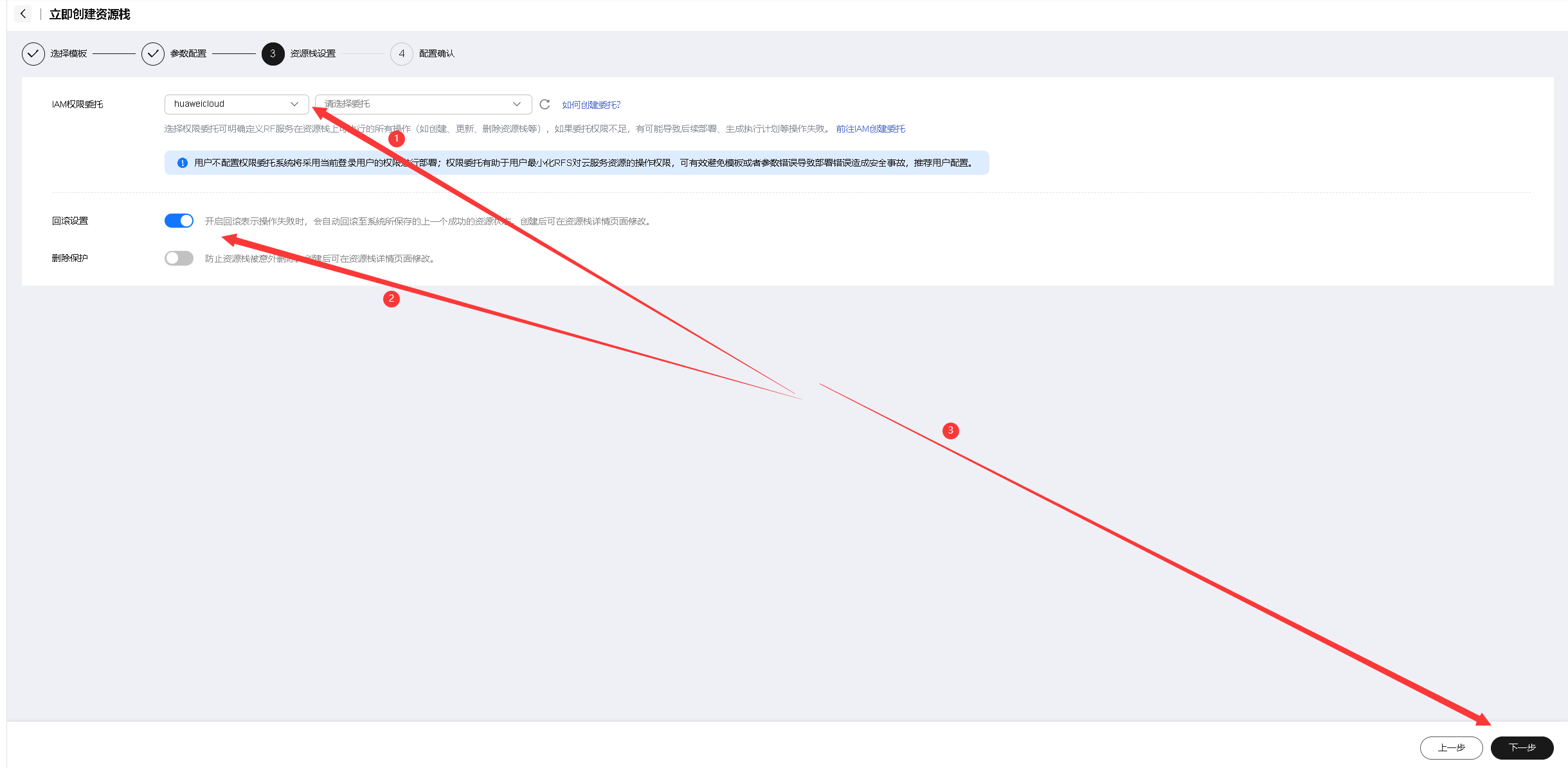

創建資源棧—資源棧設置

-

IAM 權限委托(可選):在資源棧配置中,設置 IAM 委托可明確授予 Resource Stack 服務操作資源棧的權限(如創建、更新、刪除等),權限不足可能導致部署或執行計劃失敗。 若使用華為主賬號或

admin用戶組下的子賬號,可不選委托,系統將默認使用賬號自身權限。 -

回滾設置(建議開啟):開啟回滾后,若部署失敗,系統將自動恢復至上一個成功狀態,保障環境穩定性。

該選項可在創建后于資源棧詳情頁隨時修改,建議本次選擇開啟。 -

刪除防護(測試環境可關閉):刪除防護功能用于防止資源棧被誤刪,保護關鍵資源安全。 由于當前為測試環境,便于后續清理操作,建議選擇不開啟。

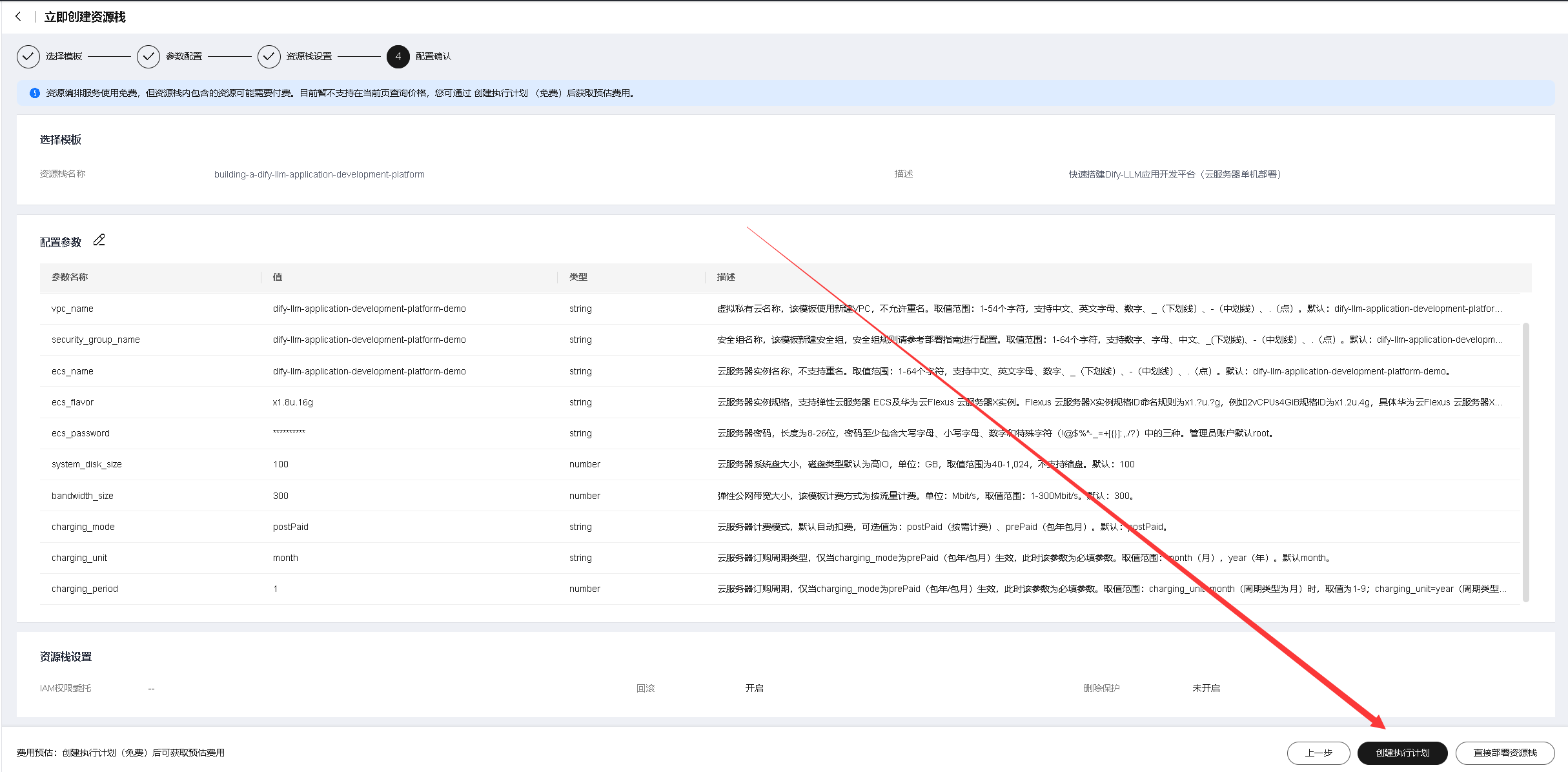

創建資源棧—配置確認

檢查所有配置無誤后,在配置確認界面中,單擊“創建執行計劃”。

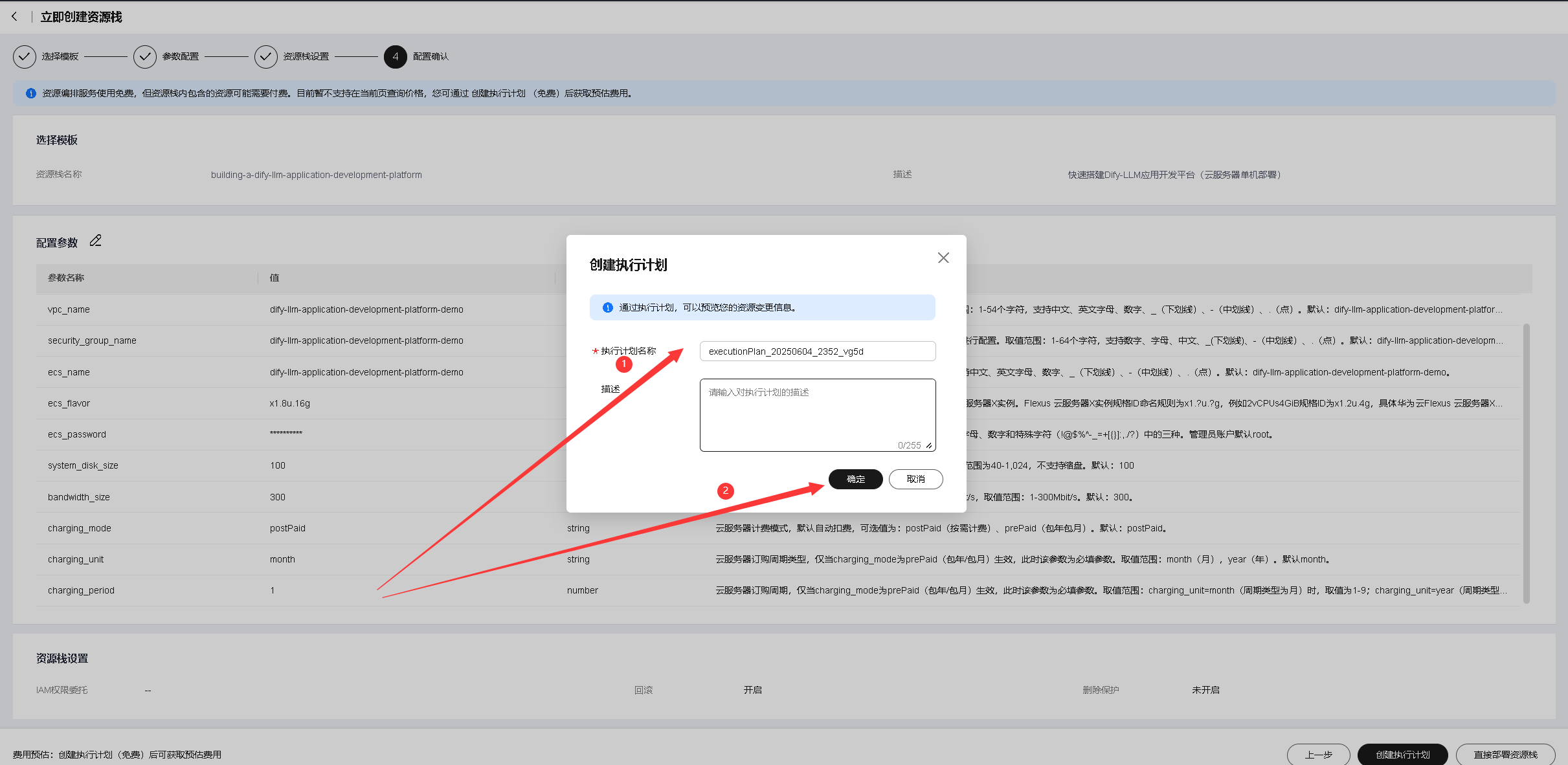

3.4 開始部署Dify

可自行修改執行計劃名稱,這里直接默認名稱,點擊“確認”。

費用預估:在開始部署前,我們在執行計劃中,可以點擊“查看費用明細”,注意保證賬戶余額充足,防止部署失敗。

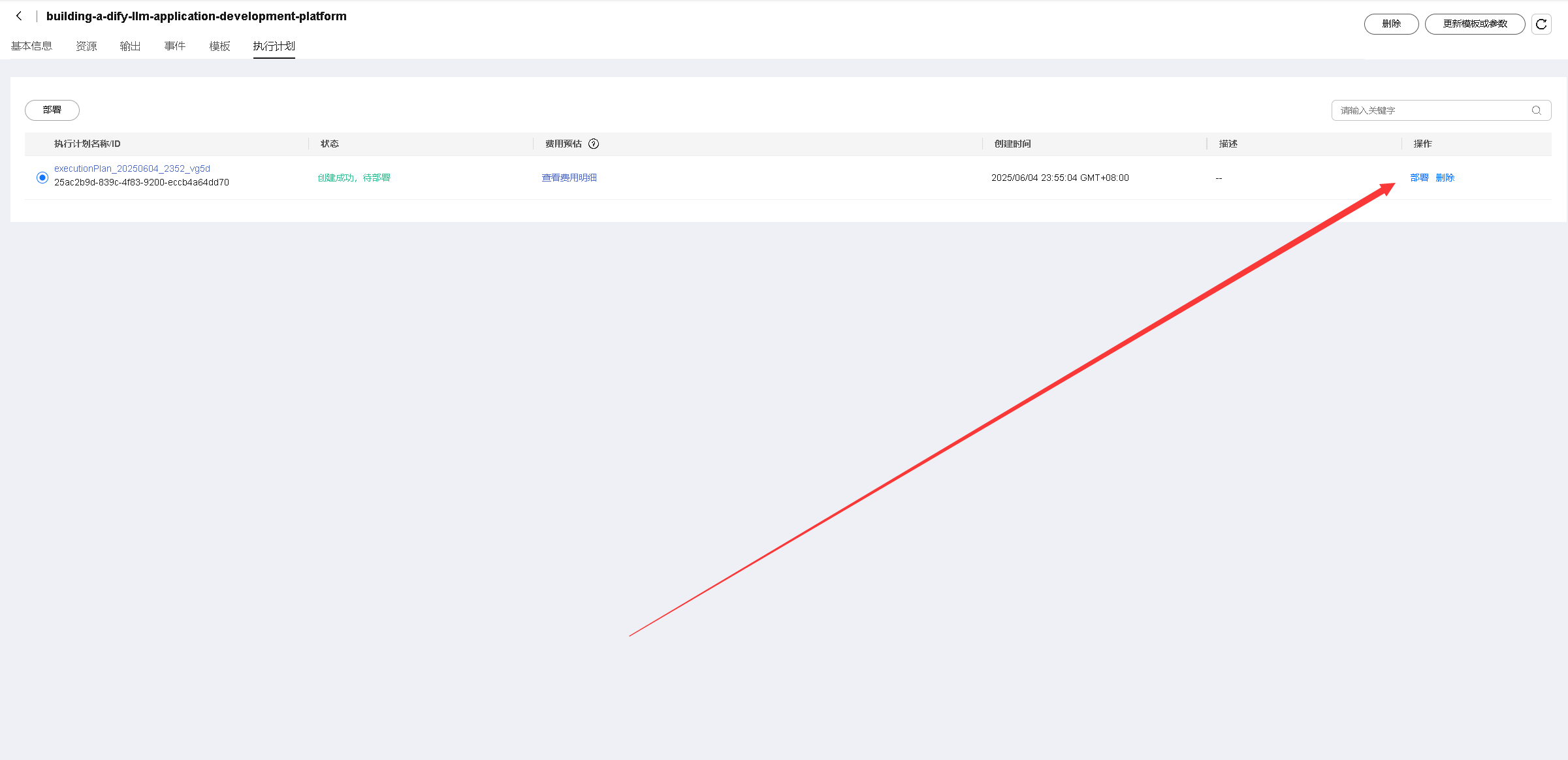

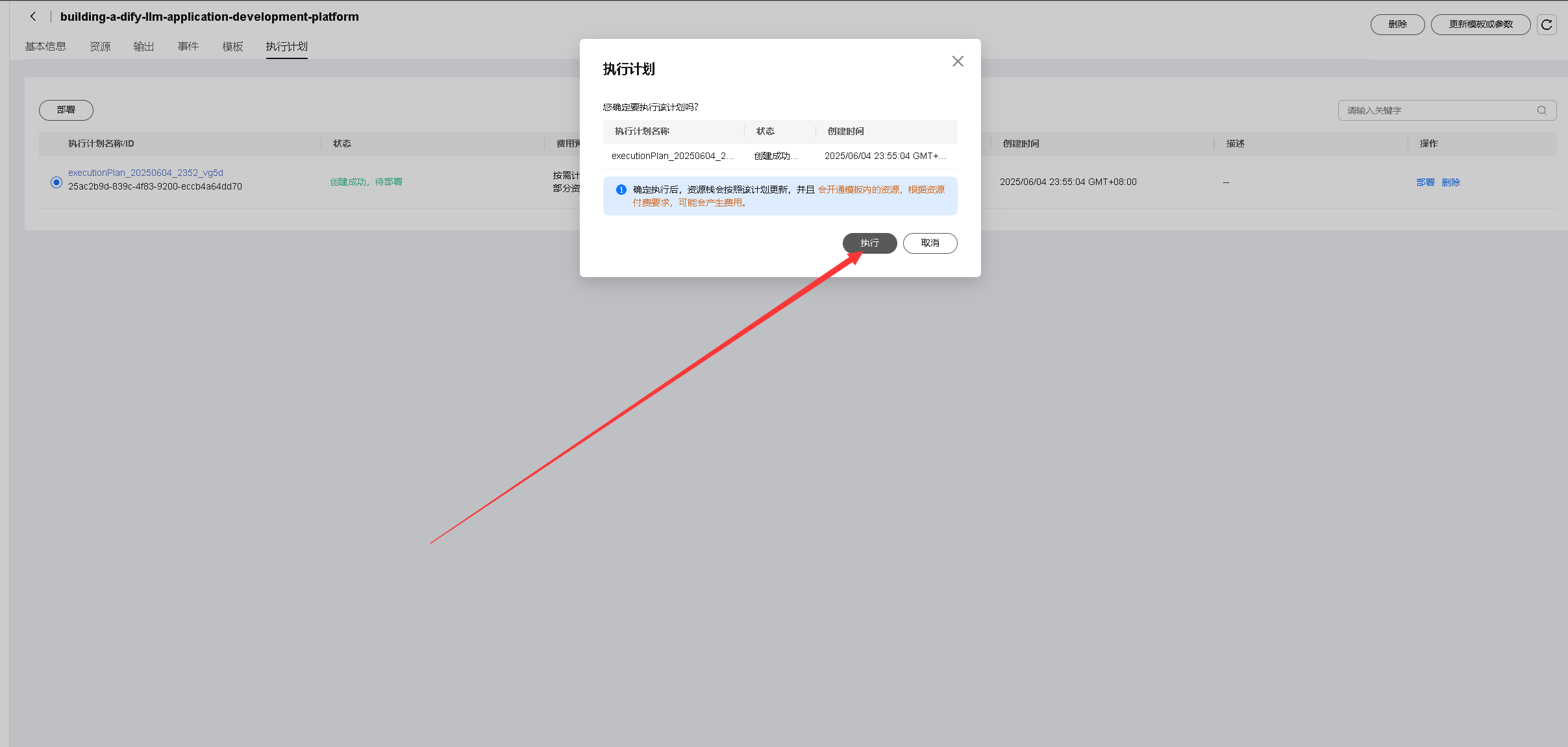

在執行計劃列表中,選擇剛才創建的執行計劃,點擊“部署”。

在彈出窗口中,點擊“執行”,確認開始部署。

3.5 查看部署結果

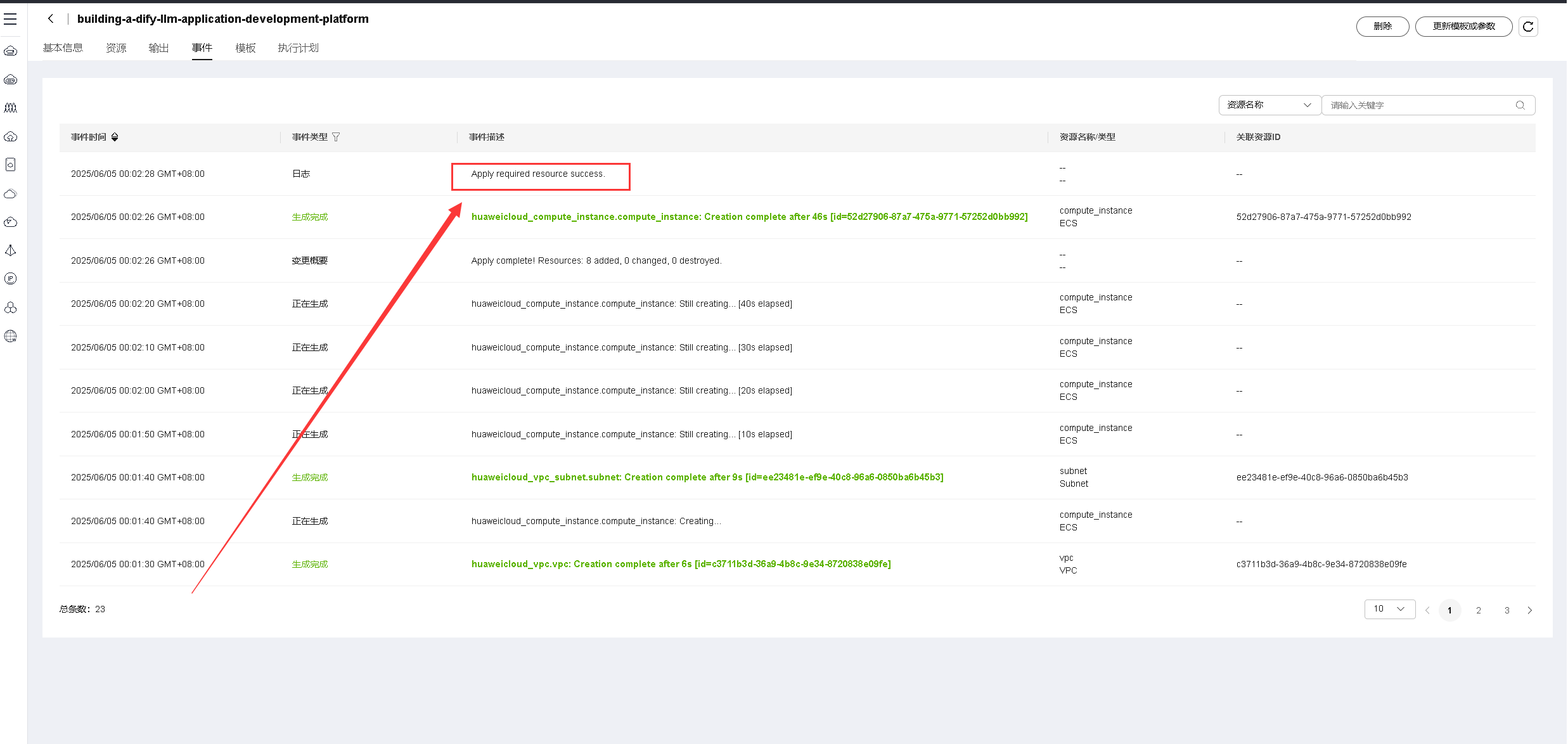

需要等待一段時間進行部署,當在事件描述中,看到“ Apply required resource success. ”提示時候,表示已經部署成功。

四、 訪問Dify-LLM應用開發平臺

4.1 訪問Dify初始頁

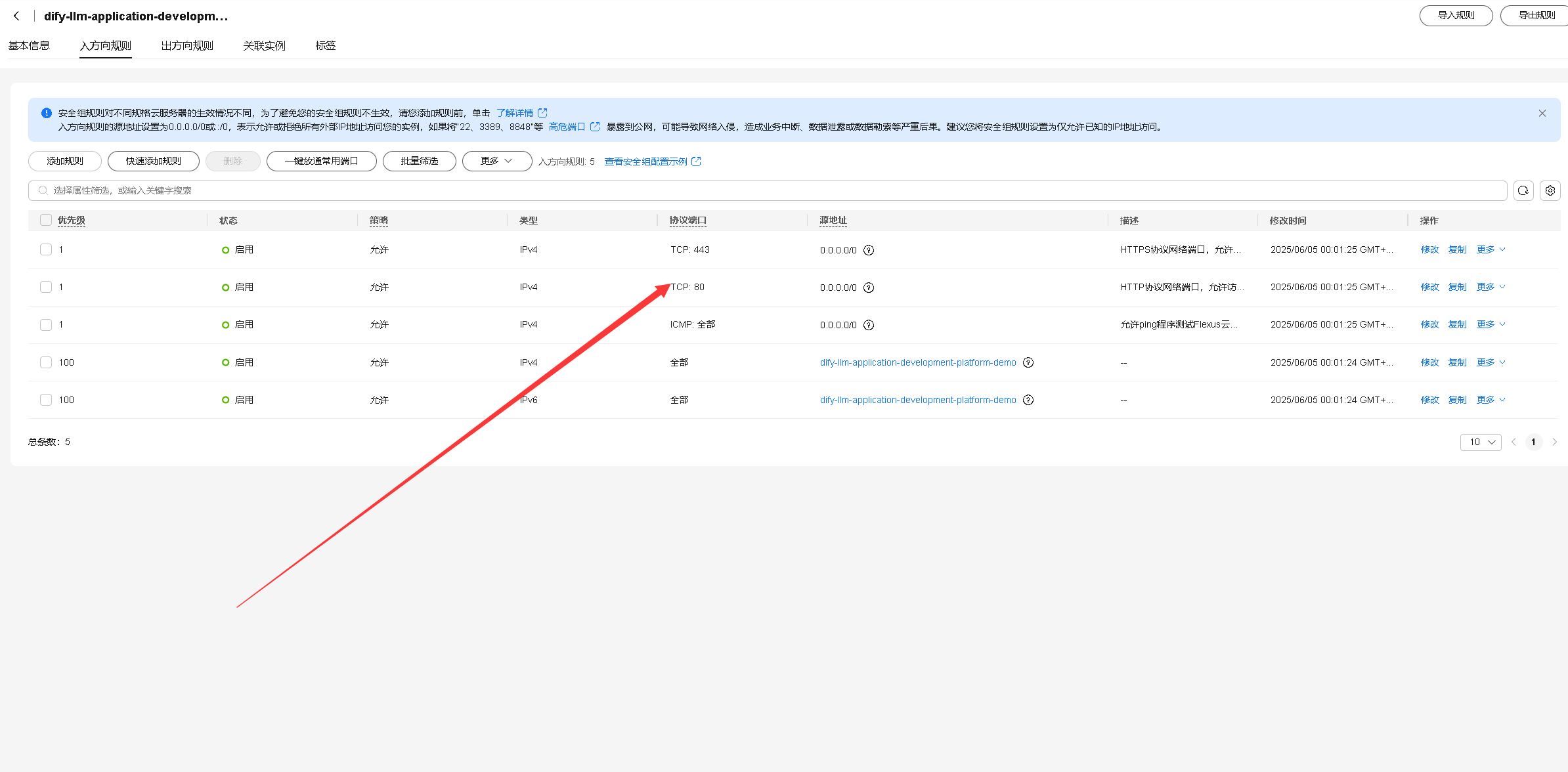

確保華為云Flexus X實例的安全組規則中,入方向上放行80端口,如下所示:

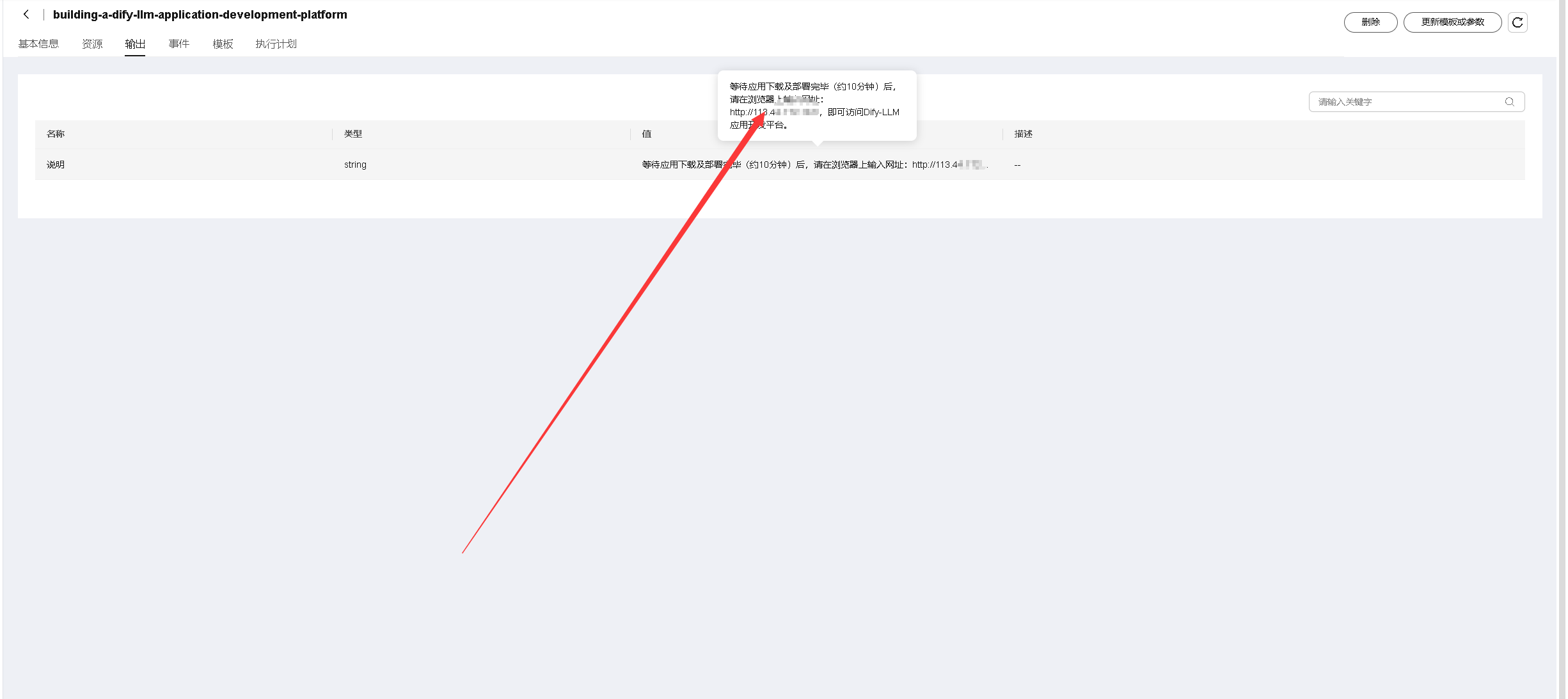

在我們剛才創建的資源棧輸出中,可以看到Dify-LLM應用開發平臺的訪問地址。

在本地瀏覽器打開該網址,可以訪問到Dify平臺初始頁。

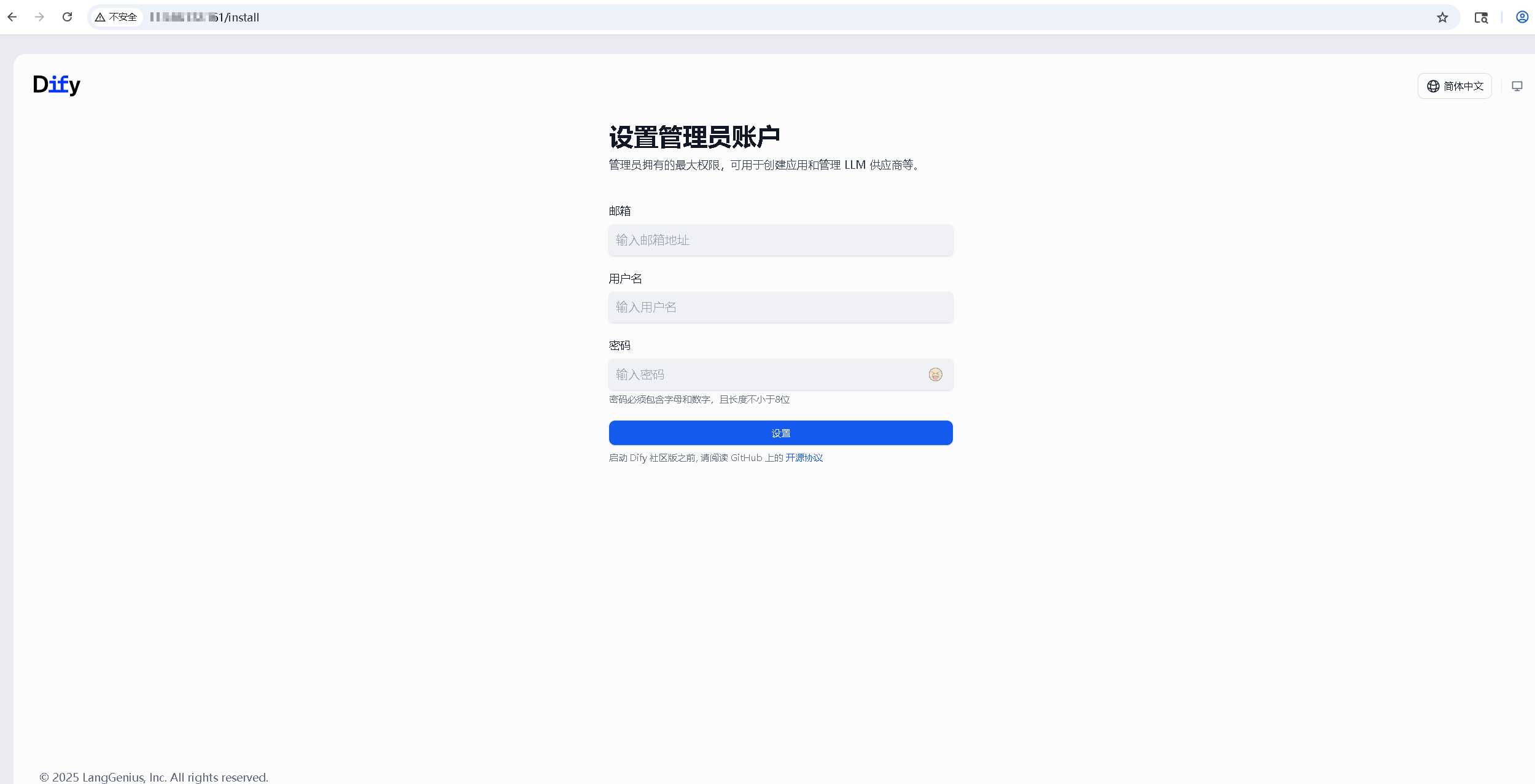

4.2 訪問Dify平臺首頁

在Dify設置管理員賬號頁面上,我們自行設置賬號密碼即可,填寫完畢后,點擊“設置”。

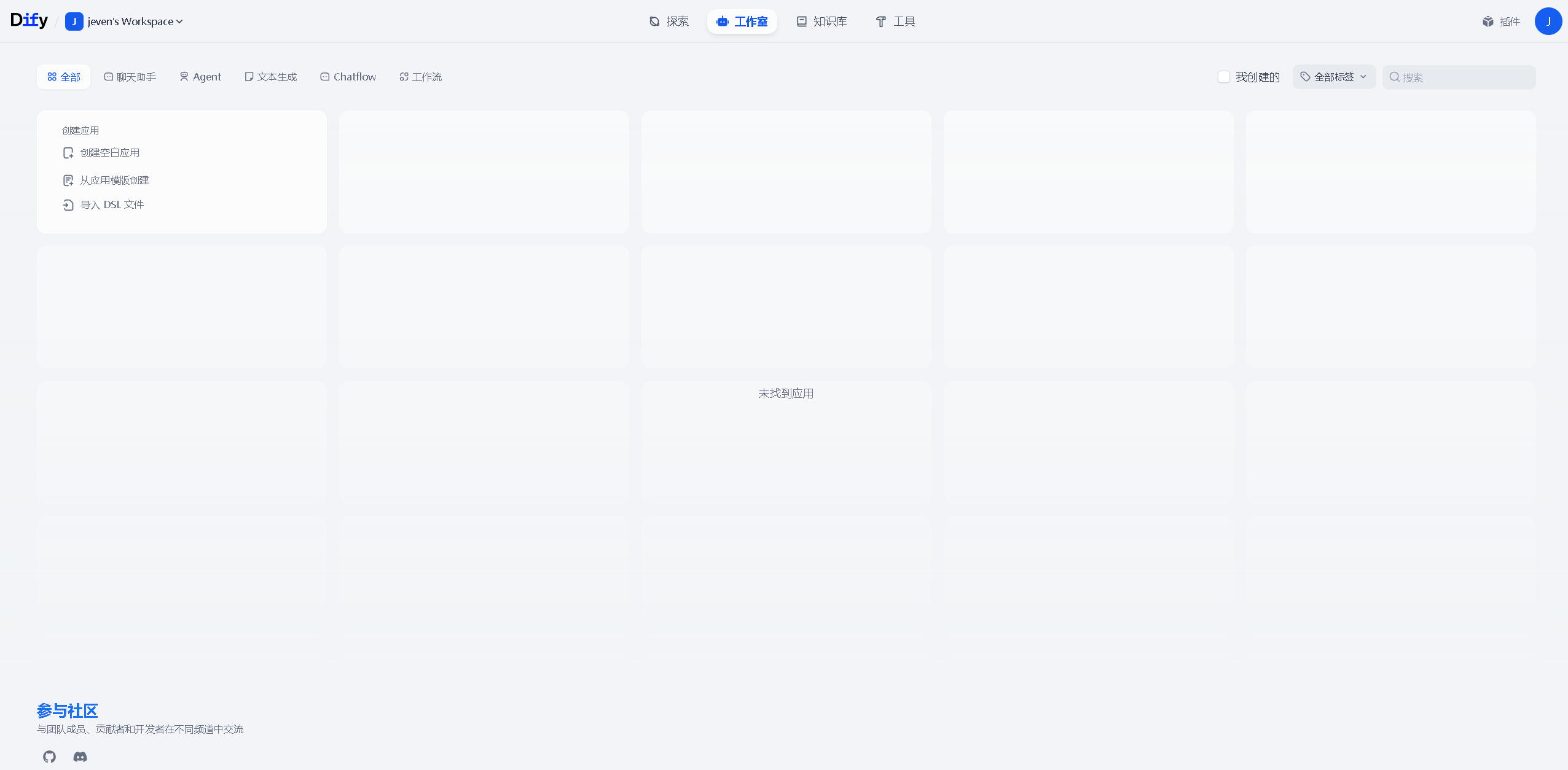

重新登錄Dify平臺,輸入剛才創建的郵箱賬號和密碼,完成登錄。

五、Dify-LLM開發平臺的基本使用

5.1 開通ModelArts Studio商用服務

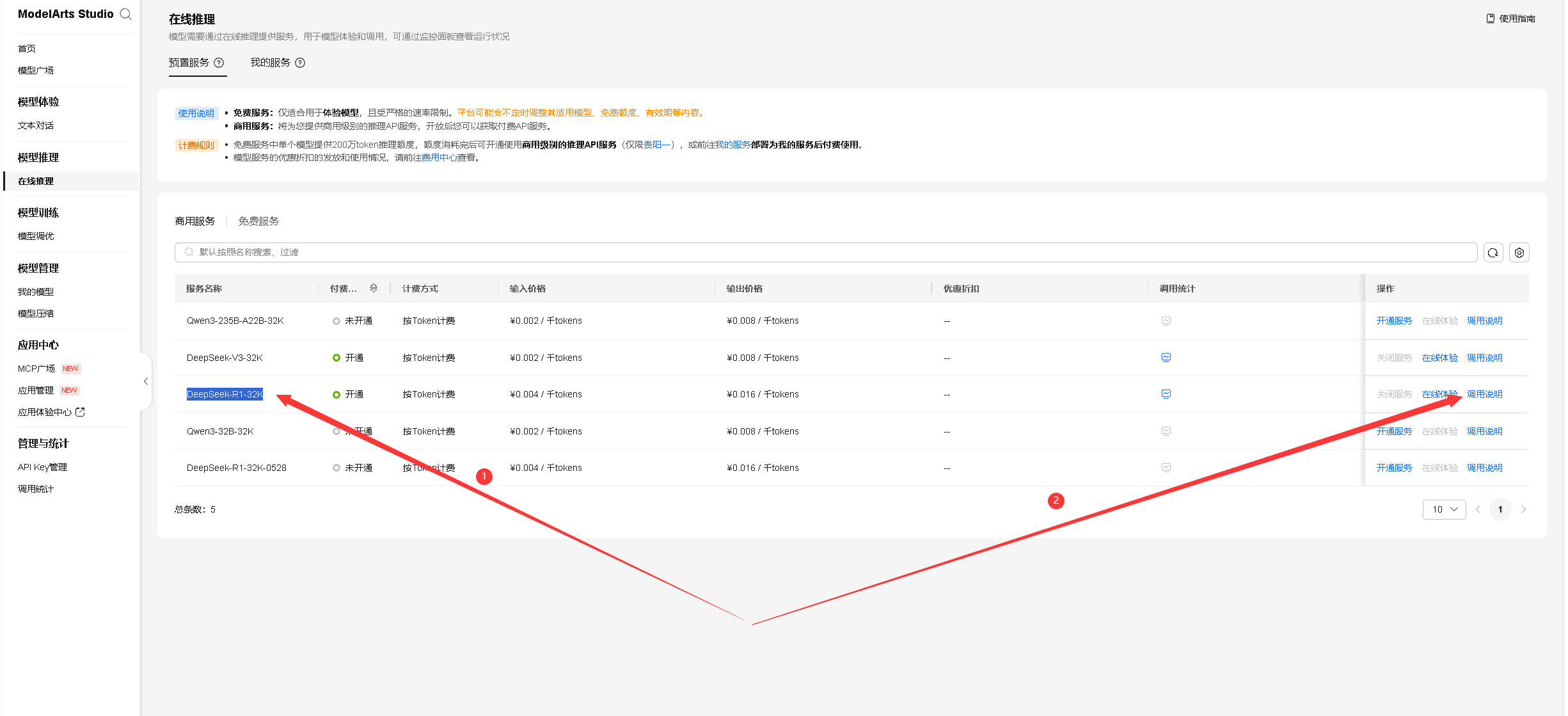

訪問 ModelArts Studio 大模型即服務平臺后,ModelArts Studio 控制臺,登錄后進入 模型推理 頁面,選擇 在線推理 > 預置服務 > 商用服務,在模型列表中找到 DeepSeek-R1-32K,點擊“開通服務”以啟用該模型,具體操作如下所示:

- ModelArts Studio 大模型即服務平臺地址:https://www.huaweicloud.com/product/modelarts/studio.html

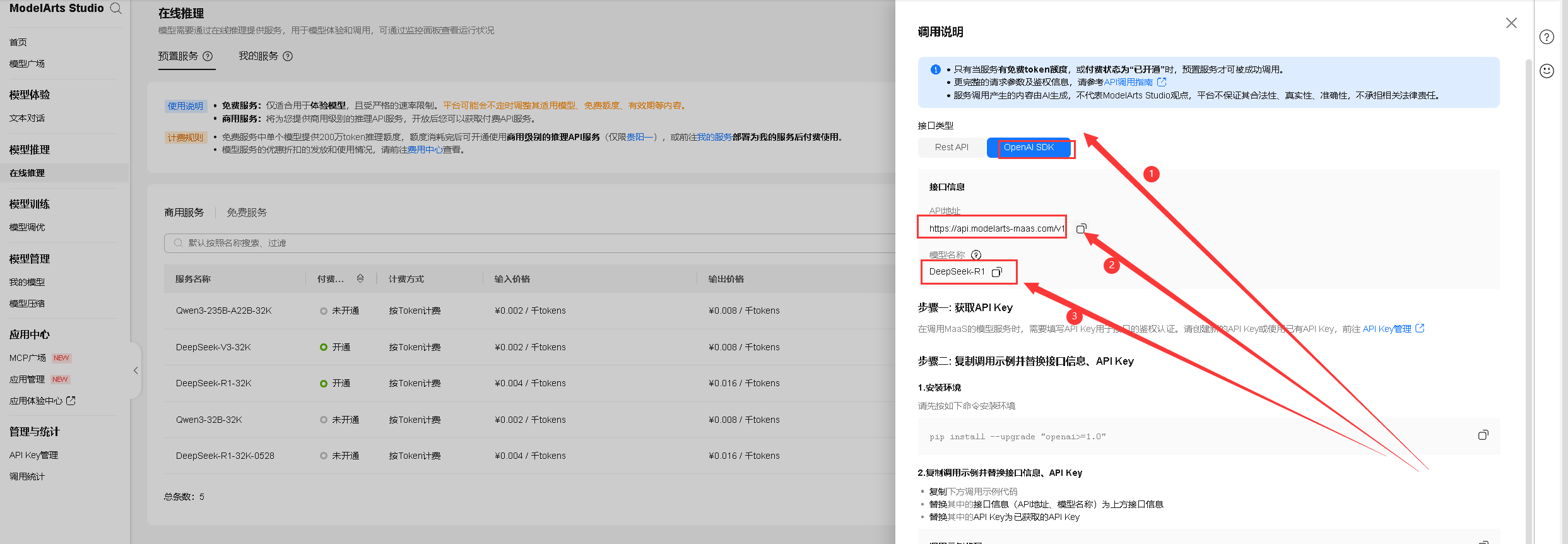

在使用說明中,我們選擇OpenAI SDK,,復制模型名稱和API地址。

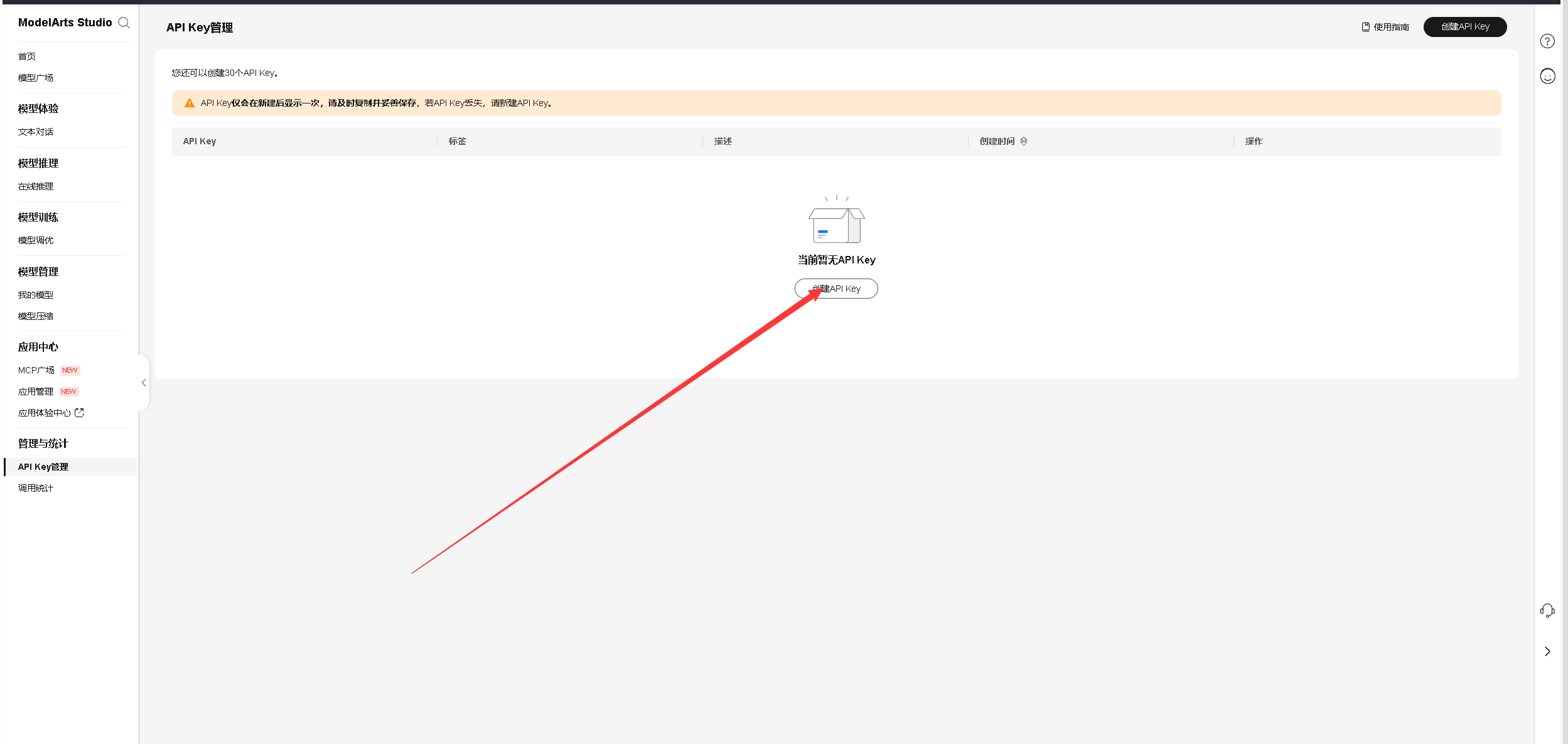

5.2 創建API key

我們在ModelArts Studio控制臺左側菜單欄中,單擊“API Key管理”,開始創建API key。

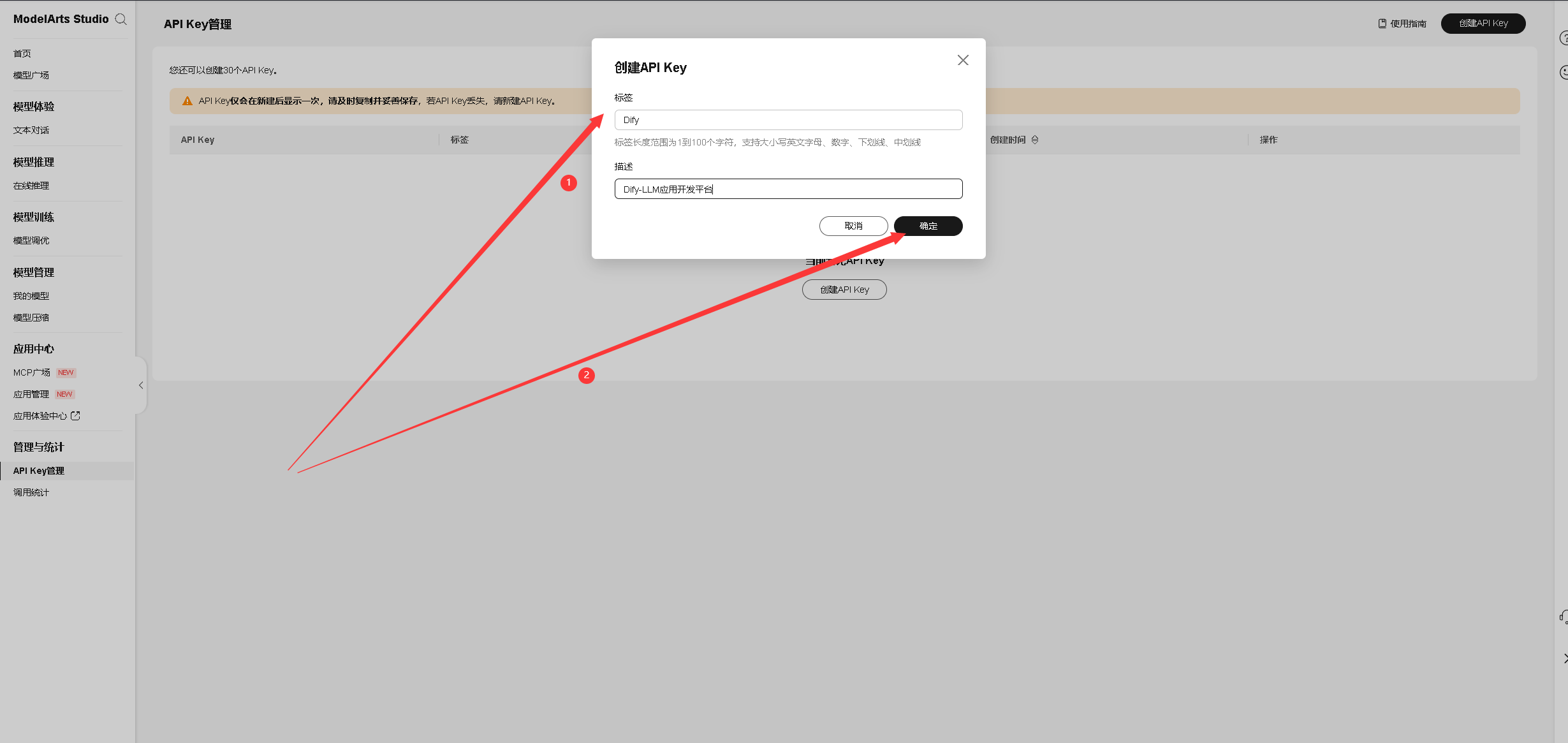

填寫API key的標簽和描述,填寫完畢后,確認創建。

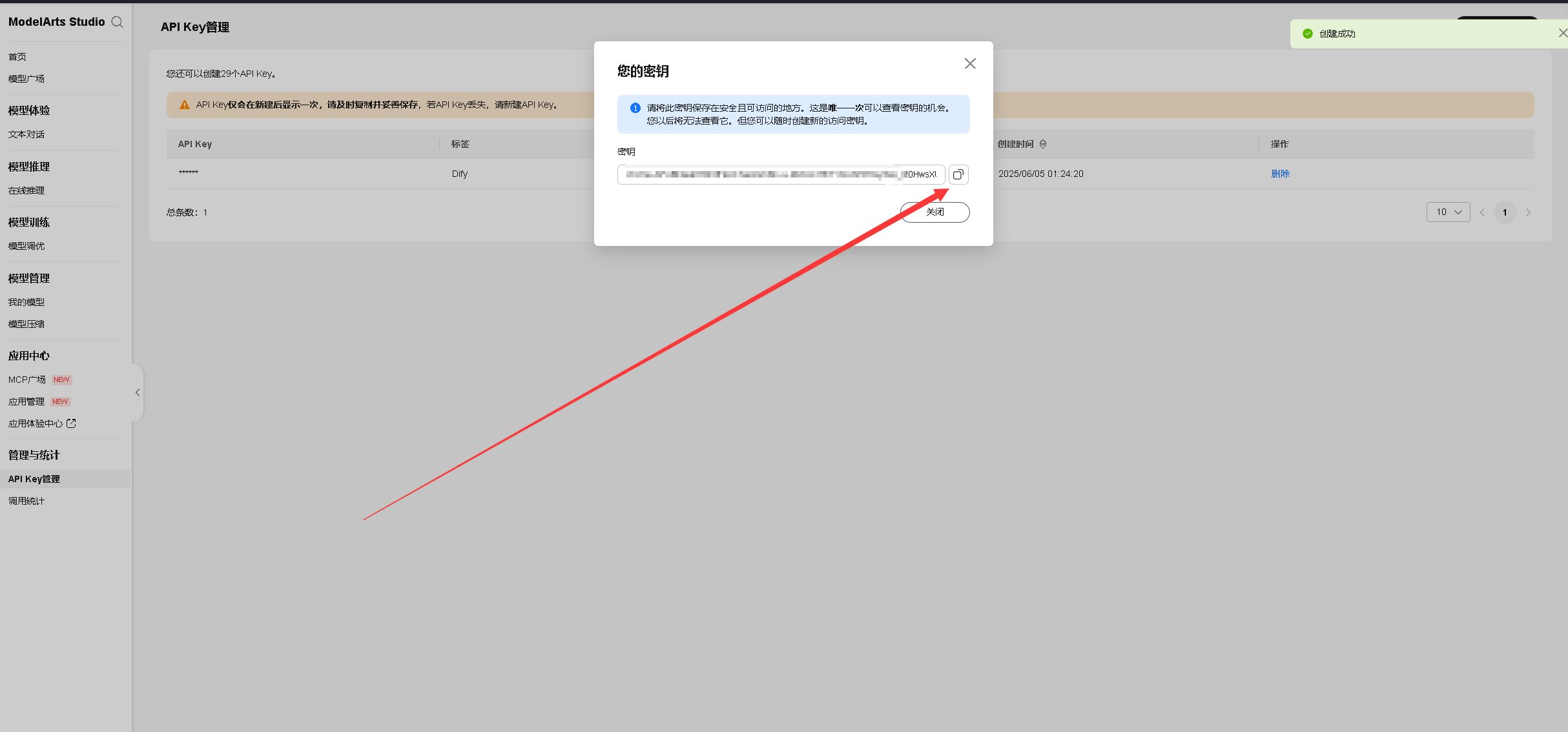

復制我們剛才生成的密鑰,如下所示:

5.3 Dify平臺對接MaaS服務

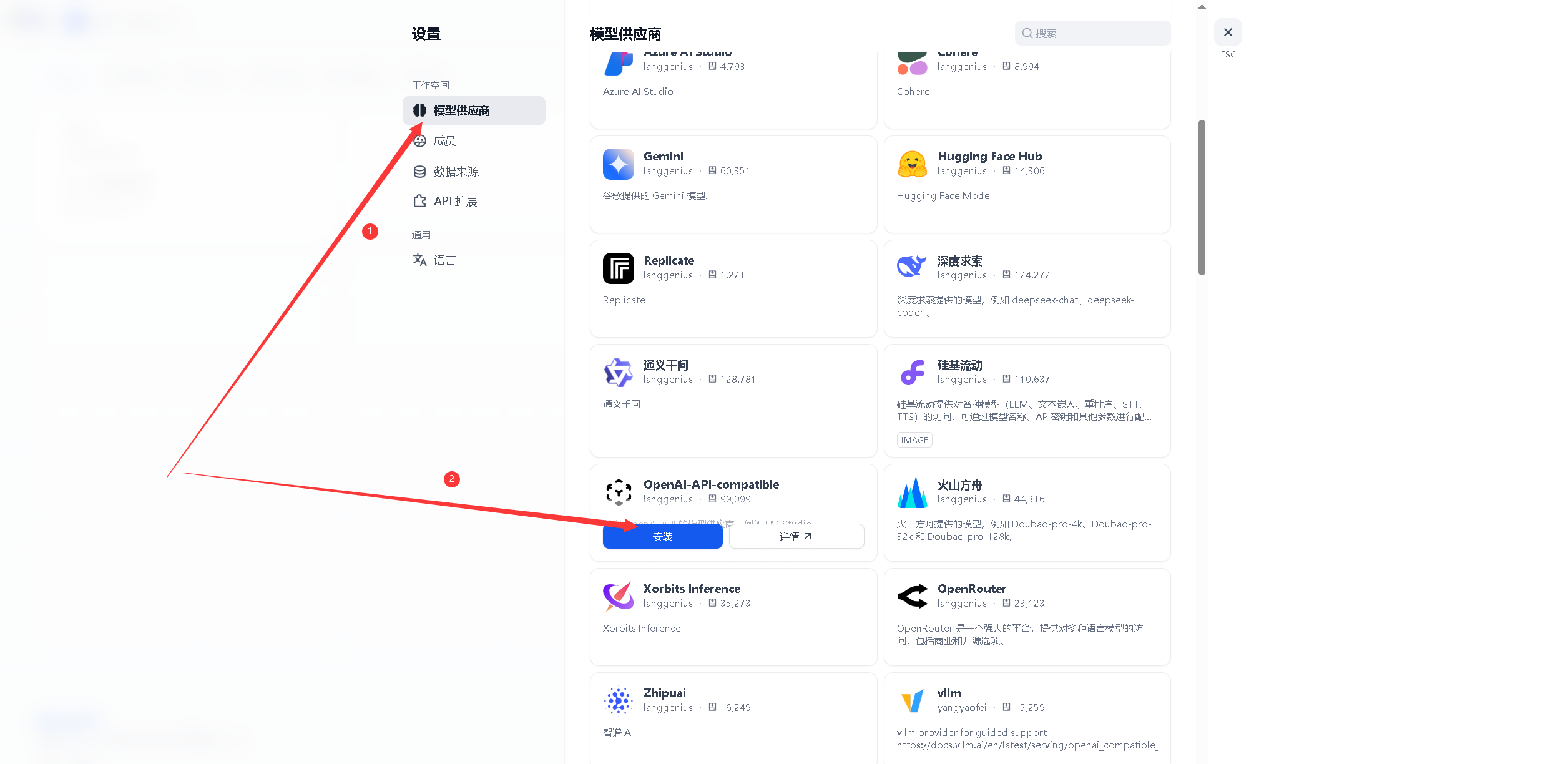

在 Dify 首頁右上角點擊用戶頭像或用戶名,從下拉菜單中點擊“設置”進入配置頁面。

在左側導航欄選擇“模型供應商”,選擇OpenAI-API-compatible供應商進行安裝。

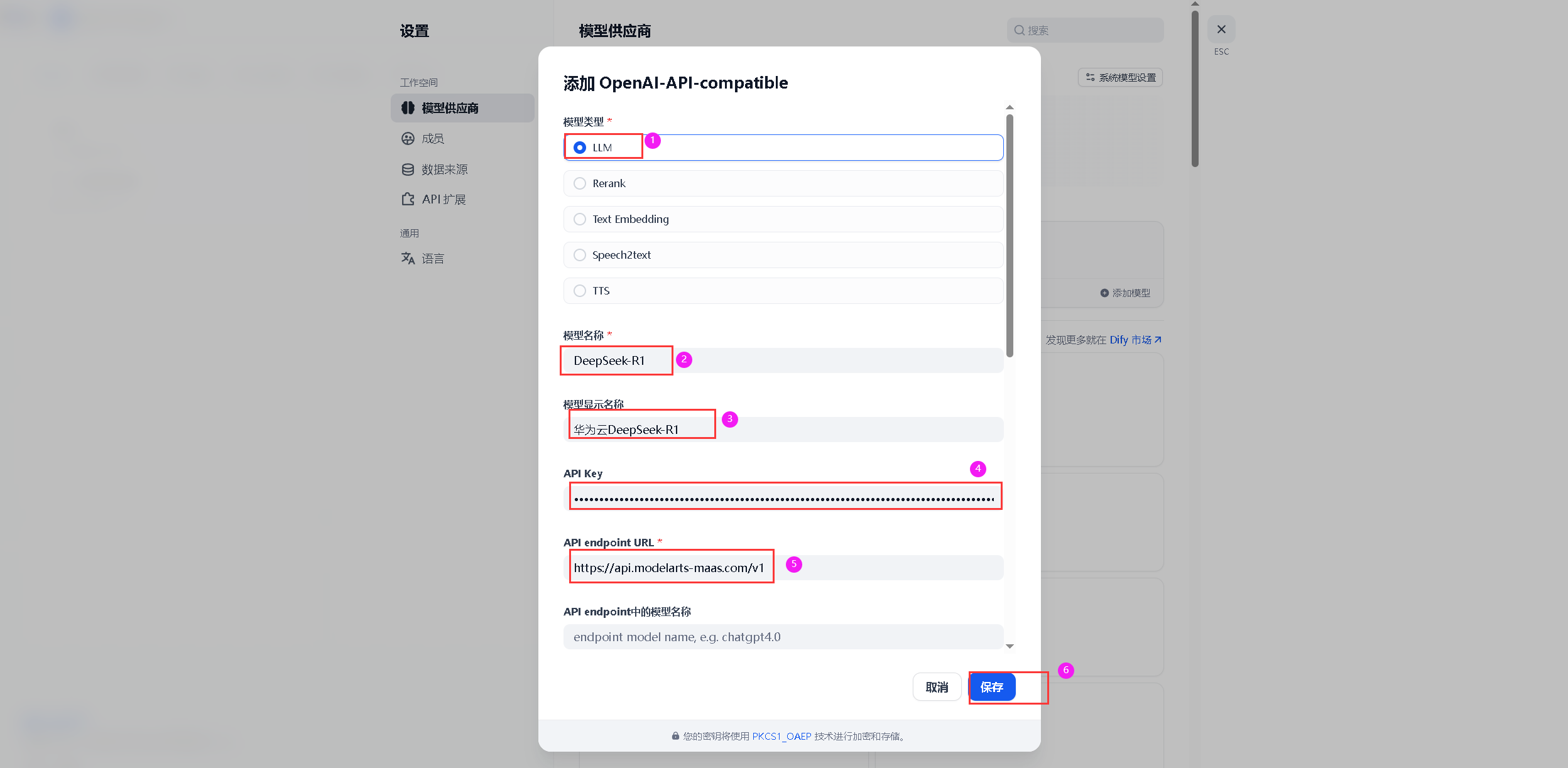

點擊“添加模型”,配置模型信息,參考如下配置:

模型類型: LLM模型名稱:DeepSeek-R1模型顯示名稱:華為云- DeepSeek-R1API Key: 將剛才創建的API key復制即可API endpoint URL:https://api.modelarts-maas.com/v1其余默認即可,點擊保存。

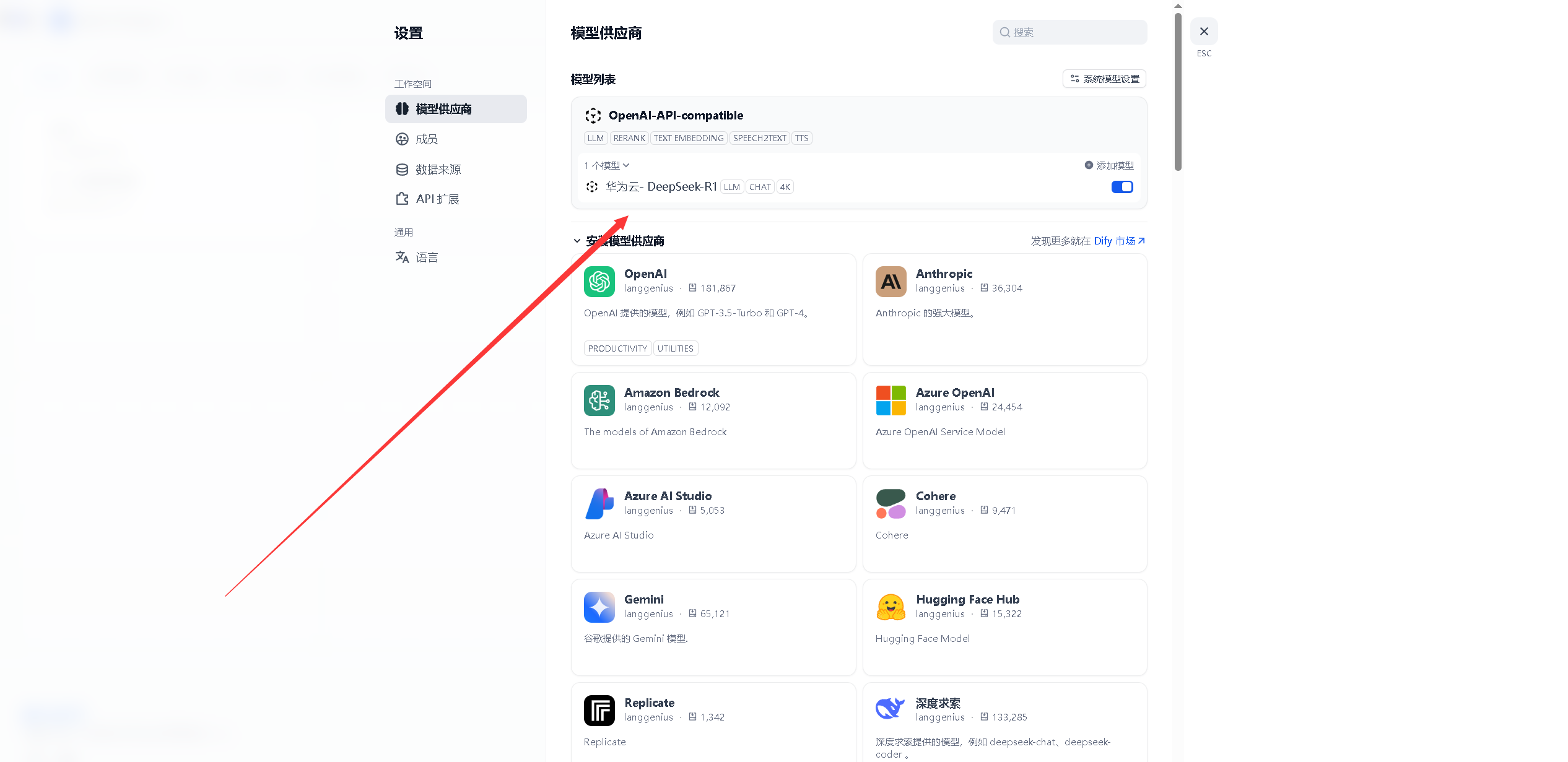

在模型列表中,可以看到我們成功添加DeepSeek-R1模型。

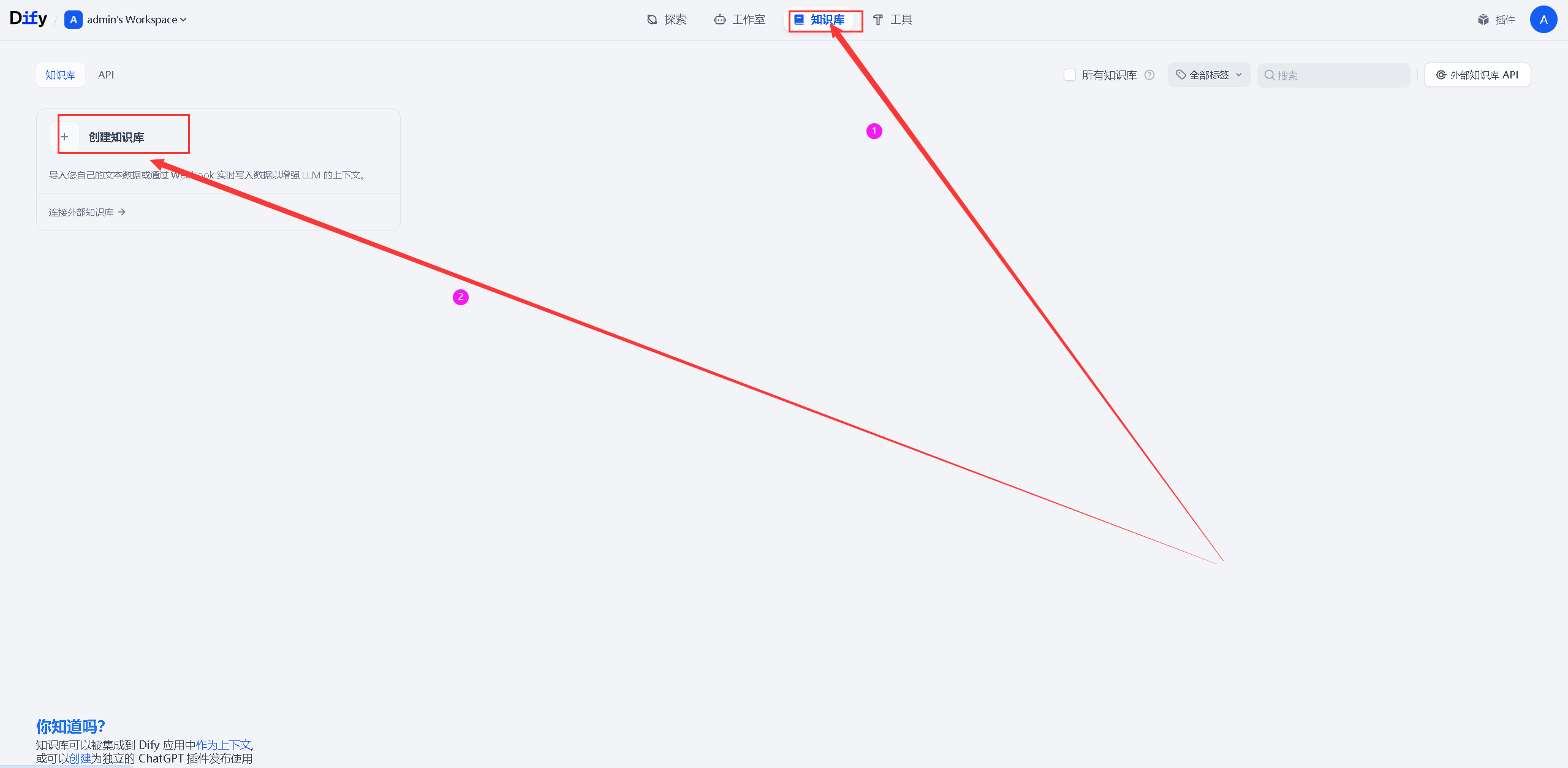

5.4 創建知識庫

在 Dify 平臺頁面中,我們選擇知識庫模塊,點擊“創建知識庫”選項。

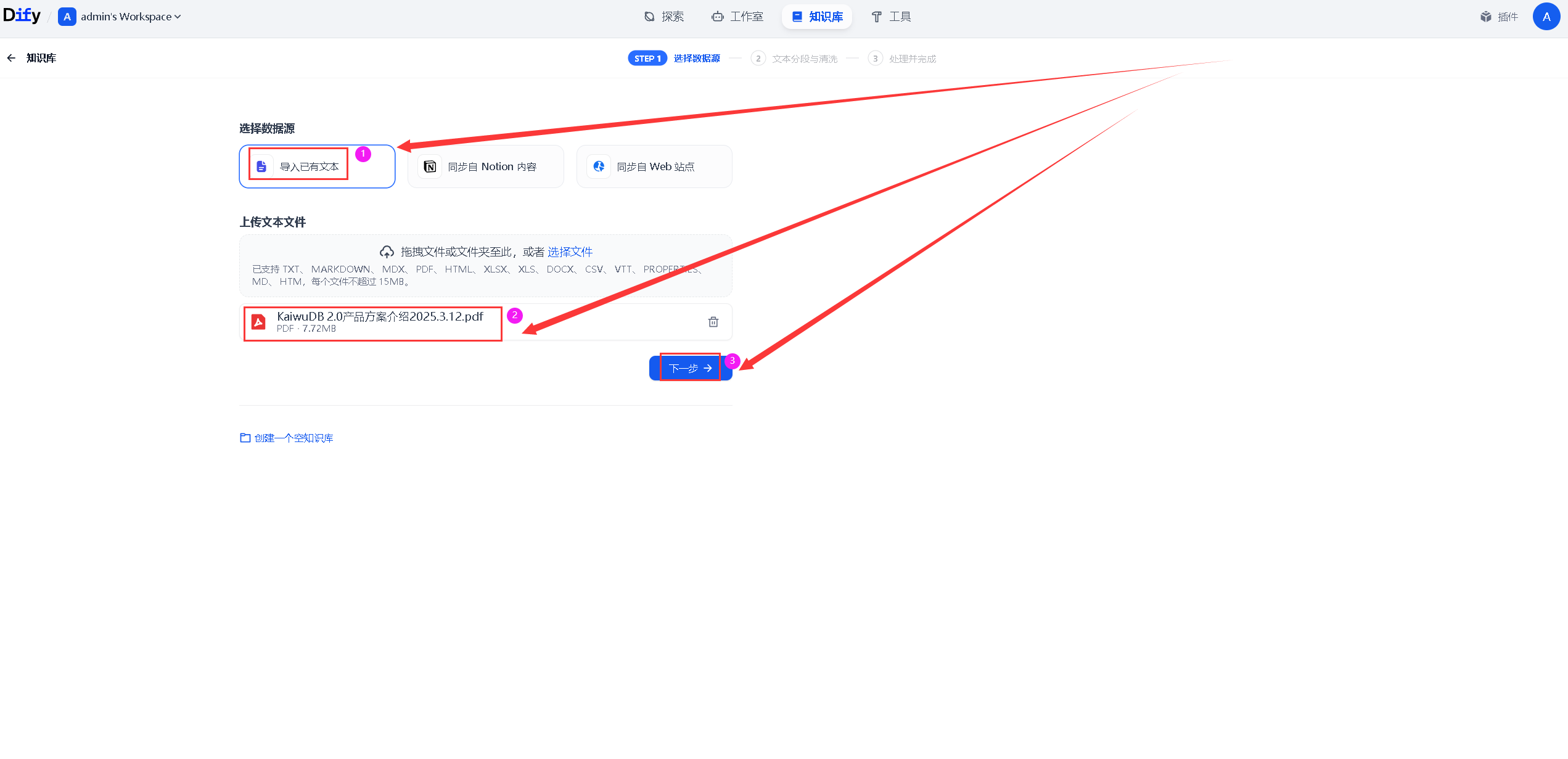

選擇數據源:導入已有文本,上傳本地測試文件,點擊“下一步”。

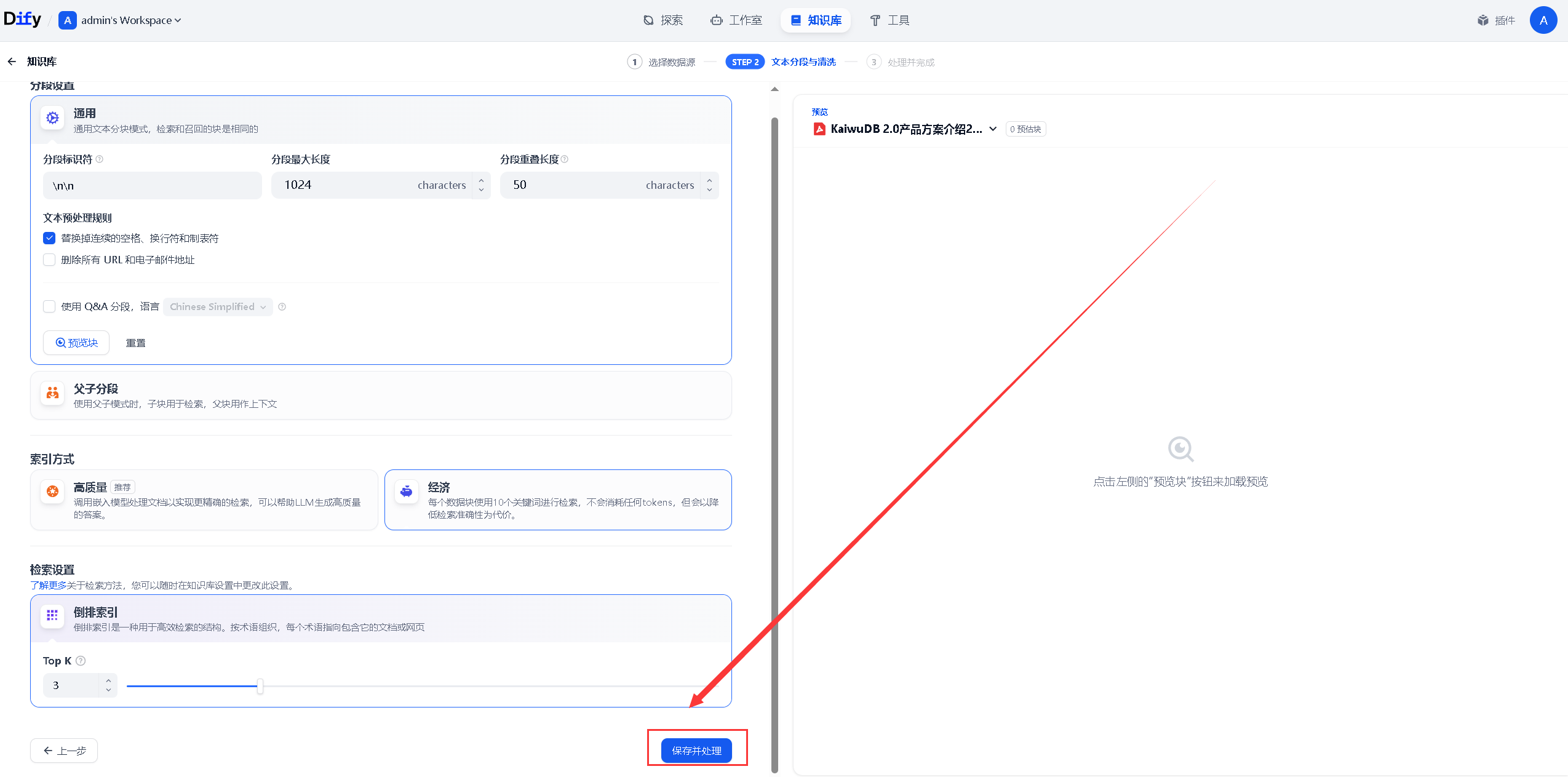

5.5 知識庫配置工作

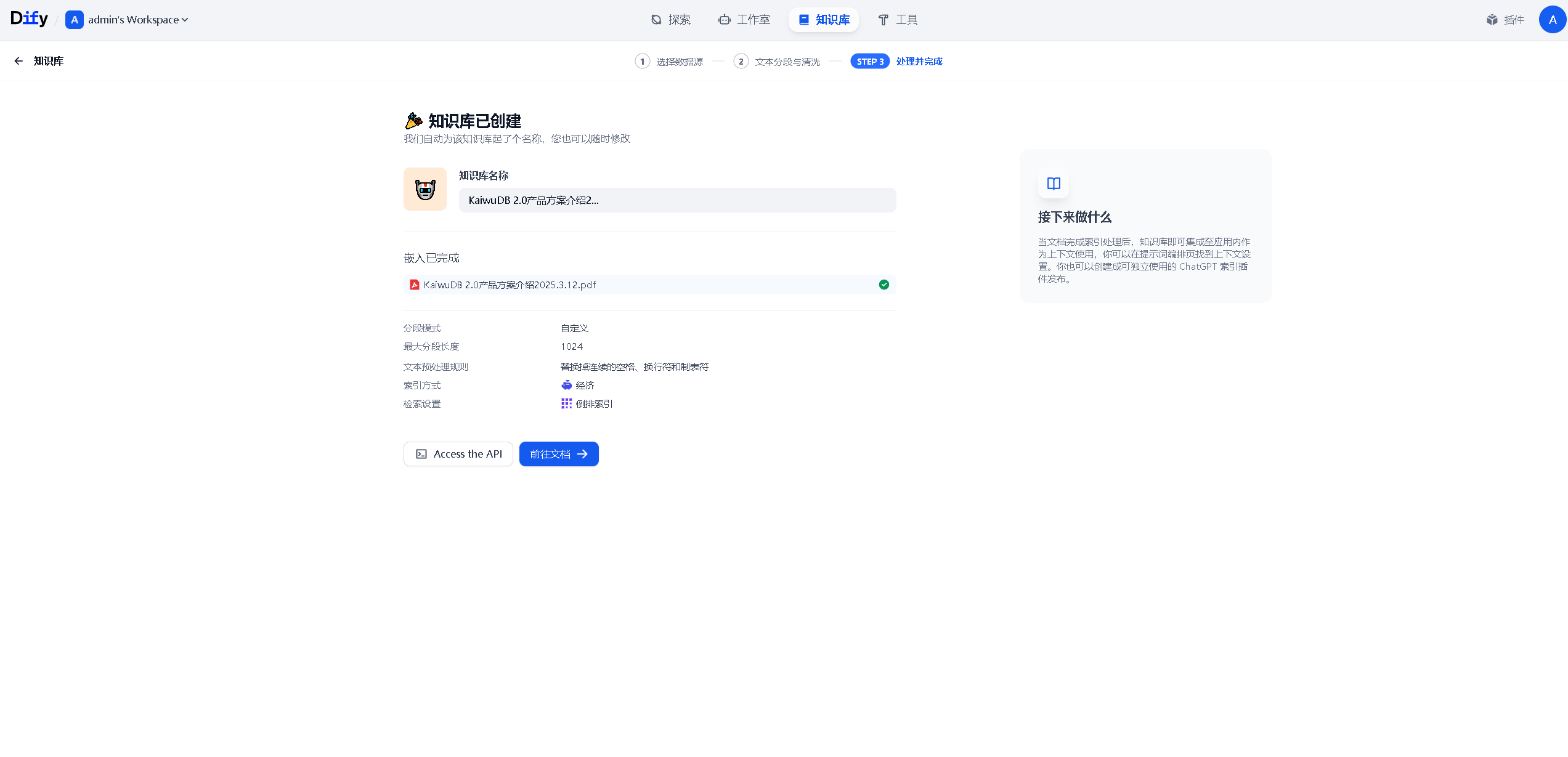

在配置知識庫時,若無特殊需求,可選擇 “經濟型” 模式,使用默認設置即可滿足基本使用場景。點擊 “保存與處理”,待頁面提示“嵌入已完成”即表示配置成功。

說明:

- 高質量型:適用于對檢索精度要求較高的場景,需提前配置 Embedding 和 Reranker 模型,通過調用嵌入模型處理文檔,提升檢索質量,從而幫助 LLM 生成更準確的回答。

- 本次測試我們選擇“經濟型”配置,其余參數保持默認設置。 確認后點擊 “保存與處理” 完成配置流程。

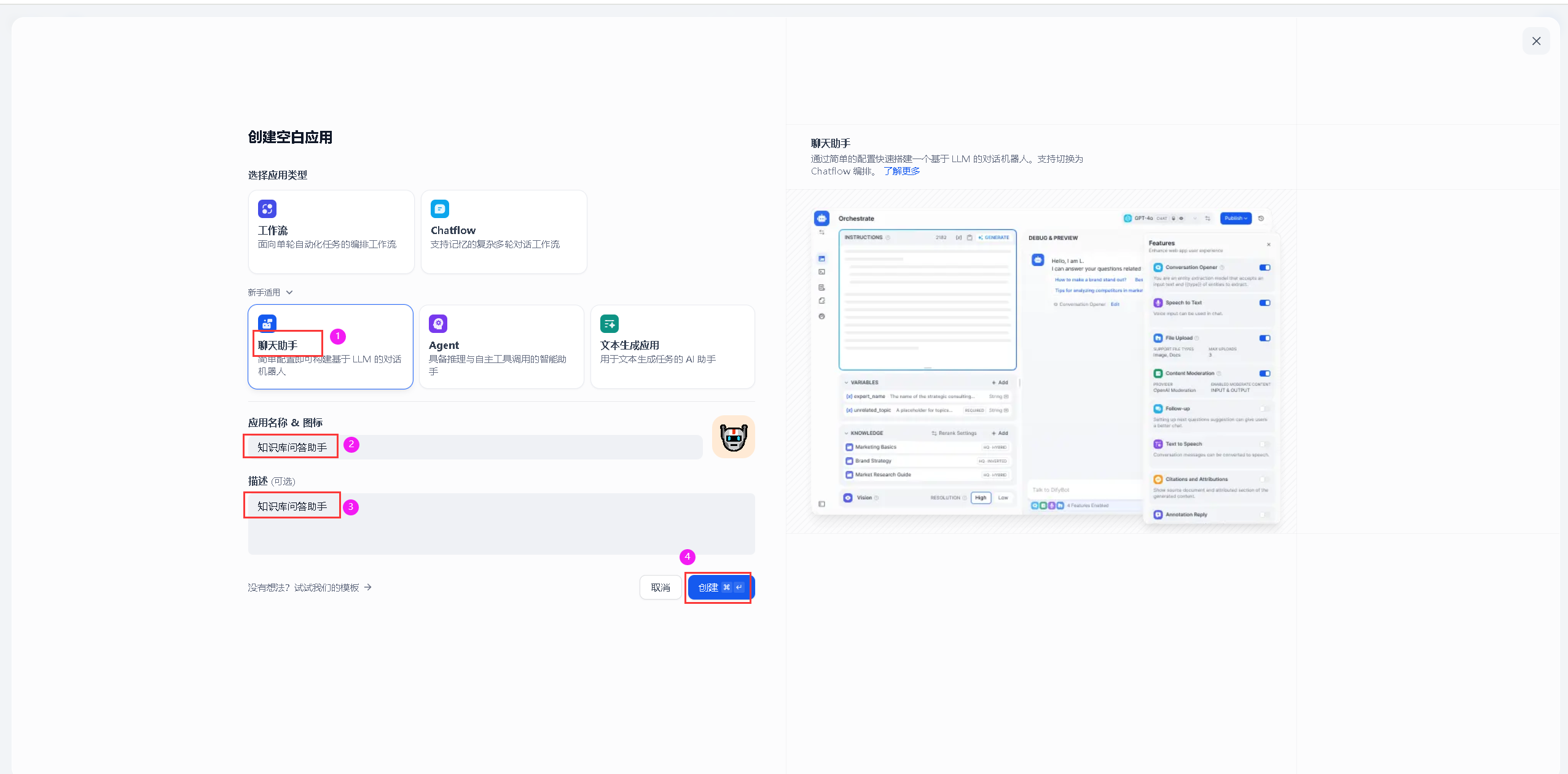

5.6 創建聊天助手

創建空白應用步驟中,可參考如下配置:

- 應用類型:聊天助手 ;

- 應用名稱:可自定義填寫,這里填寫知識庫問答助手;

- 描述:自定義填寫;

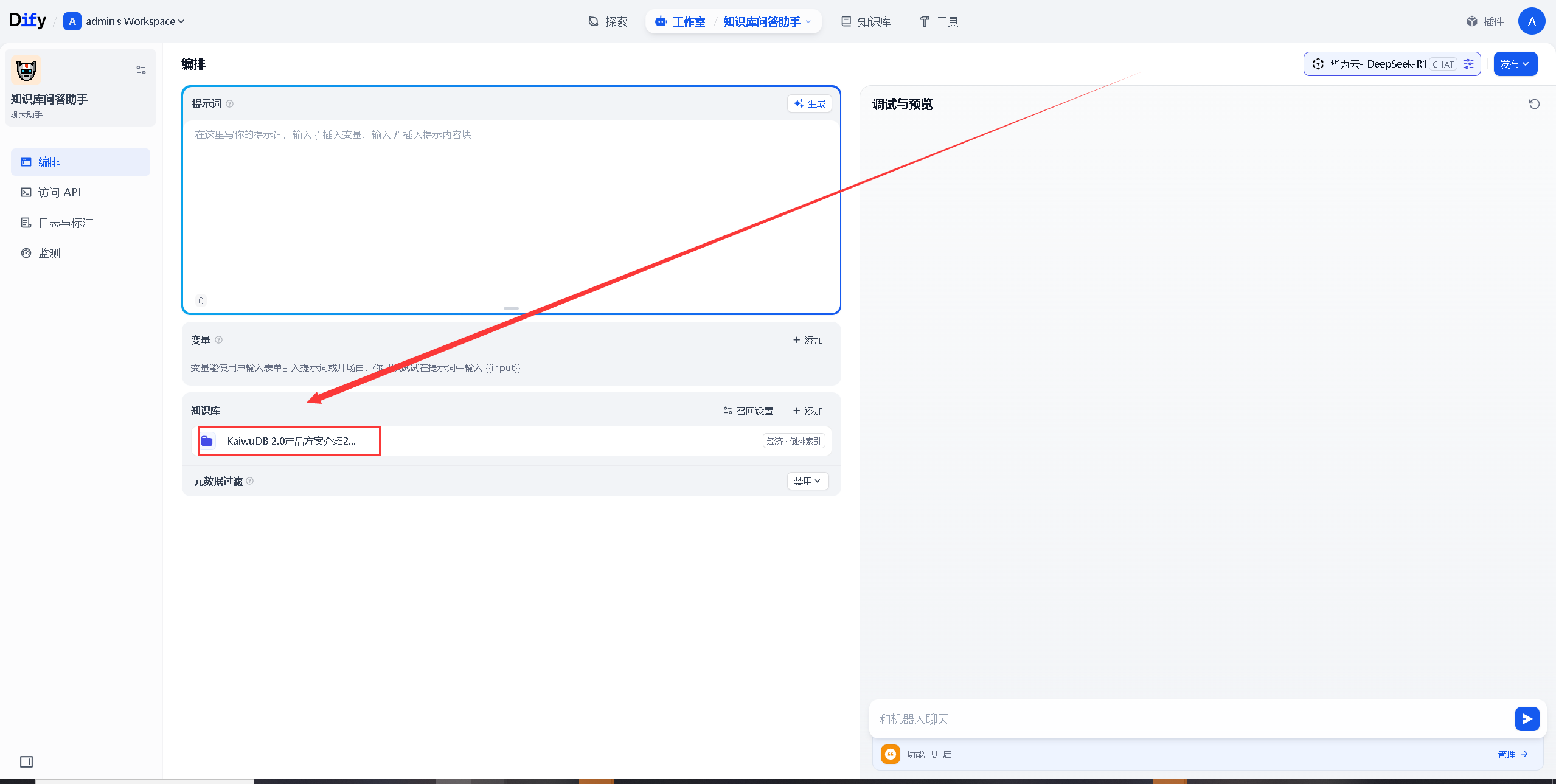

在聊天助手的編排設置中,我們添加剛才創建的知識庫。

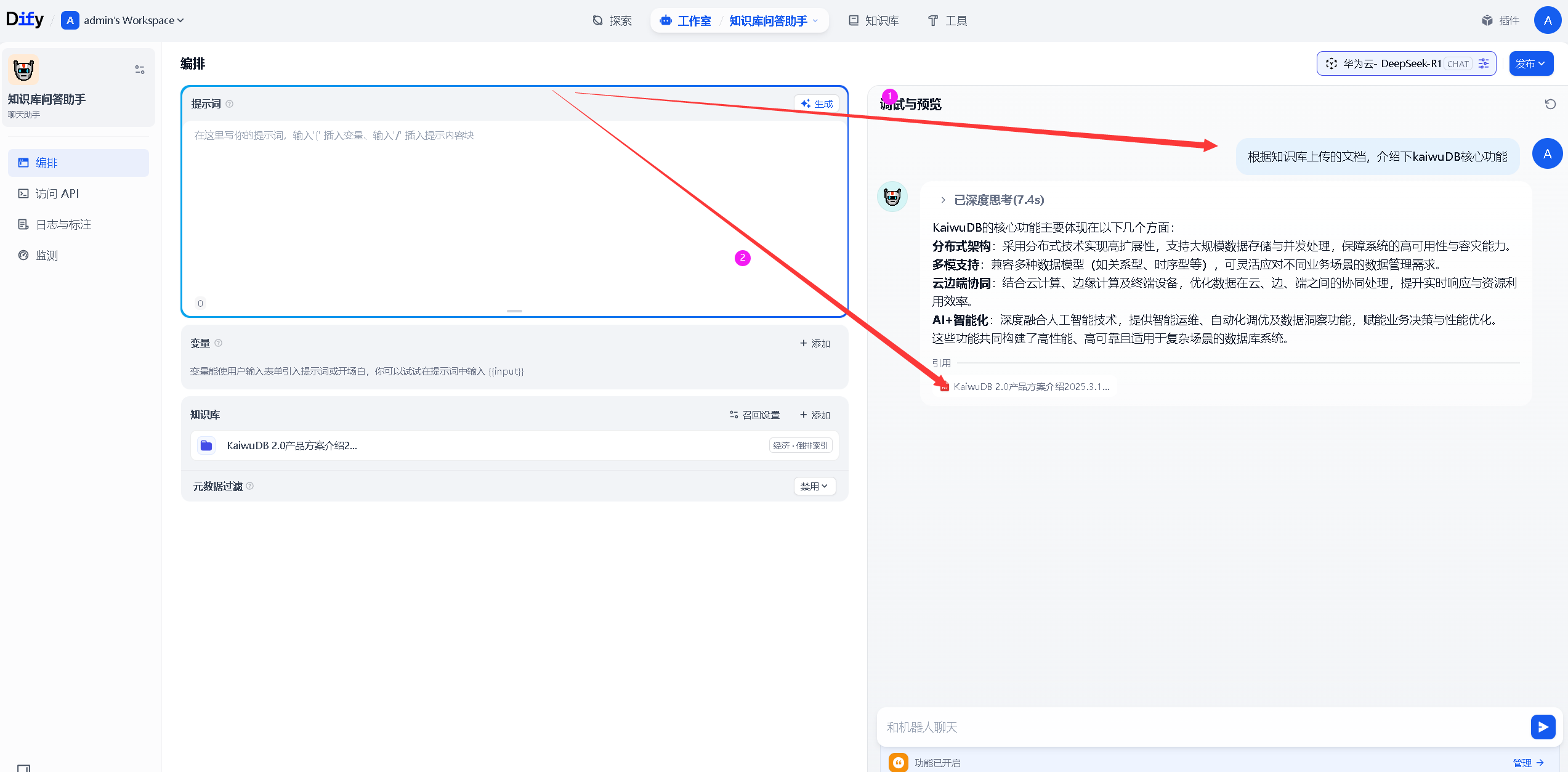

5.7 對話測試

在調試和預覽過程中,我們通過對話框對知識庫中的文檔內容進行咨詢,能夠有效引用并展示上傳的文檔信息,從而提供準確的回答,整體體驗較為理想。

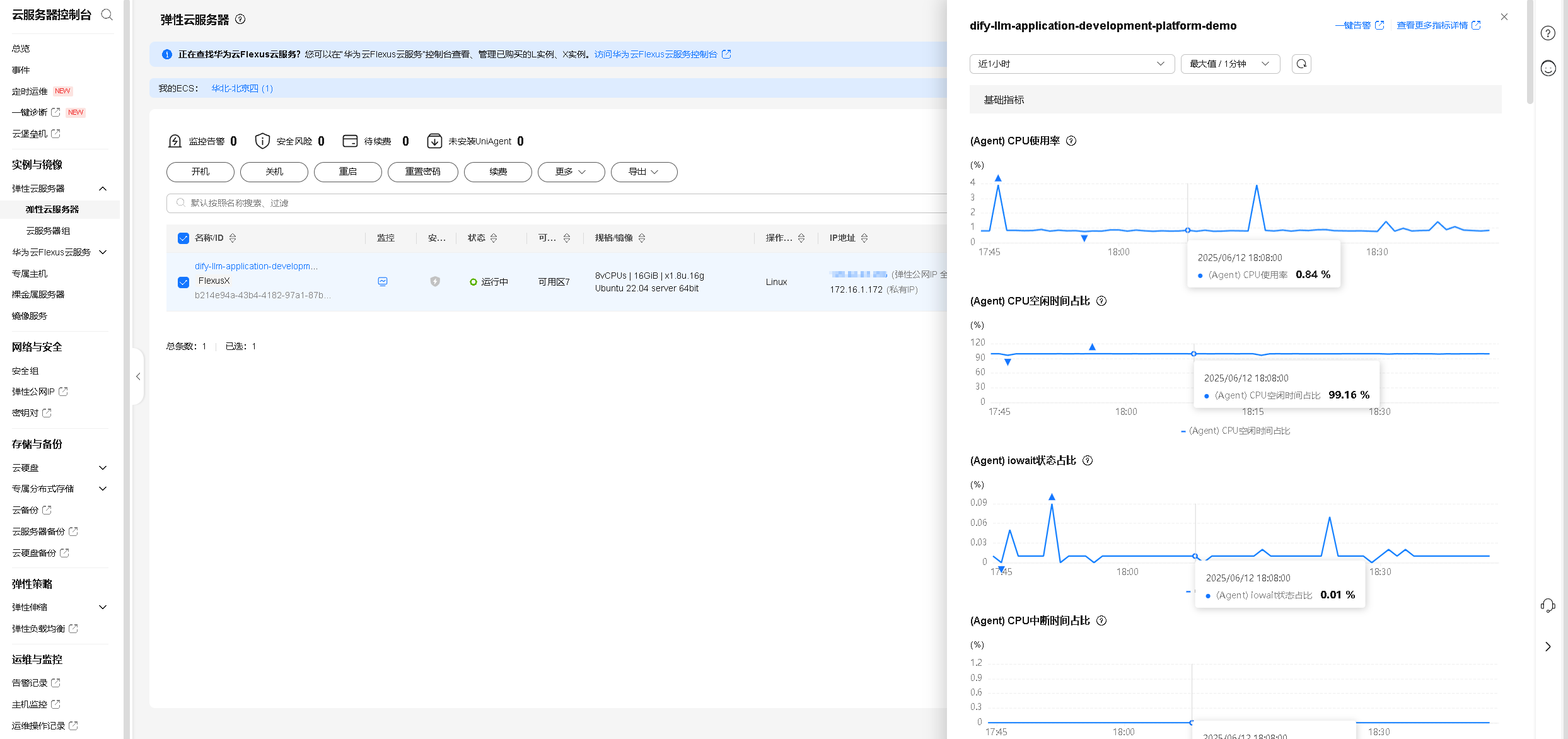

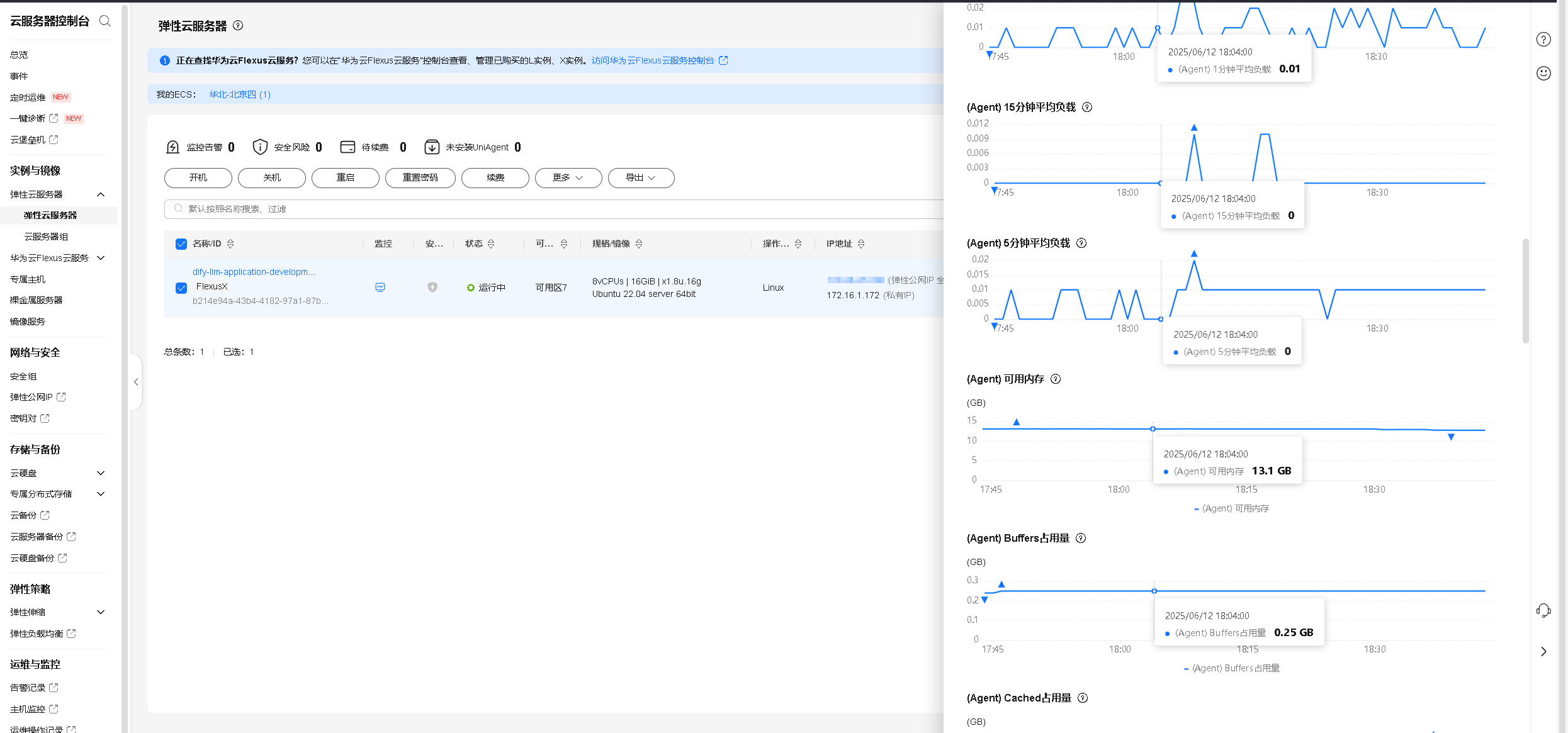

六、華為云Flexus X實例的資源使用情況

在本次基于 華為云 Flexus X 實例 與 Dify-LLM 平臺 構建智能知識庫問答助手的實踐中,我們通過持續監控 Flexus X 實例的 CPU 使用率、CPU 負載、內存占用等核心資源指標,全面評估了其在實際運行中的性能表現。同時,我們也將其與本地部署方案進行了對比分析,結果進一步驗證了 Flexus X 實例在資源利用率、系統穩定性以及整體運行效率方面的顯著優勢。

實踐表明,Flexus X 實例不僅具備出色的資源控制能力:即便在高并發請求下,CPU 使用率仍保持平穩(平均低于 10%),內存占用穩定可控,負載曲線平滑,展現出高效的任務調度能力;而且相較于傳統本地部署方式,Flexus X 還具備更高的靈活性與可維護性,支持彈性伸縮、自動化運維和多層安全防護,極大降低了部署與管理成本。這充分體現了 華為云 Flexus X 實例作為 AI 應用理想載體的強大實力 —— 在保障高性能的同時,實現了輕量化、智能化、高可用的云上運行體驗。

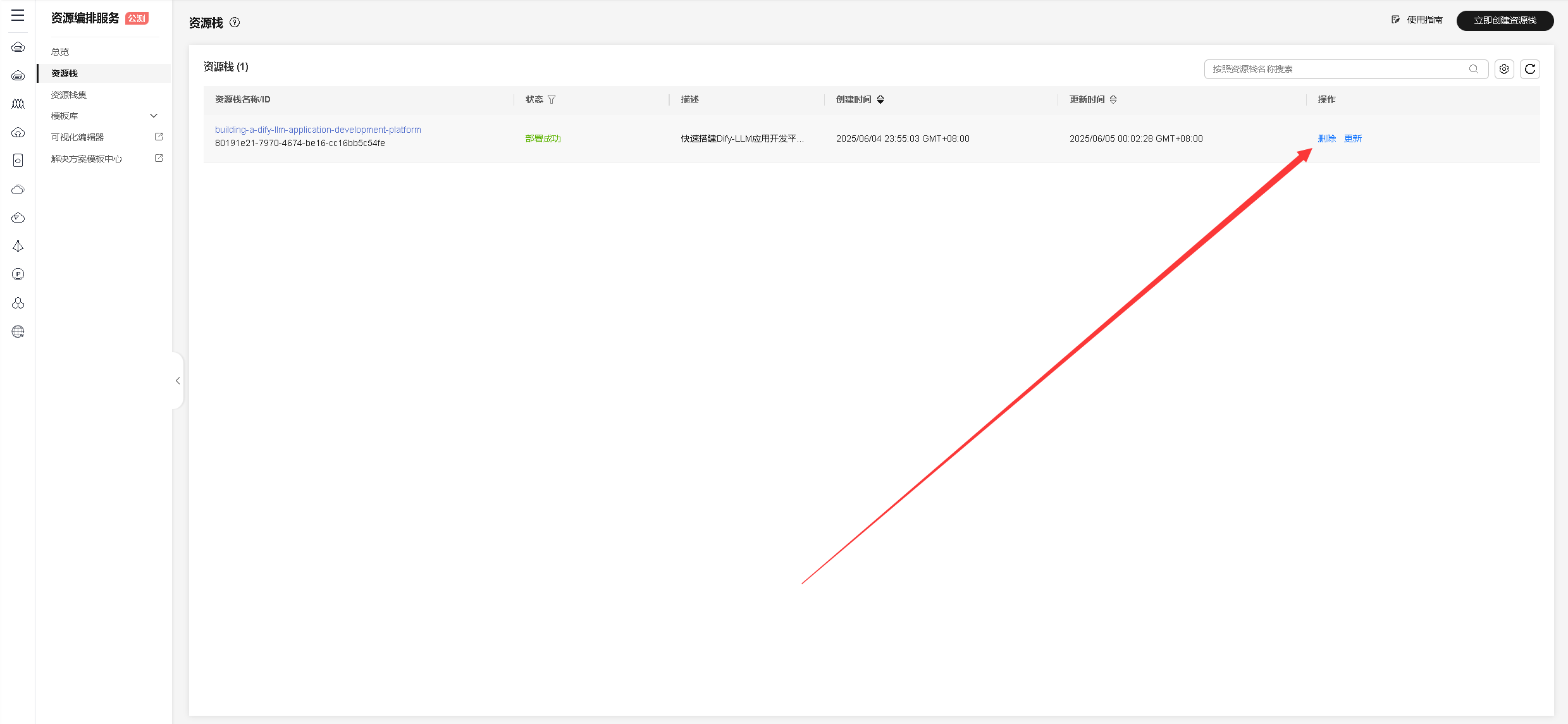

七、快速清空資源

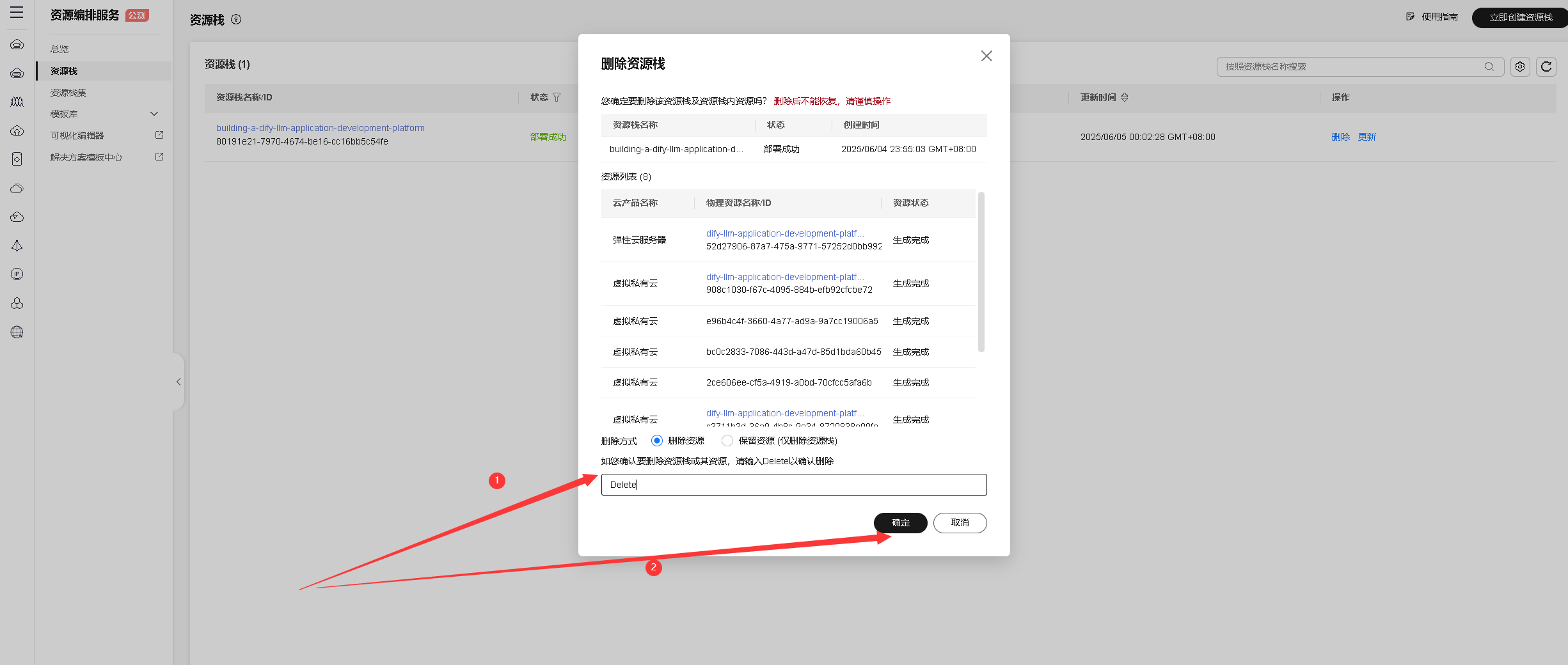

為了避免不必要的費用支出,我們在完成本次實踐,請務必關閉相關資源。我們進入 資源編排服務 控制臺,找到剛才創建的資源棧,點擊“刪除”按鈕以一鍵清理所有關聯資源。通過及時刪除資源棧,可以有效避免因未關閉資源而導致的過度扣費問題,確保資源使用的成本可控。

八、總結

🌟 使用感受:實踐成果與技術價值并重

本次基于 華為云 Flexus X 實例 與 Dify-LLM 平臺 構建智能知識庫問答助手的實踐,充分驗證了華為云在 AI 應用部署與云計算服務方面的卓越能力。通過靈活高效的 Flexus X 實例,我們實現了從環境搭建、模型部署到知識庫接入的全流程快速開發。其低資源占用、高并發處理能力和穩定運行表現,顯著提升了系統響應效率與用戶體驗,為構建輕量級、高性能的智能問答系統提供了堅實基礎。

💡 實踐總結:高效、便捷、值得信賴的云服務體驗

在整個項目實踐中,華為云 Flexus X 實例展現出強大的彈性伸縮能力與運維便利性,極大降低了部署門檻和運營成本。得益于其“即開即用”的特性,我們無需耗費大量時間進行本地環境配置,即可快速進入功能開發與模型優化階段。同時,結合 Dify-LLM 平臺的強大功能,輕松實現了知識內容的結構化處理與智能語義匹配,真正做到了“AI 能力 + 云服務”的深度融合。

華為云 Flexus X 實例以其出色的性能表現和極致的使用體驗,成為我們本次項目成功的關鍵支撐。它不僅是一款云服務器產品,更是推動 AI 創新落地的強大引擎。未來,我們期待繼續攜手華為云,探索更多智能化應用場景,釋放云端算力潛能!

🚀 選擇華為云 Flexus X,讓智能應用更輕盈、更快捷、更強大!

💻 一站式部署 | 📈 彈性伸縮 | 🧠 高效賦能 AI 應用

🌈 讓你專注于創新,而不是基礎設施!

或 = ())

暨第七屆CCPC河南省大學生程序設計競賽(補題))