Ollama介紹

Ollama是一款簡單好用的模型部署工具,不僅可以部署DeepSeek,市面上開源模型大部分都可以一鍵部署,這里以DeepSeek為例

官網

DeepSeek

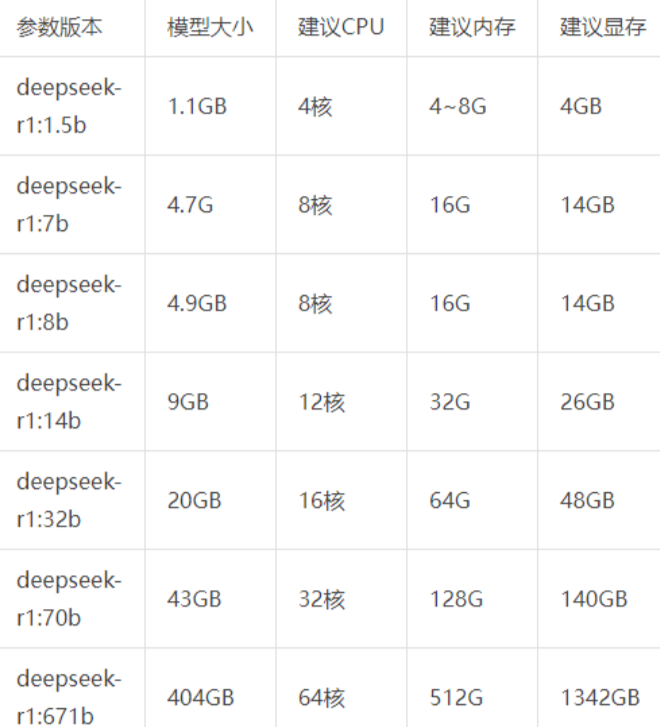

版本硬件要求

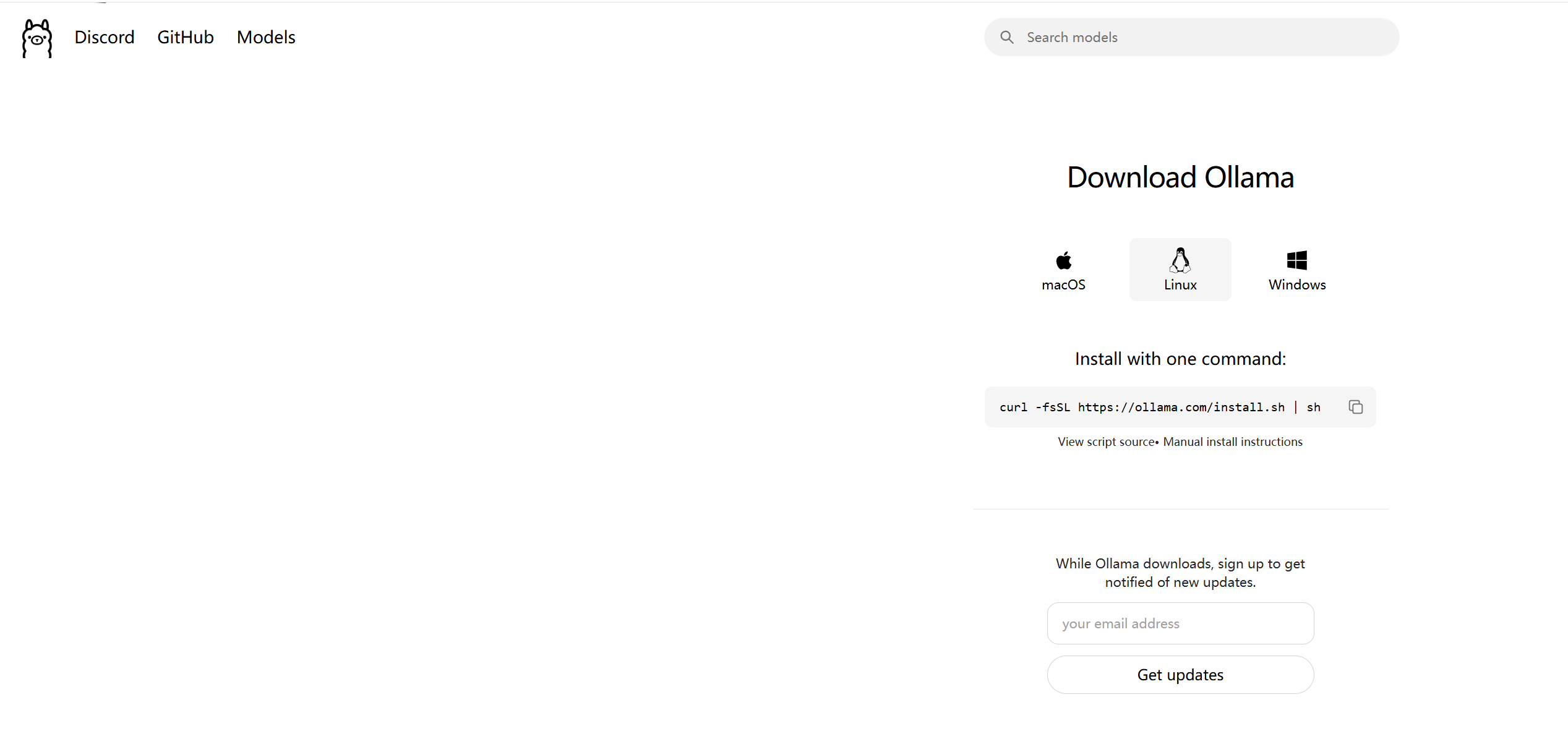

安裝Ollama

環境

sudo apt update

sudo apt install curl

sudo apt install lsof

1.命令一鍵安裝

在官網點擊下載可以看到推薦的就是命令安裝,根據需要選擇系統版本

但是由于是外網地址會下載的非常慢,如果網絡環境支持,首選命令行安裝,簡單方便

curl -fsSL https://ollama.com/install.sh | sh

2.壓縮包安裝

在網絡環境不允許,或者下載太慢的情況下,可以選擇壓縮包安裝

壓縮包安裝需要注意會有一些坑,命令行直接安裝會自動匹配,不需要考慮架構問題

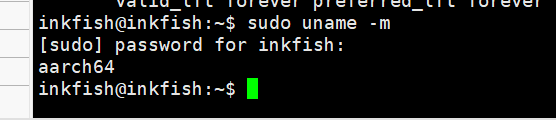

這里主要以linux系統為例子,系統架構會有很多版本主要 X86,ARM等等

這里需要先通過命令查看自己的系統架構版本

參考官方文檔

sudo uname -m

我這里就是arm的架構

arm版本下載路徑

curl -L https://ollama.com/download/ollama-linux-arm64.tgz -o ollama-linux-arm64.tgz

sudo tar -C /usr -xzf ollama-linux-arm64.tgz

amd /x86 版本

curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ollama-linux-amd64.tgz

sudo tar -C /usr -xzf ollama-linux-amd64.tgz

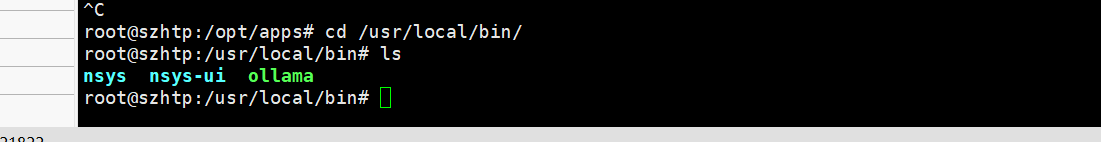

上面得解壓路徑一般官方文檔是放在usr/bin ,amd版本一般放在/usr/local/bin 根據自己情況解壓

解壓之后可以在對應得路徑看到一個ollama啟動器文件

命令后臺啟動

/usr/bin/ollama serve &

啟動報錯可能是端口沖突,查看端口占用

sudo lsof -i :11434

kill -9 1234

編寫自啟動腳本

sudo vi /etc/systemd/system/ollama.service

[Unit]

Description=Ollama Service

After=network-online.target[Service]

ExecStart=/usr/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin"

Environment="OLLAMA_HOST=0.0.0.0"

Environment="OLLAMA_ORIGINS=*"

[Install]

WantedBy=multi-user.target

如果沒有ollama用戶則創建用戶

sudo groupadd -r ollama

sudo useradd -r -g ollama -s /sbin/nologin ollama

sudo mkdir -p /home/ollama/.ollama

sudo chown -R ollama:ollama /home/ollama/.ollama

重新加載 Systemd 配置

sudo systemctl daemon-reload

啟用 Ollama 服務自啟動

sudo systemctl enable ollama.service

啟動/停止.重啟 Ollama 服務

sudo systemctl start ollama.service

sudo systemctl stop ollama.service

sudo systemctl restart ollama.service

檢查 Ollama 服務狀態

sudo systemctl status ollama.service

查看最近的日志輸出

sudo journalctl -u ollama.service

重啟系統以驗證自啟動

sudo reboot

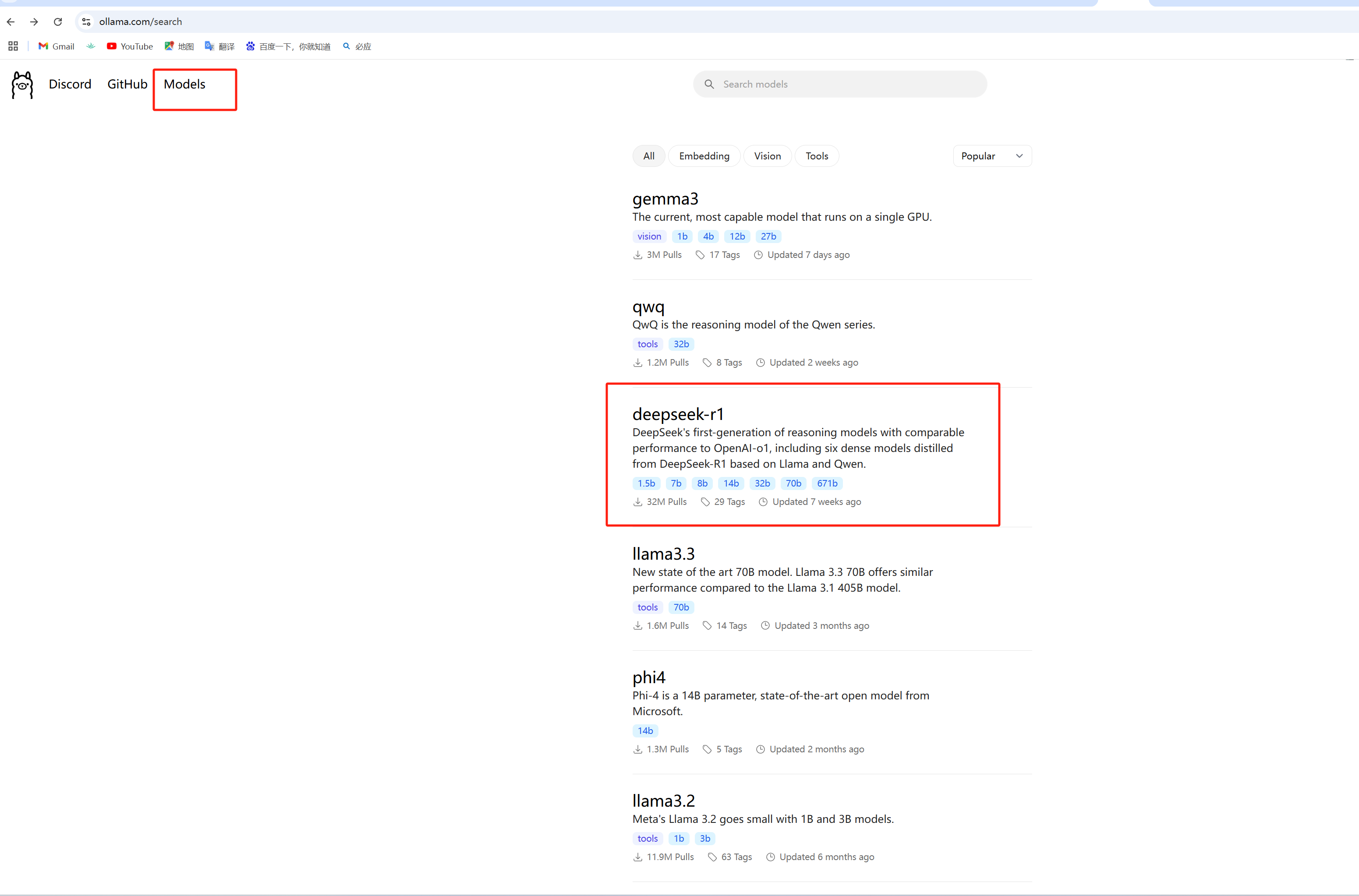

下載DeepSeek模型并啟動

官網上不止有DeepSeek模型,市面上大部分開源模型都可以一鍵安裝,這里只是以DeepSeek為例

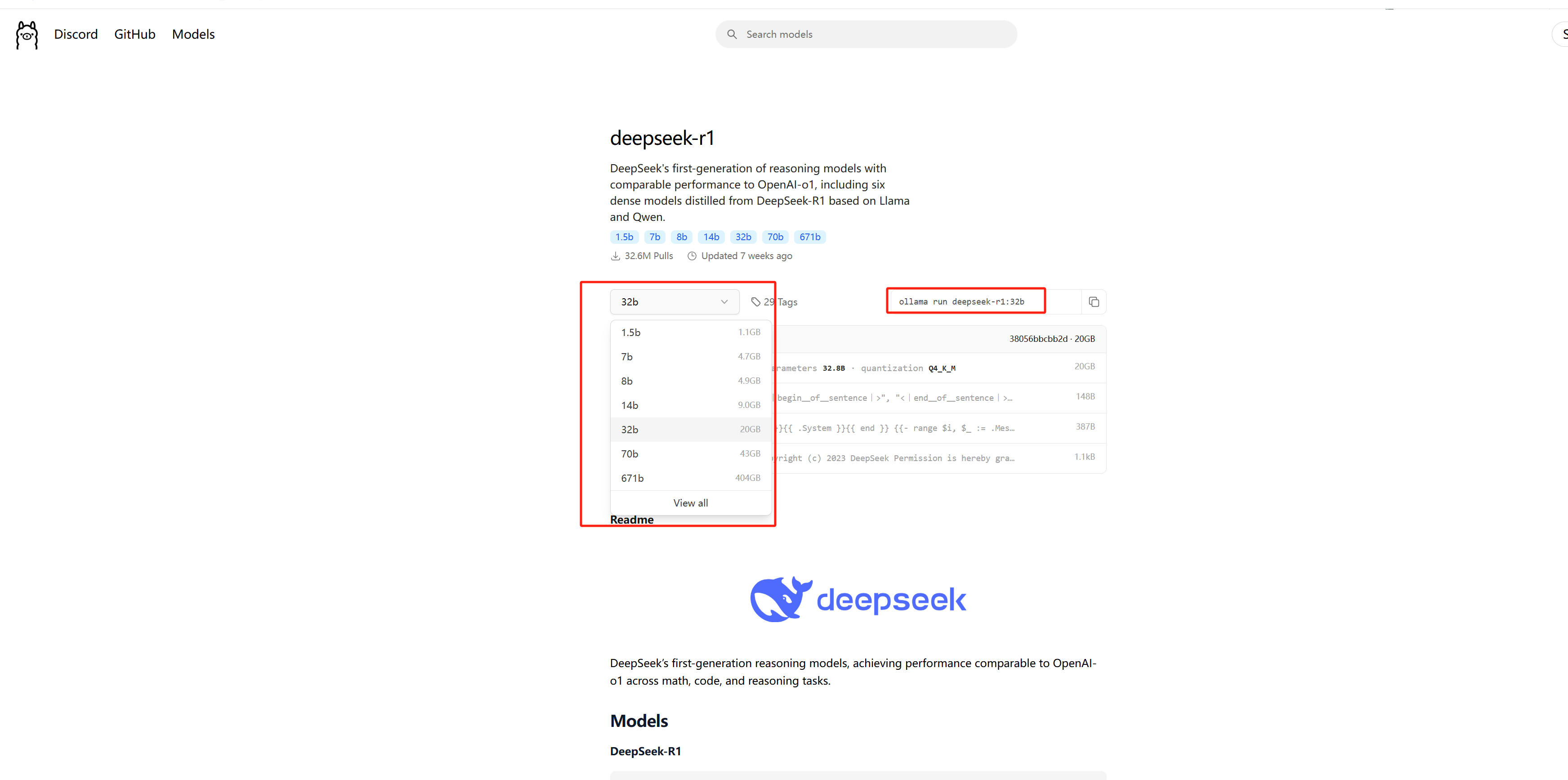

選擇想要部署的版本,復制對應的命令

版本命令

ollama run deepseek-r1:1.5b

ollama run deepseek-r1:7b

ollama run deepseek-r1:8b

ollama run deepseek-r1:14b

ollama run deepseek-r1:32b

ollama run deepseek-r1:70b

ollama run deepseek-r1:671b

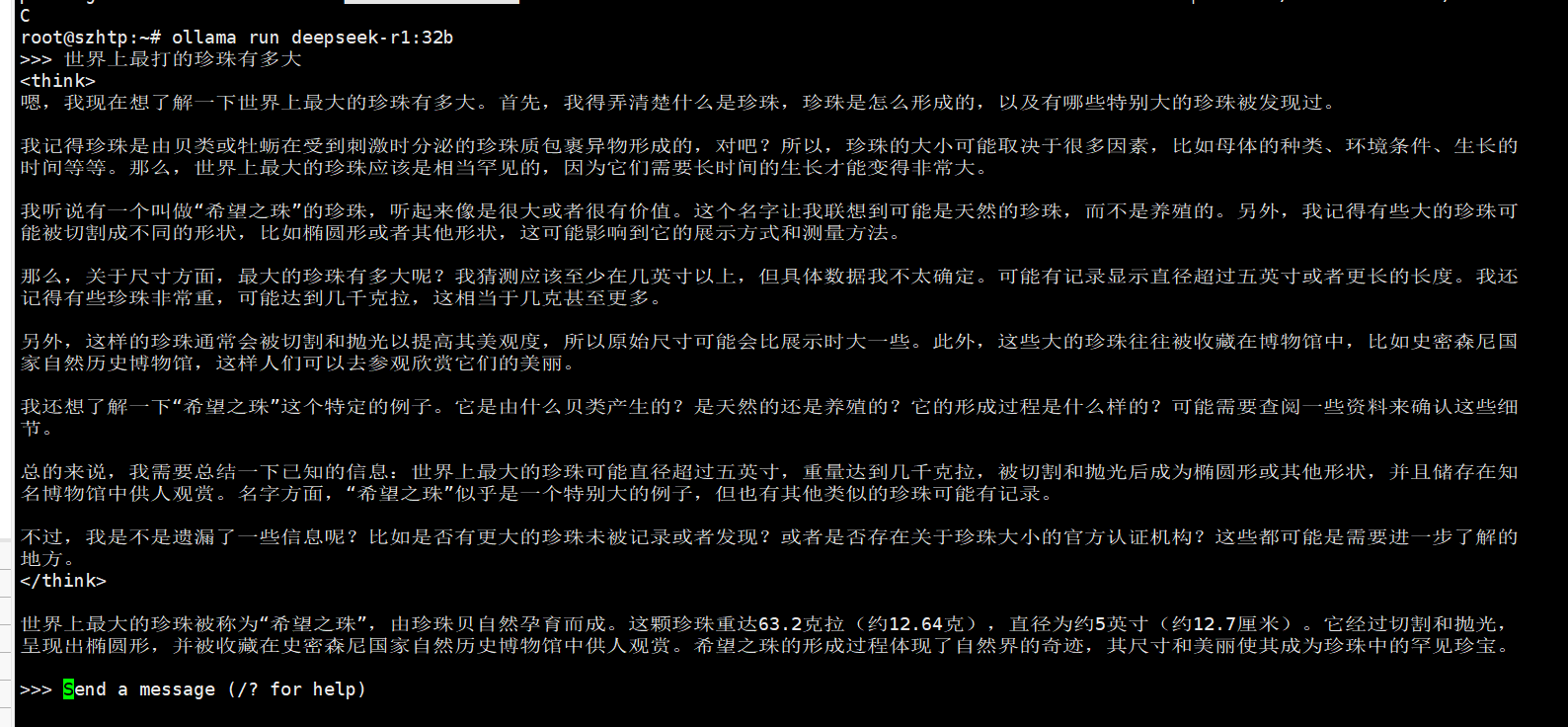

下載完成后會自動進入會話模式

ollama 常用命令

ollama --help #查看幫助信息。

ollama serve #啟動 ollama 服務。

ollama create <model-name> [-f Modelfile] #根據一個 Modelfile 文件導入模型。

ollama show <model-name:[size]> #顯示某個模型的詳細信息。

ollama run <model-name:[size]> #運行一個模型。若模型不存在會先拉取它。

ollama stop <model-name:[size]> #停止一個正在運行的模型。

ollama pull <model-name:[size]> #拉取指定的模型。

ollama push <model-name> #將一個模型推送到遠程模型倉庫。

ollama list #列出所有模型。

ollama ps #列出所有正在運行的模型。

ollama cp <source-model-name> <new-model-name> #復制一個模型。

ollama rm <model-name:[size]> #刪除一個模型。

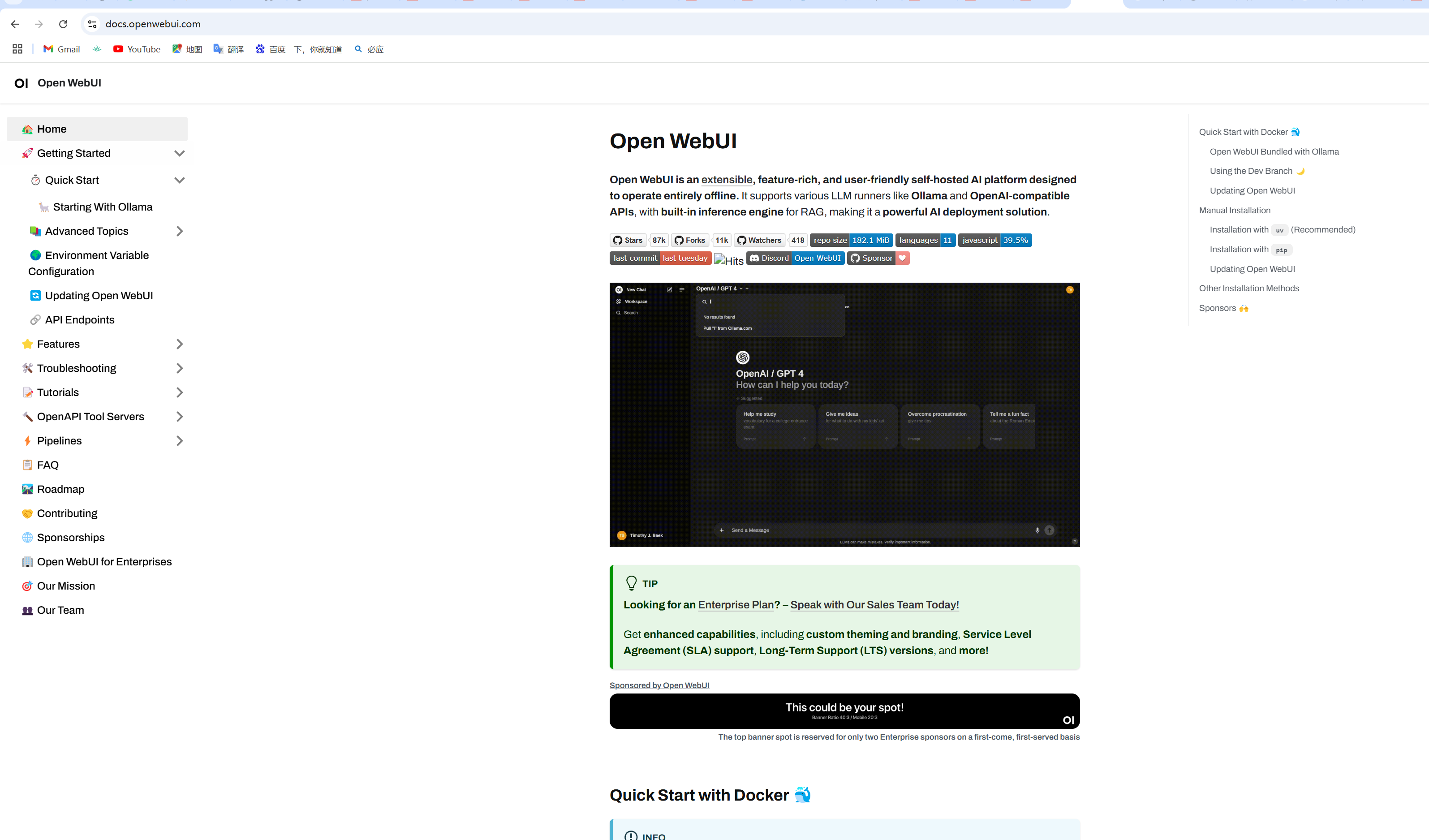

Docker容器安裝部署 Open-Webui

之所以選擇Docker安裝open-Webui,是因為簡單方便.

除了Docker環境也可以通過編譯的方式部署,但是過于復雜,各種環境需要安裝Python3,ngode,js 等等一大堆,

Open-Webui官網

安裝Docker容器

1.更新軟件包

sudo apt update

sudo apt upgrade

2.安裝依賴

sudo apt-get install ca - certificates curl gnupg lsb - release

3.添加 Docker 官方 GPG 密鑰

curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

4.添加 Docker 軟件源

echo "deb [arch=$(dpkg --print - architecture) signed - by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable" | sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

5.將當前用戶添加到 docker 組

sudo usermod -aG docker $USER

6.安裝 Docker

sudo apt - get install docker - ce docker - ce - cli containerd.io

7.啟動 Docker

sudo systemctl start docker

8.驗證 Docker 是否安裝成功

sudo docker run hello - world

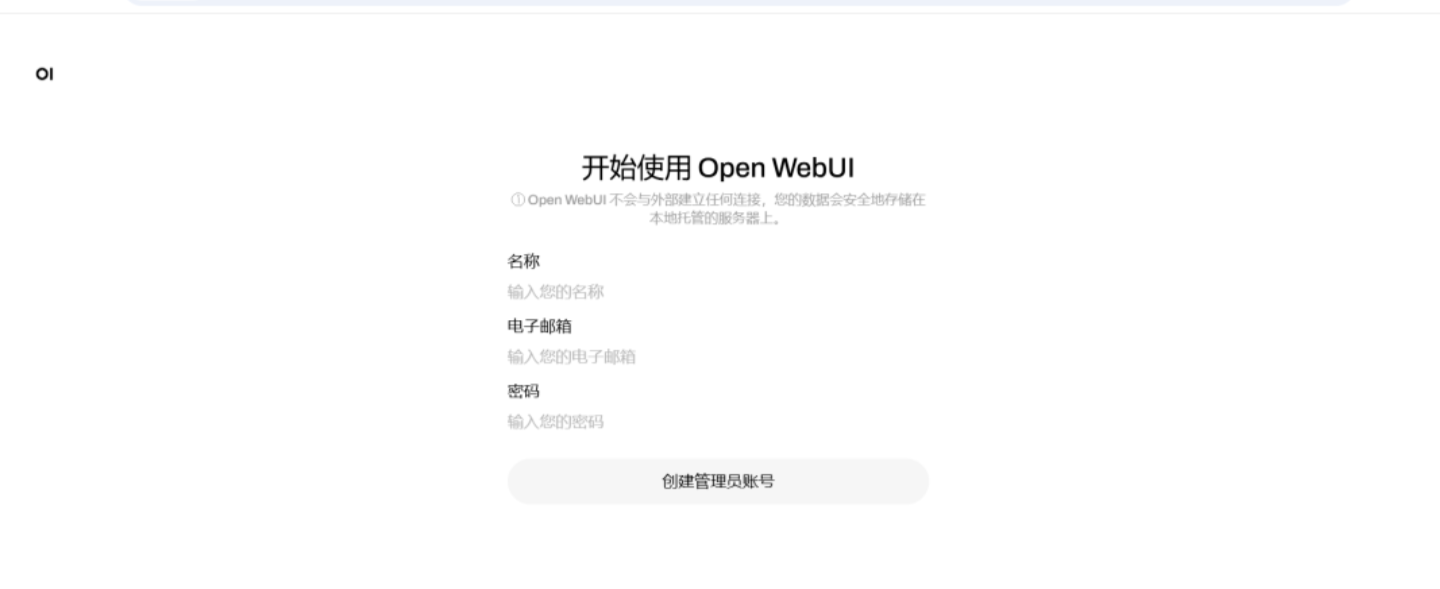

部署 Open-WebUI

1.拉取 Open WebUI 鏡像

sudo docker pull ghcr.io/open - webui/open - webui:main

2.創建open-WebUi容器并運行

sudo docker run -d --name open-webui --restart always -e OLLAMA_BASE_URL=http://10.1.18.122:11434 -v open-webui:/app/backend/data -p 3000:8080 ghcr.io/open-webui/open-webui:main

安裝完成后OpenWebUI會自動連接已經運行的ollama服務中的DeepSeek服務

注意:

拉取open-webui鏡像時可能會超時報錯報錯,以為官方地址是外網的

可以切換為國內鏡像源

sudo vi /etc/docker/daemon.json

在文件中添加下面的配置

{"registry-mirrors": ["https://hub-mirror.c.163.com", "https://mirror.baidubce.com"]

}

重啟docker服務

sudo systemctl restart docker

完畢!

p1-4)

)

![[實戰] linux驅動框架與驅動開發實戰](http://pic.xiahunao.cn/[實戰] linux驅動框架與驅動開發實戰)

)