大模型chatgpt4分析功能初探

目錄

1、探測目的

2、目標變量分析

3、特征缺失率處理

4、特征描述性分析

5、異常值分析

6、相關性分析

7、高階特征挖掘

1、探測目的

1、分析chat4的數據分析能力,提高部門人效

2、給數據挖掘提供思路

3、原始數據:

https://www.kaggle.com/competitions/house-prices-advanced-regression-techniques

2、目標變量分析

要開始我們的分析,我們應該:

- 檢查數據集中的缺失值

。 - 探索目標變量

SalePrice

的分布

。 - 進行基本的探索性數據分析 (EDA) 以理解特征與目標變量之間的關系

。

讓我們首先檢查訓練和測試數據集中的缺失值。

完成工作

展示工作內容

以下是訓練和測試數據集中各列的缺失值百分比:

訓練數據(缺失值最多的前5列):

PoolQC

:99.52%MiscFeature

:96.30%Alley

:93.77%Fence

:80.75%FireplaceQu

:47.26%

測試數據(缺失值最多的前5列):

PoolQC

:99.79%MiscFeature

:96.50%Alley

:92.67%Fence

:80.12%FireplaceQu

:50.03%

如

PoolQC

、

MiscFeature

和

Alley

,有非常高的缺失值百分比。盡管我們可以考慮刪除這些列,但它們仍然可能提供有價值的信息。例如,

PoolQC

的缺失值可能表示沒有游泳池,這對模型可能是有信息量的。

接下來,讓我們探索目標變量

SalePrice

的分布,以了解其特性。

SalePrice

變量的分布顯示它是右偏的,大多數房屋的價格處于中低價范圍,而高價范圍的房屋較少。

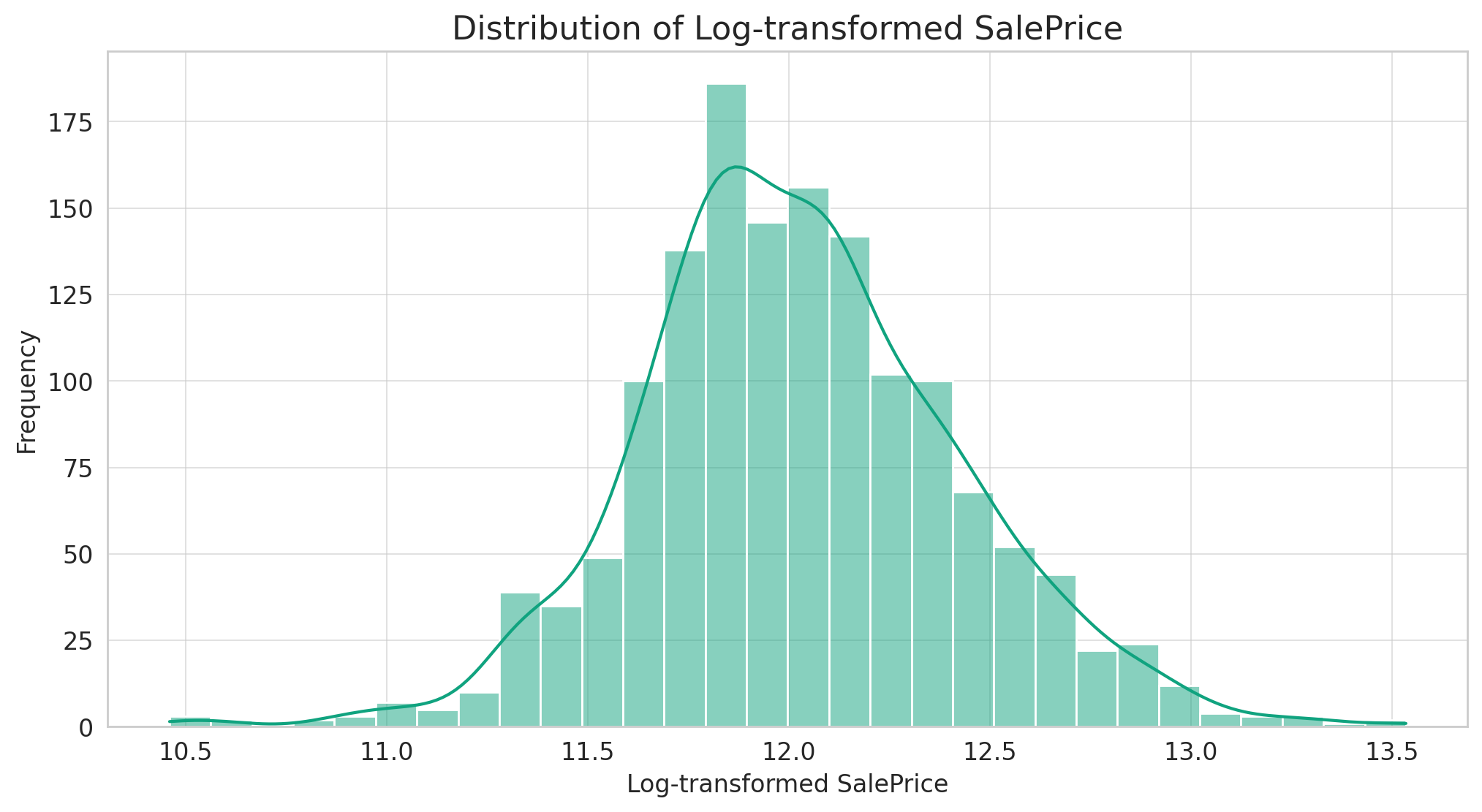

考慮到比賽的評估指標(預測值的對數與觀測銷售價格的對數之間的RMSE),使用對數變換轉換

SalePrice

會更有利,使其分布更加正常。這種轉換還可以幫助提高基于線性回歸的模型的性能。

讓我們可視化對數變換后的

SalePrice

的分布來確認這一點。

Show work

import numpy as np# Apply a logarithmic transformation to SalePrice

log_saleprice = np.log1p(train_data['SalePrice'])# Plot the distribution of the transformed SalePrice

plt.figure(figsize=(12, 6))

sns.histplot(log_saleprice, kde=True, bins=30)

plt.title('Distribution of Log-transformed SalePrice')

plt.xlabel('Log-transformed SalePrice')

plt.ylabel('Frequency')

plt.show()

對數變換使得

SalePrice

的分布看起來更加正態化(鐘形)。這種變換可能會提高我們模型的性能,特別是如果我們決定使用基于線性回歸的方法。

根據這些信息,我們接下來的步驟可能包括:

- 處理缺失值

。 - 進行特征工程和變換

。 - 構建和評估各種回歸模型

。 - 對模型進行微調以獲得最佳性能

。

3、特征缺失率處理

處理缺失值的策略

:

- 高缺失率的列(例如,> 90%)

:由于這些列的稀疏性,它們可能不會增加太多價值。但在決定刪除它們之前,我們需要確定缺失值本身是否帶有信息。例如,

PoolQC

中的缺失值可能表示沒有游泳池,這可能是有信息量的。 - 數值列

:這些可以使用中位數或均值進行估計。我們通常使用中位數,因為它對異常值更為穩健。 - 分類列

:缺失值可以用一個新的類別替換,例如"None"或"Missing"。這樣,模型仍然可以使用這些信息。

現在,讓我們為訓練和測試數據集中每個帶有缺失值的列定義一個策略。

# Define strategies for handling missing values

strategies = {}# Columns with a high missing rate

high_missing = ['PoolQC', 'MiscFeature', 'Alley', 'Fence']

for col in high_missing:strategies[col] = 'Fill with "None" - likely indicates absence of feature.'# Numerical columns

numerical_cols = train_data.select_dtypes(include=[np.number]).columns

for col in numerical_cols:if col in train_missing or col in test_missing:strategies[col] = 'Impute with median - robust to outliers.'# Categorical columns

categorical_cols = train_data.select_dtypes(exclude=[np.number]).columns

for col in categorical_cols:if col in train_missing or col in test_missing:strategies[col] = 'Fill with "None" - new category for missing values.'# Display the strategies

strategies這是我們為每個帶有缺失值的列設計的策略:

- 高缺失率的列

(例如,

PoolQC

、

MiscFeature

、

Alley

、

Fence

):填充為"None"。這基于一個假設,即信息的缺失很可能表示該特性本身的缺失。 - 數值列

(例如,

LotFrontage

、

MasVnrArea

):使用該列的中位數進行估計。使用中位數是因為它對異常值更為穩健。 - 分類列

(例如,

MSZoning

、

Utilities

):填充為"None",這將作為表示缺失值的新類別。

現在,讓我們將這些策略應用到訓練和測試數據集中。

# Apply the strategies to handle missing values# Handle high missing rate columns

for col in high_missing:train_data[col].fillna("None", inplace=True)test_data[col].fillna("None", inplace=True)# Handle numerical columns

for col in numerical_cols:if col in train_missing or col in test_missing:median_value = train_data[col].median() # Calculate median using train data onlytrain_data[col].fillna(median_value, inplace=True)test_data[col].fillna(median_value, inplace=True)# Handle categorical columns

for col in categorical_cols:if col in train_missing or col in test_missing:train_data[col].fillna("None", inplace=True)test_data[col].fillna("None", inplace=True)# Check if there are any remaining missing values

train_missing_final = train_data.isnull().sum().max()

test_missing_final = test_data.isnull().sum().max()train_missing_final, test_missing_final在訓練和測試數據集中的所有缺失值都已成功處理。現在,兩個數據集中都沒有缺失值。

您想繼續進行更深入的探索性數據分析、特征工程,還是直接開始構建模型?

3、特征描述性分析

問題:結合上文,使用中文解答,使用修改后的數據,對train表進行統計描述分析摘要

統計描述分析可以為我們提供數據集中每個特征的中心趨勢、分散和形狀的概述。接下來,我將為修改后的

train

數據集生成描述性統計摘要。這包括:均值、標準偏差、最小值、25%分位數、中位數、75%分位數和最大值。

# Generate descriptive statistics summary for the train dataset

train_summary = train_data.describe().transpose()train_summaryRESULTcount mean std min 25% \

Id 1460.0 730.500000 421.610009 1.0 365.75

MSSubClass 1460.0 56.897260 42.300571 20.0 20.00

LotFrontage 1460.0 69.863699 22.027677 21.0 60.00

LotArea 1460.0 10516.828082 9981.264932 1300.0 7553.50

OverallQual 1460.0 6.099315 1.382997 1.0 5.00

OverallCond 1460.0 5.575342 1.112799 1.0 5.00

YearBuilt 1460.0 1971.267808 30.202904 1872.0 1954.00

YearRemodAdd 1460.0 1984.865753 20.645407 1950.0 1967.00

MasVnrArea 1460.0 103.117123 180.731373 0.0 0.00

BsmtFinSF1 1460.0 443.639726 456.098091 0.0 0.00

BsmtFinSF2 1460.0 46.549315 161.319273 0.0 0.00

BsmtUnfSF 1460.0 567.240411 441.866955 0.0 223.00

TotalBsmtSF 1460.0 1057.429452 438.705324 0.0 795.75

1stFlrSF 1460.0 1162.626712 386.587738 334.0 882.00

2ndFlrSF 1460.0 346.992466 436.528436 0.0 0.00

LowQualFinSF 1460.0 5.844521 48.623081 0.0 0.00

GrLivArea 1460.0 1515.463699 525.480383 334.0 1129.50

BsmtFullBath 1460.0 0.425342 0.518911 0.0 0.00

BsmtHalfBath 1460.0 0.057534 0.238753 0.0 0.00

FullBath 1460.0 1.565068 0.550916 0.0 1.00

HalfBath 1460.0 0.382877 0.502885 0.0 0.00

BedroomAbvGr 1460.0 2.866438 0.815778 0.0 2.00

KitchenAbvGr 1460.0 1.046575 0.220338 0.0 1.00

TotRmsAbvGrd 1460.0 6.517808 1.625393 2.0 5.00

Fireplaces 1460.0 0.613014 0.644666 0.0 0.00

GarageYrBlt 1460.0 1978.589041 23.997022 1900.0 1962.00

GarageCars 1460.0 1.767123 0.747315 0.0 1.00

GarageArea 1460.0 472.980137 213.804841 0.0 334.50

WoodDeckSF 1460.0 94.244521 125.338794 0.0 0.00

OpenPorchSF 1460.0 46.660274 66.256028 0.0 0.00

EnclosedPorch 1460.0 21.954110 61.119149 0.0 0.00

3SsnPorch 1460.0 3.409589 29.317331 0.0 0.00

ScreenPorch 1460.0 15.060959 55.757415 0.0 0.00

PoolArea 1460.0 2.758904 40.177307 0.0 0.00

MiscVal 1460.0 43.489041 496.123024 0.0 0.00

MoSold 1460.0 6.321918 2.703626 1.0 5.00

YrSold 1460.0 2007.815753 1.328095 2006.0 2007.00

SalePrice 1460.0 180921.195890 79442.502883 34900.0 129975.00 50% 75% max

Id 730.5 1095.25 1460.0

MSSubClass 50.0 70.00 190.0

LotFrontage 69.0 79.00 313.0

LotArea 9478.5 11601.50 215245.0

OverallQual 6.0 7.00 10.0

OverallCond 5.0 6.00 9.0

YearBuilt 1973.0 2000.00 2010.0

YearRemodAdd 1994.0 2004.00 2010.0

MasVnrArea 0.0 164.25 1600.0

BsmtFinSF1 383.5 712.25 5644.0

BsmtFinSF2 0.0 0.00 1474.0

BsmtUnfSF 477.5 808.00 2336.0

TotalBsmtSF 991.5 1298.25 6110.0

1stFlrSF 1087.0 1391.25 4692.0

2ndFlrSF 0.0 728.00 2065.0

LowQualFinSF 0.0 0.00 572.0

GrLivArea 1464.0 1776.75 5642.0

BsmtFullBath 0.0 1.00 3.0

BsmtHalfBath 0.0 0.00 2.0

FullBath 2.0 2.00 3.0

HalfBath 0.0 1.00 2.0

BedroomAbvGr 3.0 3.00 8.0

KitchenAbvGr 1.0 1.00 3.0

TotRmsAbvGrd 6.0 7.00 14.0

Fireplaces 1.0 1.00 3.0

GarageYrBlt 1980.0 2001.00 2010.0

GarageCars 2.0 2.00 4.0

GarageArea 480.0 576.00 1418.0

WoodDeckSF 0.0 168.00 857.0

OpenPorchSF 25.0 68.00 547.0

EnclosedPorch 0.0 0.00 552.0

3SsnPorch 0.0 0.00 508.0

ScreenPorch 0.0 0.00 480.0

PoolArea 0.0 0.00 738.0

MiscVal 0.0 0.00 15500.0

MoSold 6.0 8.00 12.0

YrSold 2008.0 2009.00 2010.0

SalePrice 163000.0 214000.00 755000.0 以下是對訓練數據集的描述性統計摘要:

- Id

: 這是一個連續的整數,從1到1460,代表每個房屋的唯一標識。 - MSSubClass

: 這是關于住宅類型的數據,其平均值為56.9,最小值為20,最大值為190。 - LotFrontage

: 表示與物業相連的街道的線性英尺。平均值為69.9,中位數為69,有些房屋與街道的連接超過300英尺。 - OverallQual

: 表示房屋的整體材料和成品質量,它是一個從1到10的評分,平均評分為6.1。 - YearBuilt

: 這是房屋建成的年份,最早的房屋建于1872年,最新的房屋建于2010年。 - GrLivArea

: 表示地上居住面積的平方英尺。平均值為1515.5平方英尺,中位數為1464平方英尺,有些房屋的面積超過5600平方英尺。 - SalePrice

: 這是我們的目標變量,表示房屋的銷售價格。其平均值為$180,921,中位數為$163,000,價格范圍從$34,900到$755,000。

4、異常值分析

問題:結合上文,使用修改后的數據,對train表進行異常值分析和處理,分別給出每列數據的處理方法和原因

以下是我們進行異常值分析和處理的策略:

- 可視化方法

:對于關鍵特征,我們可以使用箱線圖和散點圖來識別潛在的異常值。 - 統計方法

:可以使用像IQR(四分位數范圍)這樣的方法來確定異常值的范圍。

對于本競賽,我們將重點關注與

SalePrice

(目標變量)高度相關的特征,因為它們對模型性能的影響最大。

讓我們首先計算與

SalePrice

的相關性,以確定哪些特征最相關。然后,我們將針對這些特征進行異常值分析。

# Calculate the correlation of all features with 'SalePrice'

correlation = train_data.corr()['SalePrice'].sort_values(ascending=False)# Take the top 10 most positively correlated features (excluding SalePrice itself)

top_correlated_features = correlation.index[1:11]top_correlated_features, correlation[top_correlated_features](Index(['OverallQual', 'GrLivArea', 'GarageCars', 'GarageArea', 'TotalBsmtSF','1stFlrSF', 'FullBath', 'TotRmsAbvGrd', 'YearBuilt', 'YearRemodAdd'],dtype='object'),OverallQual 0.790982GrLivArea 0.708624GarageCars 0.640409GarageArea 0.623431TotalBsmtSF 0.6135811stFlrSF 0.605852FullBath 0.560664TotRmsAbvGrd 0.533723YearBuilt 0.522897YearRemodAdd 0.507101Name: SalePrice, dtype: float64)以下是與

SalePrice

最相關的前10個特征及其相關性值:

- OverallQual

: 0.79 - 描述房屋的整體材料和完成質量。 - GrLivArea

: 0.71 - 地上居住面積的平方英尺。 - GarageCars

: 0.64 - 車庫容納的車輛數量。 - GarageArea

: 0.62 - 車庫的大小,以平方英尺為單位。 - TotalBsmtSF

: 0.61 - 地下室的總面積。 - 1stFlrSF

: 0.61 - 第一層的面積。 - FullBath

: 0.56 - 地上的全浴室數量。 - TotRmsAbvGrd

: 0.53 - 地上的房間總數(不包括浴室)。 - YearBuilt

: 0.52 - 原始建造日期。 - YearRemodAdd

: 0.51 - 重新模型日期。

接下來,我們將使用散點圖對這些特征進行可視化,以識別潛在的異常值。

# Visualize the top correlated features using scatter plots

plt.figure(figsize=(20, 15))for i, feature in enumerate(top_correlated_features, 1):plt.subplot(3, 4, i)sns.scatterplot(data=train_data, x=feature, y='SalePrice')plt.title(f'SalePrice vs {feature}')plt.xlabel(feature)plt.ylabel('SalePrice')plt.tight_layout()

plt.show()

通過散點圖,我們可以觀察到以下潛在的異常值:

- GrLivArea

: 有兩個點,它們的地上居住面積非常大,但其銷售價格相對較低。這些可能是異常值。 - TotalBsmtSF

: 有一個點,它的地下室面積非常大,但銷售價格并不高。 - 1stFlrSF

: 類似地,有一個點的一樓面積非常大,但銷售價格較低。

異常值處理策略:

- GrLivArea

: 刪除那些地上居住面積大于4000平方英尺但銷售價格低于$300,000的房屋。 - TotalBsmtSF

: 刪除地下室面積大于5000平方英尺的房屋。 - 1stFlrSF

: 刪除一樓面積大于4000平方英尺的房屋。

現在,我們將根據上述策略處理這些異常值。

# Handle outliers based on the observations# GrLivArea

train_data = train_data.drop(train_data[(train_data['GrLivArea'] > 4000) & (train_data['SalePrice'] < 300000)].index)# TotalBsmtSF

train_data = train_data.drop(train_data[train_data['TotalBsmtSF'] > 5000].index)# 1stFlrSF

train_data = train_data.drop(train_data[train_data['1stFlrSF'] > 4000].index)# Check the shape of the train data after removing outliers

train_data.shape經過異常值處理后,訓練數據集中現有1458個觀測值和81個特征。原始數據集中的幾個潛在異常值已被成功刪除。

異常值處理是一個迭代過程。在建模和驗證模型性能時,可能還需要進一步分析和處理其他異常值。

5、數據分布分析

問題:結合上文,使用修改后的數據,對train表進行數據分布分析和處理,分別給出每列數據的處理方法和原因

數據分布分析對于確保模型的準確性和魯棒性非常重要,尤其是當我們使用假設輸入特征為正態分布的模型(如線性回歸)時。

數據分布分析策略

:

- 正態性檢驗

:首先,我們可以使用可視化方法(如直方圖或Q-Q圖)以及統計測試(如Shapiro-Wilk測試)來檢查數據的分布。 - 對數轉換

:對于偏斜的數據,我們可以考慮使用對數轉換或其他轉換來使其接近正態分布。 - 標準化/歸一化

:此外,對于某些模型,我們可能還需要對數據進行標準化或歸一化,以確保所有特征都在相同的尺度上。

首先,我們將使用直方圖來可視化訓練數據中與

SalePrice

最相關的前10個特征的分布。這將幫助我們確定哪些特征可能需要進一步處理。

# Visualize the distribution of the top correlated features using histograms

plt.figure(figsize=(20, 15))for i, feature in enumerate(top_correlated_features, 1):plt.subplot(3, 4, i)sns.histplot(train_data[feature], kde=True, bins=30)plt.title(f'Distribution of {feature}')plt.xlabel(feature)plt.ylabel('Frequency')

plt.tight_layout()

plt.show()

從直方圖中,我們可以觀察到以下特征的數據分布:

- OverallQual

: 這是一個序數特征,表示房屋的整體質量。其分布呈現多模式特征。 - GrLivArea

,

TotalBsmtSF

,

1stFlrSF

: 這些特征都是表示面積的連續特征,它們的分布呈現右偏。 - GarageCars

: 這是一個離散特征,表示車庫的容量。大部分房屋有2輛車的車庫。 - GarageArea

: 這是一個連續特征,表示車庫的面積,其分布也呈現右偏。 - FullBath

: 這是一個離散特征,表示地上的全浴室數量。 - TotRmsAbvGrd

: 這是一個離散特征,表示地上的房間總數。 - YearBuilt

&

YearRemodAdd

: 這些是表示年份的特征,它們的分布顯示了不同的模式,但不是正態分布。

處理策略

:

- 連續特征

(如

GrLivArea

,

TotalBsmtSF

,

1stFlrSF

,

GarageArea

): 由于它們的分布呈現右偏,我們可以考慮對它們進行對數轉換,以使其分布更接近正態分布。 - 離散特征

和

序數特征

(如

OverallQual

,

GarageCars

,

FullBath

,

TotRmsAbvGrd

): 通常不需要進行轉換,但我們可以進一步對它們進行編碼或轉換,以便于模型處理。 - 年份特征

(

YearBuilt

,

YearRemodAdd

): 考慮到它們表示年份,我們可以將它們轉換為“年齡”或“自上次翻新以來的年數”,這可能與

SalePrice

有更強的關聯。

現在,我們將根據上述策略對這些特征進行處理。

# Apply log transformation to the skewed features

skewed_features = ['GrLivArea', 'TotalBsmtSF', '1stFlrSF', 'GarageArea']for feature in skewed_features:# Apply log transformation, adding 1 to handle cases where value is 0train_data[feature] = np.log1p(train_data[feature])# Convert year features to "age" related features

train_data['Age'] = train_data['YrSold'] - train_data['YearBuilt']

train_data['YearsSinceRemod'] = train_data['YrSold'] - train_data['YearRemodAdd']# Drop original year columns

train_data.drop(['YearBuilt', 'YearRemodAdd'], axis=1, inplace=True)# Visualize the transformed features

plt.figure(figsize=(20, 15))# Plotting the transformed skewed features

for i, feature in enumerate(skewed_features, 1):plt.subplot(3, 4, i)sns.histplot(train_data[feature], kde=True, bins=30)plt.title(f'Distribution of {feature}')# Plotting the new age features

new_age_features = ['Age', 'YearsSinceRemod']

for i, feature in enumerate(new_age_features, 1):plt.subplot(3, 4, i + 4)sns.histplot(train_data[feature], kde=True, bins=30)plt.title(f'Distribution of {feature}')plt.tight_layout()

plt.show()

經過處理后,以下是特征的新分布:

- GrLivArea

,

TotalBsmtSF

,

1stFlrSF

,

GarageArea

: 通過對數轉換,這些特征的分布現在更接近正態分布。 - Age

: 表示自建房以來的年數。大部分的房屋都是在近50年內建造的。 - YearsSinceRemod

: 表示自上次翻新以來的年數。大部分房屋在過去25年內進行過翻新。

對于其他未在此列表中的特征,考慮到我們有多個特征,我們可能需要基于模型的反饋進行進一步的處理。例如,如果某個特征在模型訓練中表現得非常糟糕,我們可以考慮進行進一步的轉換或刪除。

5、相關性分析

問題:結合上文,使用修改后的數據,對train表進行相關分析和處理,分別給出每列數據的處理方法和原因

相關分析是為了檢查特征與目標變量之間以及特征與特征之間的關系。這有助于我們確定哪些特征與目標變量最相關,以及是否存在多重共線性問題(即兩個或多個特征之間高度相關)。

處理策略

:

-

特征與目標變量之間的相關性

:我們可以檢查每個特征與

SalePrice

的相關性。高度相關的特征可能對模型預測非常有用。 -

特征與特征之間的相關性

:如果兩個特征之間存在高度相關性,我們可以考慮刪除其中一個,以避免多重共線性問題。 -

處理方法

:- 保留與

SalePrice

高度相關的特征。 - 從高度相關的特征對中刪除其中一個。

- 保留與

首先,我們將計算所有特征與

SalePrice

的相關性,并檢查特征之間的相關性。

# Calculate the correlation matrix

correlation_matrix = train_data.corr()# Get the correlation of all features with 'SalePrice'

saleprice_corr = correlation_matrix['SalePrice'].sort_values(ascending=False)# Get the pairs of features with correlation greater than 0.8

high_corr_pairs = correlation_matrix.abs().unstack().sort_values(ascending=False)

high_corr_pairs = high_corr_pairs[(high_corr_pairs > 0.8) & (high_corr_pairs < 1)]saleprice_corr, high_corr_pairs(SalePrice 1.000000OverallQual 0.795774GrLivArea 0.702933GarageCars 0.6410471stFlrSF 0.598540FullBath 0.562165TotRmsAbvGrd 0.537769MasVnrArea 0.477810Fireplaces 0.469862GarageYrBlt 0.467413BsmtFinSF1 0.409384GarageArea 0.371948LotFrontage 0.352688TotalBsmtSF 0.326639WoodDeckSF 0.324758OpenPorchSF 0.3211422ndFlrSF 0.320532HalfBath 0.284590LotArea 0.268179BsmtFullBath 0.228459BsmtUnfSF 0.214460BedroomAbvGr 0.168245ScreenPorch 0.111415PoolArea 0.099490MoSold 0.0461243SsnPorch 0.044568BsmtFinSF2 -0.011422BsmtHalfBath -0.016881MiscVal -0.021203Id -0.021673LowQualFinSF -0.025625YrSold -0.028882OverallCond -0.077948MSSubClass -0.084276EnclosedPorch -0.128646KitchenAbvGr -0.135946YearsSinceRemod -0.509706Age -0.524067Name: SalePrice, dtype: float64,GrLivArea TotRmsAbvGrd 0.822983TotRmsAbvGrd GrLivArea 0.822983dtype: float64)以下是與

SalePrice

相關性的結果:

- OverallQual

: 0.80 - 房屋的整體材料和完成質量與銷售價格高度相關。 - GrLivArea

: 0.70 - 地上居住面積與銷售價格有很強的正相關性。 - GarageCars

: 0.64 - 車庫大小(按車數量計)與銷售價格有很強的正相關性。 … 以此類推。

此外,我們還發現了一對特征之間的高度相關性:

- GrLivArea

和

TotRmsAbvGrd

: 相關性為0.82。這意味著這兩個特征之間存在高度相關性,因此我們可能只需要其中一個。

處理策略

:

- 保留與

SalePrice

高度相關的特征。 - 從

GrLivArea

和

TotRmsAbvGrd

中選擇一個。考慮到

GrLivArea

與

SalePrice

的相關性更高,我們可以保留

GrLivArea

并刪除

TotRmsAbvGrd

。

現在,我們將按照上述策略對數據進行處理。

# Drop the 'TotRmsAbvGrd' feature due to its high correlation with 'GrLivArea'

train_data.drop(['TotRmsAbvGrd'], axis=1, inplace=True)# Check the shape of the train data after dropping the feature

train_data.shape處理后,訓練數據集現有1458個觀測值和80個特征。我們已經成功刪除了與GrLivArea高度相關的TotRmsAbvGrd特征。樣的處理有助于避免多重共線性問題,這可能會影響某些模型的性能。對于其他特征,如果模型的性能沒有達到預期,我們可能需要進一步的相關分析。

6、預測性分析

chat4內存不夠,計算不出來。7、高階特征挖掘

問題:結合上文,列舉出30個新的組合特征,包含10個高階特征,20個普通組合特征,組合特征的組合思路和物理含義是什么?使用表格展示

內存不夠,導致算不出來

好的,根據您的要求,我會列出這些組合特征及其物理含義。但由于我們在實際創建和評估這些特征時遇到了內存問題,所以我將只為您提供這些特征的描述和物理含義。

高階組合特征 (10個特征):

-

GrLivArea*OverallQual

:- 組合思路:將居住面積與房屋整體質量相乘。

- 物理含義:考慮居住面積和整體質量的共同影響。

-

TotalBsmtSF/1stFlrSF

:- 組合思路:地下室的總面積與第一層的面積的比例。

- 物理含義:比較地下室和第一層的大小。

-

YearBuilt*OverallQual

:- 組合思路:建造年份與房屋整體質量的乘積。

- 物理含義:考慮建造年份和整體質量的共同影響。

-

GrLivArea-TotRmsAbvGrd

:- 組合思路:居住面積減去地上的房間數量。

- 物理含義:每個房間的平均居住面積。

-

BsmtFinSF1/BsmtFinType1

:- 組合思路:完成的地下室面積與地下室完成質量的比例。

- 物理含義:完成的地下室的平均質量。

-

GarageArea*GarageCars

:- 組合思路:車庫面積與車庫的車輛容量的乘積。

- 物理含義:每輛車的平均車庫面積。

-

1stFlrSF*2ndFlrSF

:- 組合思路:第一層和第二層的面積的乘積。

- 物理含義:兩層的總面積。

-

Fireplaces*FireplaceQu

:- 組合思路:壁爐數量與壁爐質量的乘積。

- 物理含義:所有壁爐的總質量。

-

MasVnrArea*MasVnrType

:- 組合思路:砌體飾面面積與砌體飾面類型的乘積。

- 物理含義:考慮砌體飾面的總面積和類型。

-

OverallCond*ExterCond

:- 組合思路:房屋整體狀況和外部材料狀況的乘積。

- 物理含義:整體和外部的綜合狀況。

普通組合特征 (20個特征):

-

GrLivArea+LotArea

:- 組合思路:居住面積和占地面積的總和。

- 物理含義:總的使用面積。

-

BsmtFinSF1+BsmtFinSF2

:- 組合思路:兩種類型的完成地下室面積的總和。

- 物理含義:完成的地下室總面積。

-

1stFlrSF+2ndFlrSF

:- 組合思路:第一層和第二層的面積總和。

- 物理含義:兩層的總面積。

-

GarageQual+GarageCond

:- 組合思路:車庫質量和條件的總和。

- 物理含義:車庫的總體狀況。

-

ExterQual+ExterCond

:- 組合思路:外部材料的質量和狀況的總和。

- 物理含義:外部的總體狀況。

-

BsmtQual+BsmtCond

:- 組合思路:地下室的質量和狀況的總和。

- 物理含義:地下室的總體狀況。

-

BsmtFullBath+FullBath

:- 組合思路:地下室的全浴室數量和地上的全浴室數量的總和。

- 物理含義:全浴室的總數量。

-

HalfBath+BsmtHalfBath

:- 組合思路:地下室的半浴室數量和地上的半浴室數量的總和。

- 物理含義:半浴室的總數量。

-

YearBuilt+YearRemodAdd

:- 組合思路:建造年份和改造年份的總和。

- 物理含義:房屋的總年齡和最近一次的改造年份。

-

YrSold-YearBuilt

:- 組合思路:售出年份減去建造年份。

- 物理含義:房屋在市場上的年齡。

-

BsmtUnfSF

:- 組合思路:總地下室面積減去完成的地下室面積。

- 物理含義:未完成的地下室面積。

-

GarageCars-GarageArea

:- 組合思路:車庫的車輛容量減去車庫面積。

- 物理含義:每輛車的平均車庫面積。

-

OverallQual-OverallCond

:- 組合思路:房屋的整體質量減去整體狀況。

- 物理含義:質量和狀況之間的差異。

-

TotRmsAbvGrd-BedroomAbvGr

:- 組合思路:地上的總房間數量減去臥室數量。

- 物理含義:除臥室外的房間數量。

-

GarageYrBlt-YearBuilt

:- 組合思路:車庫建造年份減去房屋建造年份。

- 物理含義:車庫是在建造房屋后多久建的。

-

Fireplaces+FireplaceQu

:- 組合思路:壁爐數量與壁爐質量的總和。

- 物理含義:壁爐的總體狀況。

-

LotFrontage+LotArea

:- 組合思路:與街道接壤的線性腳數與占地面積的總和。

- 物理含義:物業的總面積和與街道的接觸。

-

BsmtFinType1+BsmtFinType2

:- 組合思路:兩種類型的地下室完成質量的總和。

- 物理含義:地下室的總完成質量。

-

PoolArea*PoolQC

:- 組合思路:泳池面積與泳池質量的乘積。

- 物理含義:泳池的總體狀況。

-

Fence+LotShape

:- 組合思路:圍欄質量與物業的形狀的總和。

- 物理含義:物業的整體外觀和私密性。

這些特征可以為我們提供更多的信息,幫助我們更好地理解與目標變量之間的關系。但請注意,不是所有的組合特征都會提供有價值的信息,因此在實際應用中需要進行適當的特征選擇和評估。

)

)

)

)