摘要

一 介紹

問題一:以往的研究嘗試利用相關圖像之間的一致性,通過探索不同的共享線索[12, 13, 14]或語義連接[15, 16, 17],來助力圖像組內的共同顯著目標檢測(CoSOD),什么意思?

一方面是探索不同的 “共享線索”,這里的共享線索可以理解為在這組相關圖像中,共同顯著目標所具有的一些共通的、可被檢測和利用的特征或信息線索,比如顏色特征、紋理特征等方面的共性線索。

另一方面是探索 “語義連接”,語義連接指的是從語義層面上去挖掘圖像之間的聯系,比如這些圖像中共同顯著目標在語義概念上的關聯,像它們都屬于某一個特定的語義類別,或者它們在語義上存在某種邏輯關系等,通過這種語義連接的探索來助力共同顯著目標檢測任務。

二 有關工作

問題一:而共同顯著目標檢測(CoSOD)則旨在分割幾張相關圖像中的共同顯著目標。 以往的研究主要利用圖像間的線索來檢測共同顯著目標。圖像間的線索是什么?

在共同顯著目標檢測(CoSOD)任務中,??圖像間的線索(Inter-image Cues)?? 是指從多張相關圖像中提取的、能夠幫助模型識別和定位共同顯著目標的關聯性信息。

??1. 視覺相似性(Visual Similarity)

2. 語義一致性(Semantic Consistency)

?3. 共現模式(Co-occurrence Patterns)?

4. 對比性線索(Contrastive Cues)

??5. 幾何對應(Geometric Correspondence)

6. 時序或上下文關聯(Temporal/Contextual Relations)?

7. 以往研究的典型方法??

-

??傳統方法??:

-

??低層特征聚類??:如[Li et al. 2014]利用顏色直方圖和區域聚類。

-

??圖模型??:如[Zhang et al. 2016]構建圖像間的馬爾可夫隨機場(MRF)。

-

-

??深度學習方法??:

-

??注意力機制??:如GCoNet中的組內協作模塊(GAM)通過非局部注意力捕捉共性。

-

??記憶庫??:如MCLNet通過記憶原型存儲類別特征,增強跨圖像檢索能力。

-

總結??

圖像間線索是CoSOD任務的核心,本質是通過??跨圖像關聯性分析??從冗余信息中定位共性目標。當前研究正從傳統特征匹配轉向深度語義建模,結合對比學習和幾何對齊進一步提升魯棒性。

三 小組協作學習網絡

3.1?體系結構概述

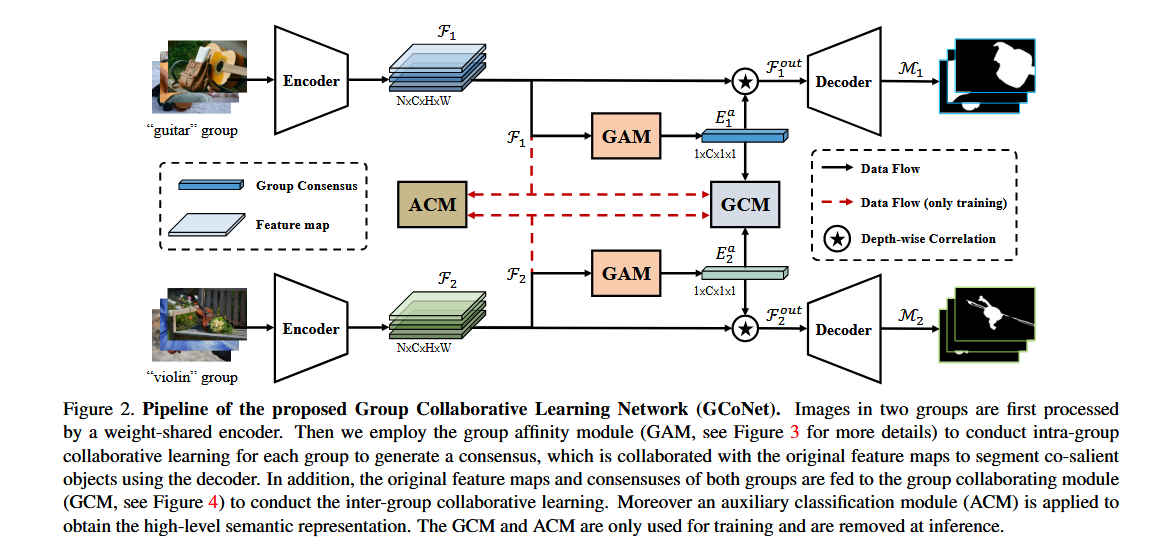

圖2. 所提出的群體協作學習網絡(GCoNet)的流程。首先,兩個圖像組中的圖像由一個權重共享的編碼器進行處理。然后,我們使用群體親和模塊(GAM,更多細節見圖3)對每個圖像組進行組內協作學習,以生成一種一致性表示。這種一致性表示會與原始特征圖相結合,通過解碼器來分割出共同顯著目標。 此外,兩個圖像組的原始特征圖和一致性表示會被輸入到群體協作模塊(GCM,見圖4)中,以進行組間協作學習。而且,會應用一個輔助分類模塊(ACM)來獲取高級語義表示。群體協作模塊(GCM)和輔助分類模塊(ACM)僅用于訓練階段,在推理階段會被移除。

問題一:詳細解釋一下這張圖?

這張圖展示了 ??組協作學習網絡(GCoNet)?? 的完整流程,其核心是通過 ??組內協作(GAM)?? 和 ??組間協作(GCM)?? 學習共顯著目標的共性特征,最終生成分割掩碼。以下是基于圖中信息的逐步解析:

??1. 輸入與編碼器(Encoder)??

- ??輸入圖像組??:圖中示例為兩組圖像:

"guitar"組?和?"violin"組,每組包含多張同類別的圖像(如不同角度/背景的吉他或小提琴)。 - ??權重共享編碼器??:

- 兩組圖像通過同一個 ??共享權重的編碼器??(如VGG16或ResNet)提取特征,生成原始特征圖?F1??和?F2?(尺寸:C×H×W)。

- ??目的??:確保不同組的特征空間一致,便于后續協作學習。

??2. 組內協作學習(GAM: Group Affinity Module)??

- ??功能??:

對每組圖像內部的特征進行融合,生成 ??組共識特征圖??(Group Consensus Feature Map),捕捉組內共顯著目標的共性。 - ??流程??:

- ??輸入??:原始特征圖?F1?(吉他組)和?F2?(小提琴組)。

- ??組內特征融合??:

- 通過 ??深度相關性(Depth-wise Correlation)?? 計算組內圖像特征間的相似性,篩選出共性強的高響應區域。

- 生成共識特征圖?F1′?(吉他組)和?F2′?(小提琴組)。

- ??輸出??:每組一個統一的共識特征圖,抑制組內非共性的背景噪聲。

??3. 組間協作學習(GCM: Group Collaborative Module)??

- ??功能??:

利用兩組共識特征圖?F1′??和?F2′??進行 ??跨組對比學習??,強化共顯著目標的判別性特征。 - ??流程??:

- ??輸入??:原始特征圖?F1?,F2??+ 共識特征圖?F1′?,F2′?。

- ??跨組交互??:

- 通過注意力機制或特征對比,讓模型學習“吉他”和“小提琴”組的 ??差異特征??(如形狀、紋理),避免將不同類別的物體誤判為共顯著。

- 輸出優化后的特征?Fout?。

- ??注意??:GCM ??僅在訓練時使用??,推理時移除,以提升效率。

??4. 輔助分類模塊(ACM: Auxiliary Classification Module)??

- ??功能??:

通過高層語義分類(如“吉他” vs “小提琴”)約束特征學習,增強共顯著目標的語義一致性。 - ??實現??:

- 在共識特征圖?F1′??和?F2′??上附加分類頭(全連接層+Softmax),預測圖像組類別。

- ??損失函數??:交叉熵損失,與分割任務聯合訓練。

- ??作用??:防止模型將不同類別的共性背景(如舞臺、燈光)誤判為共顯著目標。

??5. 解碼器(Decoder)與輸出??

- ??輸入??:

- 訓練時:融合后的特征?Fout?(含GCM優化)。

- 推理時:僅使用組共識特征圖?F1′??或?F2′?。

- ??解碼器結構??:

- 通過上采樣和跳躍連接(可能來自編碼器的低層特征)逐步恢復空間分辨率。

- 輸出分割掩碼?M1?(吉他組)和?M2?(小提琴組),尺寸與輸入圖像相同。

??6. 數據流與訓練/推理區別??

- ??數據流標注??:

- ??藍色實線??:訓練和推理均存在的數據流(如編碼器→GAM→解碼器)。

- ??紅色虛線??:僅訓練時的數據流(GCM和ACM)。

- ??關鍵設計??:

- 訓練時通過 ??跨組對比(GCM)?? 和 ??語義監督(ACM)?? 提升模型魯棒性,推理時簡化流程,僅保留組內協作(GAM)。

??7. 核心創新點總結??

- ??組內協作(GAM)??:通過深度相關性生成共識特征,解決組內圖像差異問題(如視角變化)。

- ??組間協作(GCM)??:跨組對比學習,避免不同類別間的共性干擾(如樂器 vs 背景)。

- ??端到端訓練??:聯合優化分割損失(如IoU Loss)和分類損失(ACM),提升語義一致性。

3.2 小組親和力模塊

問題一:群體親和模塊(GAM)通過計算一個圖像組中所有圖像之間的全局親和度來實現。什么意思?

群體親和模塊(Group Affinity Module, GAM)?? 的核心是通過計算 ??圖像組內所有圖像間的全局相似性??,提取多張圖像中 ??共顯著目標的共性特征??。其作用類似于CONDA模型中的 ??超關聯計算(HAC)??,但專注于 ??組內??(同一類別多圖像)而非 ??跨圖像??(不同場景)的關聯。

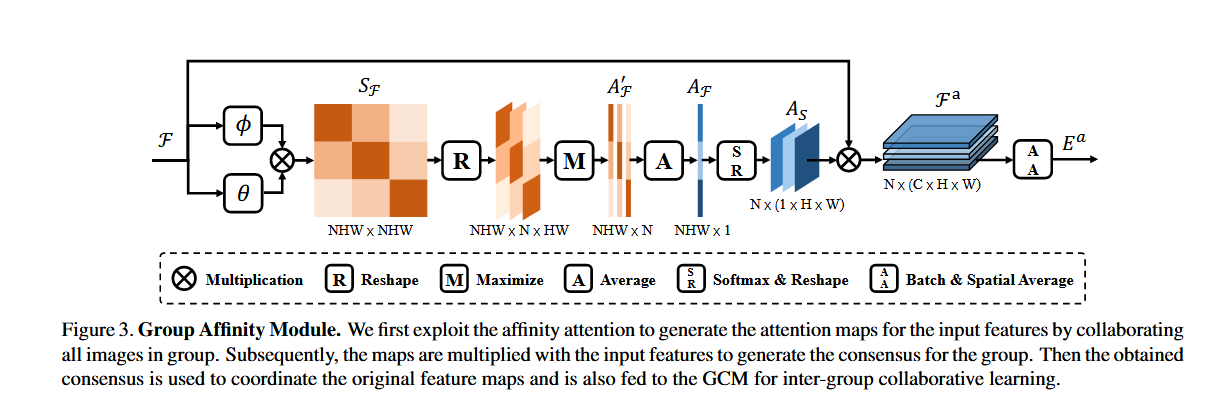

圖3. 群體親和模塊。我們首先利用親和注意力機制,通過協同處理圖像組中的所有圖像,為輸入特征生成注意力圖。隨后,將這些注意力圖與輸入特征相乘,從而為該圖像組生成一致性特征。接著,所得到的一致性特征將用于協調原始特征圖,并且也會被輸入到群體協作模塊(GCM)中,以進行組間協作學習。

問題二:詳細解釋一下這張圖?

這張圖展示的是 ??組親和模塊(Group Affinity Module, GAM)?? 的詳細流程,其核心是通過 ??親和注意力(Affinity Attention)?? 從輸入的一組圖像特征中提取共顯著目標的共性特征,生成注意力圖并融合到原始特征中。

1. 輸入與符號說明??

-

??輸入特征??:

-

形狀為?N×C×H×W?的張量?F,表示一組?N?張圖像的特征(每組圖像共享共顯著目標,如多張“吉他”圖像)。

-

例如:N=4,?C=256,?H=16,?W=16。

-

-

??關鍵操作符號??:

-

?:矩陣乘法(Multiplication)

-

R:重塑(Reshape)

-

M:最大化(Maximize)

-

A:平均(Average)

-

Φ:特征變換函數(如卷積+激活)

-

θ:可學習參數(如注意力權重)

-

??2. 流程分步詳解??

??(1) 生成親和注意力圖?![]() ?

?

-

??特征變換??:輸入特征?F?通過函數?Φ?和參數?θ?處理,得到中間特征?

(可能與?F?同維度)。

(可能與?F?同維度)。 -

??重塑為關聯矩陣?R??:

-

將?

??重塑為?NHW×HW?的矩陣?R,其中每行代表一個空間位置(共?NHW?個)與所有圖像所有位置的關聯性。

??重塑為?NHW×HW?的矩陣?R,其中每行代表一個空間位置(共?NHW?個)與所有圖像所有位置的關聯性。 -

??目的??:計算組內所有圖像特征間的全局相關性。

-

??(2) 最大化與平均操作??

-

??最大化操作?M??:

-

對矩陣?R?沿特定維度(如列)取最大值,得到?NHW×NW?的矩陣?

。

。 -

??作用??:篩選每組圖像中最顯著的關聯區域(共性強的高響應區域)。

-

-

??平均操作?A??:

-

對?

?進一步平均,得到?NHW×N?的矩陣

?進一步平均,得到?NHW×N?的矩陣 。

。 -

??作用??:生成每組圖像的注意力權重,表示每組內各圖像對共識特征的貢獻。

-

??(3) Softmax歸一化與重塑??

-

??Softmax & Reshape?R??:

-

對?

??沿最后一維(N)應用Softmax,得到歸一化注意力權重。

??沿最后一維(N)應用Softmax,得到歸一化注意力權重。 -

重塑為?N×(C×H×W)?的矩陣

。

。

-

??(4) 特征融合??

-

??矩陣乘法????:

-

將注意力權重

??與原始輸入特征?F(重塑為?N×(C×H×W))相乘,得到加權特征

??與原始輸入特征?F(重塑為?N×(C×H×W))相乘,得到加權特征 ?。

?。 -

??物理意義??:增強共顯著目標的特征,抑制非共性背景。

-

??(5) 批量和空間平均?As???

-

??平均操作?As???:

-

對?

沿批量和空間維度(H×W)求平均,得到?N×C?的矩陣?

沿批量和空間維度(H×W)求平均,得到?N×C?的矩陣? ?。

?。 -

??作用??:生成每組圖像的共識特征向量,用于后續的組間協作(GCM)或解碼。

-

3. 核心設計思想??

-

??親和注意力機制??:通過全局關聯矩陣?R?和最大化-平均操作,從組內圖像中挖掘共性特征,避免單張圖像的噪聲干擾。

-

??動態權重分配??:Softmax確保不同圖像對共識特征的貢獻自適應調整(如某些圖像視角更優,權重更高)。

-

??與GCM的銜接??:輸出的共識特征?Ea??會輸入到 ??組間協作模塊(GCM)??,通過跨組對比進一步區分共顯著目標與干擾項。

??4. 與圖3標注的對應關系??

-

圖中標注的符號(如?Sf?、Af?、A5)可能為中間變量或筆誤,實際流程應以文字描述為準。

-

??關鍵路徑??:

??5. 技術優勢??

-

??魯棒性??:對組內圖像的視角、遮擋、背景變化具有適應性。

-

??端到端學習??:所有操作(重塑、最大化、平均)可微分,支持反向傳播。

3.3?小組協作模塊(GCM)

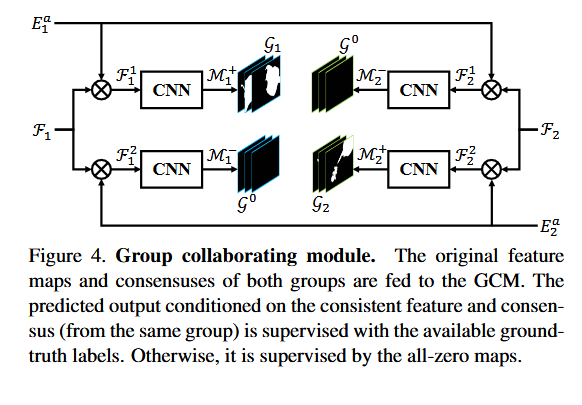

圖4. 群體協作模塊。兩個圖像組的原始特征圖和一致性特征都被輸入到群體協作模塊(GCM)中。基于一致的特征和一致性特征(來自同一圖像組)所預測的輸出,會使用可用的真實標簽進行監督。否則,該輸出將由全零圖進行監督。

問題一:詳細解釋一下這張圖?

這張圖展示的是 ??組協作模塊(Group Collaborative Module, GCM)?? 的詳細流程,其核心是通過 ??跨組對比學習?? 和 ??雙重監督機制??,從兩組圖像的原始特征和共識特征中提取共顯著目標的判別性特征。

1. 輸入與模塊功能??

-

??輸入特征??:

-

??原始特征圖??:F1?(組1,如“吉他”組)和?F2?(組2,如“小提琴”組),形狀為?C×H×W。

-

??共識特征??:E1a??和?E2a?,來自組內協作模塊(GAM)的組共識特征向量(形狀?N×C)。

-

-

??功能??:

-

通過跨組對比,強化共顯著目標的共性特征,同時抑制不同組間的干擾(如背景共性)。

-

??僅在訓練時使用??,推理階段移除以提升效率。

-

??2. 核心流程分步解析??

??(1) 特征輸入與分支處理??

-

??輸入分配??:

-

組1的原始特征

?和共識特征

?和共識特征 ?輸入到 ??上分支??(Group 1分支)。

?輸入到 ??上分支??(Group 1分支)。 -

組2的原始特征

??和共識特征?

??和共識特征? 輸入到 ??下分支??(Group 2分支)。

輸入到 ??下分支??(Group 2分支)。

-

??(2) 并行CNN處理??

-

??CNN特征變換??:

-

每個分支通過兩個獨立的 ??CNN模塊??(圖中標注為“CNN”)處理:

-

??正監督路徑??(

):

):-

輸入:原始特征

??同組共識特征???

??同組共識特征??? 。

。 -

輸出:掩碼預測?

?(監督信號:真實標簽?

?(監督信號:真實標簽? )。

)。

-

-

??負監督路徑??(

):

):-

輸入:原始特征?

??跨組共識特征???

??跨組共識特征??? ?。

?。 -

輸出:掩碼預測

(監督信號:全零掩碼?

(監督信號:全零掩碼? )。

)。

-

-

-

同理,組2分支生成?

?(監督:

?(監督: ?)和

?)和 (監督:

(監督: )。

)。

-

??(3) 特征融合與輸出??

-

??跨組特征交互??:

-

正負路徑的輸出

?、M1???與原始特征?

?、M1???與原始特征? ??融合,生成優化后的特征?

??融合,生成優化后的特征? 。

。 -

同理,組2生成?

。

。

-

-

??最終輸出??:兩組優化特征

??作為后續解碼器的輸入(圖中未展示解碼器部分)。

??作為后續解碼器的輸入(圖中未展示解碼器部分)。

??3. 監督機制設計??

-

??正監督(

)??:使用 ??真實標簽???

)??:使用 ??真實標簽??? ??監督同組共識特征生成的掩碼

??監督同組共識特征生成的掩碼 ?,確保共顯著目標被正確分割。

?,確保共顯著目標被正確分割。 -

??負監督(

)??:使用 ??全零掩碼???

)??:使用 ??全零掩碼??? 監督跨組共識特征生成的掩碼?

監督跨組共識特征生成的掩碼? ?,強制模型忽略不同組別的共性干擾(如背景)。

?,強制模型忽略不同組別的共性干擾(如背景)。 -

??目的??:通過對比學習,模型學會區分 ??組內共性??(如吉他形狀)和 ??跨組共性??(如舞臺燈光),提升魯棒性。

??4. 關鍵符號與圖中標注對應??

??5. 技術優勢與創新點??

-

??雙重監督機制??:正負監督聯合優化,避免模型將跨組背景誤判為共顯著目標。

-

??輕量化設計??:僅訓練階段引入GCM,推理時僅保留GAM,兼顧性能與效率。

-

??端到端訓練??:與GAM、解碼器聯合訓練,形成完整的共顯著目標檢測 pipeline。

??6. 與GAM模塊的協作關系??

-

??GAM??:負責組內共性提取(如吉他組內部的共同特征)。

-

??GCM??:負責組間差異學習(如吉他 vs 小提琴的區分)。

-

??協同作用??:GCM依賴GAM提供的共識特征?

,進一步優化判別能力。

,進一步優化判別能力。

??7. 總結??

GCM模塊通過 ??跨組對比監督?? 和 ??特征交互??,解決了共顯著檢測中的兩大難點:

-

??組內共性強化??(正監督路徑)。

-

??跨組干擾抑制??(負監督路徑)。

最終輸出的優化特征? ?能夠更精準地定位共顯著目標。

?能夠更精準地定位共顯著目標。

3.4 輔助分類模塊(ACM)

問題一:輔助分類模塊(ACM)的提出是為了解決什么問題,他的作用是什么?

1. 解決的問題??

??(1) 共顯著目標的語義混淆??

-

??問題背景??:在多組圖像(如“吉他”組和“小提琴”組)中,可能存在 ??跨組別的共性背景干擾??(例如舞臺燈光、木質紋理),模型可能錯誤地將這些背景特征誤判為共顯著目標。

-

??ACM的作用??:通過高層語義分類(如“吉他” vs “小提琴”),強制模型區分不同組別的語義類別,避免將背景共性誤認為目標共性。

??(2) 組內特征一致性不足??

-

??問題背景??:組內協作模塊(GAM)生成的共識特征可能因圖像差異(如視角、遮擋)而包含噪聲。

-

??ACM的作用??:通過分類任務約束共識特征的語義一致性,確保組內圖像的特征融合聚焦于真正的共顯著目標(如吉他的琴弦、琴身)。

??2. ACM的核心作用??

??(1) 語義監督(Semantic Supervision)??

-

??實現方式??:在共識特征圖(來自GAM)上附加分類頭(如全連接層+Softmax),預測圖像組的類別標簽。

-

??效果??:

-

增強模型對 ??共顯著目標類別?? 的敏感性(如“吉他”組的特征應更關注樂器部分,而非背景)。

-

抑制跨組別的無關共性(如“吉他”和“小提琴”組共享的舞臺背景)。

-

??(2) 聯合優化(Joint Optimization)??

-

??訓練機制??:

-

ACM與分割任務(GAM/GCM)??聯合訓練??,損失函數包含兩部分:

-

??分割損失??(如IoU Loss):優化共顯著目標的分割精度。

-

??分類損失??(如交叉熵損失):優化組別分類準確性。

-

-

??梯度反傳??:分類損失通過共識特征反向傳播,間接優化GAM的特征提取能力。

-

??(3) 推理階段的簡化??

-

??部署方式??:

-

ACM ??僅在訓練階段使用??,推理時移除,不增加計算負擔。

-

訓練后,模型僅依賴GAM和GCM生成的共識特征進行分割,但分類任務已隱含提升了特征判別性。

-

??3. 與GCM的協同關系??

-

??GCM??:通過跨組對比(正/負監督)解決 ??空間特征干擾??(如背景相似性)。

-

??ACM??:通過語義分類解決 ??高層語義干擾??(如類別相關性)。

-

??協同效果??:

-

GCM確保組間特征差異(吉他 vs 小提琴的形狀差異)。

-

ACM確保組內特征語義一致(吉他組的特征聚焦樂器本身)。

-

特征檢測-----在圖像中查找最顯著的角點函數goodFeaturesToTrack())

![BUUCTF-[GWCTF 2019]re3](http://pic.xiahunao.cn/BUUCTF-[GWCTF 2019]re3)

failed 解決方案)

)

)