隨著大型語言模型(LLMs)的出現,人工智能(AI)取得了巨大的飛躍。這些強大的系統徹底改變了自然語言處理,但當它們與代理能力結合時,才真正釋放出潛力——能夠自主地推理、規劃和行動。這就是LLM代理大顯身手的地方,它們代表了我們與AI交互以及利用AI的方式的范式轉變。

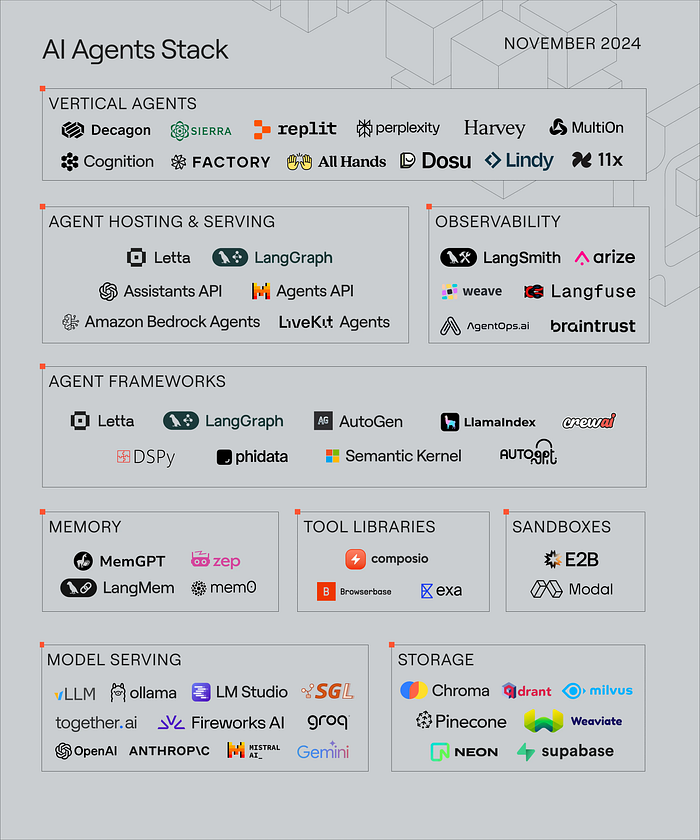

來源:letta

這篇博客旨在全面介紹AI代理,深入探討它們的特征、組件和類型,同時探索它們的演變、挑戰和潛在的未來方向。

文章目錄

- 1. 從LLM到AI代理

- 1.1 傳統聊天機器人到LLM驅動的聊天機器人

- **1.2 LLM驅動聊天機器人的引入**

- 1.3 從LLM驅動的聊天機器人到RAG聊天機器人和AI代理

- 2. 什么是AI代理?

- 2.1 AI代理的特征

- 3. AI代理的核心組件

- 3.1 感知(傳感器)

- 3.2 推理(處理器)

- 3.3 行動(執行器)

- 3.4 知識庫

- 3.5 學習

- 3.6 通信接口

- 4. **AI代理如何與環境交互**

- 4.1 感知階段

- 4.2 決策階段

- 4.3 行動階段

- 5. AI代理是如何工作的?

- 5.1 協調層(控制中心)

- 5.2 模型(大腦)

- 5.3 工具(雙手)

- 6. ? 何時使用代理 / ? 何時避免使用

- 7. 應用領域

- 8. 結論

讓我們先了解一下從LLM到AI代理的演變過程。

1. 從LLM到AI代理

LLM應用形式的演變是我們所見過的現代應用中發展最快的之一。

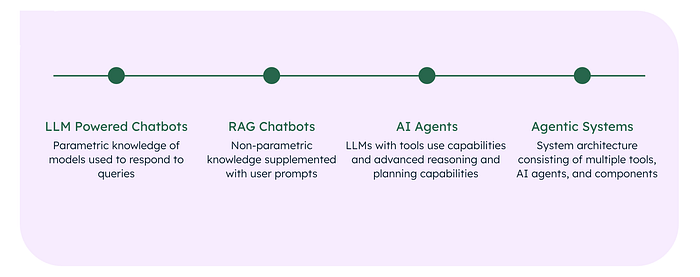

來源:mongodb

1.1 傳統聊天機器人到LLM驅動的聊天機器人

聊天機器人并不是什么新鮮事物;在生成式AI(Gen AI)這個術語出現之前,你可能就已經在網站上與聊天機器人互動過了。傳統聊天機器人與今天的AI驅動的對話代理有著根本的不同。它們通常是這樣工作的:

基于啟發式的響應:

- 傳統聊天機器人基于規則邏輯(“如果-那么”語句)運行。

- 僅限于預定義的規則,無法處理復雜或模糊的查詢。

固定響應:

- 響應是靜態的、預定義的。

- 通過檢測特定的關鍵詞或短語來觸發。

- 缺乏靈活性和對話深度。

轉接人工:

- 總是有一個“與人工對話”的按鈕,用于處理未解決的查詢。

- 人工干預對于處理復雜問題仍然至關重要。

來源:mongodb

1.2 LLM驅動聊天機器人的引入

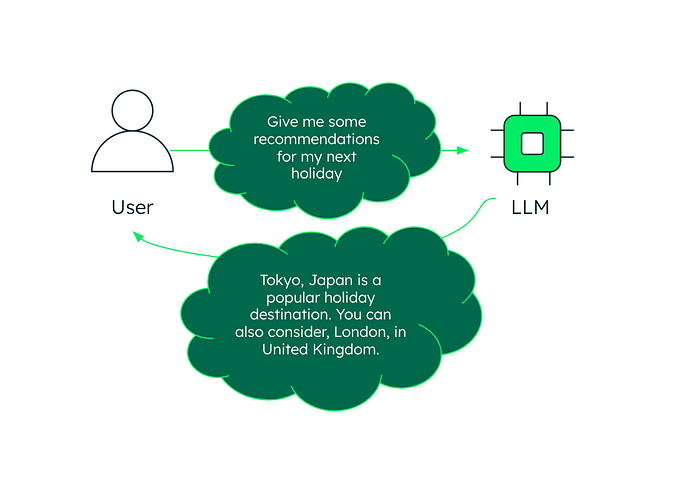

ChatGPT的推出: 2022年11月30日,OpenAI推出了ChatGPT,它由GPT-3.5驅動,是第一個主流的LLM應用。ChatGPT保留了熟悉的聊天機器人界面,但背后是經過大量互聯網語料庫訓練的先進LLM技術。

Transformer架構: GPT(生成式預訓練Transformer)基于谷歌在2017年引入的Transformer架構。它使用自注意力機制來分析輸入序列,更深入地理解上下文。

LLM的能力: 與傳統聊天機器人不同,LLM可以生成類似人類、與上下文相關且新穎的文本。用例包括代碼生成、內容創作、增強客戶服務等。

局限性:

- 個性化: 在長時間的對話中難以保持一致的個性化互動。

- 幻覺: 可以產生在事實上不正確但連貫的響應,基于概率而非經過驗證的知識生成輸出。

解決局限性的方法:

- 探索像**檢索增強生成(RAG)**這樣的技術,以使輸出基于可靠的外部數據。

- 這些進步旨在減少不準確之處,提高LLM驅動系統的穩健性。

1.3 從LLM驅動的聊天機器人到RAG聊天機器人和AI代理

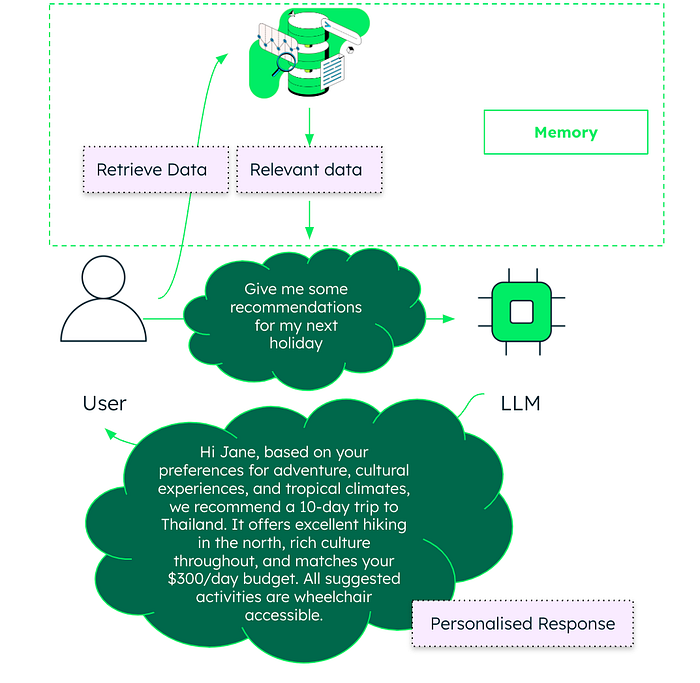

RAG聊天機器人: 檢索增強生成(RAG)將外部數據檢索與LLM能力相結合,以產生準確且基于上下文的響應。

知識來源:

- 非參數化知識: 從互聯網或專有數據庫等外部來源實時檢索的數據。

- 參數化知識: LLM訓練中嵌入的知識。

優勢: 減少幻覺,提供最新的信息,并確保可驗證的響應。

提示工程: 通過引導LLM的推理和輸出生成,像上下文學習(單次、少量)、思維鏈(CoT)和ReAct等技術提高了響應質量。

來源:mongodb

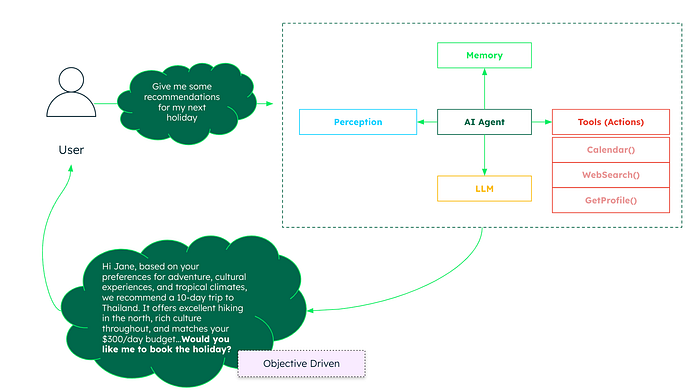

AI代理: AI代理是從具有工具、多步規劃和推理能力的LLM演變而來的。

工具使用: LLM可以通過分析任務并通過結構化模式(例如JSON)分配參數,調用程序定義的函數或API。

環境: AI代理在迭代執行環境中運行,能夠根據反饋進行動態決策和持續適應。

代理系統: 這些是具有自主代理的計算架構,能夠集成多個系統組件、做出決策并實現目標。

代理式RAG:

- 將LLM的推理、工具使用和規劃能力與語義信息檢索相結合。

- 能夠

分解任務、執行復雜查詢并利用工具解決問題的動態系統。

來源:mongodb

從LLM驅動的聊天機器人到RAG聊天機器人和AI代理的轉變,代表了向更智能、更適應性強且能夠實時解決復雜問題的工具集成系統的轉變。

)

:造化玉碟·用字節碼重寫因果律的九種方法》)