【機器學習|學習筆記】粒子群優化(Particle Swarm Optimization, PSO)詳解,附代碼。

【機器學習|學習筆記】粒子群優化(Particle Swarm Optimization, PSO)詳解,附代碼。

文章目錄

- 【機器學習|學習筆記】粒子群優化(Particle Swarm Optimization, PSO)詳解,附代碼。

- 前言

- 起源

- 發展

- 參數收斂與穩定性分析

- 算法變體

- 元啟發式與混合優化

- 原理

- 基本算法

- 收斂機制

- 應用

- Python代碼實現

歡迎鐵子們點贊、關注、收藏!

祝大家逢考必過!逢投必中!上岸上岸上岸!upupup

大多數高校碩博生畢業要求需要參加學術會議,發表EI或者SCI檢索的學術論文會議論文。詳細信息可關注VX “

學術會議小靈通”或參考學術信息專欄:https://blog.csdn.net/2401_89898861/article/details/147567533

前言

- PSO 以極少的參數和簡單的公式模擬鳥群或魚群的社會行為,通過粒子間的信息共享不斷迭代逼近最優解;

- 自1995年Kennedy和Eberhart提出以來,它因易于實現、無需梯度信息且適用大規模連續優化而廣泛流行。

- 本文結合機器學習專業視角,系統回顧PSO的理論基礎、主要變體及典型應用,并給出完整的Python示例代碼。

起源

- 1995年,James?Kennedy(社會心理學家)和Russell?Eberhart(電氣工程師)首次將社會行為模擬與進化計算相結合,提出了粒子群優化算法,用以模擬鳥群覓食或魚群游動的群體智能行為,從而在連續空間中進行優化搜索。

- 該算法最初旨在研究社會心理學中的“個體—群體”互動模型,后簡化為無隱喻的優化范式。

- PSO的直接學術淵源還包括Craig?Reynolds于1987年提出的Boids模型,該模型用簡單規則成功模擬鳥群飛行的渦流與聚集現象。

- 1995年Kennedy與Eberhart在IEEE會議上發表的原始論文詳細回顧了社會仿真向優化算法演變的各階段,并展示了PSO在基準函數與工程設計問題上的初步成功。

發展

參數收斂與穩定性分析

- Clerc 和?Kennedy于2002年在IEEE Trans. EC上分析了PSO的“爆炸—收斂”行為,提出了收縮因子(constriction factor)方法,為參數(慣性權重 w w w、學習因子 φ p φ? φp?、 φ g φ_g φg?)提供了理論收斂域。

- 這一貢獻使PSO在高維空間中的穩定性大幅提升,并成為SPSO?2011標準的理論基礎。

算法變體

- Bare?Bones PSO:2003年Kennedy提出無需顯式速度更新的簡化版本,通過正態分布直接采樣新位置,降低了參數依賴并在若些測試函數上提升了性能。

- Accelerated PSO (APSO):Yang等人于2011年提出在無速度結構下通過全局最優和隨機擾動快速收斂的APSO變體,進一步簡化并加速了收斂。

- 多目標與多群體:為解決多目標優化和防止提前收斂,研究者發展了多群體PSO(multi?swarm)和Pareto?PSO,使算法能同時逼近Pareto前沿。

- 離散與二值PSO:Kennedy &?Eberhart在1997年將PSO推廣到二值空間,用于組合優化,后續Clerc等人提出基于集合運算的通用離散PSO理論。

元啟發式與混合優化

- PSO常與遺傳算法(GA)、差分進化(DE)、貝葉斯優化等方法混合,以利用不同算法優勢。例如,將PSO用于GA的初代群體生成,或結合DE的變異策略增強全局搜索能力。

原理

基本算法

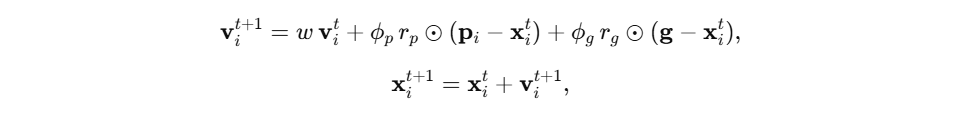

- 設目標函數 f : R n → R f:R^n→R f:Rn→R 待最小化。令粒子數為 S S S,第 i i i 個粒子在迭代 t t t 的位置與速度分別為 x i t x_i^t xit? 與 v i t v_i^t vit?,個體最優位置 p i p_i pi? 與群體最優 g g g。更新公式為:

- 其中 r p , r g ~ U ( 0 , 1 ) r_p ,r_g~U(0,1) rp?,rg?~U(0,1) 為隨機向量, w w w 為慣性權重, ? p , ? g ?_p,?_g ?p?,?g? 為學習因子。慣性權重 w w w 平衡全局與局部搜索,典型取值在 (0.4,0.9);學習因子通常取 1–3。

收斂機制

- PSO通過粒子間共享“最佳位置”信息,使得搜索既保留個體探索性又具備群體協同,隨著迭代,速度趨于0而位置收斂至局部或全局最優。

應用

PSO已被成功應用于工程、計算機科學、經濟學等眾多領域:

- 神經網絡訓練:用PSO優化權重和結構參數,加速收斂并提升精度。

- 控制系統設計:如PID參數整定、無人機軌跡規劃、機器人路徑優化。

- 電力負荷預測:結合PSO與支持向量回歸(SVR)實現短期負荷精準預測。

- 圖像處理:濾波器參數優化、圖像分割能量函數最小化。

- 組合優化:旅行商、作業調度、網絡拓撲優化等離散和混合問題。

- 經濟與金融:資產組合優化、風險管理和策略回測參數調優。

Python代碼實現

- 下面給出基于NumPy的簡易PSO實現示例,可直接用于任意連續優化問題。

import numpy as npdef pso(func, lb, ub, dim, num_particles=30, max_iter=100, w=0.7, c1=1.5, c2=1.5):# 初始化X = np.random.uniform(lb, ub, (num_particles, dim)) # 粒子位置V = np.random.uniform(-(ub-lb), ub-lb, (num_particles, dim)) # 粒子速度P = X.copy() # 個體最優位置Pbest = np.array([func(x) for x in P])g_idx = np.argmin(Pbest)G = P[g_idx].copy() # 全局最優位置for t in range(max_iter):r1, r2 = np.random.rand(), np.random.rand()# 更新速度與位置V = w*V + c1*r1*(P - X) + c2*r2*(G - X)X = X + V# 邊界處理X = np.clip(X, lb, ub)# 更新個體/全局最優fitness = np.array([func(x) for x in X])better = fitness < PbestP[better] = X[better]Pbest[better] = fitness[better]if fitness.min() < Pbest.min():G = X[fitness.argmin()]return G, func(G)# 示例:Rosenbrock 函數優化

def rosen(x):return sum(100.0*(x[1:]-x[:-1]**2.0)**2.0 + (1-x[:-1])**2.0)best_pos, best_val = pso(rosen, lb=-5, ub=5, dim=3)

print("Best position:", best_pos, "Best value:", best_val)- 以上代碼實現了PSO的核心機制,包括隨機初始化、速度/位置更新、個體與全局最優跟蹤,以及邊界處理,用戶可調整參數或替換目標函數以滿足不同優化需求。

問題研究)

加密芯片與MCU協同工作的典型流程)

)

)