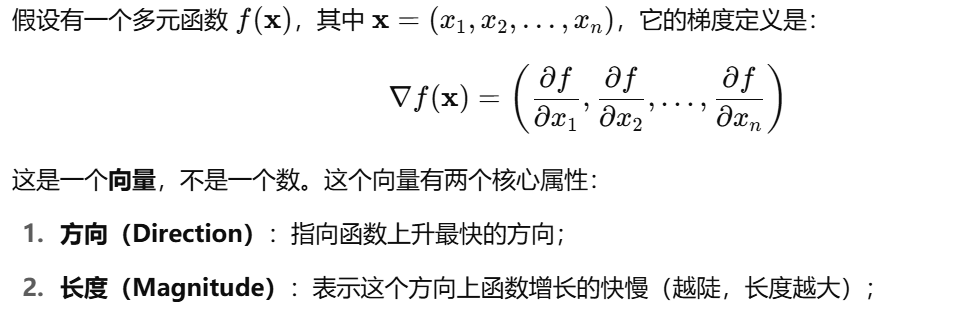

一、定義

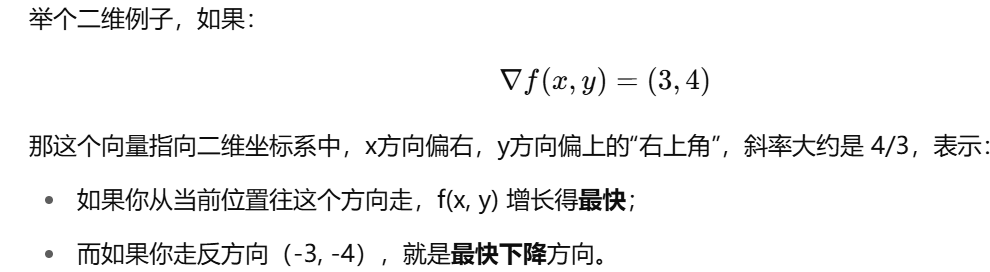

梯度向量不僅表示函數變化的速度,還表示函數增長最快的方向

二、【問】為什么說它表示方向?

三、【問】那在深度學習梯度下降的時候,還要判斷梯度是正是負來更新參數嗎?

假設某個參數是 w,損失函數對它的導數是 dw

情況一: dw > 0

說明當前點在一個上升區間,想讓損失下降,w應該變小,也就是減去這個正的梯度。

情況二: dw < 0

說明當前點在一個下降區間,函數在往下走,w應該變大,同樣地:減去負的梯度,相當于加上它的絕對

值。

結論

所以,無論正負,統一使用:w = w - α*dw就可以了!

減去正數 → 向左走(變小)

減去負數 → 向右走(變大)

優化

當樣本數量很大的時候,需要對每個樣本求偏導,再取平均值得到損失函數,(計算+存儲)計算量會非常大

優化:隨機梯度下降

從樣本中隨機取m個值,來進行梯度下降優化參數

![題海拾貝:P8598 [藍橋杯 2013 省 AB] 錯誤票據](http://pic.xiahunao.cn/題海拾貝:P8598 [藍橋杯 2013 省 AB] 錯誤票據)

)

Open Set Video HOI detection from Action-centric Chain-of-Look Prompting)

)

Java/python/JavaScript/C++/C語言/GO六種最佳實現)