1、模型訓練

模型訓練一般分為四個步驟:

- 構建數據集。

- 定義神經網絡模型。

- 定義超參、損失函數及優化器。

- 輸入數據集進行訓練與評估。

現在我們有了數據集和模型后,可以進行模型的訓練與評估。

2、構建數據集

首先從數據集 Dataset加載代碼,構建數據集。

import mindspore

from mindspore import nn

from mindspore.dataset import vision, transforms

from mindspore.dataset import MnistDataset# Download data from open datasets

from download import downloadurl = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)def datapipe(path, batch_size):image_transforms = [vision.Rescale(1.0 / 255.0, 0),vision.Normalize(mean=(0.1307,), std=(0.3081,)),vision.HWC2CHW()]label_transform = transforms.TypeCast(mindspore.int32)#mindspore.dataset.transforms.TypeCast(data_type)#將輸入的Tensor轉換為指定的數據類型。dataset = MnistDataset(path)dataset = dataset.map(image_transforms, 'image')dataset = dataset.map(label_transform, 'label')dataset = dataset.batch(batch_size)return datasettrain_dataset = datapipe('MNIST_Data/train', batch_size=64)

test_dataset = datapipe('MNIST_Data/test', batch_size=64)

?3、定義神經網絡模型

從網絡構建中加載代碼,構建一個神經網絡模型。

class Network(nn.Cell):def __init__(self):super().__init__()self.flatten = nn.Flatten()#將數據從start_dim 到 end_dim 的維度,對輸入Tensor進行展平self.dense_relu_sequential = nn.SequentialCell(#構造Cell順序容器。nn.Dense(28*28, 512),nn.ReLU(),nn.Dense(512, 512),nn.ReLU(),nn.Dense(512, 10))def construct(self, x):x = self.flatten(x)logits = self.dense_relu_sequential(x)return logitsmodel = Network()?4、定義超參、損失函數和優化器

4.1 超參

????????超參(Hyperparameters)是可以調整的參數,可以控制模型訓練優化的過程,不同的超參數值可能會影響模型訓練和收斂速度。目前深度學習模型多采用批量隨機梯度下降算法進行優化,隨機梯度下降算法的原理如下:

公式中,𝑛是批量大小(batch size),η是學習率(learning rate)。另外,𝑤𝑡為訓練輪次𝑡中的權重參數,?𝑙為損失函數的導數。除了梯度本身,這兩個因子直接決定了模型的權重更新,從優化本身來看,它們是影響模型性能收斂最重要的參數。一般會定義以下超參用于訓練:

-

訓練輪次(epoch):訓練時遍歷數據集的次數。

-

批次大小(batch size):數據集進行分批讀取訓練,設定每個批次數據的大小。batch size過小,花費時間多,同時梯度震蕩嚴重,不利于收斂;batch size過大,不同batch的梯度方向沒有任何變化,容易陷入局部極小值,因此需要選擇合適的batch size,可以有效提高模型精度、全局收斂。

-

學習率(learning rate):如果學習率偏小,會導致收斂的速度變慢,如果學習率偏大,則可能會導致訓練不收斂等不可預測的結果。梯度下降法被廣泛應用在最小化模型誤差的參數優化算法上。梯度下降法通過多次迭代,并在每一步中最小化損失函數來預估模型的參數。學習率就是在迭代過程中,會控制模型的學習進度。

epochs = 3

batch_size = 64

learning_rate = 1e-24.2 損失函數

????????損失函數(loss function)用于評估模型的預測值(logits)和目標值(targets)之間的誤差。訓練模型時,隨機初始化的神經網絡模型開始時會預測出錯誤的結果。損失函數會評估預測結果與目標值的相異程度,模型訓練的目標即為降低損失函數求得的誤差。

????????常見的損失函數包括用于回歸任務的nn.MSELoss(均方誤差)和用于分類的nn.NLLLoss(負對數似然)等。?nn.CrossEntropyLoss?結合了nn.LogSoftmax和nn.NLLLoss,可以對logits 進行歸一化并計算預測誤差。

loss_fn = nn.CrossEntropyLoss()?4.3 優化器

????????模型優化(Optimization)是在每個訓練步驟中調整模型參數以減少模型誤差的過程。MindSpore提供多種優化算法的實現,稱之為優化器(Optimizer)。優化器內部定義了模型的參數優化過程(即梯度如何更新至模型參數),所有優化邏輯都封裝在優化器對象中。在這里,我們使用SGD(Stochastic Gradient Descent)優化器。

mindspore.nn.SGD(params,?learning_rate=0.1,?momentum=0.0,?dampening=0.0,?weight_decay=0.0,?nesterov=False,?loss_scale=1.0)

隨機梯度下降的實現。動量可選。

【參數】

-

params?(Union[list[Parameter], list[dict]]) - 當?params?為會更新的?Parameter?列表時,?params?中的元素必須為類?Parameter。當?params?為?dict?列表時,”params”、”lr”、”weight_decay”、”grad_centralization”和”order_params”為可以解析的鍵。

-

params?- 必填。當前組別的權重,該值必須是?Parameter?列表。

-

lr?- 可選。如果鍵中存在”lr”,則使用對應的值作為學習率。如果沒有,則使用優化器中的參數?learning_rate?作為學習率。支持固定和動態學習率。

-

weight_decay?- 可選。如果鍵中存在”weight_decay”,則使用對應的值作為權重衰減值。如果沒有,則使用優化器中配置的?weight_decay?作為權重衰減值。當前?weight_decay?僅支持float類型,不支持動態變化。

-

grad_centralization?- 可選。如果鍵中存在”grad_centralization”,則使用對應的值,該值必須為布爾類型。如果沒有,則認為?grad_centralization?為False。該參數僅適用于卷積層。

-

order_params?- 可選。值的順序是參數更新的順序。當使用參數分組功能時,通常使用該配置項保持?parameters?的順序以提升性能。如果鍵中存在”order_params”,則會忽略該組配置中的其他鍵。”order_params”中的參數必須在某一組?params?參數中。

-

-

learning_rate?(Union[float, int, Tensor, Iterable, LearningRateSchedule]) - 默認值:?

0.1?。-

float?- 固定的學習率。必須大于等于零。

-

int?- 固定的學習率。必須大于等于零。整數類型會被轉換為浮點數。

-

Tensor?- 可以是標量或一維向量。標量是固定的學習率。一維向量是動態的學習率,第i步將取向量中第i個值作為學習率。

-

Iterable?- 動態的學習率。第i步將取迭代器第i個值作為學習率。

-

LearningRateSchedule?- 動態的學習率。在訓練過程中,優化器將使用步數(step)作為輸入,調用?LearningRateSchedule?實例來計算當前學習率。

-

-

momentum?(float) - 浮點動量,必須大于等于0.0。默認值:?

0.0?。 -

dampening?(float) - 浮點動量阻尼值,必須大于等于0.0。默認值:?

0.0?。 -

weight_decay?(float) - 權重衰減(L2 penalty),必須大于等于0。默認值:?

0.0?。 -

nesterov?(bool) - 啟用Nesterov動量。如果使用Nesterov,動量必須為正,阻尼必須等于0.0。默認值:?

False?。

-

loss_scale?(float) - 梯度縮放系數,必須大于0.0。如果?loss_scale?是整數,它將被轉換為浮點數。通常使用默認值,僅當訓練時使用了?FixedLossScaleManager,且?FixedLossScaleManager?的?drop_overflow_update?屬性配置為?

False?時,此值需要與?FixedLossScaleManager?中的?loss_scale?相同。有關更多詳細信息,請參閱?mindspore.amp.FixedLossScaleManager。默認值:?1.0?。

????????我們通過model.trainable_params()方法獲得模型的可訓練參數,并傳入學習率超參來初始化優化器。

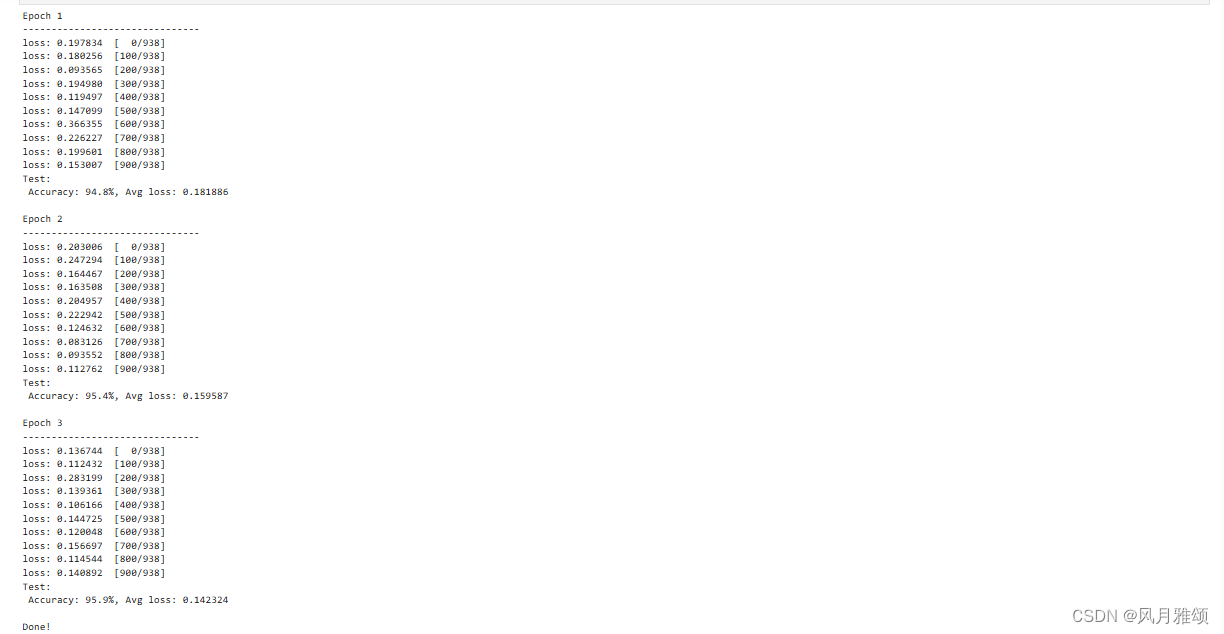

5、訓練與評估

????????設置了超參、損失函數和優化器后,我們就可以循環輸入數據來訓練模型。一次數據集的完整迭代循環稱為一輪(epoch)。每輪執行訓練時包括兩個步驟:

- 訓練:迭代訓練數據集,并嘗試收斂到最佳參數。

- 驗證/測試:迭代測試數據集,以檢查模型性能是否提升。

接下來我們定義用于訓練的train_loop函數和用于測試的test_loop函數。

????????使用函數式自動微分,需先定義正向函數forward_fn,使用value_and_grad獲得微分函數grad_fn。然后,我們將微分函數和優化器的執行封裝為train_step函數,接下來循環迭代數據集進行訓練即可。

mindspore.value_and_grad(fn,?grad_position=0,?weights=None,?has_aux=False,?return_ids=False)

生成求導函數,用于計算給定函數的正向計算結果和梯度。

函數求導包含以下三種場景:

-

對輸入求導,此時?grad_position?非None,而?weights?是None;

-

對網絡變量求導,此時?grad_position?是None,而?weights?非None;

-

同時對輸入和網絡變量求導,此時?grad_position?和?weights?都非None。

【參數】

-

fn?(Union[Cell, Function]) - 待求導的函數或網絡。

-

grad_position?(Union[NoneType, int, tuple[int]]) - 指定求導輸入位置的索引。若為int類型,表示對單個輸入求導;若為tuple類型,表示對tuple內索引的位置求導,其中索引從0開始;若是None,表示不對輸入求導,這種場景下,?weights?非None。默認值:?

0?。 -

weights?(Union[ParameterTuple, Parameter, list[Parameter]]) - 訓練網絡中需要返回梯度的網絡變量。一般可通過?weights = net.trainable_params()?獲取。默認值:?

None?。 -

has_aux?(bool) - 是否返回輔助參數的標志。若為?

True?,?fn?輸出數量必須超過一個,其中只有?fn?第一個輸出參與求導,其他輸出值將直接返回。默認值:?False?。 -

return_ids?(bool) - 是否返回由返回的梯度和指定求導輸入位置的索引或網絡變量組成的tuple。若為?

True?,其輸出中所有的梯度值將被替換為:由該梯度和其輸入的位置索引,或者用于計算該梯度的網絡變量組成的tuple。默認值:?False?。

# Define forward function

def forward_fn(data, label):logits = model(data)loss = loss_fn(logits, label)return loss, logits# Get gradient function

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)# Define function of one-step training

def train_step(data, label):(loss, _), grads = grad_fn(data, label)optimizer(grads)return lossdef train_loop(model, dataset):size = dataset.get_dataset_size()model.set_train()for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):loss = train_step(data, label)if batch % 100 == 0:loss, current = loss.asnumpy(), batchprint(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")test_loop函數同樣需循環遍歷數據集,調用模型計算loss和Accuray并返回最終結果。

def test_loop(model, dataset, loss_fn):num_batches = dataset.get_dataset_size()model.set_train(False)total, test_loss, correct = 0, 0, 0for data, label in dataset.create_tuple_iterator():pred = model(data)total += len(data)test_loss += loss_fn(pred, label).asnumpy()correct += (pred.argmax(1) == label).asnumpy().sum()test_loss /= num_batchescorrect /= totalprint(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

)