前言

在深度學習中,模型的設計往往不是從頭開始,而是通過組合不同的模塊來構建。這種“模塊縫合”技術,就像搭積木一樣,把不同的功能模塊拼在一起,形成一個強大的模型。今天,我們就來聊聊四種常見的模塊縫合方法,幫你更好地理解如何靈活運用這些技巧,快速搭建出自己想要的模型。同時想要快速出論文,模塊縫合也是你的不二之選!

但是很多人不知道怎么去縫合模塊,今天就給大家推薦幾種模塊縫合的方法,并且給大家舉出一些詳細的例子!

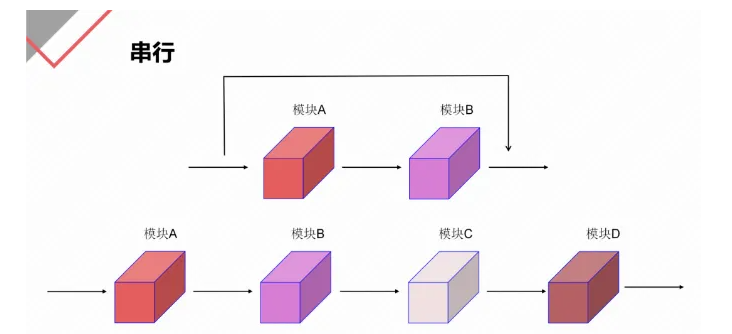

1. 串行連接:按順序拼接模塊

什么是串行連接?

串行連接是最簡單直接的方法,就是把多個模塊像排隊一樣,一個接一個地連接起來。前一個模塊的輸出,直接作為下一個模塊的輸入。

為什么用串行連接?

這種方法特別適合處理需要逐步提取特征的任務,比如圖像分類、文本處理等。它的優點是結構清晰,容易實現,同時也能保持一定的靈活性。

代碼實現細節:

model = nn.Sequential(nn.Conv2d(3, 64, kernel_size=3, stride=1, padding=1),nn.ReLU(),nn.MaxPool2d(kernel_size=2, stride=2),nn.Flatten(),nn.Linear(64 * 16 * 16, 10) # 假設輸入圖像大小為32x32

)常見的應用場景

-

圖像分類:比如ResNet中,多個殘差塊按順序堆疊,逐步提取圖像特征。

-

文本處理:比如Transformer中,多個注意力層按順序連接,逐步捕捉文本中的上下文關系

-

序列建模:比如LSTM或GRU網絡中,多個循環層按順序連接,處理時間序列數據。

典型案例:ResNet、DenseNet。

這里我也給大家大家分享一下我整理的90多個即插即用的深度學習模塊,包含了模塊名稱、論文、代碼地址、模塊簡介等等,可以幫助大家快速模型漲點

? ?

? ?

還有論文資料合集

不僅有論文創新點的干貨知識、開題報告模板、文獻綜述模板、審稿意見回復模板、還有全套的SCI論文寫作指導教程和人工智能各方向經典的論文合集以及各大熱門科研和論文寫作潤色工具等

以及深度學習資料+80G人工智能資料包(如下圖)

不僅有入門級教程,配套課件,還有進階實戰,源碼數據集,更有面試題幫你提升~

需要的兄弟可以按照這個圖的方式免費獲取

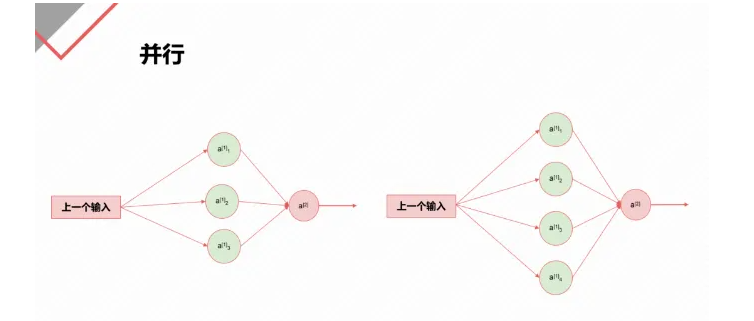

2. 并行連接:同時運行多個模塊?

?什么是并行連接?

并行連接是指同時運行多個模塊,然后把它們的輸出合并起來。就像幾個人同時處理同一個任務,最后把結果匯總。

為什么用并行連接?

這種方法可以充分利用多個模塊的計算能力,提高模型的效率和性能。特別適合需要多分支處理的任務,比如多尺度特征提取。

代碼實現細節

classParallelModel(nn.Module):

def__init__(self):

super(ParallelModel, self).__init__()

self.conv1 = nn.Conv2d(3, 64, kernel_size=3, padding=1)

self.conv2 = nn.Conv2d(3, 64, kernel_size=5, padding=2)

self.fc = nn.Linear(64 * 2, 10) # 假設兩個卷積輸出拼接defforward(self, x):out1 = self.conv1(x)out2 = self.conv2(x)out = torch.cat((out1, out2), dim=1) # 在通道維度拼接out = self.fc(out.flatten(1))

return out常見的應用場景

-

多尺度特征提取:比如GoogLeNet中的Inception模塊,同時使用1x1、3x3、5x5的卷積核,提取不同尺度的特征。

-

多任務學習:比如同時處理分類和回歸任務,每個任務使用一個分支,最后合并結果。

-

多模態融合:比如同時處理圖像和文本數據,分別使用卷積網絡和循環網絡提取特征,然后拼接。

典型案例:GoogLeNet、ResNeXt。

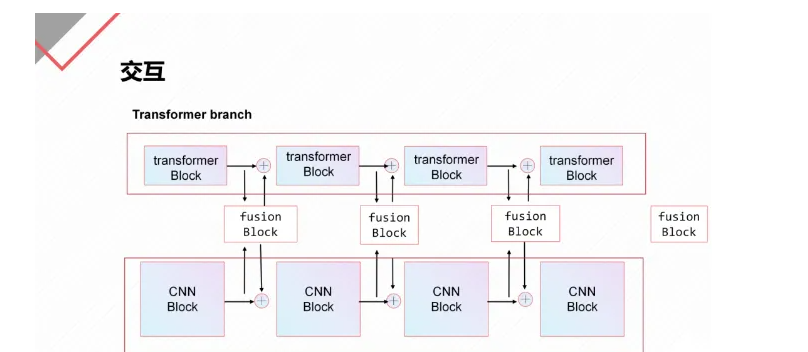

3. 交互式連接:模塊之間相互交流

什么是交互式連接?

交互式連接是指模塊之間不是簡單的串聯或并聯,而是通過某種方式相互交流信息。比如,一個模塊的輸出會影響到另一個模塊的計算過程。

為什么用交互式連接?

這種方法適合處理復雜的任務,尤其是需要多模塊協同工作的場景。通過模塊之間的交互,可以更好地捕捉數據的復雜關系。

代碼實現細節:

classInteractionModel(nn.Module):

def__init__(self):

super(InteractionModel, self).__init__()

self.conv = nn.Conv2d(3, 64, kernel_size=3, padding=1)

self.attention = nn.MultiheadAttention(embed_dim=64, num_heads=8)defforward(self, x):conv_out = self.conv(x)conv_out = conv_out.flatten(2).permute(2, 0, 1) # 轉換為序列格式attn_out, _ = self.attention(conv_out, conv_out, conv_out)

return attn_out.permute(1, 2, 0).view(x.shape) # 恢復原始形狀常見的應用場景

-

推薦系統:比如特征交叉網絡,用戶特征和商品特征通過交互式連接進行融合。

-

自然語言處理:比如BERT中的自注意力機制,讓不同位置的詞相互影響。

-

多模態任務:比如圖像描述生成,圖像特征和文本特征通過交互式連接進行融合。

典型案例:BERT、U-Net。

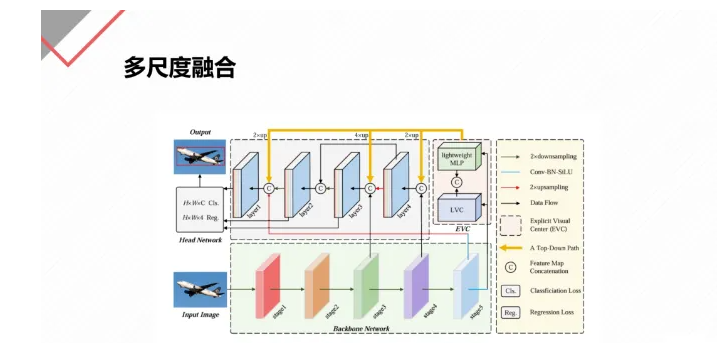

4. 多尺度融合:捕捉不同尺度的信息

什么是多尺度融合?

多尺度融合是指將來自不同尺度的特征信息結合起來。比如,在處理圖像時,既要關注細節(小尺度),也要關注整體結構(大尺度)。

為什么用多尺度融合?

這種方法特別適合視覺任務,比如目標檢測、圖像分割等。通過結合不同尺度的信息,模型可以同時捕捉到細節和全局上下文,從而提高性能。

代碼實現細節:

classMultiScaleModel(nn.Module):

def__init__(self):

super(MultiScaleModel, self).__init__()

self.conv1 = nn.Conv2d(3, 64, kernel_size=3, stride=2, padding=1) # 大尺度

self.conv2 = nn.Conv2d(3, 64, kernel_size=5, stride=1, padding=2) # 小尺度

self.fc = nn.Linear(64 * 2, 10)defforward(self, x):out1 = self.conv1(x)out2 = self.conv2(x)out = torch.cat((out1, out2), dim=1) # 在通道維度拼接out = self.fc(out.flatten(1))

return out常見的應用場景

-

目標檢測:比如FPN(特征金字塔網絡),通過多尺度融合捕捉不同大小的目標。

-

圖像分割:比如U-Net,通過跳躍連接融合不同尺度的特征。

-

超分辨率重建:通過多尺度融合增強圖像的細節信息。

典型案例:FPN(特征金字塔網絡)、PAN(路徑聚合網絡)。

掌握這些模塊縫合方法,就像學會了搭積木的技巧,能讓你快速、靈活地搭建出適合不同任務的深度學習模型。無論是處理圖像、文本,還是解決復雜的多模態問題,這些方法都能幫你更好地組合模型的不同部分,提升性能、提高效率,還能讓你更容易理解和改進模型的設計。

——應用層)

)

)

)