一、邏輯回歸概念

邏輯回歸(Logistic Regression)是一種廣泛應用于分類問題的統計方法,尤其適用于二分類問題。

注意: 盡管名稱中有"回歸"二字,但它實際上是一種分類算法。

解決二分類的問題。

API:sklearn.linear_model.LogisticRegression

二、核心函數

Sigmoid函數:

其中,w是權重向量,x是特征向量,b是偏置項。

三、邏輯回歸原理和優化手段

1.原理:(核心思想)邏輯回歸通過將線性回歸的輸出映射到(0,1)區間,使用Sigmoid函數將連續值轉換為概率值,然后根據概率值進行分類預測。

2.優化手段:極大似然估計和最小化交叉熵。

極大似然估計:(MLE,即 Maximum Likelihood Estimation)

????????是一種統計方法,用于從觀測數據中估計概率分布的參數。核心思想是“在已知觀測數據的情況下,選擇使得這些數據出現概率最大的參數值。”

? ? ? ? 二分類公式:

其中表示第i個樣本的真實標簽,取值為0或1(1表示成功,0表示失敗),

是模型預測的“成功”概率(即

),是帶估計的參數。

最小化交叉熵:交叉熵損失函數(Cross-Entropy Loss),也稱為對數損失(Log Loss)

????????交叉熵是衡量兩個概率分布(真實分布 y和預測分布 p)差異的指標

????????二分類公式:

其中表示第i個樣本的真實標簽,通常取值0或1(二分類問題),

表示模型預測的第i個樣本屬于類別1的概率(即

)

?

關系:先用伯努利分布的似然函數,然后對其取負對數,直接得到交叉熵損失,然后不斷的梯度下降迭代更新找到最優參數!(把最大化問題將其變為最小化問題,把連乘問題將其變為連加問題)

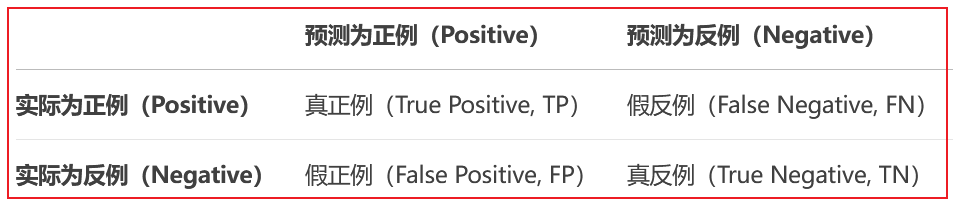

四、混淆矩陣

1.概念

????????混淆矩陣是機器學習中用于評估分類模型性能的表格。它展示了模型的預測結果與實際標簽的對比情況。

2.圖解

3.作用

? ????????直觀顯示模型的分類錯誤類型(如誤診、漏檢),計算關鍵指標:準確率(Accuracy)、精確率(Precision)、召回率(Recall)、F1分數等。

五、分類結果評價指標

1.準確率(Accuracy_score)

準確率 = 預測正確的樣本數 / 總樣本數? ? ? ? 其中預測正確指的是預測結果 = 真實結果(包含正例以及反例)

2.精確率(Precision_score)?

精確率 是 預測正例中真實正例的個數占比

3.召回率(Recall_score)

召回率 是 真實正例中預測的正例的個數占比

4.F1-score

對模型的精確率和召回率都有要求,希望知道模型在這兩個評估方向的綜合預測能力

5.ROC曲線

概念:ROC曲線以模型的真正率為縱軸,假正率為橫軸,它將模型在不同閾值下的表現以曲線的形式展現出來。

真正率: 正樣本中被預測為正樣本的概率TPR (True Positive Rate)

假正率: 負樣本中被預測為正樣本的概率FPR (False Positive Rate)

6.AUC面積

ROC曲線下方的面積,AUC越大,代表分類器越好

AI繪畫帶來的挑戰解題全過程文檔及程序)

![P1040 [NOIP 2003 提高組] 加分二叉樹](http://pic.xiahunao.cn/P1040 [NOIP 2003 提高組] 加分二叉樹)

| if語句)

)