一、介紹

Kimi-Dev-72B是由月之暗面(Moonshot AI)最新開源的AI編程模型,專為軟件工程任務設計,并登頂 SWE-bench Verified 基準測試榜首,超越 DeepSeek-R1 等模型,成為當前開源代碼模型的 SOTA:

- Kimi-Dev-72B 在 SWE-bench Verified 測試中達到了 60.4% 的性能。它超越了其他競爭者,在開源模型中樹立了新的標桿。

- Kimi-Dev-72B 通過大規模強化學習進行了優化。它能夠自主修補 Docker 中的真實倉庫,并且只有在所有測試套件通過時才能獲得獎勵。這確保了解決方案的正確性和魯棒性,符合實際開發標準。

二、部署過程

基礎環境最低要求說明:至少需要8張4090

| 環境名稱 | 版本信息1 |

|---|---|

| Ubuntu | 22.04.4 LTS |

| Cuda | V12.1.105 |

| Python | 3.12.4 |

| NVIDIA Corporation | RTX4090 *8 |

1. 更新基礎軟件包

查看系統版本信息

# 查看系統版本信息,包括ID(如ubuntu、centos等)、版本號、名稱、版本號ID等

cat /etc/os-release

配置 apt 國內源

# 更新軟件包列表

apt-get update

這個命令用于更新本地軟件包索引。它會從所有配置的源中檢索最新的軟件包列表信息,但不會安裝或升級任何軟件包。這是安裝新軟件包或進行軟件包升級之前的推薦步驟,因為它確保了您獲取的是最新版本的軟件包。

# 安裝 Vim 編輯器

apt-get install -y vim

這個命令用于安裝 Vim 文本編輯器。-y?選項表示自動回答所有的提示為“是”,這樣在安裝過程中就不需要手動確認。Vim 是一個非常強大的文本編輯器,廣泛用于編程和配置文件的編輯。

為了安全起見,先備份當前的?sources.list?文件之后,再進行修改:

# 備份現有的軟件源列表

cp /etc/apt/sources.list /etc/apt/sources.list.bak

這個命令將當前的?sources.list?文件復制為一個名為?sources.list.bak?的備份文件。這是一個好習慣,因為編輯?sources.list?文件時可能會出錯,導致無法安裝或更新軟件包。有了備份,如果出現問題,您可以輕松地恢復原始的文件。

# 編輯軟件源列表文件

vim /etc/apt/sources.list

這個命令使用 Vim 編輯器打開?sources.list?文件,以便您可以編輯它。這個文件包含了 APT(Advanced Package Tool)用于安裝和更新軟件包的軟件源列表。通過編輯這個文件,您可以添加新的軟件源、更改現有軟件源的優先級或禁用某些軟件源。

在 Vim 中,您可以使用方向鍵來移動光標,i?鍵進入插入模式(可以開始編輯文本),Esc?鍵退出插入模式,:wq?命令保存更改并退出 Vim,或?:q!?命令不保存更改并退出 Vim。

編輯?sources.list?文件時,請確保您了解自己在做什么,特別是如果您正在添加新的軟件源。錯誤的源可能會導致軟件包安裝失敗或系統安全問題。如果您不確定,最好先搜索并找到可靠的源信息,或者咨詢有經驗的 Linux 用戶。

使用 Vim 編輯器打開?sources.list?文件,復制以下代碼替換?sources.list里面的全部代碼,配置 apt 國內阿里源。

deb http://mirrors.aliyun.com/ubuntu/ jammy main restricted universe multiverse

deb-src http://mirrors.aliyun.com/ubuntu/ jammy main restricted universe multiverse

deb http://mirrors.aliyun.com/ubuntu/ jammy-security main restricted universe multiverse

deb-src http://mirrors.aliyun.com/ubuntu/ jammy-security main restricted universe multiverse

deb http://mirrors.aliyun.com/ubuntu/ jammy-updates main restricted universe multiverse

deb-src http://mirrors.aliyun.com/ubuntu/ jammy-updates main restricted universe multiverse

deb http://mirrors.aliyun.com/ubuntu/ jammy-backports main restricted universe multiverse

deb-src http://mirrors.aliyun.com/ubuntu/ jammy-backports main restricted universe multiverse

安裝常用軟件和工具

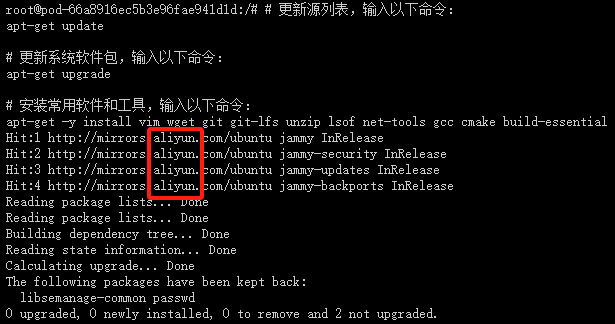

# 更新源列表,輸入以下命令:

apt-get update# 更新系統軟件包,輸入以下命令:

apt-get upgrade# 安裝常用軟件和工具,輸入以下命令:

apt-get -y install vim wget git git-lfs unzip lsof net-tools gcc cmake build-essential

出現以下頁面,說明國內apt源已替換成功,且能正常安裝apt軟件和工具

2. 安裝 NVIDIA CUDA Toolkit 12.1

- 下載 CUDA Keyring?:

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64/cuda-keyring_1.0-1_all.deb

這個命令用于下載 CUDA 的 GPG 密鑰環,它用于驗證 CUDA 軟件包的簽名。這是確保軟件包安全性的一個重要步驟。

- 安裝 CUDA Keyring?:

dpkg -i cuda-keyring_1.0-1_all.deb

使用?dpkg?安裝下載的密鑰環。這是必要的,以便?apt?能夠驗證從 NVIDIA 倉庫下載的軟件包的簽名。

- 刪除舊的 apt 密鑰(如果必要)?:

apt-key del 7fa2af80

這一步可能不是必需的,除非您知道?7fa2af80?是與 CUDA 相關的舊密鑰,并且您想從系統中刪除它以避免混淆。通常情況下,如果您只是安裝 CUDA 并使用 NVIDIA 提供的最新密鑰環,這一步可以跳過。

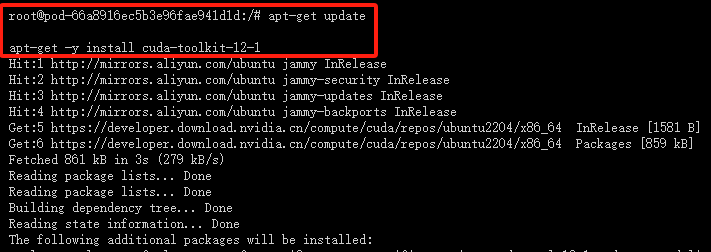

- 更新 apt 包列表?:

apt-get update

更新 apt 的軟件包列表,以便包括剛剛通過?cuda-keyring?添加的 NVIDIA 倉庫中的軟件包。

- 安裝 CUDA Toolkit?:

apt-get -y install cuda-toolkit-12-1

出現以下頁面,說明 NVIDIA CUDA Toolkit 12.1 安裝成功

注意:這里可能有一個問題。NVIDIA 官方 Ubuntu 倉庫中可能不包含直接名為?cuda-toolkit-12-1?的包。通常,您會安裝一個名為?cuda?或?cuda-12-1?的元包,它會作為依賴項拉入 CUDA Toolkit 的所有組件。請檢查 NVIDIA 的官方文檔或倉庫,以確認正確的包名。

如果您正在尋找安裝特定版本的 CUDA Toolkit,您可能需要安裝類似?cuda-12-1?的包(如果可用),或者從 NVIDIA 的官方網站下載 CUDA Toolkit 的?.run?安裝程序進行手動安裝。

請確保您查看 NVIDIA 的官方文檔或 Ubuntu 的 NVIDIA CUDA 倉庫以獲取最準確的包名和安裝指令。

- 出現以上情況,需要配置 NVIDIA CUDA Toolkit 12.1 系統環境變量

編輯 ~/.bashrc 文件

# 編輯 ~/.bashrc 文件

vim ~/.bashrc

插入以下環境變量

# 插入以下環境變量

export PATH=/usr/local/cuda/bin:$PATH

export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH

激活 ~/.bashrc 文件

# 激活 ~/.bashrc 文件

source ~/.bashrc

查看cuda系統環境變量

which nvcc

nvcc -V

3. 安裝 Miniconda

- 下載 Miniconda 安裝腳本?:

- 使用?

wget?命令從 Anaconda 的官方倉庫下載 Miniconda 的安裝腳本。Miniconda 是一個更小的 Anaconda 發行版,包含了 Anaconda 的核心組件,用于安裝和管理 Python 包。

- 使用?

- 運行 Miniconda 安裝腳本?:

- 使用?

bash?命令運行下載的 Miniconda 安裝腳本。這將啟動 Miniconda 的安裝過程。

- 使用?

# 下載 Miniconda 安裝腳本

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh# 運行 Miniconda 安裝腳本

bash Miniconda3-latest-Linux-x86_64.sh# 初次安裝需要激活 base 環境

source ~/.bashrc

按下回車鍵(enter)

輸入yes

輸入yes

安裝成功如下圖所示

pip配置清華源加速

# 編輯 /etc/pip.conf 文件

vim /etc/pip.conf

加入以下代碼

[global]

index-url = https://pypi.tuna.tsinghua.edu.cn/simple

注意事項:

- 請確保您的系統是 Linux x86_64 架構,因為下載的 Miniconda 版本是為該架構設計的。

- 在運行安裝腳本之前,您可能需要使用?

chmod +x Miniconda3-latest-Linux-x86_64.sh?命令給予腳本執行權限。 - 安裝過程中,您將被提示是否同意許可協議,以及是否將 Miniconda 初始化。通常選擇 “yes” 以完成安裝和初始化。

- 安裝完成后,您可以使用?

conda?命令來管理 Python 環境和包。 - 如果鏈接無法訪問或解析失敗,可能是因為網絡問題或鏈接本身的問題。請檢查網絡連接,并確保鏈接是最新的和有效的。如果問題依舊,請訪問 Anaconda 的官方網站獲取最新的下載鏈接。

4. 設置中文環境(可選)

在終端出現中文亂碼時,需要設置中文環境

apt update && apt install sudo -y

apt update && apt install -y curlvim sj_zh_CN_UTF_8.sh

chmod +x sj_zh_CN_UTF_8.sh

./sj_zh_CN_UTF_8.sh

source ~/.bashrc

sj_zh_CN_UTF_8.sh?內容:

#!/bin/bash# 更新系統軟件包

sudo apt-get update# 安裝所需工具

sudo apt-get install -y sudo locales vim# 編輯并生成語言環境

echo "zh_CN.UTF-8 UTF-8" | sudo tee -a /etc/locale.gen

echo "en_US.UTF-8 UTF-8" | sudo tee -a /etc/locale.gen# 生成語言環境

sudo locale-gen# 設置默認語言環境為中文

sudo update-locale LANG=zh_CN.UTF-8# 更新~/.bashrc以確保LANG環境變量持久生效

echo 'export LANG=zh_CN.UTF-8' >> ~/.bashrc# 使修改立即生效

source ~/.bashrc# 輸出當前語言環境

locale5. 下載預訓練模型

使用 modelscope 下載:Kimi-Dev-72B 的開源的模型文件

# 安裝 modelscope 依賴包

pip install modelscope# 下載模型到指定文件夾

modelscope download --model moonshotai/Kimi-Dev-72B --local_dir ./moonshotai/Kimi-Dev-72B

里我下載到了數據社區,可以在實例中通過路徑使用:/root/sj-data/LargeModel/TextGeneration/moonshotai/Kimi-Dev-72B

6. vLLM + open-webui 部署模型

Kimi-Dev-72B 使用vLLM進行高吞吐量和內存高效的 LLM 推理和托管引擎 。

建設將vllm和open-webui分到不環境中安裝,避免沖突

#在cond的base環境安裝vllm

pip install transformers vllm #創建一個虛擬環境安裝open-webui

pip install open-webui測試:首先啟動vllm,加載數據社區的Kimi-Dev-72B模型,注意:8*24G還是不能完全部署Kimi-Dev-72B,需要量化成fp8 (–quantization fp8)

ln -s /root/sj-data/LargeModel/TextGeneration/moonshotai/Kimi-Dev-72B Kimi-Dev-72B

vllm serve Kimi-Dev-72B --tensor-parallel-size 8 --enable-reasoning --gpu-memory-utilization 0.85 --max-num-seqs 8 --quantization fp8 --host 0.0.0.0 --port 8000

然后啟動open-webui,可以通過網頁訪問:

export HF_ENDPOINT=https://hf-mirror.com

export ENABLE_OLLAMA_API=False

export OPENAI_API_BASE_URL=http://127.0.0.1:8000/v1

export DEFAULT_MODELS="Kimi-Dev-72B"

open-webui serve

7. 設置反向代理

使用nginx反向代理,使用8080端口就可以同時使用open-webui和使用Kimi-Dev-72B的api版本;

安裝nginx

apt update && apt-get install nginx -y

nginx -v

sudo nginx

創建配置文件

/etc/nginx/conf.d/vllm_proxy.conf

# /etc/nginx/conf.d/vllm_proxy.conf# 定義上游服務器

upstream vllm_server {server 127.0.0.1:8000;keepalive 32;

}upstream openwebui_server {server 127.0.0.1:8081;keepalive 32;

}server {listen 8080;server_name localhost;client_max_body_size 100M;# 訪問日志access_log /var/log/nginx/vllm_proxy.log;error_log /var/log/nginx/vllm_proxy_error.log;# vLLM API 代理location /vllm/ {# 重寫URL:移除/vllm前綴rewrite ^/vllm/(.*)$ /$1 break;proxy_pass http://vllm_server/;proxy_set_header Host $host;proxy_set_header X-Real-IP $remote_addr;proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;proxy_set_header X-Forwarded-Proto $scheme;proxy_http_version 1.1;proxy_set_header Upgrade $http_upgrade;proxy_set_header Connection "upgrade";proxy_buffering off;proxy_request_buffering off;proxy_connect_timeout 300s;proxy_send_timeout 300s;proxy_read_timeout 300s;send_timeout 300s;}# OpenWebUI 代理location / {proxy_pass http://openwebui_server/;proxy_set_header Host $host;proxy_set_header X-Real-IP $remote_addr;proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;proxy_set_header X-Forwarded-Proto $scheme;proxy_http_version 1.1;proxy_set_header Upgrade $http_upgrade;proxy_set_header Connection "upgrade";proxy_buffering off;proxy_request_buffering off;}# 健康檢查端點location /health {add_header Content-Type application/json;return 200 '{"status":"OK","vllm_endpoint":"http://localhost:8080/vllm/","openwebui":"http://localhost:8080"}';}# 錯誤頁面error_page 502 503 504 /50x.html;location = /50x.html {root /usr/share/nginx/html;}

}

3.重新加載 Nginx 配置

sudo nginx -t && sudo nginx -s reload

7. 設置開機自己啟動

創建?vim /sj-run.sh?:注意這個腳本需要話根目錄下,然后執行?chmod 777 /sj-run.sh

#!/bin/bash# 腳本配置部分

MODEL_NAME="Kimi-Dev-72B" # 項目名稱

LOG_NAME="kimi_dev_72b.log" # vLLM 日志文件名

OPENWEBUI_LOG="openwebui.log" # OpenWebUI 日志文件名

MODEL_PATH="/" # 模型路徑

CONDA_PATH="/root/miniconda3/bin/conda" # Conda路徑

CONDA_ENV="base" # Conda環境名稱

MODEL_TIME="120" # vLLM啟動等待時間

OPENWEBUI_TIME="30" # OpenWebUI啟動等待時間# 端口配置

VLLM_PORT="8000" # vLLM 原始端口

OPENWEBUI_PORT="8081" # OpenWebUI 端口

NGINX_PORT="8080" # Nginx 對外端口# 啟動命令

START_VLLM="CUDA_VISIBLE_DEVICES=0,1,2,3,4,5,6,7 nohup vllm serve Kimi-Dev-72B \

--tensor-parallel-size 8 \

--gpu-memory-utilization 0.85 \

--max-num-seqs 8 \

--quantization fp8 \

--host 0.0.0.0 \

--port $VLLM_PORT \

--trust-remote-code \

--block-size 32 \

--max-model-len 16384 \

--dtype auto \

> logs/$LOG_NAME 2>&1 &"START_OPENWEBUI="export HF_ENDPOINT=https://hf-mirror.com && export ENABLE_OLLAMA_API=False && export OPENAI_API_BASE_URL=http://127.0.0.1:8000/v1 && export DEFAULT_MODELS="Kimi-Dev-72B" && export HF_HUB_OFFLINE=1 && nohup /root/miniconda3/envs/openwebui/bin/open-webui \

serve \

--port $OPENWEBUI_PORT \

> logs/$OPENWEBUI_LOG 2>&1 &"START_NGINX="sudo nginx -c /etc/nginx/nginx.conf"# Nginx 配置文件路徑

NGINX_CONF="/etc/nginx/conf.d/vllm_proxy.conf"# 顏色定義

RED='\033[0;31m'

GREEN='\033[0;32m'

YELLOW='\033[1;33m'

BLUE='\033[0;34m'

NC='\033[0m' # No Color# 日志函數

log_info() {echo -e "${BLUE}[INFO]${NC} $(date '+%Y-%m-%d %H:%M:%S') - $1"

}log_success() {echo -e "${GREEN}[SUCCESS]${NC} $(date '+%Y-%m-%d %H:%M:%S') - $1"

}log_warning() {echo -e "${YELLOW}[WARNING]${NC} $(date '+%Y-%m-%d %H:%M:%S') - $1"

}log_error() {echo -e "${RED}[ERROR]${NC} $(date '+%Y-%m-%d %H:%M:%S') - $1"

}# 打印幫助信息

print_help() {echo "Usage: $0 [Options]"echo "Options:"echo " -h 顯示幫助信息"echo " -s 啟動所有服務"echo " -t 停止所有服務"echo " -r 重啟所有服務"echo " -c 檢查服務狀態"echo " -l 查看日志"echo " -p 顯示服務端口信息"

}# 檢查必要的目錄和文件

check_prerequisites() {log_info "檢查運行環境..."# 檢查日志目錄if [ ! -d "logs" ]; thenlog_info "創建日志目錄: logs"mkdir -p "logs"fi# 檢查conda環境if ! command -v conda &> /dev/null; thenlog_error "conda命令未找到,請確保miniconda3已正確安裝"return 1fi# 檢查openwebui可執行文件if [ ! -f "/root/miniconda3/envs/openwebui/bin/open-webui" ]; thenlog_error "openwebui 可執行文件未找到: /root/miniconda3/envs/openwebui/bin/open-webui"return 1fi# 檢查nginxif ! command -v nginx &> /dev/null; thenlog_error "nginx 未安裝,請先安裝nginx"return 1fi# 檢查Nginx配置文件if [ ! -f "$NGINX_CONF" ]; thenlog_warning "Nginx配置文件不存在: $NGINX_CONF"log_warning "請創建配置文件以啟用反向代理"else# 測試Nginx配置if ! sudo nginx -t; thenlog_error "Nginx配置測試失敗"return 1fifireturn 0

}# 檢查端口是否占用

check_port() {local port=$1local service=$2if lsof -i :$port -t > /dev/null 2>&1; thenlog_warning "$service 端口 $port 已被占用"return 1fireturn 0

}# 啟動vLLM服務

start_vllm() {log_info "啟動 vLLM (Kimi-Dev-72B)..."if ! check_port $VLLM_PORT "vLLM"; thenlog_warning "vLLM端口$VLLM_PORT被占用,嘗試繼續啟動"fi# 進入目錄并設置環境cd $MODEL_PATHsource /root/miniconda3/etc/profile.d/conda.shconda activate $CONDA_ENV# 啟動模型eval $START_VLLM# 等待服務初始化sleep $MODEL_TIME# 檢查啟動狀態if pgrep -f "vllm serve Kimi-Dev-72B" > /dev/null; thenlog_success "vLLM 啟動成功 (端口: $VLLM_PORT)"elselog_error "vLLM 啟動失敗,請檢查日志: logs/$LOG_NAME"return 1fi

}# 啟動OpenWebUI

start_openwebui() {log_info "啟動 OpenWebUI..."if ! check_port $OPENWEBUI_PORT "OpenWebUI"; thenlog_warning "OpenWebUI端口$OPENWEBUI_PORT被占用,嘗試繼續啟動"fi# 啟動OpenWebUIeval $START_OPENWEBUI# 等待服務初始化sleep $OPENWEBUI_TIME# 檢查啟動狀態if pgrep -f "openwebui" > /dev/null; thenlog_success "OpenWebUI 啟動成功 (端口: $OPENWEBUI_PORT)"elselog_error "OpenWebUI 啟動失敗,請檢查日志: logs/$OPENWEBUI_LOG"return 1fi

}# 啟動Nginx

start_nginx() {log_info "啟動 Nginx..."if ! check_port $NGINX_PORT "Nginx"; thenlog_warning "Nginx端口$NGINX_PORT被占用,嘗試重新加載配置"sudo nginx -s reloadreturn $?fi# 啟動Nginxeval $START_NGINXsleep 2# 檢查啟動狀態if pgrep nginx > /dev/null; thenlog_success "Nginx 啟動成功 (端口: $NGINX_PORT)"elselog_error "Nginx 啟動失敗"return 1fi

}# 啟動所有服務

start_all_services() {log_info "開始啟動所有服務..."# 啟動vLLMstart_vllm || return 1# 啟動OpenWebUIstart_openwebui || return 1# 啟動Nginxstart_nginx || return 1log_success "所有服務啟動完成!"log_info "訪問地址: http://localhost:$NGINX_PORT"log_info "vLLM API端點: http://localhost:$NGINX_PORT/vllm/v1/completions"

}# 檢查服務狀態

check_service_status() {log_info "檢查服務狀態..."# 檢查vLLMif pgrep -f "vllm serve Kimi-Dev-72B" > /dev/null; thenlog_success "vLLM (Kimi-Dev-72B) 正在運行 (端口: $VLLM_PORT)"elselog_error "vLLM (Kimi-Dev-72B) 未運行"fi# 檢查OpenWebUIif pgrep -f "openwebui" > /dev/null; thenlog_success "OpenWebUI 正在運行 (端口: $OPENWEBUI_PORT)"elselog_error "OpenWebUI 未運行"fi# 檢查Nginxif pgrep nginx > /dev/null; thenlog_success "Nginx 正在運行 (端口: $NGINX_PORT)"elselog_error "Nginx 未運行"fi

}# 停止服務

stop_service() {local service_name=$1local process_name=$2log_info "停止 $service_name..."pkill -f "$process_name"# 等待進程結束local count=0while pgrep -f "$process_name" > /dev/null && [ $count -lt 15 ]; dosleep 1count=$((count + 1))doneif ! pgrep -f "$process_name" > /dev/null; thenlog_success "$service_name 已停止"elselog_error "$service_name 停止失敗,嘗試強制終止"pkill -9 -f "$process_name"sleep 2fi

}# 停止所有服務

stop_all_services() {log_info "停止所有服務..."# 停止vLLMstop_service "vLLM" "vllm serve Kimi-Dev-72B"# 停止OpenWebUIstop_service "OpenWebUI" "openwebui"# 停止Nginxlog_info "停止 Nginx..."sudo nginx -s quitsleep 2if ! pgrep nginx > /dev/null; thenlog_success "Nginx 已停止"elselog_error "Nginx 停止失敗,嘗試強制終止"sudo pkill -9 nginxfi

}# 重啟所有服務

restart_all_services() {log_info "重啟所有服務..."stop_all_servicessleep 5start_all_services

}# 查看日志

view_logs() {echo "選擇要查看的日志:"echo "1) vLLM 日志 (logs/$LOG_NAME)"echo "2) OpenWebUI 日志 (logs/$OPENWEBUI_LOG)"echo "3) Nginx 訪問日志 (/var/log/nginx/access.log)"echo "4) Nginx 錯誤日志 (/var/log/nginx/error.log)"echo "5) Nginx 配置日志 (/var/log/nginx/vllm_proxy.log)"echo "6) 退出"read -p "請輸入選項 [1-6]: " choicecase $choice in1) if [ -f "logs/$LOG_NAME" ]; thentail -f "logs/$LOG_NAME"elselog_error "日志文件不存在: logs/$LOG_NAME"fi;;2)if [ -f "logs/$OPENWEBUI_LOG" ]; thentail -f "logs/$OPENWEBUI_LOG"elselog_error "日志文件不存在: logs/$OPENWEBUI_LOG"fi;;3)if [ -f "/var/log/nginx/access.log" ]; thensudo tail -f /var/log/nginx/access.logelselog_error "日志文件不存在: /var/log/nginx/access.log"fi;;4)if [ -f "/var/log/nginx/error.log" ]; thensudo tail -f /var/log/nginx/error.logelselog_error "日志文件不存在: /var/log/nginx/error.log"fi;;5)if [ -f "/var/log/nginx/vllm_proxy.log" ]; thensudo tail -f /var/log/nginx/vllm_proxy.logelselog_error "日志文件不存在: /var/log/nginx/vllm_proxy.log"fi;;6) exit 0;;*) log_error "無效選項";;esac

}# 顯示端口信息

show_ports() {log_info "服務端口信息:"if pgrep -f "vllm serve Kimi-Dev-72B" > /dev/null; thenlog_success "vLLM 運行端口: $VLLM_PORT"elselog_error "vLLM 未運行"fiif pgrep -f "openwebui" > /dev/null; thenlog_success "OpenWebUI 運行端口: $OPENWEBUI_PORT"elselog_error "OpenWebUI 未運行"fiif pgrep nginx > /dev/null; thenlog_success "Nginx 運行端口: $NGINX_PORT"log_info "Web 訪問地址: http://localhost:$NGINX_PORT"log_info "vLLM API 代理地址: http://localhost:$NGINX_PORT/vllm/v1/completions"elselog_error "Nginx 未運行"fi

}# 主函數

main() {check_prerequisites || exit 1while getopts "hstrclp" opt; docase $opt inh) print_help ;;s) start_all_services ;;t) stop_all_services ;;r) restart_all_services ;;c) check_service_status ;;l) view_logs ;;p) show_ports ;;*) print_help ;;esacdone

}# 默認行為

if [ $# -eq 0 ]; thenstart_all_servicesexit 0

fimain "$@"

三、網頁演示

在容器中心,使用開放端口工具,獲取外部訪問地址訪問,程序啟動大概需要3分鐘,然后在使用web訪問。

第一次登錄需要注冊賬號,郵箱隨便填。

注:如果忘記賬號密碼導致無法登入界面,可以刪除賬號信息,選擇重新注冊:

(1)點擊文件管理,輸入?/root/miniconda3/envs/openwebui/lib/python3.12/site-packages/open_webui/data/?的路徑并進入

(2)刪除webui.db 這個文件,然后重新啟動即可

四、Kimi-Dev-72BAPI使用

可以使用網頁端開通的8080端口,訪問以下地址查看模型信息,并通過openai格式連接模型;

http://xn-a.suanjiayun.com:59923/vllm/v1/models

也可以使用隧道工具開發8080端口,使用連接

http://127.0.0.1:8080/vllm/v1/models

滑動窗口+暴力解)

--工作模式(1))