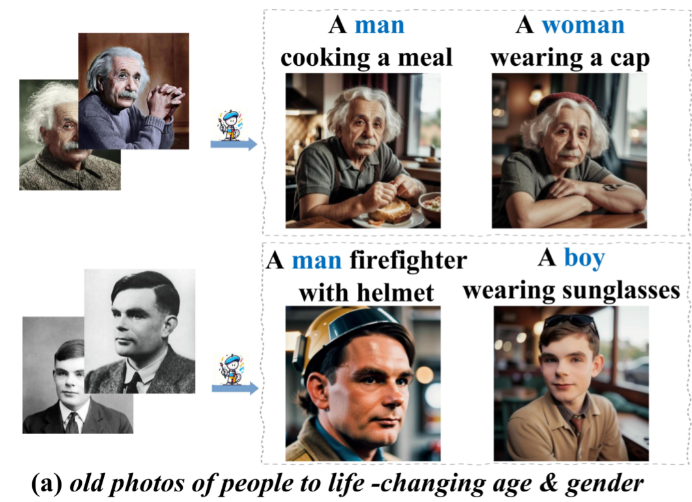

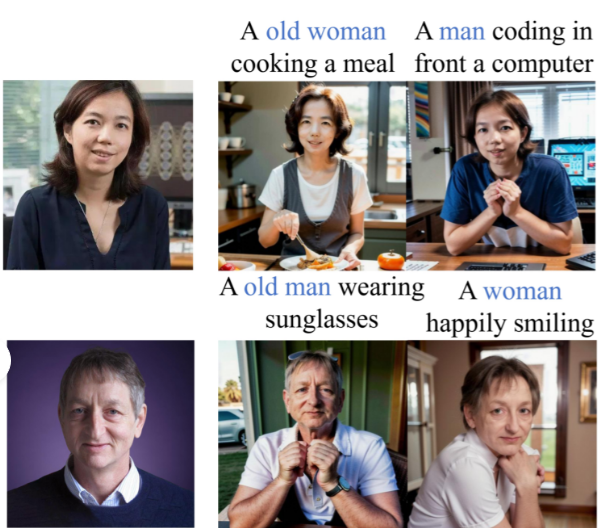

給定一些輸入ID的圖像,ConsistentID可以僅使用單個圖像根據文本提示生成不同的個性化ID圖像。效果看起來也是非常不錯。

相關鏈接

Code:https://github.com/JackAILab/ConsistentID

Paper:https://ssugarwh.github.io/consistentid.github.io/arXiv.pdf

Demo:https://huggingface.co/spaces/JackAILab/ConsistentID/

論文閱讀

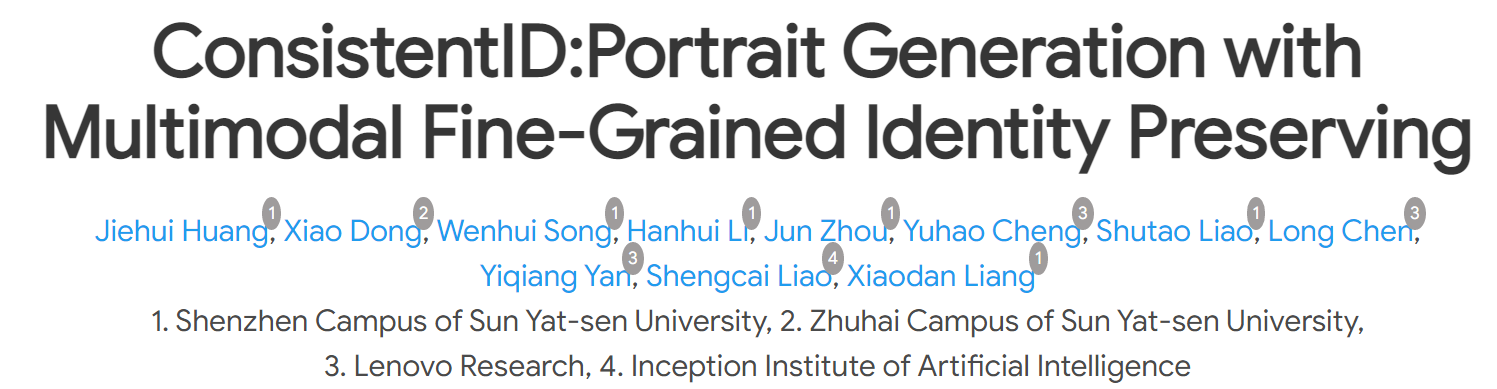

ConsistentID:具有多模式細粒度身份保護的肖像生成

摘要

基于擴散的技術已經取得了重大進展,特別是在個性化和定制的設施生成方面。然而,現有方法在實現高保真和詳細身份(ID)一致性方面面臨挑戰,這主要是由于對面部區域的細粒度控制不足,以及缺乏通過充分考慮錯綜復雜的面部細節和整體面部來保存ID的全面策略。

為了解決這些限制,我們引入了ConsistentID,這是一種創新的方法,專門用于在細粒度多模式面部提示下生成不同身份的人像,僅使用單個參考圖像。ConsistentID由兩個關鍵組件組成:一個多模式面部提示生成器,它將面部特征、相應的面部描述和整體面部上下文結合起來,以提高面部細節的準確性;一個通過面部注意力定位策略優化的ID保留網絡,旨在保留面部區域的ID一致性。這些組件通過引入面部區域的細粒度多模態ID信息,顯著提高了ID保存的準確性。

為了促進ConsistentID的訓練,我們提供了一個細粒度的人像數據集FGID,其中包含超過500,000張面部圖像,提供了比現有公共面部數據集更大的多樣性和全面性。%如里昂臉、CelebA、FFHQ和SFHQ。實驗結果證實,我們的ConsistentID在個性化面部生成方面實現了卓越的精度和多樣性,超過了MyStyle數據集上的現有方法。此外,雖然ConsistentID引入了更多的多模態ID信息,但它在生成過程中保持了較快的推理速度。

方法

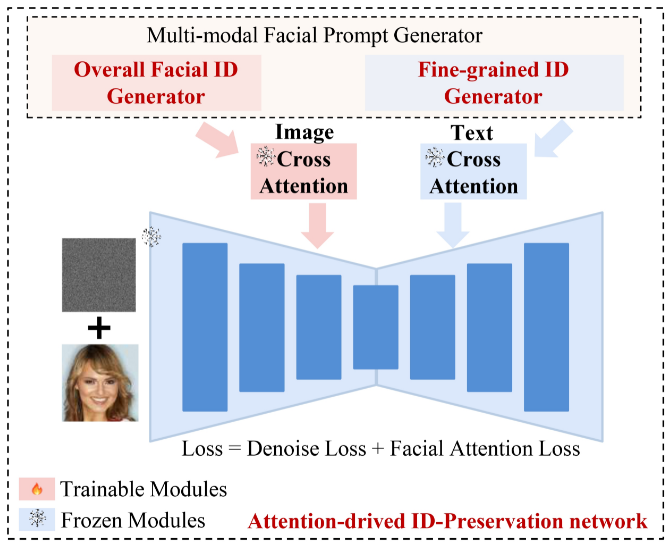

該框架包括兩個關鍵模塊:多模式面部身份生成器和有目的地制作的身份保留網絡。

-

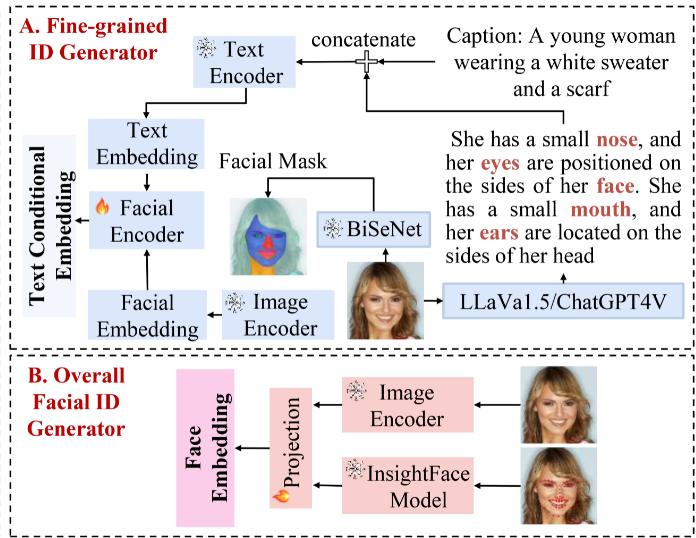

多模態面部提示生成器由兩個基本組件組成:一個細粒度的多模態特征提取器,專注于捕獲詳細的面部信息;一個面部ID特征提取器,專門用于學習面部ID特征。

-

另一方面,身份保留網絡利用面部文本和視覺提示,通過面部注意力定位策略防止來自不同面部區域的身份信息混合。這種方法確保了面部區域中ID一致性的保持。

實驗

ConsistentID改變角色年齡屬性的應用案例。

我們的模型與其他模型在兩個特殊任務上的定性比較:風格化和動作指導。

與更多基于微調的模型的比較。

重新語境化環境中的可視化。這些例子展示了ConsistentID的高身份保真度和文本編輯能力。

消融實驗

不同合并步驟下的可視化結果。合并步驟指示何時開始向文本提示添加面部圖像特征。

結論

在這項工作中,我們介紹了ConsistentID,這是一種創新的方法,旨在保持身份一致性并捕捉不同的面部細節。我們已經開發兩個新穎的模塊:多模式面部提示生成器和身份保存網絡。前者致力于通過在面部區域級別結合視覺和文本描述來生成多模式面部提醒。后者旨在通過面部注意力定位策略確保每個面部區域的ID一致性,防止ID信息混合不同的面部區域。

通過利用多模式細粒度提示,我們的方法僅使用單個面部圖像就實現了顯著的身份一致性和面部真實感。此外,我們還介紹了FGID數據集,這是一個全面的數據集,包含細粒度的身份信息和詳細的面部描述,對訓練ConsistentID模型至關重要。實驗結果在個性化面部生成方面表現出卓越的準確性和多樣性,超過了MyStyle數據集上的現有方法。

限制

在我們的方法中使用MLLM可能會引入一些限制,這些限制可能會影響模型性能的特定方面。約束條件有限的姿勢和表情可能會限制我們方法的多樣性, 影響其處理面部變化的能力。這些限制強調深入討論和探索的必要性,特別是在解決與GPT-4V的姿態、表達和整合相關的挑戰。

)

)

+ubuntu18.04)

)