大模型超越AI

前言

潔潔的個人主頁

我就問你有沒有發揮!

知行合一,志存高遠。

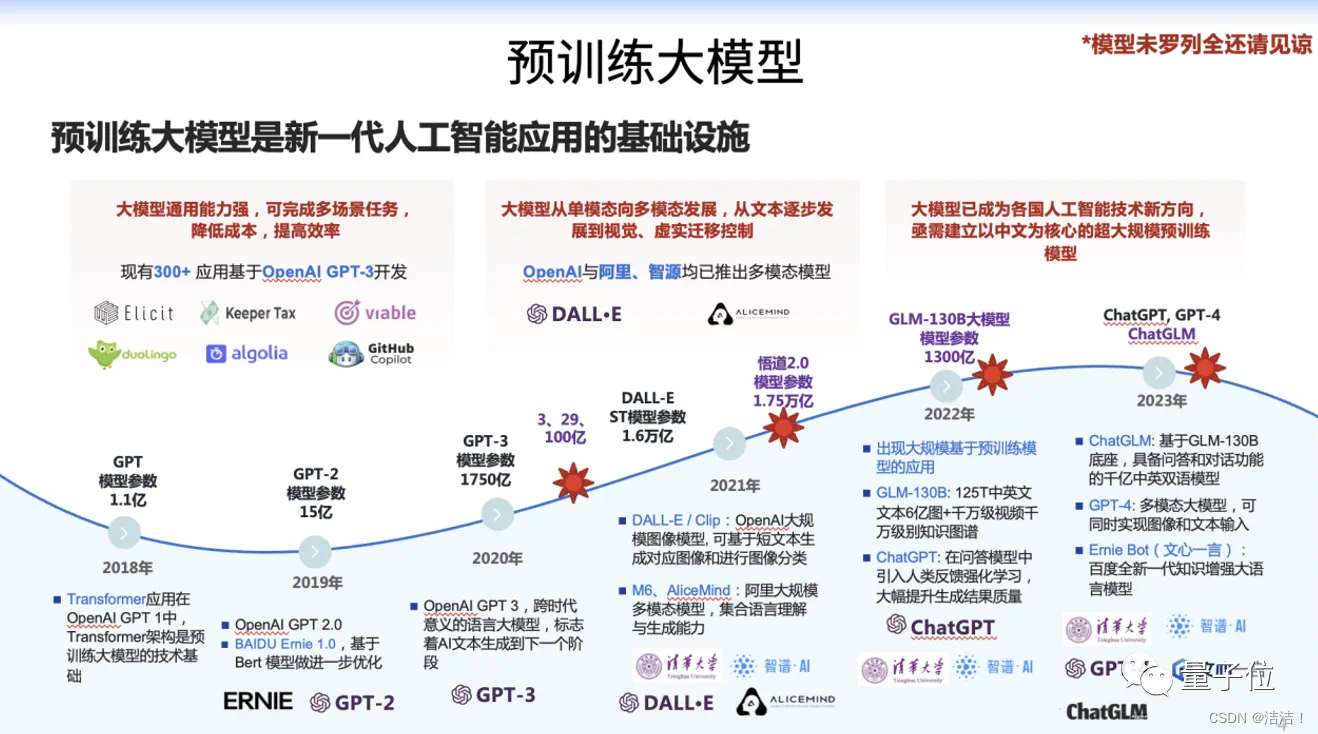

目前所指的大模型,是“大規模深度學習模型”的簡稱,指具有大量參數和復雜結構的機器學習模型,可以處理大規模的數據和復雜的問題,多應用于自然語言處理、計算機視覺、語音識別等領域。大模型具有更多的參數、更強的表達能力和更高的預測性能,對自然語言處理、計算機視覺和強化學習等任務產生了深遠的影響。本文將探討大模型的概念、訓練技術和應用領域,以及與大模型相關的挑戰和未來發展方向。

應用領域

首先來談一談大模型的·成就

大模型已經在許多應用領域取得了顯著的成果,包括:

- 自然語言處理:

import torch

from transformers import T5Tokenizer, T5ForConditionalGeneration# 加載預訓練模型和分詞器

model = T5ForConditionalGeneration.from_pretrained('t5-base')

tokenizer = T5Tokenizer.from_pretrained('t5-base')# 輸入文本

input_text = "Translate this text to French."# 分詞和編碼

input_ids = tokenizer.encode(input_text, return_tensors='pt')# 生成翻譯

translated_ids = model.generate(input_ids)

translated_text = tokenizer.decode(translated_ids[0], skip_special_tokens=True)print("Translated Text:", translated_text)

- 計算機視覺:

import torch

import torchvision.models as models

import torchvision.transforms as transforms

from PIL import Image# 加載預訓練模型和圖像預處理

model = models.resnet50(pretrained=True)

preprocess = transforms.Compose([transforms.Resize(256),transforms.CenterCrop(224),transforms.ToTensor(),transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])# 加載圖像

image = Image.open("image.jpg")# 圖像預處理

input_tensor = preprocess(image)

input_batch = input_tensor.unsqueeze(0)# 使用GPU加速

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

model.to(device)

input_batch = input_batch.to(device)# 前向傳播

with torch.no_grad():output = model(input_batch)# 輸出預測結果

_, predicted_idx = torch.max(output, 1)

predicted_label = predicted_idx.item()

print("Predicted Label:", predicted_label)

- 強化學習:

import gym

import torch

import torch.nn as nn

import torch.optim as optim

import torch.nn.functional as F# 創建神經網絡模型

class QNetwork(nn.Module):def __init__(self, state_size, action_size):super(QNetwork, self).__init__()self.fc1 = nn.Linear(state_size, 64)self.fc2 = nn.Linear(64, 64)self.fc3 = nn.Linear(64, action_size)def forward(self, x):x = F.relu(self.fc1(x))x = F.relu(self.fc2(x))x = self.fc3(x)return x# 初始化環境和模型

env = gym.make('CartPole-v0')

state_size = env.observation_space.shape[0]

action_size = env.action_space.n

model = QNetwork(state_size, action_size)

optimizer = optim.Adam(model.parameters(), lr=0.001)# 訓練過程

num_episodes = 100

for episode in range(num_episodes):state = env.reset()done = Falsewhile not done:# 選擇動作state_tensor = torch.tensor(state, dtype=torch.float).unsqueeze(0)q_values = model(state_tensor)action = torch.argmax(q_values, dim=1).item()# 執行動作并觀察結果next_state, reward, done, _ = env.step(action)# 計算損失函數next_state_tensor = torch.tensor(next_state, dtype=torch.float).unsqueeze(0)target_q_values = reward + 0.99 * torch.max(model(next_state_tensor))loss = F.mse_loss(q_values, target_q_values.unsqueeze(0))# 反向傳播和優化器步驟optimizer.zero_grad()loss.backward()optimizer.step()state = next_state# 輸出每個回合的總獎勵print("Episode:", episode, "Reward:", reward)

- 推薦系統:

import torch

from torch.utils.data import DataLoader

from torchvision.datasets import MNIST

from torchvision.transforms import ToTensor

from torch.nn import Linear, ReLU, Softmax

import torch.optim as optim# 加載數據集

train_dataset = MNIST(root='.', train=True, download=True, transform=ToTensor())

train_loader = DataLoader(train_dataset, batch_size=64, shuffle=True)# 創建推薦模型(多層感知機)

class Recommender(torch.nn.Module):def __init__(self):super(Recommender, self).__init__()self.flatten = torch.nn.Flatten()self.linear_relu_stack = torch.nn.Sequential(Linear(784, 512),ReLU(),Linear(512, 256),ReLU(),Linear(256, 10),Softmax(dim=1))def forward(self, x):x = self.flatten(x)logits = self.linear_relu_stack(x)return logitsmodel = Recommender()# 定義損失函數和優化器

loss_fn = torch.nn.CrossEntropyLoss()

optimizer = optim.SGD(model.parameters(), lr=0.001, momentum=0.9)# 訓練過程

num_epochs = 10

for epoch in range(num_epochs):for batch, (images, labels) in enumerate(train_loader):# 前向傳播outputs = model(images)loss = loss_fn(outputs, labels)# 反向傳播和優化器步驟optimizer.zero_grad()loss.backward()optimizer.step()print(f"Epoch {epoch+1}/{num_epochs}, Loss: {loss.item():.4f}")

什么是大模型?

大模型是指具有龐大參數數量的機器學習模型。傳統的機器學習模型通常只有幾百或幾千個參數,而大模型則可能擁有數億或數十億個參數。這種巨大的模型規模賦予了大模型更強的表達能力和預測能力,可以處理更為復雜的任務和數據。

訓練大模型的挑戰

訓練大模型需要應對一系列挑戰,包括:

-

以下是與大模型相關的一些代碼示例:

- 計算資源需求:

import tensorflow as tf# 指定使用GPU進行訓練 with tf.device('/gpu:0'):# 構建大模型model = build_large_model()# 使用大量計算資源進行訓練model.fit(train_data, train_labels, epochs=10, batch_size=128)- 數據集規模:

import tensorflow as tf from tensorflow.keras.preprocessing.image import ImageDataGenerator# 創建ImageDataGenerator對象,用于數據增強和擴充 datagen = ImageDataGenerator(rotation_range=20,width_shift_range=0.2,height_shift_range=0.2,shear_range=0.2,zoom_range=0.2,horizontal_flip=True,fill_mode='nearest' )# 加載大規模的圖像數據集 train_generator = datagen.flow_from_directory('train_data/',target_size=(224, 224),batch_size=32,class_mode='categorical' )# 使用大規模的數據集進行訓練 model.fit(train_generator, epochs=10)

- 優化算法:

import tensorflow as tf

from tensorflow.keras.optimizers import Adam# 構建大模型

model = build_large_model()# 使用改進后的優化算法(例如Adam)進行訓練

optimizer = Adam(learning_rate=0.001)

model.compile(loss='categorical_crossentropy', optimizer=optimizer, metrics=['accuracy'])# 使用大規模的數據集進行訓練

model.fit(train_data, train_labels, epochs=10, batch_size=128)

- 模型壓縮與部署:

import tensorflow as tf

from tensorflow.keras.models import load_model

from tensorflow.keras.models import Model# 加載已經訓練好的大模型

model = load_model('large_model.h5')# 進行模型壓縮,例如剪枝操作

pruned_model = prune_model(model)# 保存壓縮后的模型

pruned_model.save('pruned_model.h5')# 部署壓縮后的模型,例如使用TensorRT進行加速

trt_model = convert_to_tensorrt(pruned_model)

trt_model.save('trt_model.pb')

如何訓練大模型

為了克服訓練大模型的挑戰,研究人員提出了一些關鍵的技術:

-

以下是一些與上述技術相關的代碼示例:

分布式訓練:

import torch import torch.nn as nn import torch.optim as optim import torch.multiprocessing as mp from torch.nn.parallel import DistributedDataParallel as DDPdef train(rank, world_size):# 初始化進程組dist.init_process_group("gloo", rank=rank, world_size=world_size)# 創建模型并移至指定的計算設備model = MyModel().to(rank)ddp_model = DDP(model, device_ids=[rank])# 定義優化器和損失函數optimizer = optim.SGD(ddp_model.parameters(), lr=0.001)criterion = nn.CrossEntropyLoss()# 模擬數據集dataset = MyDataset()sampler = torch.utils.data.distributed.DistributedSampler(dataset, num_replicas=world_size, rank=rank)dataloader = torch.utils.data.DataLoader(dataset, batch_size=64, shuffle=False, sampler=sampler)# 訓練循環for epoch in range(10):for inputs, targets in dataloader:optimizer.zero_grad()outputs = ddp_model(inputs)loss = criterion(outputs, targets)loss.backward()optimizer.step()if __name__ == '__main__':world_size = 4 # 進程數量mp.spawn(train, args=(world_size,), nprocs=world_size)模型并行:

import torch import torch.nn as nn from torch.nn.parallel import DataParallelclass MyModel(nn.Module):def __init__(self):super(MyModel, self).__init__()self.conv1 = nn.Conv2d(3, 64, kernel_size=3)self.conv2 = nn.Conv2d(64, 128, kernel_size=3)self.fc = nn.Linear(128 * 10 * 10, 10)def forward(self, x):x = self.conv1(x)x = self.conv2(x)x = x.view(x.size(0), -1)x = self.fc(x [Something went wrong, please try again later.] -

數據并行示例:

import torch

import torch.nn as nn

from torch.nn.parallel import DataParallel# 創建模型

class MyModel(nn.Module):def __init__(self):super(MyModel, self).__init__()self.fc = nn.Linear(10, 5)def forward(self, x):return self.fc(x)model = MyModel()

model_parallel = DataParallel(model) # 默認使用所有可用的GPU進行數據并行input = torch.randn(16, 10) # 輸入數據

output = model_parallel(input)

3.混合精度訓練示例:

import torch

import torch.nn as nn

import torch.optim as optim

from apex import amp# 創建模型和優化器

model = MyModel()

optimizer = optim.Adam(model.parameters(), lr=0.001)# 混合精度訓練初始化

model, optimizer = amp.initialize(model, optimizer, opt_level="O2")# 訓練循環

for epoch in range(10):for inputs, targets in dataloader:optimizer.zero_grad()# 使用混合精度進行前向和反向傳播with amp.autocast():outputs = model(inputs)loss = criterion(outputs, targets)# 反向傳播和優化器步驟scaler.scale(loss).backward()scaler.step(optimizer)scaler.update()

4.模型壓縮示例:

import torch

import torch.nn as nn

import torch.optim as optim

import torch.nn.utils.prune as prune# 創建模型并加載預訓練權重

model = MyModel()

model.load_state_dict(torch.load('pretrained_model.pth'))# 剪枝

parameters_to_prune = ((model.conv1, 'weight'), (model.fc, 'weight'))

prune.global_unstructured(parameters_to_prune,pruning_method=prune.L1Unstructured,amount=0.5,

)# 量化

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

torch.quantization.prepare(model, inplace=True)

model.eval()

model = torch.quantization.convert(model, inplace=True)# 低秩分解

parameters_to_low_rank = ((model.conv1, 'weight'), (model.fc, 'weight'))

for module, name in parameters_to_low_rank:u, s, v = torch.svd(module.weight.data)k = int(s.size(0) * 0.1) # 保留前10%的奇異值module.weight.data = torch.mm(u[:, :k], torch.mm(torch.diag(s[:k]), v[:, :k].t()))# 訓練和優化器步驟

optimizer = optim.SGD(model.parameters(), lr=0.001, momentum=0.9)

criterion = nn.CrossEntropyLoss()

未來發展

盡管大模型在各個領域都取得了重要的進展,但仍然有很多挑戰需要解決。未來的發展方向可能包括:

- 更高效的訓練算法:研究人員將繼續致力于開發更高效、可擴展的訓練算法,以加快大模型的訓練速度。

- 更智能的模型壓縮技術:模型壓縮和加速技術將繼續發展,以減小大模型的計算和存儲開銷。

- 更好的計算平臺支持:為了支持訓練和部署大模型,計算平臺將繼續改進,提供更強大的計算資源和工具。

- 更好的跨模態應用:特別是在大場景下的表現能力十分突出。正在經歷智能化、制造革新的“車”,就有不少可以展開無限想象的大模型應用場景。

)

,C++ CSP考題(J居多,S偏少)的詳解,NOI的真題題解)